Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

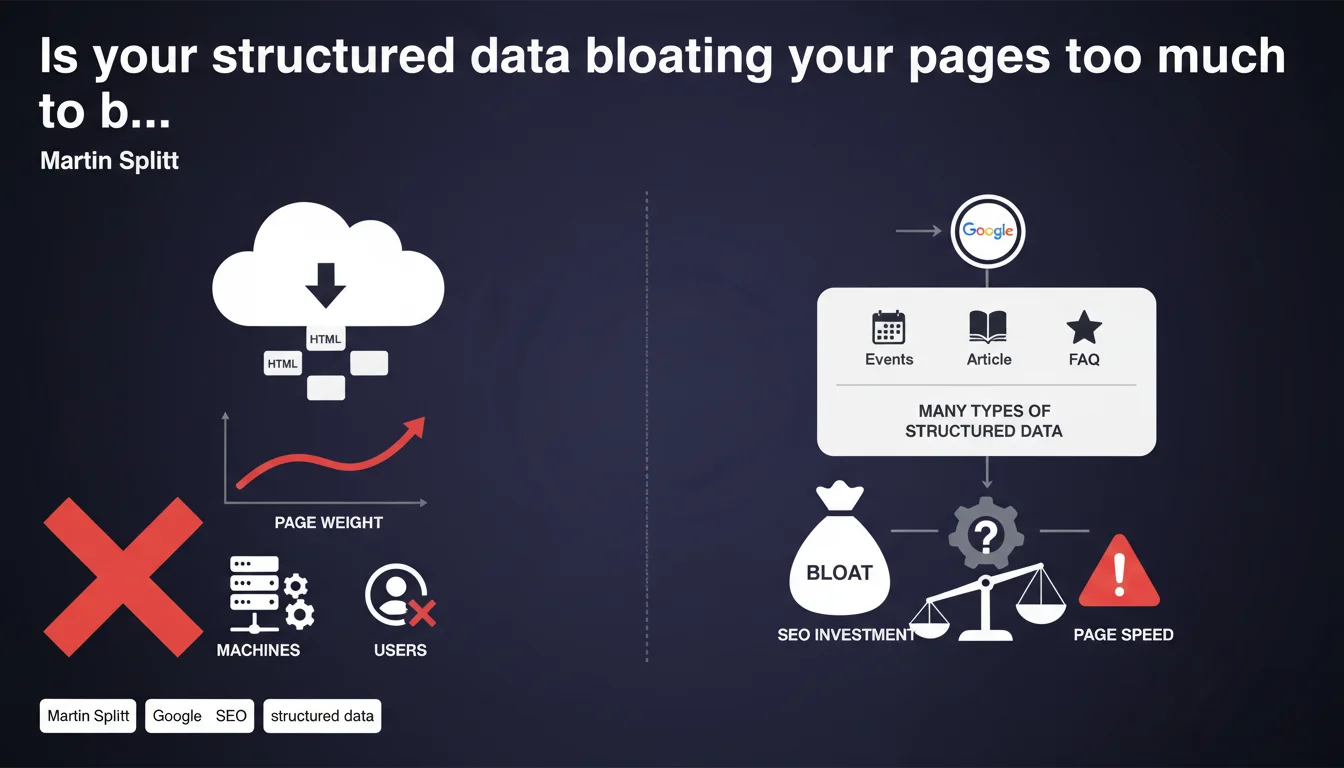

Google acknowledges that structured data can significantly increase a page's HTML weight, since this data is intended for machines rather than users. With the multiplication of supported markup types, code bloat has become a real problem that can impact performance if you're not careful.

What you need to understand

Why is Google raising the HTML weight question now?

Martin Splitt points out a technical paradox: the more Google encourages structured data adoption (and it does so massively), the more the volume of code invisible to the user explodes. SEO professionals stack schemas — Product, FAQ, Review, Breadcrumb, Organization, LocalBusiness, VideoObject, and more — in a race for visibility in rich SERPs.

The problem? This JSON-LD or microdata code can easily represent 30 to 50% of a page's total weight. On e-commerce sites with complex product sheets, you regularly see pages where structured data exceeds visible content. And that's starting to raise performance questions.

What exactly do we mean by "intended for machines"?

Structured data is invisible code to the end user. It doesn't display on screen, doesn't contribute to reading experience, and only has value for robots parsing the HTML. It's pure markup, redundant with visible content.

This redundancy is precisely what bloats the page: you describe your product in standard HTML for your visitors, then describe it again entirely in JSON-LD for Google. Same information, twice. The signal-to-noise ratio of HTML code degrades mechanically.

At what point does this extra weight become problematic?

Concretely, it depends on your weight budget and Core Web Vitals. If your page already weighs 1.5 MB with optimized images, minified JS, and critical CSS, adding 50 KB of JSON-LD isn't neutral. Especially on mobile with degraded connections.

TTFB and LCP can be impacted if the server has to generate and transmit more code. The browser must parse more HTML before displaying anything. It's marginal on lightweight pages, but becomes measurable on already heavy pages.

- Structured data is invisible code to users, but heavy for machines

- The multiplication of supported schemas encourages unlimited stacking without clear guidelines

- Performance impact depends on total page weight and connection quality

- The useful code-to-machine code ratio degrades with semantic markup inflation

SEO Expert opinion

Is this statement consistent with real-world observations?

Yes, absolutely. We regularly see that sites implementing every possible schema end up with pages that are 200-300 KB of pure HTML, half of which is JSON-LD. This is particularly visible on e-commerce sites that stack Product + AggregateRating + Offer + FAQPage + Breadcrumb + Organization.

But — and this is where it gets tricky — Google provides no threshold indication. From how many KB is the game no longer worth the candle? No idea. Splitt identifies the problem without proposing guardrails, which leaves SEOs in the dark. [To verify] whether Google actively penalizes pages too heavy in structured data, or if it's just an indirect effect through Core Web Vitals.

Should you reduce your structured data usage then?

No, and that's precisely the trap of this statement. Google says "watch your weight," but in parallel it continues to prioritize rich results in SERPs. If you remove your FAQ markup to lighten the page, you lose your rich snippet and your CTR collapses.

The real message to take away: be selective and pragmatic. Implement schemas that have measurable ROI (those that trigger visible rich snippets), not all those Google "supports." Nobody's asking you to mark up every detail of your content if it brings nothing to visibility.

Which structured data are truly a priority?

Focus on schemas with high SERP impact: Product/Offer for e-commerce, Recipe for food content, VideoObject for video content, FAQ/HowTo to capture space in results. The rest — Organization, BreadcrumbList, WebSite — is useful but secondary.

If your page already exceeds 150 KB of HTML and your Core Web Vitals are tight, remove schemas that trigger no differentiated display in Google. That's dead weight. Test with Search Console and the Rich Results Test: if the schema appears nowhere, cut it.

Practical impact and recommendations

How do you identify if your structured data is too heavy?

First reflex: measure your raw HTML weight. Open the inspector, display the full source code, and compare JSON-LD size to the rest of the document. If your structured data represents more than 30% of HTML weight, that's a warning signal.

Then test performance impact. Temporarily remove all JSON-LD and measure your Core Web Vitals before/after with PageSpeed Insights or WebPageTest. If LCP gains 200-300 ms, you have a problem.

What concrete actions should you take to optimize?

Prioritize schemas with ROI. Keep only those that trigger rich snippets or features visible in SERPs. Test each schema with the Rich Results Test and verify in Search Console that it actually generates enrichments.

Minify your JSON-LD. Remove unnecessary spaces, line breaks, optional properties without added value. A well-cleaned JSON-LD can lose 20-30% of weight without changing functionality.

Avoid duplication between schemas. If you mark up a product with Product + Offer + AggregateRating, verify that you're not repeating the same info (name, description, image) in each object. Factor out as much as possible.

- Measure total HTML weight and isolate the structured data portion

- Compare Core Web Vitals with and without JSON-LD to quantify impact

- Keep only schemas that trigger visible rich snippets

- Minify JSON-LD: remove spaces, line breaks, empty properties

- Factor common data between schemas to avoid redundancy

- Test regularly with Rich Results Test and Search Console

- Monitor HTML weight evolution across deployments

❓ Frequently Asked Questions

Le structured data peut-il réellement pénaliser mes Core Web Vitals ?

Faut-il supprimer certains schémas pour alléger mes pages ?

Quelle est la limite de poids acceptable pour le structured data ?

Le JSON-LD est-il plus lourd que les microdonnées ou RDFa ?

Peut-on compresser le structured data côté serveur ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.