Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

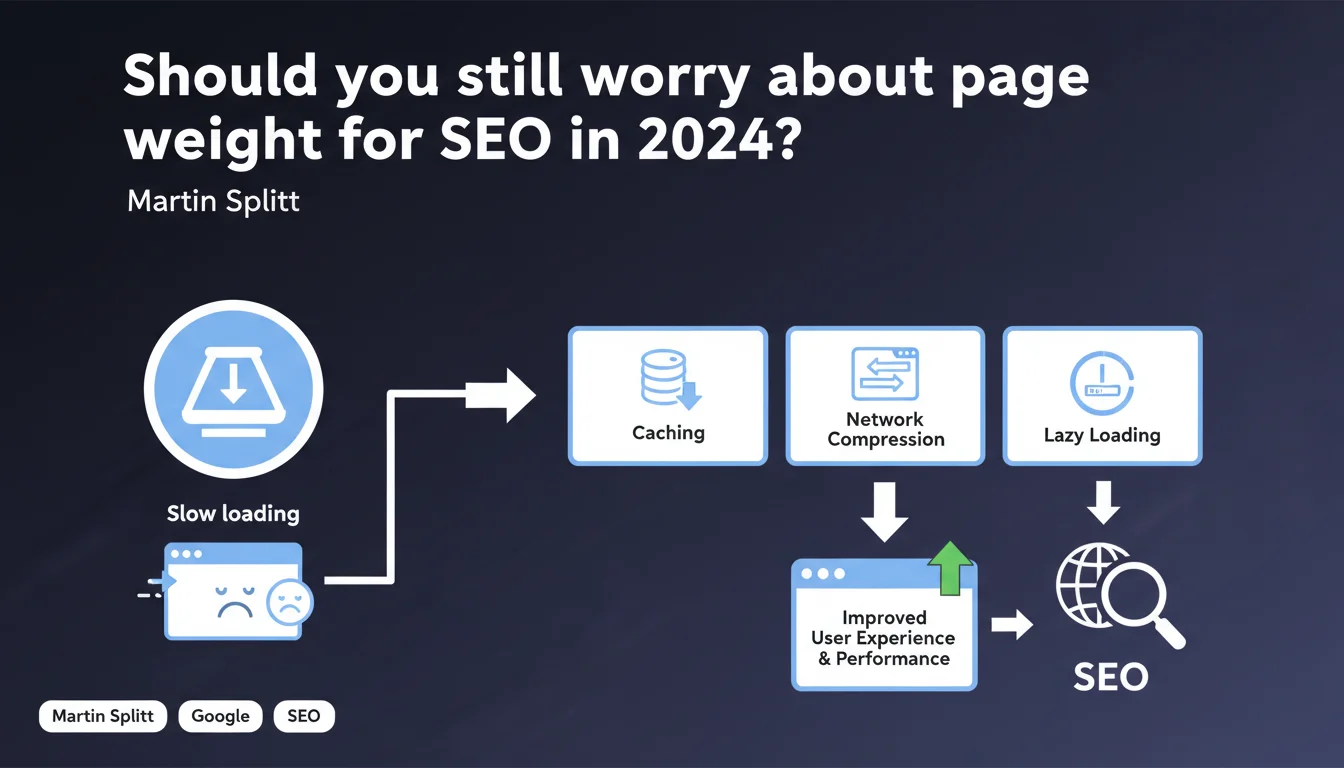

Google recommends three technical levers to neutralize the impact of page weight: caching, network compression, and lazy loading. The goal: maintain a smooth user experience without necessarily reducing the total volume of data. These mechanisms allow you to decouple technical weight from perceived performance.

What you need to understand

Why does Google insist on mechanisms rather than pure weight reduction?

Google's position reflects a reality: the modern web is visually rich, and asking sites to return to 500 KB pages is utopian. Users expect high-resolution images, embedded videos, interactive interfaces.

Rather than fighting this trend, Google recommends intelligently managing resource delivery. Caching avoids repeated downloads, compression drastically reduces transferred volume, lazy loading defers loading what isn't immediately visible.

What are the specific technical mechanisms mentioned and their exact role?

Caching (browser cache, CDN) stores static resources locally or on geographically close servers. Result: a resource is downloaded only once, then reused.

Network compression (Gzip, Brotli) compresses text files (HTML, CSS, JS) before transmission. A 200 KB CSS file can drop to 40 KB once compressed — that's 80% savings.

Lazy loading defers loading images and iframes outside the viewport. If a page contains 50 images but only 5 are visible above the fold, only those 5 load initially.

Is this approach sufficient to guarantee good performance?

No. These mechanisms mitigate the impact of weight, they don't eliminate it. A 10 MB page remains problematic even with cache and compression, especially on mobile with 3G connection.

Google isn't saying "ignore total weight". It's saying "use these tools so weight doesn't impact perceived experience". Crucial nuance.

- Caching: reduces repeated requests

- Network compression: decreases transferred volume (text only)

- Lazy loading: prioritizes immediately visible content

- These mechanisms complement but don't replace actual weight optimization

- Impact on Core Web Vitals (LCP, CLS) depends on implementation

SEO Expert opinion

Is this statement coherent with Core Web Vitals?

Yes, but with a major caveat. Core Web Vitals measure actual experience: LCP (time to load largest visible element), FID (interactivity), CLS (visual stability). The three mechanisms cited can improve these metrics — provided they're properly implemented.

Poorly configured lazy loading can actually degrade LCP if the hero image is deferred. Caching does nothing on first visit. Brotli compression requires server support that not all hosting providers natively offer.

Google remains vague on acceptable thresholds. At what weight do these mechanisms become insufficient? [To verify] — no quantified data accompanies this recommendation.

What risks does this approach present in practice?

The main danger: relying exclusively on these technical crutches and neglecting actual resource optimization. I've audited sites with lazy loading on 200 images at 3 MB each — technically "compliant" with recommendations, catastrophic for mobile experience.

Another pitfall observed in the field: lazy loading triggering CLS (Layout Shift) because image dimensions aren't reserved. Or Brotli compression overloading server CPU on undersized infrastructure.

Let's be honest: this statement gives a partial green light to sometimes questionable practices. "My pages are 5 MB but I have lazy loading so it's fine" — no, it probably isn't.

In which contexts are these recommendations insufficient?

On mobile with slow connection, lazy loading doesn't compensate for bloated DOM or blocking JavaScript. Cache doesn't work for new visitors (often the majority on some sites).

For e-commerce sites with hundreds of product listings, lazy loading alone doesn't solve Time to Interactive. If main JavaScript weighs 800 KB, even compressed, parsing blocks the main thread.

Practical impact and recommendations

What needs to be implemented concretely?

Caching: configure HTTP Cache-Control and Expires headers for your static resources (CSS, JS, images, fonts). Target 1-year duration for versioned files. Use a CDN to distribute geographically.

Network compression: enable Brotli (level 6-8 for CSS/JS) on your server or via your CDN. Fallback to Gzip if Brotli isn't supported. Verify with tools like GiftOfSpeed or DevTools that text files are actually compressed.

Lazy loading: implement the native HTML attribute loading="lazy" on off-viewport images. For older browsers, use a lightweight JS library (Lozad, Lazysizes). Always reserve dimensions (width/height) to avoid CLS.

Which mistakes should you absolutely avoid?

Never lazy-load the LCP image (Largest Contentful Paint) — this must load with absolute priority. Use fetchpriority="high" or preload if needed.

Don't enable overly aggressive compression (Brotli level 11) in real-time — marginal gains don't offset CPU load. Pre-compress assets at build time if possible.

Don't rely solely on browser cache: users clear their cache, switch devices. Cache should be a bonus, not the primary strategy.

How do you verify these optimizations are working?

Use PageSpeed Insights and WebPageTest to measure actual impact on LCP, TBT (Total Blocking Time), and CLS. Compare before/after with slow connection profiles (3G).

Check HTTP response headers via DevTools (Network tab): presence of content-encoding: br or gzip, correct cache-control headers.

Test lazy loading by slowly scrolling the page with network throttling enabled. Images should load just before entering the viewport, not too early, not too late.

- Enable Brotli/Gzip on server for HTML, CSS, JS, SVG, fonts

- Configure Cache-Control with long durations (1 year) for versioned resources

- Implement

loading="lazy"on all off-viewport images - Reserve dimensions (width/height) on all images to avoid CLS

- Never lazy-load the LCP image or critical resources

- Test actual impact on Core Web Vitals with mobile 3G profiles

- Regularly audit HTTP headers and RUM metrics (Real User Monitoring)

❓ Frequently Asked Questions

Le lazy loading natif (attribut HTML) suffit-il ou faut-il une bibliothèque JavaScript ?

La compression Brotli est-elle vraiment meilleure que Gzip ?

Quelle durée de cache définir pour les ressources statiques ?

Le lazy loading impacte-t-il le référencement des images dans Google Images ?

Ces optimisations suffisent-elles pour passer les Core Web Vitals ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.