Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

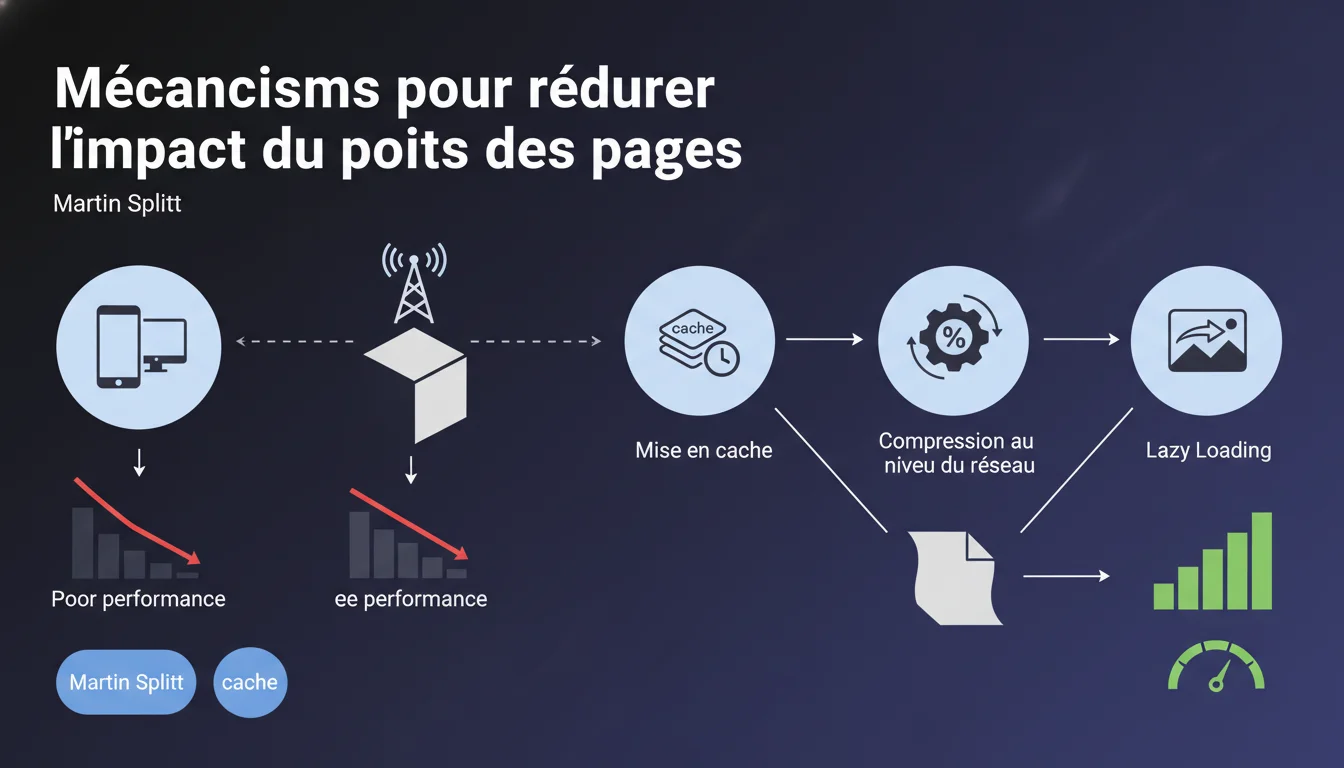

Google recommande trois leviers techniques pour neutraliser l'impact du poids des pages : mise en cache, compression réseau et lazy loading. L'objectif : maintenir une expérience utilisateur fluide sans nécessairement réduire le volume total de données. Ces mécanismes permettent de dissocier poids technique et performance perçue.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur les mécanismes plutôt que sur la réduction pure du poids ?

La position de Google traduit une réalité : le web moderne est visuellement riche, et demander aux sites de revenir à des pages de 500 Ko relève de l'utopie. Les utilisateurs attendent des images haute résolution, des vidéos intégrées, des interfaces interactives.

Plutôt que de lutter contre cette tendance, Google recommande de gérer intelligemment la livraison des ressources. La mise en cache évite les téléchargements répétés, la compression réduit drastiquement le volume transféré, le lazy loading diffère le chargement de ce qui n'est pas immédiatement visible.

Quels sont les mécanismes techniques mentionnés et leur rôle exact ?

La mise en cache (browser cache, CDN) stocke localement ou sur des serveurs géographiquement proches les ressources statiques. Résultat : une ressource n'est téléchargée qu'une fois, puis réutilisée.

La compression réseau (Gzip, Brotli) compresse les fichiers textuels (HTML, CSS, JS) avant transmission. Un fichier CSS de 200 Ko peut tomber à 40 Ko une fois compressé — soit 80% de gain.

Le lazy loading diffère le chargement des images et iframes hors viewport. Si une page contient 50 images mais que seules 5 sont visibles au-dessus de la ligne de flottaison, seules ces 5 se chargent initialement.

Cette approche suffit-elle à garantir de bonnes performances ?

Non. Ces mécanismes atténuent l'impact du poids, ils ne le suppriment pas. Une page de 10 Mo reste problématique même avec cache et compression, notamment sur mobile avec connexion 3G.

Google ne dit pas "ignorez le poids total". Il dit "utilisez ces outils pour que le poids n'impacte pas l'expérience perçue". Nuance cruciale.

- Mise en cache : réduit les requêtes répétées

- Compression réseau : diminue le volume transféré (texte uniquement)

- Lazy loading : priorise le contenu visible immédiatement

- Ces mécanismes complètent mais ne remplacent pas l'optimisation du poids réel

- L'impact sur Core Web Vitals (LCP, CLS) dépend de la mise en œuvre

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les Core Web Vitals ?

Oui, mais avec une grosse réserve. Les Core Web Vitals mesurent l'expérience réelle : LCP (temps de chargement du plus grand élément visible), FID (interactivité), CLS (stabilité visuelle). Les trois mécanismes cités peuvent améliorer ces métriques — à condition d'être bien implémentés.

Le lazy loading mal configuré peut justement dégrader le LCP si l'image principale est différée. La mise en cache ne sert à rien sur la première visite. La compression Brotli nécessite un support serveur que tous les hébergements ne proposent pas nativement.

Google reste vague sur les seuils acceptables. À partir de quel poids ces mécanismes deviennent-ils insuffisants ? [À vérifier] — aucune donnée chiffrée n'accompagne cette recommandation.

Quels risques cette approche présente-t-elle en pratique ?

Le principal danger : se reposer exclusivement sur ces béquilles techniques et négliger l'optimisation réelle des ressources. J'ai audité des sites avec du lazy loading sur 200 images de 3 Mo chacune — techniquement "conformes" aux recommandations, catastrophiques en expérience mobile.

Autre piège observé sur le terrain : le lazy loading qui déclenche du CLS (Layout Shift) parce que les dimensions des images ne sont pas réservées. Ou la compression Brotli qui surcharge le CPU serveur sur des infrastructures sous-dimensionnées.

Soyons honnêtes : cette déclaration donne un feu vert partiel à des pratiques parfois douteuses. "Mes pages font 5 Mo mais j'ai du lazy loading donc c'est OK" — non, ça ne l'est probablement pas.

Dans quels contextes ces recommandations sont-elles insuffisantes ?

Sur mobile avec connexion lente, le lazy loading ne compense pas un DOM surchargé ou du JavaScript bloquant. Le cache ne fonctionne pas pour les nouveaux visiteurs (souvent majoritaires sur certains sites).

Pour les sites e-commerce avec listings de centaines de produits, le lazy loading seul ne règle pas la question du Time to Interactive. Si le JavaScript principal pèse 800 Ko, même compressé, le parsing bloque le thread principal.

Impact pratique et recommandations

Que faut-il mettre en place concrètement ?

Mise en cache : configurez les headers HTTP Cache-Control et Expires pour vos ressources statiques (CSS, JS, images, fonts). Visez une durée de 1 an pour les fichiers versionnés. Utilisez un CDN pour distribuer géographiquement.

Compression réseau : activez Brotli (niveau 6-8 pour CSS/JS) sur votre serveur ou via votre CDN. Fallback sur Gzip si Brotli n'est pas supporté. Vérifiez avec des outils comme GiftOfSpeed ou les DevTools que les fichiers texte sont effectivement compressés.

Lazy loading : implémentez l'attribut HTML natif loading="lazy" sur les images hors viewport. Pour les navigateurs plus anciens, utilisez une bibliothèque JS légère (Lozad, Lazysizes). Réservez toujours les dimensions (width/height) pour éviter le CLS.

Quelles erreurs éviter absolument ?

Ne lazy-loadez jamais l'image LCP (Largest Contentful Paint) — celle-ci doit se charger en priorité absolue. Utilisez fetchpriority="high" ou preload si nécessaire.

N'activez pas une compression trop agressive (Brotli niveau 11) en temps réel — le gain marginal ne compense pas la charge CPU. Pré-compressez les assets au build si possible.

Ne comptez pas uniquement sur le cache navigateur : les utilisateurs vident leur cache, changent de device. Le cache doit être un bonus, pas la stratégie principale.

Comment vérifier que ces optimisations fonctionnent ?

Utilisez PageSpeed Insights et WebPageTest pour mesurer l'impact réel sur LCP, TBT (Total Blocking Time) et CLS. Comparez avant/après avec des profils de connexion lente (3G).

Vérifiez les headers de réponse HTTP via les DevTools (onglet Network) : présence de content-encoding: br ou gzip, headers cache-control corrects.

Testez le lazy loading en scrollant lentement dans la page avec le throttling réseau activé. Les images doivent se charger juste avant d'entrer dans le viewport, pas trop tôt, pas trop tard.

- Activer Brotli/Gzip sur le serveur pour HTML, CSS, JS, SVG, fonts

- Configurer Cache-Control avec des durées longues (1 an) pour ressources versionnées

- Implémenter

loading="lazy"sur toutes les images hors viewport - Réserver dimensions (width/height) sur toutes les images pour éviter CLS

- Ne jamais lazy-loader l'image LCP ni les ressources critiques

- Tester l'impact réel sur Core Web Vitals avec des profils mobile 3G

- Auditer régulièrement les headers HTTP et les métriques RUM (Real User Monitoring)

❓ Questions frequentes

Le lazy loading natif (attribut HTML) suffit-il ou faut-il une bibliothèque JavaScript ?

La compression Brotli est-elle vraiment meilleure que Gzip ?

Quelle durée de cache définir pour les ressources statiques ?

Le lazy loading impacte-t-il le référencement des images dans Google Images ?

Ces optimisations suffisent-elles pour passer les Core Web Vitals ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.