Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

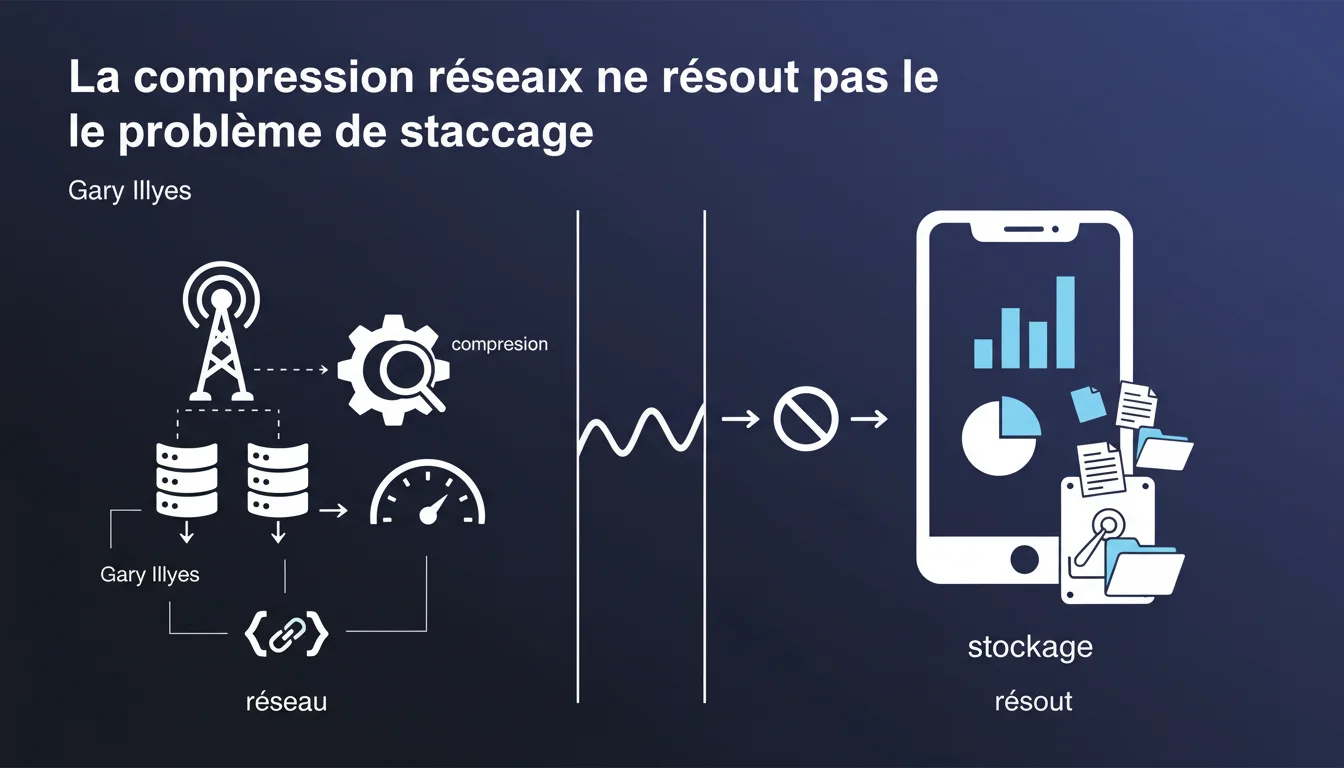

La compression réseau accélère le transfert de données mais ne réduit pas l'espace occupé sur l'appareil de l'utilisateur une fois les fichiers décompressés. Cette distinction est cruciale pour comprendre l'impact réel de vos ressources sur l'expérience utilisateur, notamment sur mobile où le stockage est limité.

Ce qu'il faut comprendre

Pourquoi cette distinction entre compression réseau et stockage local ?

La compression réseau (gzip, Brotli) compresse les fichiers lors de leur transit entre le serveur et le navigateur. Elle réduit la bande passante consommée et accélère le chargement initial.

Mais une fois que le navigateur reçoit ces fichiers — JavaScript, CSS, images — il les décompresse en mémoire pour les utiliser. Sur le disque local (cache navigateur, PWA, données applicatives), ils occupent leur taille réelle, non compressée.

En quoi cela concerne-t-il le SEO ?

Les Core Web Vitals mesurent en partie la performance perçue. Si vos ressources pèsent lourd une fois décompressées, elles saturent la mémoire vive et le cache local, surtout sur mobile.

Concrètement : un fichier JavaScript de 500 Ko compressé peut faire 2 Mo décompressé. Le navigateur devra gérer ces 2 Mo en mémoire. Si l'appareil manque de ressources, le site ralentit, même si le transfert réseau était rapide.

Quelle différence avec la compression d'images ?

Les formats d'images modernes (WebP, AVIF) compressent de manière permanente le fichier source. Une image WebP de 50 Ko reste 50 Ko sur le disque et en mémoire.

La compression réseau, elle, ne fait que réduire le poids pendant le transfert. C'est un gain temporaire, pas structurel.

- La compression réseau (gzip, Brotli) ne s'applique que pendant le transfert HTTP

- Les fichiers occupent leur taille complète en cache local et en mémoire

- Sur mobile, le stockage limité peut forcer le navigateur à vider le cache plus souvent, dégradant l'UX

- Les images doivent être optimisées à la source (WebP, AVIF), pas uniquement compressées au niveau réseau

- Les Core Web Vitals peuvent souffrir si les ressources décompressées saturent la mémoire de l'appareil

Avis d'un expert SEO

Cette déclaration remet-elle en cause les bonnes pratiques actuelles ?

Non. Elle clarifie une confusion courante : activer gzip ou Brotli ne dispense pas d'optimiser le poids réel de vos fichiers sources. Beaucoup pensent qu'une fois la compression activée, le problème de performance est réglé. C'est faux.

Les outils comme Lighthouse ou PageSpeed Insights mesurent les performances réelles, incluant la mémoire utilisée et le parsing JavaScript. Un JS compressé mais mal écrit ou trop volumineux à l'origine restera un boulet, même avec Brotli activé.

Où cette règle s'applique-t-elle le plus concrètement ?

Sur les Progressive Web Apps et les sites stockant des ressources en cache local via Service Workers. Si vous mettez en cache 10 Mo de JS/CSS compressés, ils occuperont leur taille décompressée sur l'appareil — potentiellement 30-40 Mo.

Sur un smartphone Android milieu de gamme avec 32 Go de stockage saturés, le navigateur videra ce cache rapidement. L'utilisateur devra retélécharger les ressources à chaque visite, annulant tout bénéfice de mise en cache.

Y a-t-il des cas où cette distinction est négligeable ?

Sur desktop avec stockage abondant et RAM confortable, oui. Mais le mobile-first indexing de Google impose de raisonner d'abord pour les appareils contraints. [À vérifier] : Google n'a jamais précisé si Googlebot simule ces contraintes de stockage local lors du crawl mobile, mais les signaux UX (taux de rebond, engagement) en pâtissent, et ça, Google le mesure.

Impact pratique et recommandations

Que faut-il optimiser concrètement au-delà de la compression réseau ?

D'abord, réduire le poids source de vos fichiers JavaScript et CSS. Tree-shaking, code splitting, suppression des dépendances inutiles. Un fichier plus léger à la source reste léger partout — en transit, en cache, en mémoire.

Ensuite, adopter des formats d'images modernes (WebP, AVIF) qui intègrent une compression permanente dans le fichier lui-même. Une image de 200 Ko en JPEG peut descendre à 50 Ko en WebP sans perte visible, et cette réduction persiste partout.

Comment vérifier l'impact réel sur le stockage et la mémoire ?

Utilisez les DevTools Chrome : l'onglet Performance enregistre la mémoire consommée pendant le chargement. L'onglet Application > Cache Storage montre le poids réel des fichiers mis en cache localement.

Testez sur un appareil Android bas de gamme avec stockage saturé. Si le cache est régulièrement vidé, vos ressources sont trop lourdes.

Quelles erreurs fréquentes éviter ?

Ne pas confondre compression réseau (gzip/Brotli) et optimisation source. Activer Brotli ne dispense pas de minifier, d'optimiser les images à la source, ou de réduire les bundles JS.

Ne pas ignorer les contraintes mobiles : un site rapide sur desktop avec fibre optique peut être catastrophique sur 4G avec un smartphone à 150 euros. Google indexe le mobile d'abord.

- Activer gzip ou Brotli sur tous les fichiers texte (HTML, CSS, JS, JSON, XML)

- Minifier et tree-shake le JavaScript à la source pour réduire le poids décompressé

- Convertir les images en WebP ou AVIF pour une compression permanente

- Auditer le poids des fichiers en cache local via DevTools > Application

- Tester les performances sur un appareil Android bas de gamme avec stockage saturé

- Surveiller la mémoire consommée via DevTools > Performance

- Limiter le poids total des ressources mises en cache par les Service Workers (max 10-15 Mo décompressés)

- Réévaluer régulièrement les dépendances npm : beaucoup de librairies pèsent lourd une fois décompressées

❓ Questions frequentes

La compression Brotli est-elle meilleure que gzip pour réduire le stockage local ?

Les images WebP sont-elles compressées uniquement au niveau réseau ?

Les Service Workers cachent-ils les fichiers compressés ou décompressés ?

Google pénalise-t-il les sites dont les ressources occupent trop d'espace en cache ?

Faut-il désactiver la compression réseau si on optimise déjà les fichiers sources ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.