Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

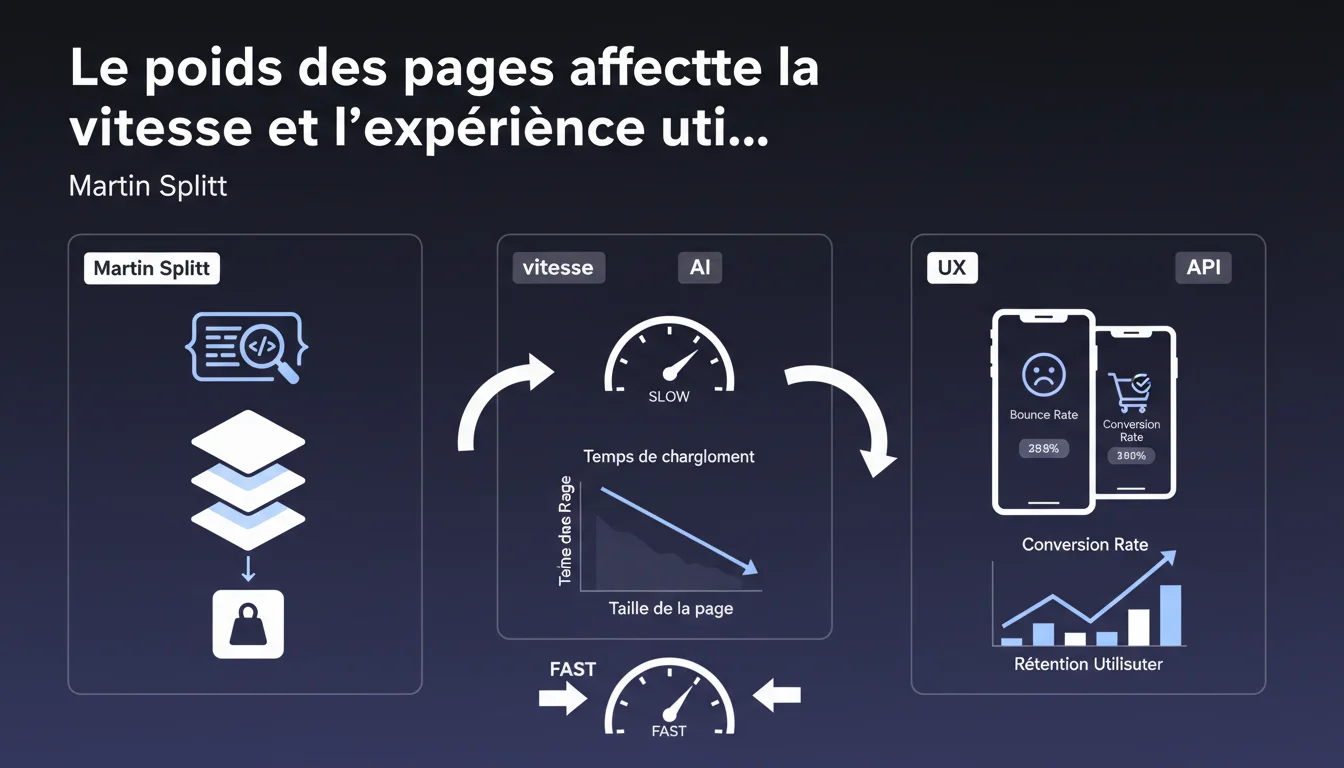

Google confirme que la taille des pages impacte directement la vitesse de chargement, qui elle-même influence la rétention et les conversions. Plus une page est lourde, plus le transfert et le traitement des données sont longs. Pour un SEO, c'est un rappel sans équivoque : optimiser le poids technique d'une page n'est pas un détail, c'est une variable de performance mesurable.

Ce qu'il faut comprendre

Cette déclaration ne révèle rien de révolutionnaire — on sait depuis des années que la vitesse compte. Mais elle a le mérite de poser les bases factuelles : la taille conditionne le temps de transfert, et ce temps affecte l'expérience. Pas de raccourci magique.

Ce qui importe ici, c'est la chaîne de causalité : poids → vitesse → comportement utilisateur → résultats business. Google ne dit pas explicitement que le poids influence le ranking, mais il relie vitesse et métriques d'engagement — qui, elles, peuvent jouer un rôle indirect.

Pourquoi Google insiste-t-il sur ce point maintenant ?

Parce que les sites deviennent de plus en plus lourds. Entre les frameworks JavaScript, les bibliothèques tierces, les trackers marketing et les images non compressées, certaines pages pèsent plusieurs méga-octets pour afficher… trois paragraphes de texte.

Google veut rappeler une évidence : chaque kilo-octet a un coût. Et ce coût se paie en latence, en bande passante mobile, en frustration utilisateur. Les études citées (sans sources détaillées, notez-le) montrent que les sites rapides convertissent mieux — c'est cohérent avec tout ce qu'on sait du comportement en ligne.

Le poids est-il le seul facteur de vitesse ?

Non. Le poids brut n'est qu'une partie du problème. Vous pouvez avoir une page de 500 Ko qui charge en 8 secondes à cause d'un JavaScript bloquant mal optimisé, et une page de 2 Mo qui s'affiche en 2 secondes grâce à un lazy loading bien fichu et un CDN performant.

La composition du poids compte autant que le poids total : images, CSS, JS, fonts, ressources tierces. Chaque type de ressource a son propre impact sur le rendering et l'interactivité. Le poids n'est qu'un proxy — ce qui compte vraiment, ce sont les Core Web Vitals et la perception utilisateur.

- Poids = temps de transfert : plus de données à télécharger = latence accrue, surtout sur mobile ou connexion lente

- Vitesse ≠ légèreté pure : une page lourde bien optimisée peut battre une page légère mal structurée

- Rétention et conversion : Google établit un lien direct entre rapidité et résultats business, sans entrer dans les détails des études

- Core Web Vitals : le poids influence LCP (ressources lourdes = temps de paint), CLS (fonts et images non dimensionnées), et FID/INP (JS lourd = main thread bloqué)

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, complètement. Les audits montrent systématiquement une corrélation entre poids de page et temps de chargement — c'est mécanique. Là où ça devient intéressant, c'est dans les priorités d'optimisation.

J'ai vu des sites à 3 Mo performer correctement parce que les ressources critiques étaient priorisées, le reste lazy-loadé, et le serveur rapide. À l'inverse, des sites à 800 Ko ramer à cause d'un JavaScript qui bloque le rendu ou d'une cascade de requêtes mal séquencées. Le poids brut est un indicateur, pas une sentence.

Que manque-t-il dans cette déclaration ?

Les données concrètes. Google parle d'« études » sans les sourcer. Quel type de sites ? Quels secteurs ? Quels seuils de poids déclenchent une baisse mesurable de rétention ? [A vérifier] — on aurait aimé des chiffres, pas juste un principe général.

Ensuite, la déclaration reste silencieuse sur l'arbitrage business. Parfois, un site lourd est justifié : une galerie photo haute résolution, un configurateur de produit interactif, un outil web complexe. L'enjeu n'est pas toujours de réduire coûte que coûte, mais d'optimiser ce qui existe et de mesurer l'impact réel sur les conversions.

Dans quels cas cette règle s'applique-t-elle moins ?

Quand l'audience est captive ou à forte intention. Un site B2B avec un trafic qualifié et des leads à forte valeur peut tolérer une page un peu plus lourde si elle apporte de la valeur (démos interactives, comparateurs détaillés). La vitesse reste importante, mais elle ne prime pas sur la fonctionnalité.

Par contre, sur un site e-commerce grand public ou un média à forte audience mobile, chaque milliseconde compte. Les utilisateurs ont des alternatives immédiates — ils ne vont pas attendre. C'est là que le poids devient critique pour la compétitivité.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire le poids sans sacrifier la qualité ?

Commencez par auditer la composition de vos pages. Utilisez un outil comme WebPageTest ou Lighthouse pour identifier les ressources les plus lourdes. Souvent, les images non optimisées représentent 60-80 % du poids total — c'est le levier numéro un.

Ensuite, compressez : WebP ou AVIF pour les images, minification pour CSS et JS, Gzip ou Brotli côté serveur. Lazy-loadez tout ce qui n'est pas immédiatement visible. Et challengez chaque script tiers : tracking, chat, pub — chacun ajoute du poids et de la latence, souvent sans ROI clair.

Quelles erreurs éviter ?

Ne vous focalisez pas uniquement sur le poids brut. J'ai vu des équipes passer des semaines à grappiller quelques Ko sur des images déjà optimisées, alors qu'un JavaScript tiers monopolisait le main thread pendant 3 secondes. Priorisez l'impact, pas la métrique vanity.

Autre piège : optimiser en local sans tester en conditions réelles. Vos pages chargent vite sur votre Mac avec la fibre ? Testez sur un smartphone mid-range avec une 4G fluctuante — c'est là que vous verrez les vrais problèmes.

Comment vérifier que vos optimisations fonctionnent ?

Mesurez avant/après avec des outils comme Lighthouse, PageSpeed Insights, ou mieux encore, des données RUM (Real User Monitoring) via Chrome UX Report ou vos propres analytics. Les Core Web Vitals sont vos indicateurs de référence : LCP, CLS, INP.

Surveillez aussi les métriques business : taux de rebond, temps sur la page, taux de conversion. Si vos optimisations techniques n'ont pas d'impact mesurable sur ces KPIs, c'est qu'il y a un autre problème — ou que vous optimisez le mauvais endroit.

- Auditez la composition de vos pages (images, JS, CSS, fonts, ressources tierces)

- Compressez les images (WebP, AVIF) et les assets (minification, Gzip/Brotli)

- Implémentez le lazy loading pour tout contenu below-the-fold

- Éliminez ou différez les scripts tiers non critiques

- Priorisez le chargement des ressources critiques (critical CSS, preload)

- Testez en conditions réelles (mobile, connexions lentes) via WebPageTest ou des devices physiques

- Mesurez l'impact sur les Core Web Vitals et les métriques business (taux de rebond, conversions)

Réduire le poids de vos pages n'est pas une fin en soi — c'est un moyen d'améliorer l'expérience utilisateur, donc la performance business. Concentrez-vous sur les leviers à fort impact : images, JavaScript, ressources tierces. Mesurez, itérez, et validez que vos optimisations se traduisent par des résultats concrets.

Ces chantiers techniques peuvent rapidement devenir complexes, surtout sur des sites à forte volumétrie ou des stacks techniques contraintes. Si vous manquez de ressources internes ou que vous voulez accélérer la mise en œuvre, collaborer avec une agence SEO spécialisée en performance web peut vous faire gagner un temps précieux et sécuriser vos gains.

❓ Questions frequentes

Le poids d'une page influence-t-il directement le classement dans Google ?

Quel est le poids idéal pour une page web en SEO ?

Les images sont-elles toujours le principal facteur de poids de page ?

Est-ce que lazy-loader les images suffit à régler les problèmes de poids ?

Comment mesurer l'impact réel du poids sur mes conversions ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.