Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

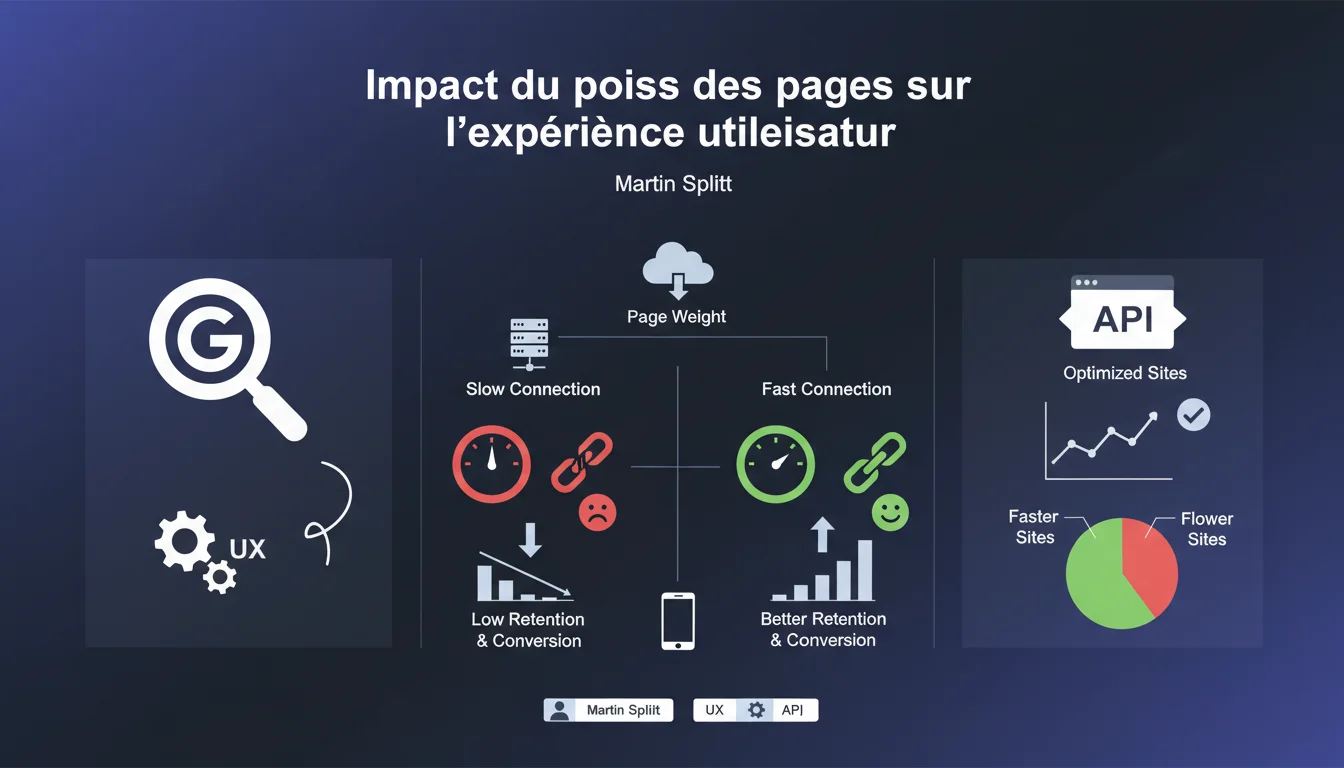

Google confirme que le poids des pages reste un enjeu majeur pour l'expérience utilisateur, surtout sur connexions lentes. Des sites plus rapides enregistrent de meilleurs taux de rétention et de conversion, selon les études évoquées. L'optimisation du poids n'est pas qu'une question technique — c'est un levier business direct.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il encore sur le poids des pages ?

Martin Splitt rappelle une évidence qu'on oublie trop vite : le poids des pages reste problématique pour une part significative des utilisateurs. Même si la fibre se démocratise, des millions d'internautes naviguent encore sur réseaux mobiles lents ou zones mal couvertes.

Google ne parle pas ici d'un critère de classement direct, mais d'un impact sur les métriques comportementales. Pages lourdes = temps de chargement élevé = utilisateurs qui abandonnent avant même d'avoir vu le contenu. Et ça, Google le mesure.

Quel lien entre poids des pages et taux de conversion ?

Les études mentionnées pointent toutes dans la même direction : sites rapides = meilleure rétention, meilleurs taux de conversion. Concrètement, chaque seconde de chargement supplémentaire fait fuir un pourcentage non négligeable de visiteurs.

C'est moins une question SEO pure qu'une question de performance commerciale. Mais comme les signaux utilisateurs influencent indirectement le référencement (taux de rebond, durée de session), tout se rejoint au final.

Est-ce vraiment nouveau comme message ?

Non. Google martèle ce discours depuis des années — Core Web Vitals, Page Experience, tout ça s'inscrit dans la même logique. Ce qui change, c'est que Splitt reformule avec des termes simples : le poids, ça plombe l'UX.

- Le poids des pages reste un frein majeur pour les connexions lentes

- Sites rapides = meilleure rétention et taux de conversion supérieurs

- Signaux utilisateurs indirects : temps de chargement impacte comportement, donc potentiellement classement

- Message cohérent avec Core Web Vitals et Page Experience

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, totalement. Depuis l'intégration des Core Web Vitals comme facteur de classement, on voit clairement que Google valorise les sites qui chargent vite. Mais attention — valorise ne veut pas dire propulse en première page automatiquement.

Dans la vraie vie, un site avec contenus médiocres mais ultra-rapide ne dépassera jamais un concurrent avec contenus solides mais légèrement plus lent. Le poids des pages joue, mais reste un critère parmi d'autres. Google ne le dit jamais explicitement dans ce genre de comm', et c'est dommage.

Quelles nuances faut-il apporter à ce message ?

Splitt parle d'études montrant l'impact sur rétention et conversion. Lesquelles ? Aucune précision. [A vérifier] — on aimerait des chiffres, des sources, pas juste une généralité. Ce genre de formulation floue laisse chacun interpréter à sa sauce.

Autre point : le "poids des pages" est une métrique trop large. Est-ce qu'on parle du poids total (Mo), du nombre de requêtes HTTP, du temps de rendu ? Un site peut peser lourd mais charger vite grâce au lazy loading, au CDN, à la compression. L'inverse existe aussi.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Pour certains types de sites, le poids est incompressible sans sacrifier la valeur ajoutée. Exemple : plateformes e-commerce avec visuels haute définition, sites de photos/vidéos, outils SaaS chargés en fonctionnalités. Dans ces cas, mieux vaut investir dans optimisation du rendu critique que tout rogner.

Et puis soyons honnêtes : sur certaines requêtes ultra-spécialisées avec peu de concurrence, un site lent mais exhaustif peut largement dominer. Google ne va pas pénaliser un contenu rare et pertinent juste parce qu'il charge en 4 secondes au lieu de 2.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire le poids de ses pages ?

Commencez par un audit de performance complet : PageSpeed Insights, Lighthouse, WebPageTest. Identifiez les ressources les plus lourdes — images non compressées, scripts JS inutiles, polices web exotiques qui pèsent des centaines de Ko.

Ensuite, passez à l'action : compression d'images (WebP, AVIF), lazy loading pour tout ce qui est below the fold, minification CSS/JS, suppression des plugins WordPress superflus. Chaque Ko compte, surtout sur mobile.

Quelles erreurs éviter dans cette optimisation ?

Ne sacrifiez pas la qualité visuelle au point de rendre le site laid. Une image trop compressée donne une impression de site cheap, et ça tue la conversion autant qu'un chargement lent. Trouvez le juste équilibre.

Autre piège : supprimer du contenu utile pour alléger. Si vos vidéos explicatives ou vos graphiques enrichissent réellement l'expérience, gardez-les — optimisez-les, mais ne les virez pas. Le poids doit servir un objectif, pas être réduit aveuglément.

Comment vérifier que vos optimisations fonctionnent ?

Mesurez avant/après avec des outils fiables : GTmetrix, PageSpeed Insights, Chrome DevTools. Surveillez surtout les Core Web Vitals en situation réelle via Search Console — les tests en labo ne reflètent pas toujours l'expérience terrain.

Analysez aussi les métriques comportementales : taux de rebond, durée moyenne de session, pages vues par visite. Si vos optimisations font grimper ces indicateurs, c'est que ça marche. Sinon, creusez ailleurs.

- Auditer le poids actuel des pages clés (PageSpeed, Lighthouse)

- Compresser images et passer en formats modernes (WebP, AVIF)

- Implémenter le lazy loading sur images et vidéos

- Minifier CSS, JS et supprimer code inutilisé

- Activer compression serveur (Gzip, Brotli)

- Tester rendu sur connexions lentes simulées

- Suivre Core Web Vitals en conditions réelles (Search Console)

- Mesurer impact sur métriques comportementales et conversions

❓ Questions frequentes

Le poids des pages est-il un critère de classement direct chez Google ?

À partir de quel poids une page est-elle considérée comme trop lourde ?

Faut-il sacrifier la qualité visuelle pour réduire le poids ?

Les sites e-commerce avec nombreux visuels sont-ils désavantagés ?

Comment mesurer l'impact réel du poids sur mes conversions ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.