Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

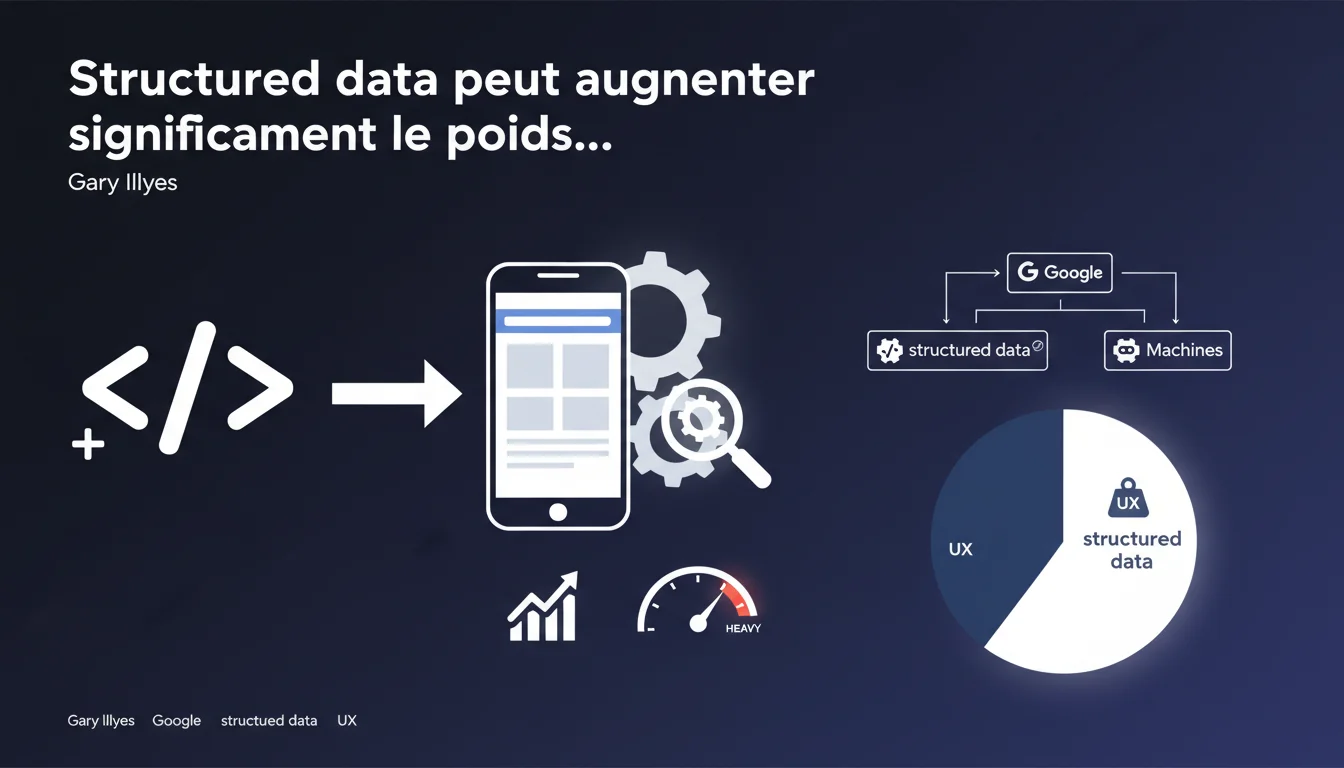

Gary Illyes confirme que l'ajout de structured data augmente significativement le poids HTML des pages, car ces métadonnées sont destinées aux machines et non aux utilisateurs. Cette inflation du code pose la question de l'arbitrage entre visibilité dans les SERP enrichies et performance technique.

Ce qu'il faut comprendre

Pourquoi les données structurées alourdissent-elles autant le code HTML ?

Les données structurées (Schema.org, JSON-LD, microdata) sont des métadonnées explicites ajoutées au code pour que Google et autres moteurs comprennent précisément le contenu. Contrairement au texte visible qui sert à la fois au visiteur et au bot, ces marquages ne bénéficient qu'aux machines.

Un exemple concret : une fiche produit e-commerce avec Schema Product peut facilement ajouter 5 à 15 Ko de JSON-LD — prix, disponibilité, notes, images, variantes. Sur une page initialement légère (30-40 Ko HTML), cela représente une augmentation de 20 à 40 % du poids brut.

Tous les types de structured data ont-ils le même impact sur le poids ?

Non. Un simple Breadcrumb pèse quelques centaines d'octets, tandis qu'un Recipe détaillé avec ingrédients, étapes, nutrition et avis peut dépasser 10 Ko. Les schemas imbriqués (FAQPage avec 15 questions, Event avec offres multiples) explosent rapidement.

Google supporte des dizaines de types — tous documentés dans sa galerie officielle — mais leur complexité varie énormément. Le danger : empiler Product + Review + FAQPage + Breadcrumb + Organization sans mesurer l'impact cumulé.

Cette augmentation de poids affecte-t-elle vraiment les performances ?

Oui, sur deux fronts. D'abord le temps de téléchargement : chaque Ko supplémentaire allonge le TTFB et ralentit l'affichage, surtout en 3G/4G. Ensuite le parsing HTML : le navigateur doit analyser ce code supplémentaire même si l'utilisateur ne le voit jamais.

Pour les Core Web Vitals, l'effet reste indirect mais réel : un HTML gonflé retarde le LCP si les ressources critiques sont bloquées, et peut dégrader le FID si le parsing monopolise le thread principal trop longtemps.

- Les données structurées ajoutent du code invisible destiné uniquement aux moteurs de recherche

- L'impact varie de quelques centaines d'octets (Breadcrumb) à plus de 10 Ko (Recipe, Product complexe)

- Cet alourdissement affecte le temps de téléchargement et le parsing HTML

- Google documente tous les types supportés — mais tous ne se valent pas en termes de poids

- L'empilement de multiples schemas peut créer une inflation significative du code

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. On observe régulièrement des pages dont le HTML dépasse 100 Ko — souvent à cause d'une surcouche de structured data mal calibrée. Le piège classique : implémenter tous les schemas disponibles « au cas où », sans prioriser ceux qui apportent réellement de la valeur business.

La question que Gary Illyes n'aborde pas ici : à partir de quel seuil cette inflation devient-elle problématique ? Google ne donne aucun chiffre. [A verifier] : existe-t-il un point de bascule où l'alourdissement annule les bénéfices des rich snippets ? Les tests A/B montrent que l'impact dépend fortement du profil de connexion des visiteurs.

Faut-il pour autant renoncer aux données structurées ?

Bien sûr que non. Le vrai arbitrage consiste à mesurer le ROI de chaque schema. Un Product avec étoiles et prix dans les SERP booste mécaniquement le CTR — c'est du gain direct. Un FAQPage qui n'apparaît jamais en position zéro mais ajoute 8 Ko ? Questionnable.

Soyons honnêtes : beaucoup de sites implémentent du structured data par mimétisme, sans vérifier si Google l'affiche effectivement. La Search Console offre un rapport « Améliorations » qui montre les types détectés — mais pas leur impact réel sur les impressions enrichies.

Quel est l'impact sur le budget crawl et l'indexation ?

Un HTML plus lourd consomme davantage de ressources serveur et de bande passante Googlebot. Pour un site de 10 000 pages, passer de 40 Ko à 60 Ko moyen représente 200 Mo supplémentaires à crawler — négligeable pour Google, mais ça compte pour votre infra et votre budget crawl si vous êtes sur un serveur mutualisé ou limité.

Par contre, aucune preuve que Google pénalise directement un HTML gonflé pour cause de structured data. Le moteur distingue code visible et métadonnées. Ce qui compte : la cohérence entre le contenu visible et les données structurées. Un décalage (prix affiché ≠ prix dans le schema) peut entraîner un retrait du rich snippet, voire une action manuelle.

Impact pratique et recommandations

Que faut-il faire concrètement pour limiter l'alourdissement ?

Première étape : auditer le structured data existant. Utilisez le validateur Schema.org ou la Search Console pour lister tous les types présents. Ensuite, vérifiez dans la Search Console et dans les SERP réelles quels schemas Google affiche effectivement sous forme de rich snippets.

Supprimez tout ce qui n'apparaît jamais ou qui n'apporte aucune valeur mesurable. Par exemple, un LocalBusiness détaillé sur chaque page d'un site e-commerce national n'a aucun sens — un Organization global en footer suffit.

Quelles erreurs techniques éviter lors de l'implémentation ?

Ne dupliquez jamais le même schema dans plusieurs formats (JSON-LD + microdata). Privilégiez JSON-LD : il est plus facile à maintenir, à déboguer, et peut être chargé de manière asynchrone ou différée si le poids devient critique.

Évitez les imbrications inutiles. Un Recipe n'a pas besoin d'inclure un Organization complet avec logo et sameAs si cette info est déjà dans le footer global. Google consolide les données au niveau du site.

Attention aux plugins qui génèrent du structured data automatiquement : vérifiez qu'ils ne créent pas de doublons ou de schemas obsolètes (Google a déprécié certains types comme Speakable).

Comment mesurer l'impact réel sur les performances ?

Comparez le poids HTML avant/après implémentation avec Chrome DevTools (onglet Network). Si l'augmentation dépasse 15-20 %, testez l'impact sur les Core Web Vitals avec PageSpeed Insights ou WebPageTest.

Pour les sites à fort trafic mobile 3G/4G, chaque Ko compte. Utilisez le mode « Slow 3G » de Chrome DevTools pour simuler une connexion dégradée et observer le ralentissement réel.

- Auditer tous les types de structured data présents sur le site avec la Search Console

- Vérifier dans les SERP réelles quels schemas Google affiche effectivement

- Supprimer les schemas redondants, dupliqués ou jamais exploités par Google

- Privilégier JSON-LD en footer plutôt que microdata inline pour limiter le poids visible

- Éviter les imbrications complexes et les doublons Organization/Person

- Mesurer le poids HTML avant/après avec Chrome DevTools (onglet Network)

- Tester l'impact sur LCP et FID avec PageSpeed Insights en mode mobile

- Désactiver les schemas automatiques inutiles générés par les plugins CMS

❓ Questions frequentes

Les données structurées en JSON-LD pèsent-elles plus lourd que les microformats ?

Google pénalise-t-il un HTML trop lourd à cause des structured data ?

Faut-il compresser ou minifier les données structurées JSON-LD ?

Peut-on charger les structured data de manière asynchrone pour limiter l'impact sur le LCP ?

Combien de Ko de structured data est acceptable sur une page produit e-commerce ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.