Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

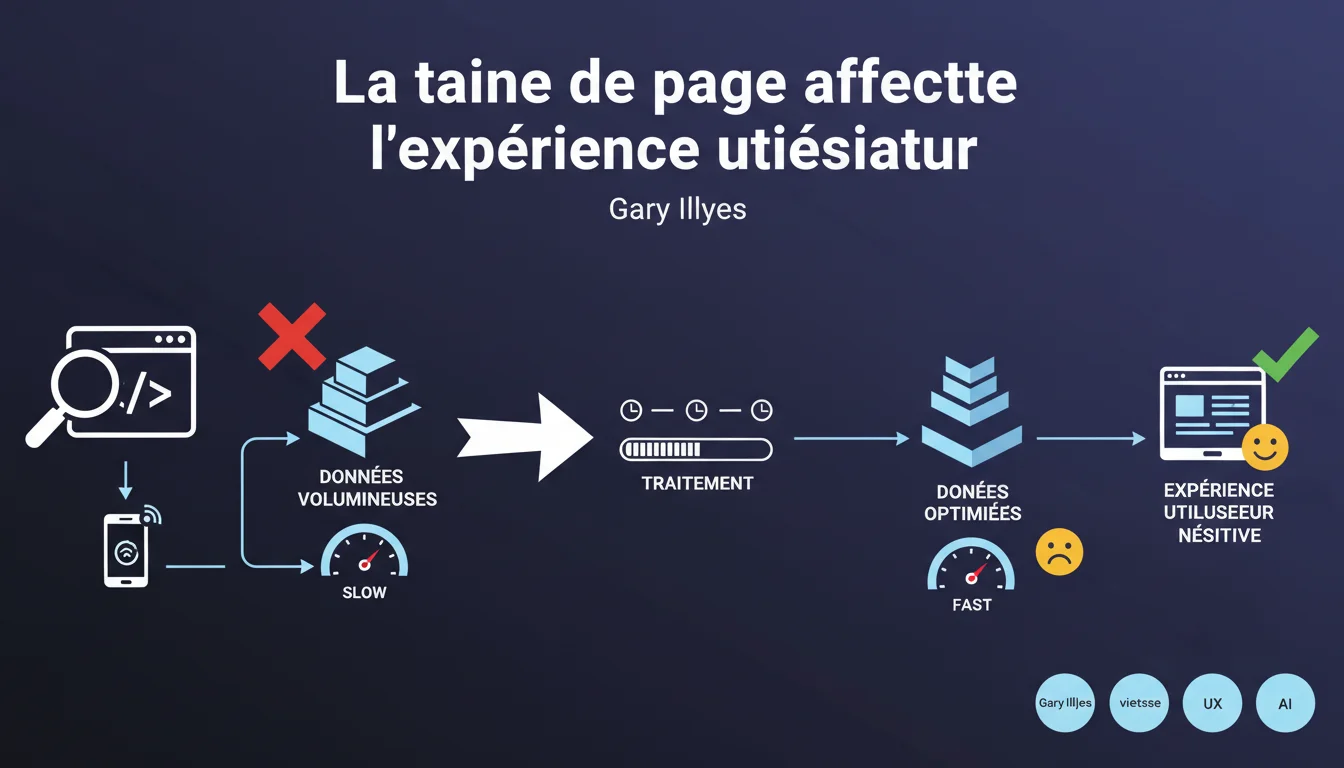

Google confirme que les pages volumineuses restent un handicap pour l'expérience utilisateur, surtout sur connexions lentes ou appareils à stockage limité. La taille impacte directement la vitesse d'affichage : plus de données transférées = traitement plus long. L'optimisation du poids de page demeure un levier concret d'amélioration UX et performance.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il encore sur la taille de page en 2026 ?

La déclaration de Gary Illyes peut surprendre dans un contexte où la 5G se déploie et où les connexions fibre dominent dans de nombreux pays. Pourtant, l'écart entre territoires urbains et ruraux reste massif, et une part significative du trafic mondial provient encore de zones où la 4G plafonne ou où le WiFi domestique peine.

Google rappelle ici une réalité : l'universalité de l'accès au web impose de ne pas concevoir uniquement pour les environnements privilégiés. Les pages lourdes excluent de facto une partie de l'audience — et Google le sait, car il observe les taux de rebond et le comportement utilisateur à grande échelle.

Quelle relation entre taille de page et vitesse d'affichage ?

La formule est simple : plus de kilooctets = plus de temps de téléchargement + plus de ressources CPU/GPU sollicitées pour parser, compiler, rendre. Le poids d'une page ne se limite pas au HTML brut : images, scripts, feuilles de style, polices — tout compte.

Les navigateurs modernes optimisent le rendu progressif et le lazy loading, certes. Mais une page de 5 Mo reste une page de 5 Mo : même avec un excellent réseau, le terminal doit traiter ces données. Sur un appareil d'entrée de gamme avec 2 Go de RAM et un processeur modeste, l'impact est brutal.

Quels utilisateurs sont vraiment concernés aujourd'hui ?

Trois profils clés : les zones rurales/périurbaines avec connexions médiocres, les marchés émergents où les smartphones bas de gamme dominent, et les utilisateurs mobiles en situation de mobilité réelle (train, voiture, zones de couverture instable).

Google ne donne pas de chiffres, mais les études terrain montrent que 30 à 40 % du trafic web mondial provient encore de connexions inférieures à 10 Mbps. Ignorer cette réalité, c'est accepter de perdre une partie de son audience potentielle — et de ses conversions.

- Les pages volumineuses pénalisent toujours une large part du trafic mondial

- La vitesse d'affichage est directement corrélée au volume de données transférées

- L'optimisation du poids reste un levier UX et SEO concret, pas une relique du passé

- Les appareils bas de gamme amplifient l'impact négatif des pages lourdes

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment les observations terrain ?

Oui, sans ambiguïté. Les audits SEO montrent systématiquement une corrélation entre pages lourdes et taux de rebond élevé, surtout sur mobile. Les sites e-commerce avec des fiches produits dépassant 3-4 Mo (images HD non optimisées, carrousels JS mal implémentés) perdent régulièrement 15 à 25 % de conversions sur segments à faible débit.

Ce qui est intéressant, c'est que Google ne parle pas ici de Core Web Vitals ou de métriques techniques. Il cadre le sujet sur l'expérience utilisateur brute — une approche plus universelle et moins sujette aux évolutions de métriques.

Dans quels cas la taille de page devient-elle réellement critique ?

Trois seuils pratiques émergent des observations : au-delà de 2 Mo sur mobile, les décrochages se multiplient. Au-delà de 5 Mo sur desktop, même sur connexions correctes, le temps d'affichage complet dépasse souvent 5 secondes — seuil psychologique où l'utilisateur commence à douter.

Les pages à fort contenu média (portfolios photo, articles enrichis, landing pages vidéo) sont les plus exposées. Mais le problème ne vient pas toujours du contenu visible : les scripts tiers, pixels de tracking, widgets sociaux ajoutent souvent 1 à 2 Mo invisibles. [À vérifier] : Google n'indique pas si la taille qu'il évoque inclut ou exclut les ressources tierces bloquées par les adblockers.

Y a-t-il des exceptions où la taille importe moins ?

Sur des audiences B2B corporate ultra-qualifiées avec connexions professionnelles garanties, l'impact est marginal. Idem pour certains contenus SaaS où l'utilisateur est déjà engagé et prêt à patienter (dashboards complexes, outils métier).

Mais attention : même dans ces cas, la première visite reste critique. Un prospect qui découvre votre outil via une recherche Google ne vous accordera pas la même patience qu'un utilisateur déjà client. L'argument « notre cible a du bon débit » tient rarement à l'épreuve des analytics.

Impact pratique et recommandations

Comment auditer efficacement le poids réel de vos pages ?

Première étape : mesurer en conditions réelles, pas uniquement en local ou via des outils synthétiques. WebPageTest avec profil 3G/4G simulé, Chrome DevTools en throttling, GTmetrix avec localisation distante — multipliez les angles.

Ensuite, décomposez le poids par type de ressource. Identifiez les gros contributeurs : images non optimisées (JPEG au lieu de WebP, absence de responsive images), scripts JS volumineux (bibliothèques complètes chargées pour quelques fonctions), polices custom non subsettées.

Quelles optimisations prioriser pour réduire la taille sans dégrader l'UX ?

L'ordre d'attaque classique : images d'abord (compression, formats modernes, lazy loading), puis JavaScript (tree shaking, code splitting, déférer les scripts non critiques), enfin CSS (purge des règles inutilisées, inline du critical CSS).

Ne négligez pas les ressources tierces : un pixel de tracking mal configuré peut peser 200 Ko et bloquer le rendu. Auditez chaque script externe, challengez sa nécessité, chargez-le de manière asynchrone ou différée.

Quels outils pour automatiser le monitoring du poids de page ?

Lighthouse CI intégré en pipeline, SpeedCurve ou Calibre pour le monitoring continu, PageSpeed Insights via API pour tracker l'évolution. Définissez des budgets de performance : alerte si une page dépasse X Ko, bloqueur si le build ajoute plus de Y Ko sans validation explicite.

Automatiser évite les régressions silencieuses : un développeur ajoute une bibliothèque JS, une image HD glisse dans une PR — sans alerte, le poids grimpe sans qu'on s'en aperçoive.

- Auditer le poids total et par type de ressource sur échantillon représentatif de pages

- Implémenter compression WebP/AVIF + lazy loading sur toutes les images

- Analyser et réduire le poids des bundles JavaScript (code splitting, tree shaking)

- Différer ou supprimer les scripts tiers non essentiels au premier affichage

- Mettre en place un budget de performance automatisé dans le pipeline CI/CD

- Monitorer l'évolution du poids de page en continu avec alertes sur dépassements

❓ Questions frequentes

Quel est le poids de page maximal recommandé par Google ?

Les Core Web Vitals mesurent-ils directement le poids de page ?

Le lazy loading résout-il complètement le problème des pages volumineuses ?

Les CDN et HTTP/3 compensent-ils le surpoids des pages ?

Faut-il privilégier la compression côté serveur ou l'optimisation à la source ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.