Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

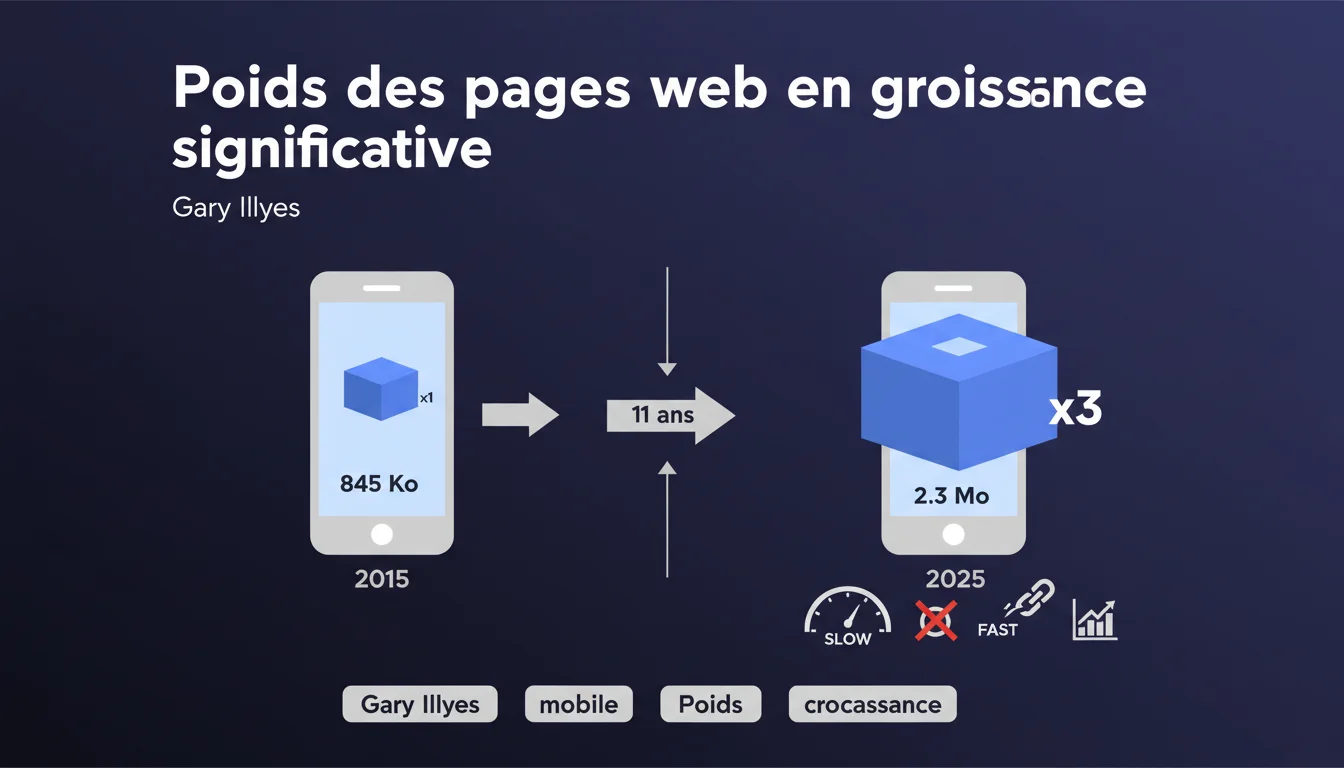

Le poids médian des pages d'accueil mobiles est passé de 845 Ko à 2,3 Mo en 11 ans, soit une multiplication par trois. Cette inflation massive impacte directement la vitesse de chargement et les Core Web Vitals. Pour les praticiens SEO, c'est un signal d'alarme : optimiser le poids des pages n'est plus optionnel, c'est une condition de survie dans les SERP.

Ce qu'il faut comprendre

D'où vient cette explosion du poids des pages ?

Le Web Almanac révèle une tendance lourde : le poids médian des pages mobiles a triplé en 11 ans. Plusieurs facteurs expliquent cette dérive : prolifération des frameworks JavaScript, images haute résolution non optimisées, multiplication des scripts tiers (analytics, publicité, chatbots), et CSS/JS non minifiés.

Cette inflation n'est pas anodine. Elle se traduit par des temps de chargement dégradés, surtout sur réseaux lents (3G, 4G instable). Or, Google a clairement indexé la vitesse comme facteur de classement via les Core Web Vitals depuis mi-2021.

Que signifie concrètement un poids médian de 2,3 Mo ?

Concrètement, 2,3 Mo représentent environ 80 requêtes HTTP en moyenne. Sur une connexion 3G (environ 1,6 Mbps), cela donne un temps de téléchargement théorique de ~11 secondes — sans compter le parsing et le rendu. La médiane masque aussi des situations extrêmes : certains sites dépassent 5-6 Mo.

Pour un praticien SEO, cela pose un problème direct : le LCP (Largest Contentful Paint) explose. Si votre hero image pèse 800 Ko et arrive après 2 Mo de JS, vous êtes hors clous. Le seuil "bon" du LCP est de 2,5 secondes — difficile à tenir avec un tel lest.

Pourquoi cette déclaration de Gary Illyes maintenant ?

Gary Illyes ne sort pas ce chiffre par hasard. Google observe une dégradation généralisée des performances dans son index. En pointant cette inflation, il envoie un message clair : les SEO et développeurs doivent reprendre le contrôle du poids des pages.

Cette déclaration s'inscrit dans la continuité du discours Google sur l'expérience utilisateur. Après avoir introduit les Core Web Vitals, le moteur rappelle que l'optimisation technique reste un prérequis — pas une cerise sur le gâteau.

- Le poids médian a triplé : de 845 Ko à 2,3 Mo en 11 ans

- JavaScript et images sont les principaux responsables de cette inflation

- Impact direct sur les Core Web Vitals, notamment LCP et FID

- Les sites mobiles sont les plus touchés : réseaux lents + poids élevé = catastrophe UX

- Google rappelle que la vitesse reste un critère de classement

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, totalement. Les audits que je mène montrent systématiquement des pages qui dépassent allègrement les 3-4 Mo, surtout sur les sites e-commerce ou médias. Le problème, c'est que beaucoup de clients ne mesurent même pas le poids de leurs pages — ils découvrent le chiffre lors de l'audit initial.

Ce qui me frappe, c'est que cette inflation est souvent invisible côté desktop. Avec des connexions fibre et des machines puissantes, les équipes internes ne ressentent pas la douleur. Mais dès qu'on teste sur un vrai mobile, en 4G bridé, la réalité frappe : 8-10 secondes pour afficher le contenu principal.

Quelles nuances faut-il apporter à ce constat ?

Gary Illyes parle de médiane, pas de moyenne. Cela signifie que 50 % des sites sont au-dessus de 2,3 Mo. Mais attention : certains sites très bien optimisés restent sous 1 Mo, même avec du contenu riche. Le problème n'est donc pas une fatalité technique — c'est une question de discipline et de priorités.

Autre nuance : le poids brut ne dit pas tout. Un site de 2,3 Mo avec du lazy loading intelligent, du code-splitting et du HTTP/2 peut charger plus vite qu'un site de 1,5 Mo mal structuré. Le poids est un indicateur, pas une condamnation automatique. [À vérifier] : Gary Illyes ne précise pas si Google pondère le poids brut ou prend en compte les stratégies de chargement différé dans son évaluation des Core Web Vitals.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Si vous opérez un site en PWA (Progressive Web App) avec un service worker bien configuré, le poids initial importe moins : le cache fait le job pour les visites suivantes. Idem pour les sites à forte audience récurrente (SaaS, outils métier) où l'utilisateur ne voit le poids qu'une fois.

Mais soyons honnêtes : pour un site contenu classique (blog, e-commerce, média), la première visite compte énormément. Google crawle comme un nouvel utilisateur — sans cache. Si votre LCP explose dès le premier chargement, vous perdez en ranking. La règle s'applique donc à 90 % des cas.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire le poids des pages ?

Première priorité : audit technique complet. Utilise WebPageTest, Lighthouse et PageSpeed Insights pour identifier les ressources lourdes. Ensuite, passe au crible images, JavaScript et CSS. Les images représentent souvent 50-70 % du poids — compresse-les systématiquement.

Pour les images, adopte les formats modernes (WebP, AVIF) avec fallback. Mets en place du lazy loading natif (loading="lazy") pour tout ce qui n'est pas above-the-fold. Côté JS/CSS, minifie, compresse (Gzip/Brotli), et coupe tout ce qui n'est pas critique.

Quelles erreurs éviter absolument ?

Ne charge pas 15 scripts tiers sans les auditer. Chaque pixel de tracking, chaque chatbot, chaque widget social ajoute 100-300 Ko. Beaucoup de ces scripts sont inutilisés ou redondants. Fais le tri : garde ce qui sert vraiment, diffère ou supprime le reste.

Autre piège : les polices web non optimisées. Charger 6 variantes d'une Google Font en WOFF2 peut peser 400 Ko. Limite-toi à 2-3 graisses maximum, utilise font-display: swap, et héberge localement si possible.

Comment vérifier que mon site est conforme aux bonnes pratiques ?

Teste ton site sur plusieurs conditions réseau (3G slow, 4G, fibre) via les DevTools Chrome. Le poids total doit idéalement rester sous 1,5 Mo pour le mobile. Si tu dépasses 2 Mo, c'est un signal d'alarme : creuse chaque ressource au-dessus de 100 Ko.

Mets en place un budget de performance dans ton CI/CD. Des outils comme Lighthouse CI ou SpeedCurve peuvent bloquer un déploiement si le poids ou le LCP dégradent. Automatiser la surveillance évite les régressions silencieuses.

- Auditer le poids des pages avec WebPageTest et Lighthouse

- Compresser toutes les images (WebP/AVIF + lazy loading)

- Minifier et compresser JS/CSS (Gzip/Brotli)

- Faire le tri dans les scripts tiers : garder l'essentiel, différer ou supprimer le superflu

- Optimiser les polices web : 2-3 variantes max,

font-display: swap - Tester sur connexions lentes (3G slow) pour détecter les régressions

- Mettre en place un budget de performance automatisé dans le CI/CD

Réduire le poids des pages n'est plus un luxe — c'est une condition sine qua non pour maintenir un bon classement. Les Core Web Vitals pénalisent les sites lourds, surtout sur mobile. Un audit rigoureux suivi d'optimisations ciblées (images, JS, CSS, scripts tiers) permet de repasser sous les 1,5 Mo et de gagner plusieurs secondes sur le LCP.

Ces optimisations demandent une expertise technique pointue et une coordination étroite entre SEO, développeurs et équipes marketing. Si cette complexité vous paraît insurmontable ou si vous manquez de ressources internes, faire appel à une agence SEO spécialisée peut accélérer considérablement le processus et garantir des résultats mesurables sans mobiliser vos équipes pendant des mois.

❓ Questions frequentes

Le poids de la page impacte-t-il directement le classement Google ?

Un site de 2,3 Mo peut-il quand même bien ranker ?

Faut-il privilégier le poids ou la qualité du contenu ?

Les formats d'image modernes (WebP, AVIF) font-ils vraiment la différence ?

Comment convaincre la direction d'investir dans l'optimisation du poids ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.