Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

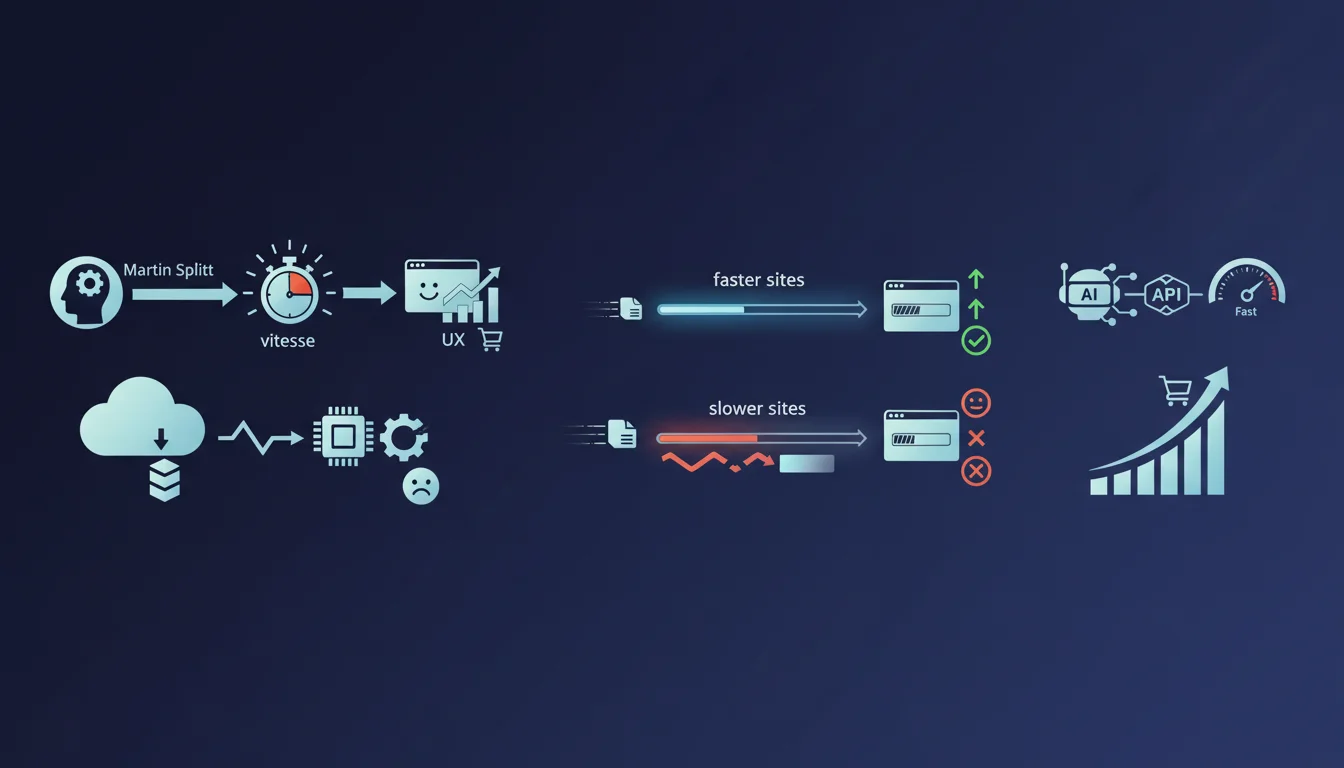

Google confirme ce que beaucoup pressentaient : les sites rapides convertissent mieux et retiennent davantage les visiteurs. La vitesse dépend directement du poids des pages — plus le volume de données à transférer est élevé, plus le délai d'affichage s'allonge. Concrètement, optimiser le poids c'est optimiser la conversion.

Ce qu'il faut comprendre

Pourquoi Google lie-t-il vitesse et conversion ?

La déclaration de Martin Splitt s'appuie sur des études empiriques montrant une corrélation directe entre temps de chargement et comportement utilisateur. Un site lent augmente mécaniquement le taux de rebond et réduit les conversions — c'est une réalité observée sur des millions de sessions.

Google ne se contente pas d'affirmer que la vitesse compte pour le référencement : il pointe explicitement son impact sur les métriques business. Ce glissement de discours est significatif — la performance technique devient un levier de chiffre d'affaires, pas seulement un critère de ranking.

Quel rôle joue le poids de page dans cette équation ?

Le poids de page, c'est la masse de données à télécharger avant affichage : HTML, CSS, JavaScript, images, fonts, vidéos. Plus ce volume est élevé, plus le réseau met de temps à transférer, et plus le processeur peine à parser, exécuter et rendre le contenu.

Splitt rappelle ici un principe élémentaire souvent négligé : chaque kilo-octet compte. Les sites modernes accumulent souvent des centaines de kilos de JS inutiles, des images non optimisées, des fonts exotiques. Résultat : des pages qui dépassent allègrement les 3-4 Mo pour un contenu qui pourrait tenir en 500 Ko.

En quoi cette affirmation diffère-t-elle des discours habituels ?

Google parle généralement de Core Web Vitals en termes abstraits : LCP, FID, CLS. Ici, Splitt prend un angle beaucoup plus direct : vitesse = conversion = argent. C'est un message pragmatique qui court-circuite les débats techniques pour aller droit au point qui intéresse les décideurs.

Il recentre aussi l'attention sur le poids de page plutôt que sur des optimisations serveur ou CDN. C'est une façon subtile de dire que le problème principal vient souvent du front-end — trop de ressources, mal compressées, mal priorisées.

- Vitesse et conversion sont liées par des études multiples, pas par une simple corrélation anecdotique.

- Le poids de page est le levier principal — réduire le volume de données transférées améliore mécaniquement la vitesse.

- Google oriente le discours vers l'impact business pour toucher un public au-delà des techniciens SEO.

- Le message sous-jacent : nettoyez votre front-end avant de chercher des optimisations exotiques.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même l'un des rares points sur lesquels Google et les praticiens SEO sont unanimes. Les tests A/B menés par Amazon, Walmart, Akamai et des dizaines d'autres acteurs montrent qu'une seconde de latence supplémentaire peut coûter plusieurs points de conversion. Les études citées par Splitt ne sont pas des hypothèses — elles sont documentées et répliquées.

Sur le terrain, on voit régulièrement des sites e-commerce perdre 10 à 20 % de leur chiffre d'affaires à cause d'un temps de chargement trop long. Les utilisateurs mobiles sont particulièrement sensibles : au-delà de 3 secondes, une majorité abandonne. Ce n'est pas une question de perception — c'est statistique.

Quelles nuances faut-il apporter à ce discours ?

La déclaration de Splitt pose une relation causale simple : poids élevé = lenteur = moins de conversions. Dans l'absolu, c'est vrai. Mais la réalité est un peu plus complexe.

Premièrement, tous les kilos ne se valent pas. Un script de tracking de 50 Ko bloquant en début de page ralentit bien plus qu'une image de 200 Ko chargée en lazy-load. Le problème n'est pas seulement le poids brut, c'est aussi l'ordre de chargement, le parsing JavaScript, les requêtes bloquantes.

Deuxièmement, la vitesse n'est pas le seul facteur de conversion. Un site rapide mais mal designé, avec un tunnel d'achat confus ou des produits non compétitifs, convertira mal quand même. La vitesse est une condition nécessaire, pas suffisante.

Troisièmement, certains types de sites peuvent se permettre plus de poids — un configurateur 3D interactif, un outil SaaS complexe. L'arbitrage entre richesse fonctionnelle et légèreté dépend du contexte métier. Il ne faut pas tomber dans l'austérité numérique à tout prix.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Sur des sites à très forte notoriété ou en situation de monopole, l'impact de la lenteur est amorti par l'absence d'alternative. Si vous êtes le seul acteur sur un marché de niche, vos utilisateurs attendront. Mais c'est une exception — et même dans ce cas, vous laissez de l'argent sur la table.

Les sites à audience captive — intranets, plateformes B2B avec contrats long terme — peuvent aussi relâcher un peu la pression. L'utilisateur n'a pas le choix, il reviendra. Mais là encore, la frustration s'accumule et finit par peser sur le renouvellement des contrats.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire le poids de page ?

Première étape : mesurer. Utilisez WebPageTest, Lighthouse ou GTmetrix pour identifier les ressources les plus lourdes. Souvent, 80 % du poids vient de 20 % des fichiers — images non optimisées, bibliothèques JS surdimensionnées, fonts inutiles.

Ensuite, compressez les images — passez au WebP ou AVIF, redimensionnez aux dimensions réelles d'affichage. Une image de 2 Mo servant dans un conteneur de 300 px de large, c'est du gaspillage pur. Servez des formats modernes avec un fallback pour les vieux navigateurs.

Côté JavaScript, faites du tree-shaking et du code-splitting. Si vous embarquez une bibliothèque entière pour utiliser une seule fonction, c'est le moment de refactoriser. Différez ou lazy-loadez tout ce qui n'est pas critique au premier affichage.

Quelles erreurs éviter dans cette optimisation ?

Ne sacrifiez pas la qualité visuelle au point de dégrader l'expérience. Une image trop compressée qui pixelise fait fuir autant qu'une page lente. Il faut trouver l'équilibre — compression agressive mais avec préservation de la netteté perçue.

Évitez de multiplier les outils de monitoring et tracking en pensant que ça ne coûte rien. Chaque script tiers ajoute du poids, des requêtes, du parsing. Google Analytics, Hotjar, Facebook Pixel, Drift, Intercom — au bout d'un moment, vous traînez 500 Ko de trackers pour un article de blog de 10 Ko. Priorisez.

Ne comptez pas uniquement sur un CDN pour masquer le problème. Un CDN accélère la distribution, mais ne réduit pas le poids intrinsèque. Si votre page pèse 5 Mo, elle pèsera 5 Mo partout dans le monde — juste un peu plus vite. Le CDN est un amplificateur, pas une solution de fond.

Comment vérifier que votre site est conforme aux attentes de Google ?

Utilisez PageSpeed Insights et Search Console pour suivre vos Core Web Vitals. Google vous donne les seuils : LCP sous 2,5 s, FID sous 100 ms, CLS sous 0,1. Ces métriques sont des proxies de la vitesse perçue et de la stabilité visuelle.

Mais ne vous arrêtez pas aux scores — testez en conditions réelles. Simulez une connexion 3G lente, utilisez un appareil Android milieu de gamme, naviguez comme un utilisateur lambda. Les outils donnent des indications, le terrain donne la vérité.

- Auditez votre poids de page actuel et identifiez les 5 ressources les plus lourdes.

- Compressez toutes les images au format WebP ou AVIF avec un taux de qualité entre 75 et 85.

- Supprimez ou différez les scripts JavaScript non critiques au premier affichage.

- Nettoyez les fonts inutilisées et limitez-vous à 2 ou 3 graisses maximum.

- Réduisez le nombre de scripts tiers et consolidez les outils de tracking.

- Activez la compression Gzip ou Brotli côté serveur pour tous les assets texte.

- Testez votre site en conditions 3G lente sur mobile depuis un appareil Android milieu de gamme.

- Suivez vos Core Web Vitals dans Search Console et corrigez les pages en rouge.

❓ Questions frequentes

À partir de quel poids de page la vitesse devient-elle un vrai problème ?

Les Core Web Vitals suffisent-ils à mesurer la vitesse de mon site ?

Est-ce que compresser les images dégrade vraiment la qualité visuelle ?

Un CDN peut-il compenser un site trop lourd ?

Comment convaincre un client que la vitesse impacte ses revenus ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.