Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

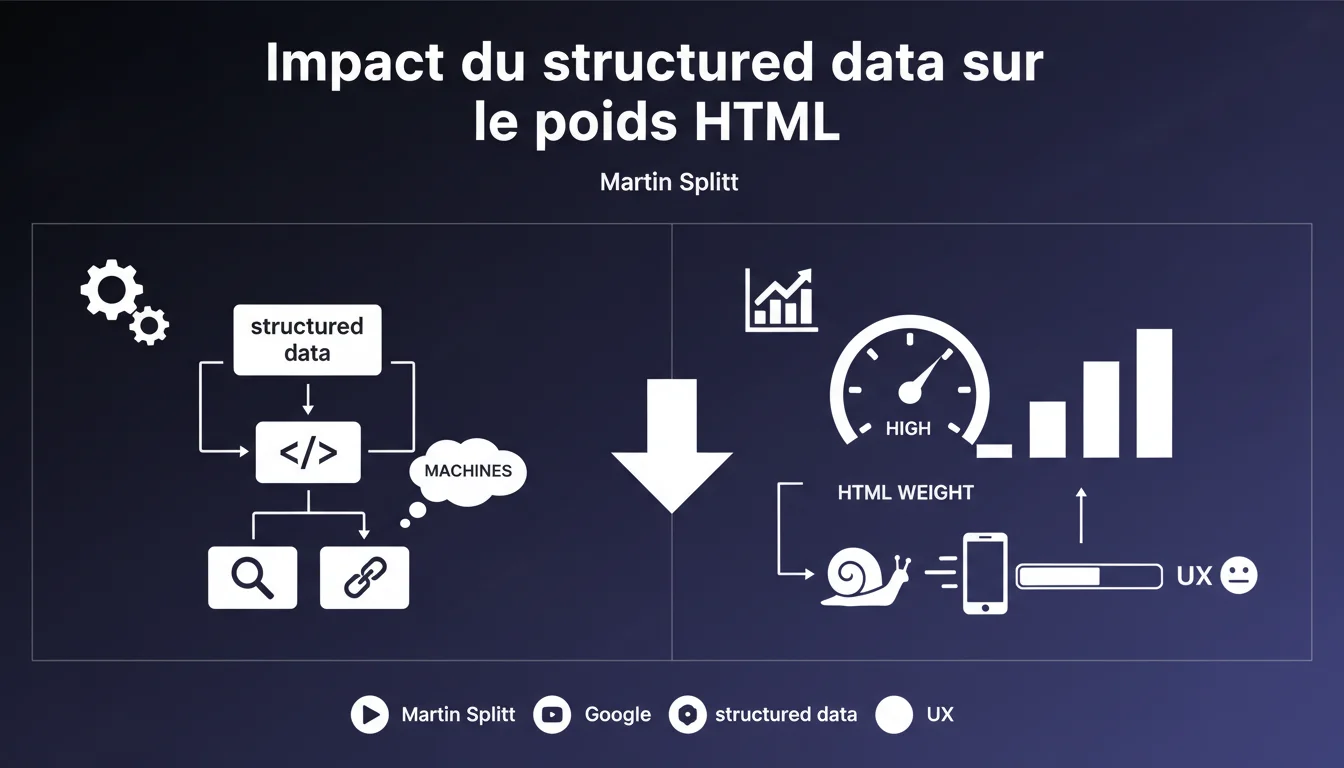

Google reconnaît que le structured data peut considérablement augmenter le poids HTML d'une page, car ces données sont destinées aux machines et non aux utilisateurs. Avec la multiplication des types de balisage supportés, l'inflation du code devient un problème réel qui peut impacter les performances si on n'y prend pas garde.

Ce qu'il faut comprendre

Pourquoi Google soulève-t-il cette question du poids HTML maintenant ?

Martin Splitt pointe un paradoxe technique : plus Google encourage l'adoption du structured data (et il le fait massivement), plus le volume de code non visible par l'utilisateur explose. Les professionnels SEO empilent les schémas — Product, FAQ, Review, Breadcrumb, Organization, LocalBusiness, VideoObject, etc. — dans une course à la visibilité dans les SERP enrichies.

Le problème ? Ce code JSON-LD ou microdata peut facilement représenter 30 à 50% du poids total d'une page. Sur des sites e-commerce avec des fiches produits complexes, on observe régulièrement des pages où le structured data dépasse le contenu visible. Et ça, ça commence à poser question côté performance.

Qu'entend-on exactement par « destinées aux machines » ?

Les données structurées sont du code invisible pour l'utilisateur final. Elles ne s'affichent pas à l'écran, ne contribuent pas à l'expérience de lecture, et n'ont d'intérêt que pour les robots qui parsent le HTML. C'est du markup pur et dur, redondant avec le contenu visible.

Cette redondance est justement ce qui alourdit : vous décrivez votre produit en HTML classique pour vos visiteurs, puis vous le re-décrivez entièrement en JSON-LD pour Google. Même info, deux fois. Le ratio signal/bruit du code HTML se dégrade mécaniquement.

Dans quelle mesure ce poids supplémentaire devient-il problématique ?

Concrètement, ça dépend de votre budget de poids et de vos Core Web Vitals. Si votre page pèse déjà 1,5 Mo avec images optimisées, JS minifié et CSS critique, ajouter 50 Ko de JSON-LD n'est pas neutre. Surtout sur mobile avec des connexions dégradées.

Le TTFB et le LCP peuvent être impactés si le serveur doit générer et transmettre plus de code. Le navigateur doit parser plus de HTML avant d'afficher quoi que ce soit. C'est marginal sur des pages légères, ça devient mesurable sur des pages déjà lourdes.

- Le structured data est du code invisible pour les utilisateurs, mais lourd pour les machines

- La multiplication des schémas supportés encourage l'empilement sans limite claire

- L'impact performance dépend du poids total de la page et de la qualité de connexion

- Le ratio code utile/code machine se dégrade avec l'inflation du balisage sémantique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, totalement. On constate régulièrement que les sites qui implémentent tous les schémas possibles finissent avec des pages qui font 200-300 Ko de HTML pur, dont la moitié est du JSON-LD. C'est particulièrement visible sur les sites e-commerce qui empilent Product + AggregateRating + Offer + FAQPage + Breadcrumb + Organization.

Mais — et c'est là que ça coince — Google ne donne aucune indication de seuil. À partir de combien de Ko le jeu n'en vaut plus la chandelle ? Aucune idée. Splitt constate le problème sans proposer de garde-fou, ce qui laisse les SEO dans le flou. [A vérifier] si Google pénalise activement les pages trop lourdes en structured data, ou s'il s'agit juste d'un effet indirect via les Core Web Vitals.

Faut-il réduire son usage du structured data pour autant ?

Non, et c'est justement le piège de cette déclaration. Google dit « attention au poids », mais en parallèle il continue de privilégier les résultats enrichis dans les SERP. Si vous retirez votre balisage FAQ pour alléger la page, vous perdez votre rich snippet et votre CTR s'effondre.

Le vrai message à retenir : soyez sélectifs et pragmatiques. Implémentez les schémas qui ont un ROI mesurable (ceux qui déclenchent des rich snippets visibles), pas tous ceux que Google « supporte ». Personne ne vous demande de baliser chaque détail de votre contenu si ça n'apporte rien en visibilité.

Quelles données structurées sont vraiment prioritaires ?

Concentrez-vous sur les schémas à fort impact SERP : Product/Offer pour l'e-commerce, Recipe pour la food, VideoObject pour les contenus vidéo, FAQ/HowTo pour capturer de l'espace dans les résultats. Le reste — Organization, BreadcrumbList, WebSite — c'est utile mais secondaire.

Si votre page dépasse déjà les 150 Ko de HTML et que vos Core Web Vitals sont limites, supprimez les schémas qui ne déclenchent aucun affichage différencié dans Google. C'est du poids mort. Testez avec la Search Console et la Rich Results Test : si le schéma n'apparaît nulle part, virez-le.

Impact pratique et recommandations

Comment identifier si vos données structurées pèsent trop lourd ?

Premier réflexe : mesurez le poids de votre HTML brut. Ouvrez l'inspecteur, affichez le code source complet, et comparez la taille du JSON-LD par rapport au reste du document. Si votre structured data représente plus de 30% du poids HTML, c'est un signal d'alerte.

Ensuite, testez l'impact performance. Supprimez temporairement tout le JSON-LD et mesurez vos Core Web Vitals avant/après avec PageSpeed Insights ou WebPageTest. Si le LCP gagne 200-300 ms, vous avez un problème.

Quelles actions concrètes mettre en place pour optimiser ?

Priorisez les schémas à ROI. Gardez uniquement ceux qui déclenchent des rich snippets ou des features visibles dans les SERP. Testez chaque schéma avec la Rich Results Test et vérifiez dans la Search Console qu'il génère effectivement des enrichissements.

Minifiez votre JSON-LD. Retirez les espaces inutiles, les sauts de ligne, les propriétés optionnelles sans valeur ajoutée. Un JSON-LD bien nettoyé peut perdre 20-30% de poids sans rien changer fonctionnellement.

Évitez la duplication entre schémas. Si vous balisez un produit avec Product + Offer + AggregateRating, vérifiez que vous ne répétez pas les mêmes infos (nom, description, image) dans chaque objet. Factorisez au maximum.

- Mesurer le poids HTML total et isoler la part du structured data

- Comparer les Core Web Vitals avec et sans JSON-LD pour quantifier l'impact

- Garder uniquement les schémas qui déclenchent des rich snippets visibles

- Minifier le JSON-LD : supprimer espaces, sauts de ligne, propriétés vides

- Factoriser les données communes entre schémas pour éviter la redondance

- Tester régulièrement avec Rich Results Test et Search Console

- Surveiller l'évolution du poids HTML au fil des déploiements

❓ Questions frequentes

Le structured data peut-il réellement pénaliser mes Core Web Vitals ?

Faut-il supprimer certains schémas pour alléger mes pages ?

Quelle est la limite de poids acceptable pour le structured data ?

Le JSON-LD est-il plus lourd que les microdonnées ou RDFa ?

Peut-on compresser le structured data côté serveur ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.