Declaration officielle

Autres déclarations de cette vidéo 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

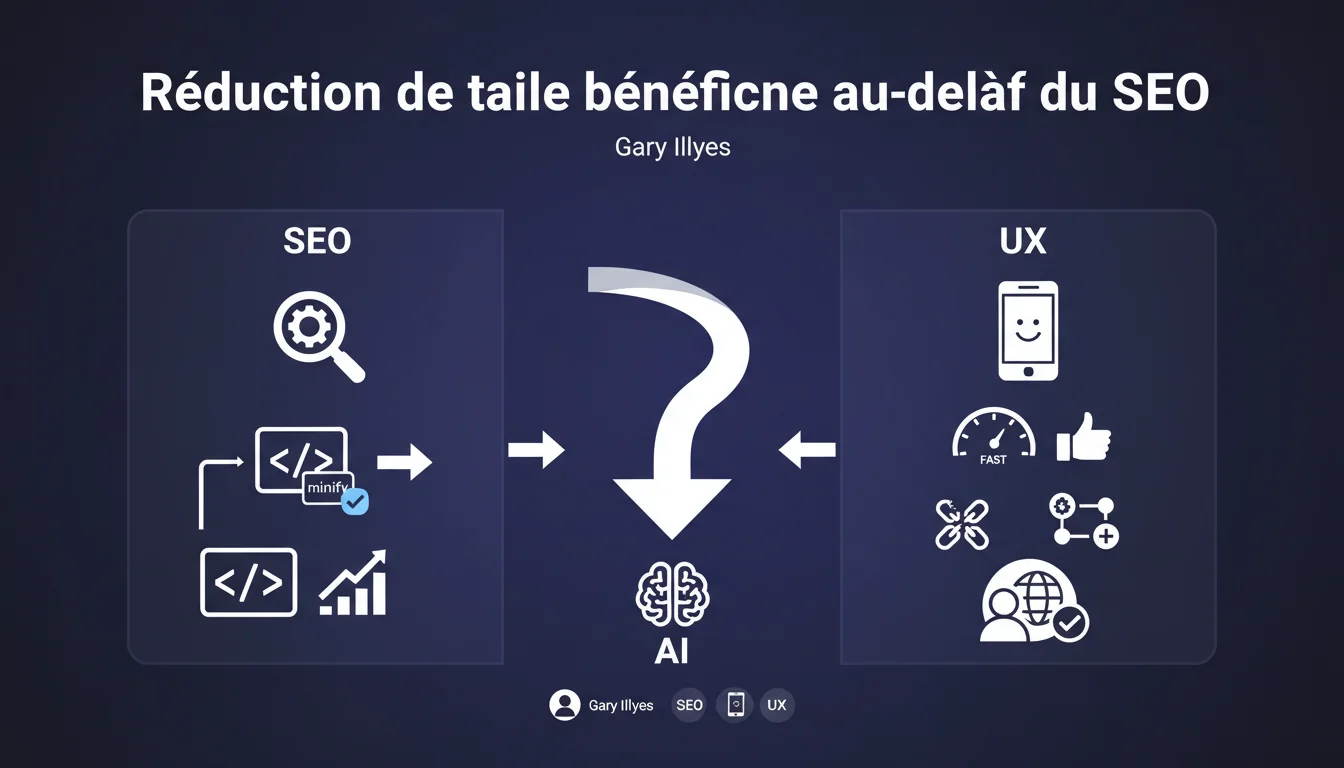

Google affirme que réduire la taille des pages bénéficie d'abord à l'expérience utilisateur, et seulement ensuite au référencement. La réactivité du site est le vrai enjeu — les pages lourdes frustrent les visiteurs et dégradent les performances. L'optimisation technique n'est pas qu'une question de positionnement, c'est une question d'usage.

Ce qu'il faut comprendre

Que cherche vraiment à dire Google avec cette déclaration ?

Gary Illyes recentre le débat : l'optimisation de la taille des pages n'est pas un levier SEO isolé, c'est avant tout un facteur d'expérience utilisateur. Le message sous-jacent est clair — si vous réduisez vos assets uniquement pour plaire à Googlebot, vous passez à côté de l'essentiel.

Les utilisateurs abandonnent les sites lents. Le temps de chargement influe directement sur le taux de rebond, la conversion, et donc indirectement sur les signaux comportementaux que Google observe. En d'autres termes : un site rapide garde ses visiteurs, et un site qui garde ses visiteurs envoie des signaux positifs.

Pourquoi Google insiste-t-il sur la réactivité plutôt que sur le ranking ?

Parce que la performance perçue conditionne l'engagement. Une page de 5 Mo peut techniquement se charger, mais si elle met 8 secondes sur mobile, l'utilisateur est déjà parti. Google a intérêt à ce que les sites qu'il envoie en première page soient consultables — sinon, les utilisateurs perdent confiance dans les résultats.

Cette déclaration s'inscrit dans la continuité des Core Web Vitals, mais sans les nommer explicitement. L'idée reste la même : optimiser pour l'humain, pas pour l'algorithme. Le ranking suit, mais ce n'est pas le point de départ.

Quels types d'optimisations sont visés ici ?

Tout ce qui alourdit inutilement une page : images non compressées, JavaScript redondant, CSS non critiques chargés en priorité, polices web excessives, trackers tiers en cascade. Ces éléments s'accumulent vite — un site WordPress standard avec quelques plugins peut facilement dépasser 3-4 Mo.

- Compression des images (WebP, AVIF) et lazy loading

- Minification et bundling des CSS/JS

- Suppression des scripts tiers non essentiels

- Utilisation d'un CDN pour réduire la latence

- Optimisation des polices (subset, preload, font-display)

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Oui, mais avec une nuance importante. Sur le terrain, on constate que la vitesse de chargement a un impact mesurable sur le SEO — notamment via les Core Web Vitals. Mais cet impact est souvent indirect : un site rapide génère un meilleur engagement, ce qui améliore les métriques comportementales, ce qui in fine influence le positionnement.

Le problème, c'est que Google ne quantifie jamais précisément ce poids. Dire que l'optimisation « aide » avec les moteurs de recherche reste vague. [À vérifier] dans quelle mesure une réduction de 50 % du poids d'une page impacte directement le crawl budget ou l'indexation — les données publiques manquent.

Quels cas échappent à cette logique ?

Les sites à forte autorité éditoriale ou institutionnelle s'en sortent souvent malgré des performances médiocres. Un média de référence peut charger 6 Mo de scripts publicitaires et rester en première page — parce que la pertinence thématique et les backlinks compensent. Soyons honnêtes : la vitesse compte, mais elle ne fait pas tout.

Autre cas : les applications web complexes (SaaS, dashboards) où la lourdeur initiale est compensée par une navigation fluide ensuite. Google n'est pas naïf — il sait différencier un site éditorial d'un outil métier. Le contexte d'usage change l'équation.

Faut-il toujours privilégier la légèreté à tout prix ?

Non. Sacrifier des fonctionnalités essentielles pour grappiller 200 Ko n'a pas de sens si cela dégrade l'expérience. L'optimisation doit rester pragmatique : éliminer le superflu, compresser l'utile, différer le secondaire.

Impact pratique et recommandations

Que faut-il faire concrètement pour réduire la taille des pages ?

Commence par un audit de performance : PageSpeed Insights, Lighthouse, WebPageTest. Identifie les ressources qui pèsent le plus — souvent, 80 % du poids vient de 20 % des assets.

Ensuite, priorise les actions à fort impact : compression des images (passage en WebP ou AVIF), suppression des plugins WordPress inutilisés, nettoyage des CSS/JS non critiques. Teste chaque modification sur un environnement de staging avant de déployer en production.

- Compresser toutes les images (WebP/AVIF) et activer le lazy loading

- Minifier et combiner les fichiers CSS/JS

- Désactiver ou limiter les scripts tiers (analytics, pub, chat)

- Utiliser un CDN pour servir les assets statiques

- Configurer la mise en cache navigateur (Cache-Control, Expires)

- Optimiser les polices web (subset, preload, font-display:swap)

- Surveiller régulièrement les Core Web Vitals via Search Console

Quelles erreurs éviter lors de l'optimisation ?

Ne casse pas le rendu visuel en différant trop de CSS critique — le Cumulative Layout Shift (CLS) explose si les éléments se déplacent au chargement. Ne lazy-load pas le contenu above-the-fold, Google peut le manquer.

Évite aussi les plugins d'optimisation « tout-en-un » mal configurés : certains cassent le JavaScript, d'autres génèrent du cache obsolète. Teste toujours manuellement après activation.

Comment vérifier que les optimisations portent leurs fruits ?

Surveille trois métriques clés : temps de chargement (LCP), interactivité (FID ou INP), et stabilité visuelle (CLS). Compare avant/après avec des outils comme Chrome DevTools, Lighthouse, ou GTmetrix.

Côté SEO, observe l'évolution du taux de rebond, du temps passé et des pages vues par session dans Analytics. Si ces métriques s'améliorent, c'est que l'optimisation fonctionne — et Google le capte indirectement.

❓ Questions frequentes

La réduction de la taille des pages améliore-t-elle directement le ranking Google ?

Quel est le poids idéal pour une page web en 2025 ?

Le lazy loading des images nuit-il au SEO ?

Les Core Web Vitals et la taille des pages sont-ils liés ?

Faut-il optimiser toutes les pages ou seulement celles à fort trafic ?

🎥 De la même vidéo 43

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.