Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

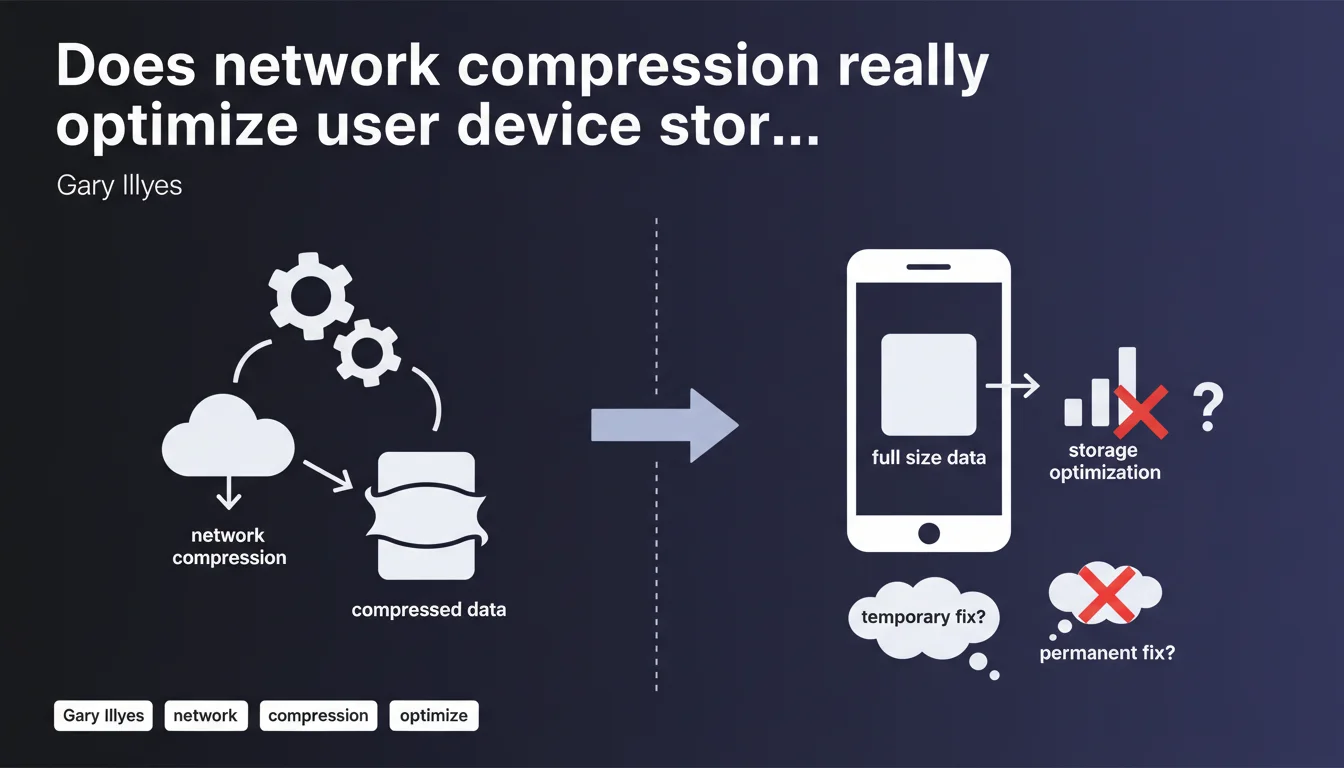

Network compression accelerates data transfer but does not reduce the space occupied on the user's device once files are decompressed. This distinction is crucial to understanding the real impact of your resources on user experience, especially on mobile where storage is limited.

What you need to understand

Why does this distinction between network compression and local storage matter so much?

Network compression (gzip, Brotli) compresses files as they transit between server and browser. It reduces bandwidth consumption and speeds up initial loading.

But once the browser receives these files — JavaScript, CSS, images — it decompresses them in memory to use them. On local disk (browser cache, PWAs, app data), they occupy their actual, uncompressed size.

How does this affect SEO?

Core Web Vitals measure perceived performance in part. If your resources are heavy once decompressed, they saturate RAM and local cache, especially on mobile.

Concretely: a 500 KB compressed JavaScript file can expand to 2 MB when decompressed. The browser must manage these 2 MB in memory. If the device lacks resources, the site slows down, even if network transfer was fast.

What's the difference with image compression?

Modern image formats (WebP, AVIF) compress the source file permanently. A 50 KB WebP image stays 50 KB on disk and in memory.

Network compression only reduces weight during transfer. It's a temporary gain, not a structural one.

- Network compression (gzip, Brotli) only applies during HTTP transfer

- Files occupy their full size in local cache and memory

- On mobile, limited storage can force the browser to clear cache more often, degrading UX

- Images should be optimized at source (WebP, AVIF), not just compressed at network level

- Core Web Vitals can suffer if decompressed resources saturate device memory

SEO Expert opinion

Does this statement challenge current best practices?

No. It clarifies a common misconception: enabling gzip or Brotli does not eliminate the need to optimize the actual weight of your source files. Many believe that once compression is activated, the performance problem is solved. That's wrong.

Tools like Lighthouse or PageSpeed Insights measure actual performance, including memory used and JavaScript parsing. A compressed but poorly written or originally bloated JS file will remain a drag, even with Brotli enabled.

Where does this rule apply most concretely?

On Progressive Web Apps and sites storing resources in local cache via Service Workers. If you cache 10 MB of compressed JS/CSS, it will occupy its decompressed size on the device — potentially 30-40 MB.

On a mid-range Android smartphone with 32 GB of saturated storage, the browser will clear this cache quickly. The user will have to re-download resources on each visit, canceling any caching benefit.

Are there cases where this distinction is negligible?

On desktop with abundant storage and comfortable RAM, yes. But mobile-first indexing from Google requires reasoning first for constrained devices. [To verify]: Google has never clarified whether Googlebot simulates these local storage constraints during mobile crawling, but UX signals (bounce rate, engagement) suffer from it, and Google measures that.

Practical impact and recommendations

What exactly needs to be optimized beyond network compression?

First, reduce the source weight of your JavaScript and CSS files. Tree-shaking, code splitting, removal of unnecessary dependencies. A lighter source file stays light everywhere — in transit, in cache, in memory.

Next, adopt modern image formats (WebP, AVIF) that integrate permanent compression into the file itself. A 200 KB JPEG image can drop to 50 KB in WebP with no visible loss, and this reduction persists everywhere.

How do you verify the real impact on storage and memory?

Use Chrome DevTools: the Performance tab records memory consumed during loading. The Application > Cache Storage tab shows the actual weight of locally cached files.

Test on a low-end Android device with saturated storage. If cache is regularly cleared, your resources are too heavy.

What common mistakes should you avoid?

Don't confuse network compression (gzip/Brotli) and source optimization. Enabling Brotli does not exempt you from minifying, optimizing images at source, or reducing JS bundles.

Don't ignore mobile constraints: a site fast on desktop with fiber optic can be catastrophic on 4G with a 150-dollar smartphone. Google indexes mobile first.

- Enable gzip or Brotli on all text files (HTML, CSS, JS, JSON, XML)

- Minify and tree-shake JavaScript at source to reduce decompressed weight

- Convert images to WebP or AVIF for permanent compression

- Audit the weight of locally cached files via DevTools > Application

- Test performance on a low-end Android device with saturated storage

- Monitor memory consumed via DevTools > Performance

- Limit the total weight of resources cached by Service Workers (max 10-15 MB decompressed)

- Regularly re-evaluate npm dependencies: many libraries are heavy once decompressed

❓ Frequently Asked Questions

La compression Brotli est-elle meilleure que gzip pour réduire le stockage local ?

Les images WebP sont-elles compressées uniquement au niveau réseau ?

Les Service Workers cachent-ils les fichiers compressés ou décompressés ?

Google pénalise-t-il les sites dont les ressources occupent trop d'espace en cache ?

Faut-il désactiver la compression réseau si on optimise déjà les fichiers sources ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.