Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

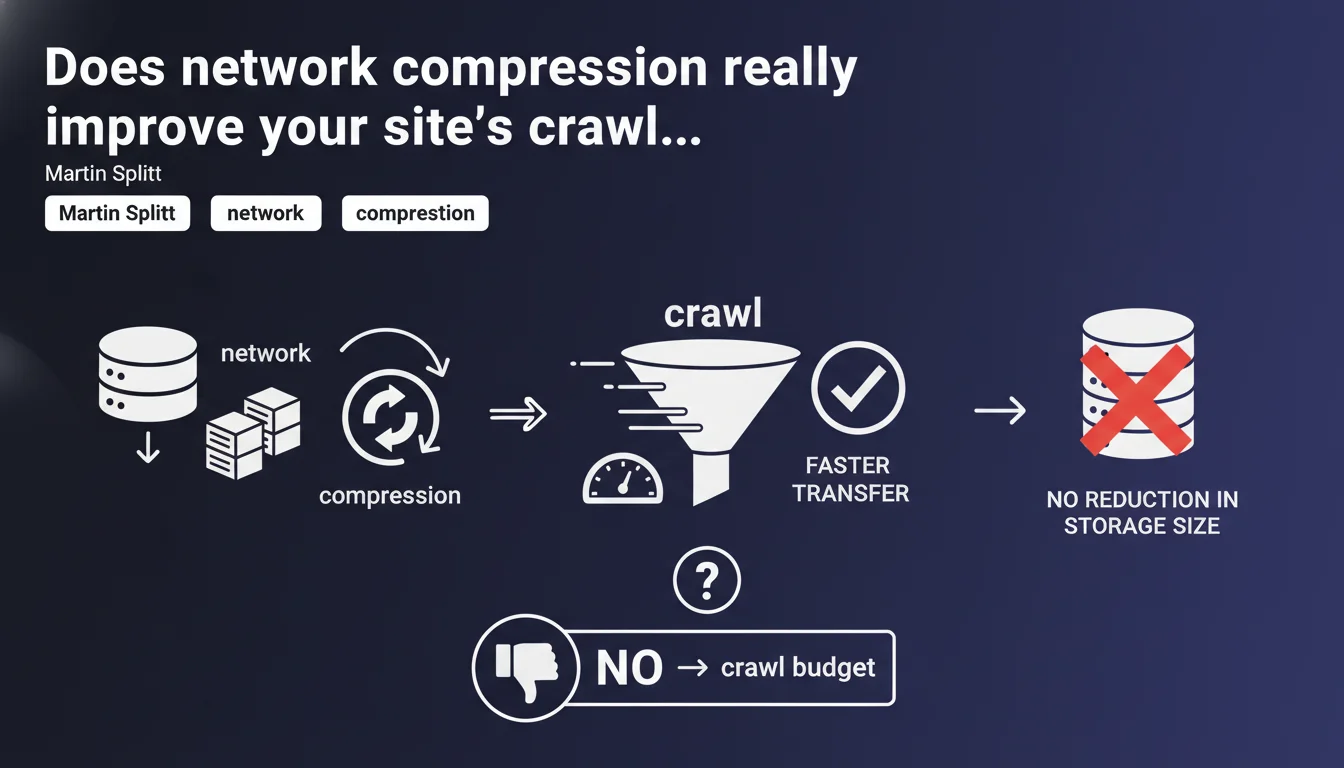

Network compression (gzip, Brotli) accelerates data transfer between server and crawler, but doesn't reduce the storage space required on Google's side. Its impact on crawl is limited to download speed, not the volume processed.

What you need to understand

Martin Splitt reminds us of a technical distinction that's often misunderstood: network compression and storage space are two different things.

Compression (gzip, Brotli) compresses data during HTTP transfer. Once received, it's decompressed for analysis and storage.

Why is this distinction crucial for SEO?

Many SEO professionals think that enabling network compression allows Google to crawl more pages with the same budget. This is partially true, but not for the reasons they believe.

Compression accelerates the download of resources. An HTML file of 200 KB compressed to 40 KB downloads 5 times faster. Googlebot saves time per request, so it can crawl more pages within a given time window.

What's the real impact on Google's infrastructure?

On the storage side, Google must keep the decompressed version for indexing. A 200 KB HTML file will remain 200 KB on Google's servers, even if the transfer only weighed 40 KB.

The bandwidth savings mainly benefit your origin server (your hosting) and crawl speed. Not Google's storage footprint.

- Network compression reduces transfer time, not the final volume processed

- Googlebot downloads faster, but still must analyze and store the same data

- The main impact: crawl time optimization, not theoretical crawlable volume

- Decompressed files on the crawler's side retain their original size

SEO Expert opinion

Does this statement change how you should optimize your crawl budget?

No, not fundamentally. Enabling compression remains a best practice — it would be absurd not to use it.

But you need to stop believing it solves structural crawl budget problems. If Google only crawls 10% of your site, compression won't magically increase that to 50%. It will just speed up the crawl of those 10%.

What are the real variables that impact crawl budget?

The crawl time saved by compression can indirectly increase the number of pages visited — if your server responds quickly and your architecture is clean.

But the real levers are elsewhere: crawl depth, page quality, server response time, volume of duplicate content. Compression is an efficiency multiplier, not a structural lever.

Is Google transparent about the exact mechanisms of crawl budget?

As often, this statement remains generic. Martin Splitt doesn't provide numbers: how much time do you actually save? What's the threshold where compression significantly impacts crawling?

[To verify] The real impact of compression on the number of pages crawled depends on too many undocumented variables (average page size, network latency, site reputation). It's difficult to quantify precisely without field testing.

Practical impact and recommendations

What should you do concretely on your site?

Enable Brotli compression (better than gzip) on your server or via CDN. This is a basic technical prerequisite, not an advanced SEO optimization.

Verify that your HTTP headers include Content-Encoding: br or gzip. Test with Chrome DevTools (Network tab) or tools like GTmetrix.

What mistakes should you avoid when interpreting this statement?

Don't overestimate compression's impact on crawl budget. If Google is crawling your site poorly, look first for real problems: poorly managed pagination, infinite facets, catastrophic server response times, misconfigured robots.txt.

Compression is a convenience optimization, not a miracle cure. It improves crawl speed, not its depth or base frequency.

How do you verify your configuration is optimal?

- Enable Brotli (level 4-6) or gzip (level 6) on HTML, CSS, JS, JSON, XML

- Verify via

curl -I -H "Accept-Encoding: br,gzip" https://yoursite.com - Monitor download time in crawl reports (Search Console, server logs)

- Compare bandwidth volume before/after activation

- Don't compress already-compressed images (JPG, PNG, WebP) — it's wasteful and CPU-intensive

Network compression is essential for technical efficiency, but it won't compensate for a flawed SEO architecture.

Focus on content quality, site structure, and relevance signals. Compression will optimize these foundations, not replace them.

These technical optimizations are part of a global strategy that's often complex to manage alone — particularly on large sites or those with advanced indexing issues. Support from a specialized SEO agency can accelerate compliance and ensure every lever is pulled in the right order, with measurable impact on your performance.

❓ Frequently Asked Questions

La compression réseau augmente-t-elle directement le nombre de pages crawlées ?

Faut-il privilégier Brotli ou gzip pour le SEO ?

La compression a-t-elle un impact sur le classement dans les résultats de recherche ?

Dois-je compresser toutes les ressources de mon site ?

Comment vérifier que Google crawle mon site avec la compression activée ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.