Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

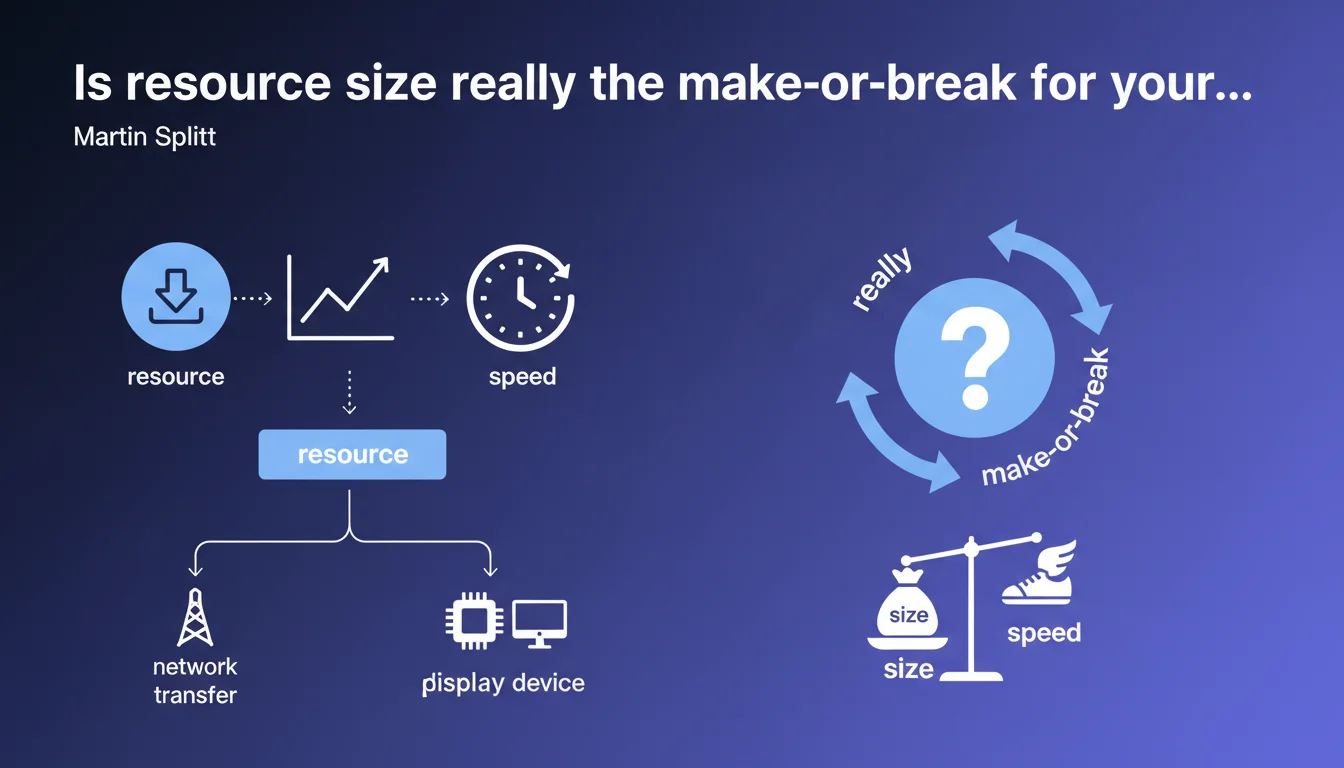

Martin Splitt confirms that a site's speed depends directly on the volume of data being transferred: the heavier the resources, the slower the network transfer and device processor handling. It's not groundbreaking news, but a timely reminder that optimizing resource weight remains a fundamental lever for improving performance.

What you need to understand

What's the logic behind this claim?

Google establishes a straightforward cause-and-effect relationship: data volume = transfer time + processing time. The more bytes you send to the browser, the harder the network works to deliver them and the more the device's CPU (especially on mobile) struggles to digest everything.

This statement targets two distinct bottlenecks. On one hand, network bandwidth: a 2 MB file mechanically takes longer to download than a 200 KB file, especially on unstable 3G or 4G. On the other hand, the processing capacity of the device: decompressing, parsing, and displaying heavy JavaScript or unoptimized images puts strain on the processor, delaying final display.

Why does Google keep hammering home this obvious point?

Because websites keep ballooning without restraint. WordPress themes bloated with scripts, uncompressed HD images, JavaScript libraries imported entirely when you only use 10% of their functions — it all accumulates and tanks your Core Web Vitals.

Google wants to drive home that resource size isn't a cosmetic detail, but a parameter that directly impacts LCP (Largest Contentful Paint) and FID (First Input Delay). If your hero image weighs 5 MB, your LCP will be catastrophic, no matter how good your hosting is.

What does this mean concretely for SEO?

The Core Web Vitals have been a ranking signal since June 2021. A bloated site = degraded metrics = a handicap in the SERPs, especially against competitors who've optimized their resources.

But there's another stake: crawl budget. A site serving 10 MB pages consumes more bandwidth on the Googlebot side. On large sites (e-commerce, catalogs), this can limit the number of pages crawled daily.

- Resource size directly influences the speed perceived by users and measured by Google.

- Network transfer and CPU processing are the two bottlenecks identified by Splitt.

- Optimizing resource weight improves Core Web Vitals (LCP, FID) and potentially crawl budget.

- This claim primarily targets sites accumulating scripts and media without discernment.

SEO Expert opinion

Does this statement bring anything new to the table?

Let's be honest: no. This is a restatement of well-known principles from years past. Any professional who's optimized a site knows that compressing images, minifying CSS/JS, and limiting HTTP requests speeds up rendering.

What's interesting is that Splitt chooses to reinforce this publicly. It signals that Google still sees too many sites neglecting these basics — and that the Chrome/Search team views this as a persistent problem.

What nuances should we add to this claim?

The statement deliberately remains generic and vague. It doesn't specify at what threshold size becomes problematic, or which type of resource weighs heaviest in the balance (images? scripts? fonts?).

In practice, not all bytes are created equal. A large JavaScript file blocking rendering is far more penalizing than an image lazy-loaded at the bottom of the page. The timing and criticality of each resource matter just as much as their raw weight.

Another point: the statement ignores the impact of the number of HTTP requests. A 500 KB site spread across 150 requests can be slower than a 1 MB site compressed into 10 well-optimized requests (HTTP/2, CDN, cache). Size is just one variable among many.

In what cases doesn't this rule really apply?

On ultra-fast connections (fiber, 5G), the difference between 500 KB and 1 MB becomes negligible for network transfer. The bottleneck then shifts to CPU processing and code quality (JavaScript parsing, layout shifts).

Similarly, on high-end devices, processing resources is fast even if they're voluminous. The problem primarily arises on budget smartphones and unstable mobile connections — a significant share of global traffic. [To verify]: Google doesn't publish public stats on the actual distribution of device types in its indexes.

Practical impact and recommendations

What should you actually do to reduce resource size?

Start with a weight audit: use Lighthouse, WebPageTest, or GTmetrix to identify the heaviest resources. Focus on quick wins: image compression, conversion to WebP/AVIF, CSS/JS minification.

For images, prioritize native lazy-loading (loading="lazy" attribute) on everything that's not above-the-fold. Serve modern formats (WebP, AVIF) with a JPEG fallback. Set explicit dimensions to prevent layout shifts.

On the JavaScript side, hunt down unused libraries. Webpack Bundle Analyzer or Chrome DevTools Coverage show you what's loaded but never executed. Properly configured tree-shaking can halve your bundle size.

What mistakes should you avoid when optimizing?

Don't sacrifice visual quality to the point of pixelated images. A blurry image harms user experience and conversions — slight extra weight beats perceptible degradation.

Also avoid lazy-loading every image thoughtlessly. The hero image (LCP) must load immediately. Lazy-loading this critical resource degrades LCP instead of improving it.

Another pitfall: over-optimizing caching. Setting infinite cache on all resources can block urgent fixes. Use cache-busting (filename hashing) to properly version your assets.

How do you verify your site complies?

Regularly measure your Core Web Vitals via Search Console (real-world data) and PageSpeed Insights (lab data). Target LCP < 2.5s, FID < 100ms, and CLS < 0.1.

Use continuous monitoring (SpeedCurve, Calibre, Treo) to catch regressions. A plugin addition or theme update can easily push page weight up 30% overnight.

- Audit resource weight with Lighthouse or WebPageTest

- Compress and convert images to WebP/AVIF

- Minify CSS/JS and eliminate dead code (tree-shaking)

- Lazy-load non-critical images, but not the hero image

- Use a CDN to reduce network latency

- Implement cache-busting for static assets

- Monitor Core Web Vitals via Search Console and third-party tools

❓ Frequently Asked Questions

La taille des ressources est-elle le seul facteur qui impacte la vitesse d'un site ?

Faut-il privilégier le lazy-loading systématique de toutes les images ?

Quel format d'image privilégier pour optimiser le poids sans perdre en qualité ?

La réduction de la taille des ressources améliore-t-elle le budget de crawl ?

Comment mesurer l'impact réel de l'optimisation des ressources sur le classement ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.