Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

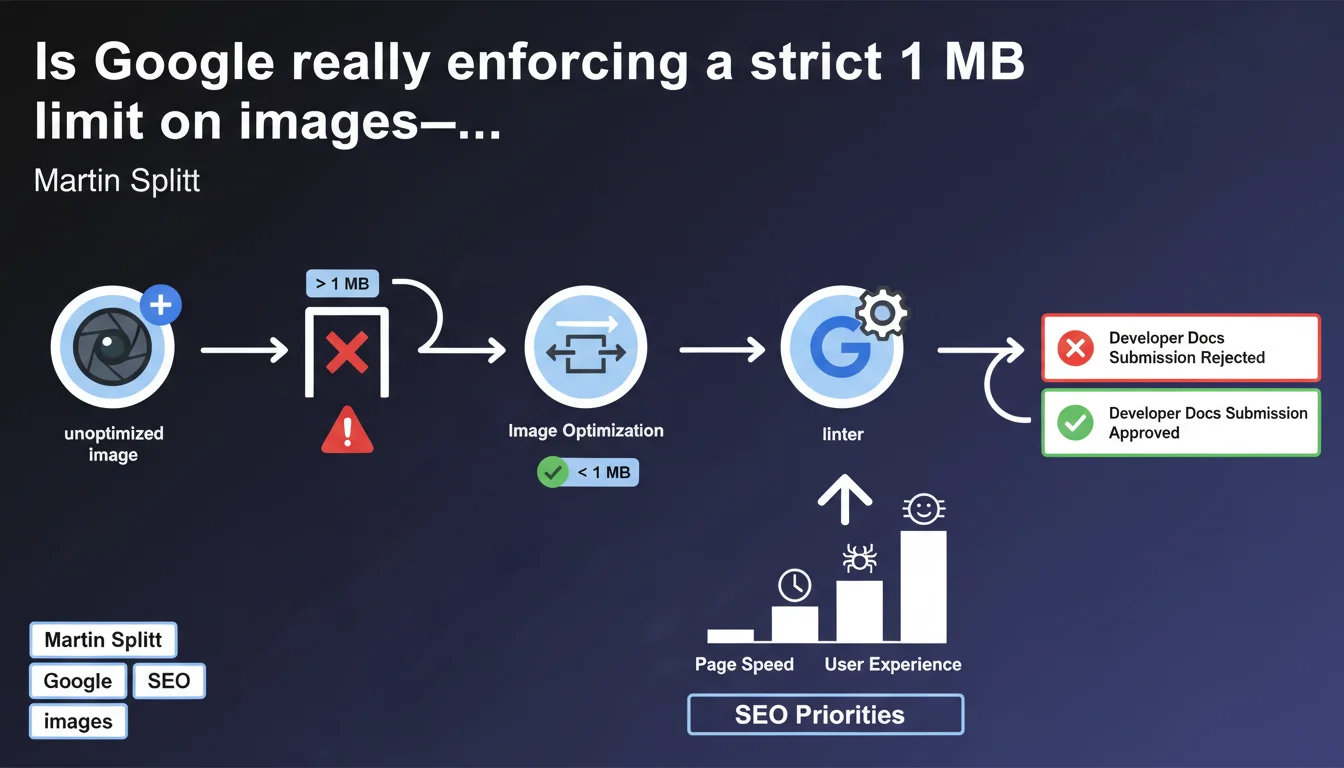

Google uses an internal linter that automatically blocks the submission of images exceeding 1 MB on its own developer documentation sites. This technical choice reveals the critical importance the search engine places on image optimization—and sends a clear signal to webmasters: if Google imposes this constraint on itself, you should do the same.

What you need to understand

What is a linter and why does Google use it for images?

A linter is an automated quality control tool that analyzes code or resources before deployment. Here, Google has configured its development pipeline to reject any image exceeding 1 MB on its own developer-focused sites.

This technical constraint is not trivial. It reflects a strict internal policy: even Google's own teams cannot bypass this rule. The implicit message? Image optimization is not optional, it's a prerequisite.

Why exactly 1 MB?

The 1 MB threshold is not chosen randomly. It's a compromise between acceptable visual quality and loading performance across various connection speeds. For a modern website, a 1 MB image remains relatively heavy—but it's a ceiling, not a target.

Most properly optimized images weigh between 50 and 300 KB. Google sets here an absolute upper limit, while knowing that its own teams aim well below it.

What is the direct implication for SEO?

Google doesn't explicitly say "heavy images will penalize your rankings." But by imposing this constraint on itself, the engine suggests that loading speed remains a major quality signal.

Images are often the first factor in slowing down a page. If you neglect their optimization, you sacrifice your Core Web Vitals (particularly LCP), which can impact your visibility.

- Google practices what it preaches: its own sites respect this strict limit

- The 1 MB threshold is an absolute maximum, not a target to reach

- Poorly optimized images directly degrade LCP and TTFB

- This statement confirms that image optimization remains a priority SEO lever

SEO Expert opinion

Does this internal constraint prove a direct ranking impact?

Let's be honest: no, not directly. Google doesn't say "any image above 1 MB will cost you positions." What this statement reveals is a performance-oriented engineering culture—and this culture inevitably influences algorithm design.

If Google imposes such strict constraints internally, it's because loading speed remains a non-negotiable quality criterion. Core Web Vitals are simply the public translation of this obsession. [To verify]: it would be interesting to correlate the average image size on a site with its actual LCP performance—Google provides no numerical data on this relationship.

Should you really limit yourself to 1 MB per image?

No, and that's where Google's message can be misleading. The 1 MB threshold is a safety limit, not an operational recommendation. In practice, targeting 1 MB remains far too generous for most images.

A well-compressed e-commerce product photo in WebP typically runs around 80-150 KB. An optimized hero banner? 200-300 KB maximum. If your images are approaching 1 MB, you've missed several compression steps.

What are the pitfalls to avoid with this statement?

The classic pitfall: thinking "OK, I'll get all my images to 999 KB and I'm good." No. The goal is not to meet an arbitrary limit, but to actually optimize loading.

Another trap: focusing only on file size in KB and ignoring actual dimensions. An image of 2000×1500 pixels compressed to 800 KB is still nonsense if it displays at 400×300 on mobile. The browser downloads unnecessary pixels, regardless of the final file size.

Practical impact and recommendations

What should you actually do to respect this logic?

First step: audit your existing images. Use Lighthouse, PageSpeed Insights, or a tool like Screaming Frog to list all images on your site and identify those exceeding 500 KB.

Next, apply a systematic compression strategy: conversion to WebP (with JPEG fallback), compression with acceptable loss (80-85% quality), and above all, generation of multiple sizes via srcset to serve the version adapted to each device.

How do you automate this optimization at scale?

Manually, it's unmanageable. The ideal is to integrate optimization into your build pipeline: tools like ImageOptim, Squoosh, or WordPress plugins like Imagify/ShortPixel that process images at upload.

For large sites, a CDN with on-the-fly image transformation (Cloudflare Images, Imgix, Cloudinary) is often the only viable solution. You upload the image in high quality, and the CDN automatically serves the optimized version based on context.

What critical errors should you avoid?

Never sacrifice visual quality in the name of optimization. A blurry or pixelated image degrades user experience and can harm conversion—and thus indirectly SEO through behavioral signals.

Another error: forgetting alt attributes. Google regularly emphasizes the importance of alternative text for accessibility and contextual understanding of images. A perfectly optimized image without relevant alt text remains a missed opportunity.

- Audit all images exceeding 500 KB

- Convert to WebP with JPEG/PNG fallback

- Implement srcset and sizes for responsiveness

- Use a CDN with automatic transformation for high volume

- Verify that each image has a descriptive alt attribute

- Regularly monitor LCP via Search Console and Lighthouse

- Enable lazy loading for images outside initial viewport

❓ Frequently Asked Questions

Google pénalise-t-il directement les sites avec des images au-dessus de 1 Mo ?

Le format WebP est-il vraiment indispensable ?

Faut-il optimiser toutes les images, même celles en dessous de 1 Mo ?

Quelle différence entre compression avec et sans perte ?

Les images SVG sont-elles concernées par cette limite ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.