Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ La compression réseau suffit-elle à optimiser le crawl de votre site ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

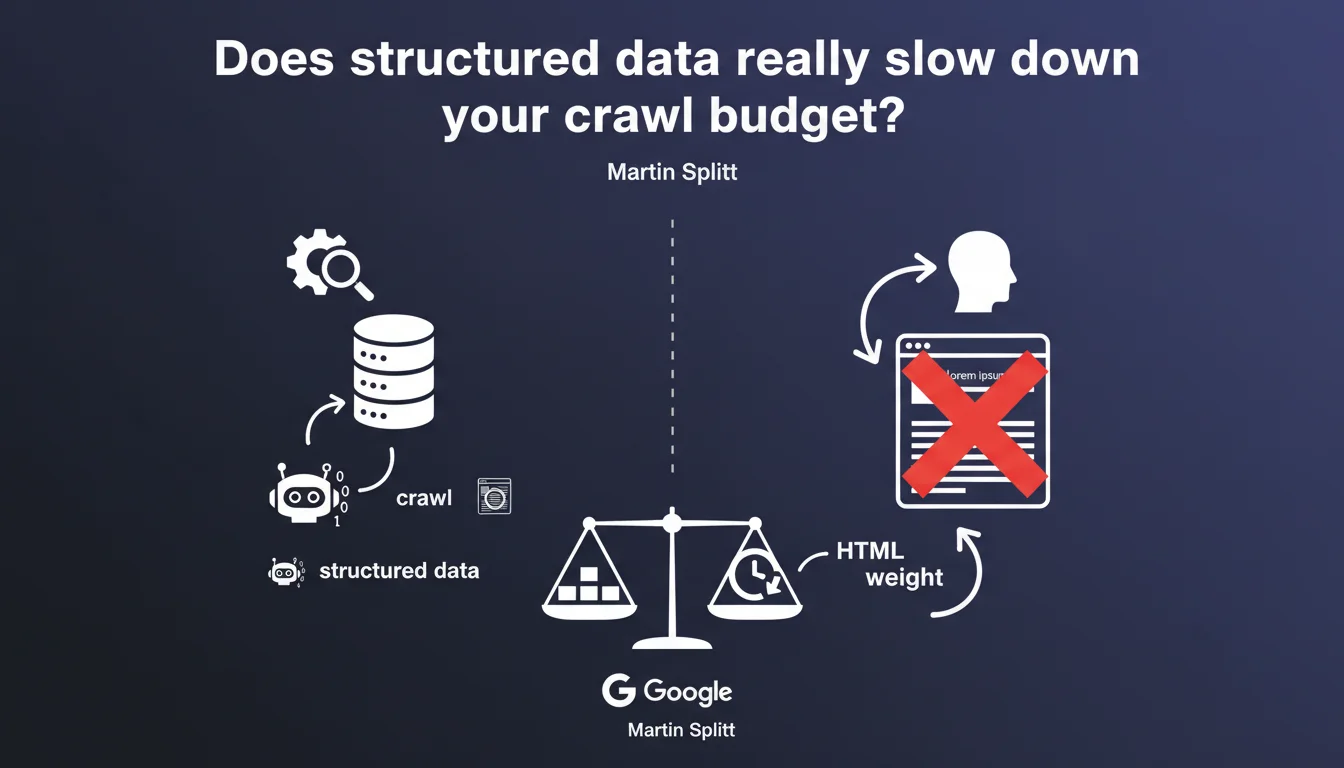

Martin Splitt reminds us that structured data inflates the HTML weight of pages. The more you add, the heavier it gets — which can impact crawl time and bandwidth consumption. Let's be honest: Google supports dozens of schema types, and stacking JSON-LD without discernment comes at a cost.

What you need to understand

Why is Google warning about the weight of structured data?

Structured data is additional code injected into the HTML to help search engines understand content. JSON-LD, microdata, RDFa: they all add kilobytes that the bot must download and parse.

The problem doesn't arise with a single Product or Article schema. But when you multiply types — FAQ, HowTo, BreadcrumbList, Organization, Review, Video, Event — HTML weight explodes. And this code is invisible to users: it only serves machines.

What are the concrete consequences of overly heavy HTML?

Bloated HTML consumes more bandwidth, slows down page downloads, and can hinder crawling. On a site with 10,000 pages containing 15 KB of structured data per page, that's 150 MB of pure JSON-LD that Googlebot must process.

Processing time on the bot side also increases. The more voluminous the HTML, the longer parsing and indexing take. On large-scale sites, this can impact crawl budget and delay the discovery of new pages.

Are all schema types equal in terms of weight?

No. A basic Article schema weighs 1-2 KB. A FAQPage schema with 10 detailed questions can reach 8-12 KB. An enriched Product schema with reviews, offers, aggregateRating: 5-7 KB.

Some sites stack 4-5 schemas per page without questioning it. Total weight can exceed 20 KB of structured data — more than the visible text content itself. That's where the problem lies.

- Structured data increases HTML weight proportionally to the volume of schemas added

- Heavy HTML slows down crawling, consumes crawl budget, and impacts bandwidth

- Google supports dozens of schema types: stacking without strategy has a real cost

- Structured data code is invisible to users — it only serves machines

- Complex schemas (FAQ, HowTo, enriched Product) weigh significantly more than a basic Article

SEO Expert opinion

Is this statement consistent with field observations?

Yes, completely. On e-commerce sites with product pages packed with Product schema + Review + FAQ + BreadcrumbList + Organization, we observe HTML weights of 80-120 KB of which 25-30 KB is pure JSON-LD. Server response time is fine, but crawl time increases mechanically.

Logs show Googlebot spends more time on these heavy pages. On sites with limited crawl budget, this translates to fewer pages crawled per session. Concretely? New pages take longer to be discovered.

Should you limit structured data then?

No — but you must be strategic. The classic mistake: deploying all schemas Google supports "just in case". FAQPage on every page when there's no real FAQ. HowTo on an article that isn't a tutorial. Review schema without actual user reviews.

The marginal SEO gain doesn't always justify the added weight. A poorly implemented or irrelevant schema provides nothing — it just consumes crawl budget for nothing. [To verify] Does Google have a threshold beyond which it penalizes HTML overweight? Officially no, but the crawl impact is measurable.

In what cases does structured data weight become critical?

On large sites with millions of pages. A media site with 500,000 articles, each carrying 10 KB of useless structured data: 5 GB of avoidable HTML weight. The bot spends its time downloading redundant JSON-LD instead of discovering fresh content.

On low-authority sites, crawl budget is limited. Every kilobyte counts. If Googlebot spends 30% of its time parsing non-essential schemas, that's 30% fewer pages crawled per session.

Practical impact and recommendations

What should you do concretely to optimize structured data weight?

Audit each schema type deployed. Ask yourself: does this schema deliver a measurable SEO gain or enriched display in the SERP? If not, remove it. A duplicated Organization schema on every page serves no purpose — put it only on the homepage.

Minimize JSON-LD. Remove unnecessary spaces, non-critical optional properties, redundant descriptions. A Product schema can be compact: name, image, offers, aggregateRating. No need to fill every property in the schema.org vocabulary.

What mistakes must you absolutely avoid?

Don't deploy a FAQPage schema with 20 detailed questions on every page if it doesn't generate rich snippets. Google rarely displays more than 2-3 FAQs in SERP — the rest is dead weight.

Avoid duplicating structured data between HTML and JSON-LD. Some CMS systems generate microdata in the page body AND JSON-LD in the footer — an unnecessary duplicate that bloats the code.

How do you verify the real impact on your crawl?

Analyze your server logs. Compare average crawl time for pages with structured data vs. without. Measure average HTML weight. If your pages exceed 100 KB of which 30 KB is JSON-LD, you likely have a problem.

Test the Rich Results Test on a sample of pages. Verify which schemas are actually eligible for rich snippets. Others are candidates for removal or simplification.

- Audit all deployed schema types and remove those without measurable SEO gain

- Minimize JSON-LD: remove spaces, non-critical optional properties, redundant descriptions

- Deploy a schema only if it generates an enriched display in the SERP

- Avoid duplicates between microdata and JSON-LD

- Limit FAQPage to a maximum of 3-5 relevant questions

- Place Organization schema only on the homepage, not on every page

- Analyze logs to measure the impact of HTML weight on crawl time

- Test schemas with the Rich Results Test before massive deployment

❓ Frequently Asked Questions

Combien de ko de structured data est acceptable par page ?

Les structured data impactent-elles le temps de chargement côté utilisateur ?

Faut-il privilégier JSON-LD ou microdata pour limiter le poids ?

Un schema invalide ralentit-il davantage le crawl ?

Les structured data comptent-elles dans le crawl budget ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.