Official statement

Other statements from this video 43 ▾

- □ Pourquoi Googlebot s'arrête-t-il à 15 Mo par URL et comment cela impacte-t-il votre crawl ?

- □ Google mesure-t-il vraiment le poids de page comme vous le pensez ?

- □ Le poids des pages mobiles a triplé en 10 ans : faut-il s'inquiéter pour le SEO ?

- □ Les données structurées alourdissent-elles trop vos pages pour être rentables en SEO ?

- □ Votre site mobile contient-il autant de contenu que votre version desktop ?

- □ Pourquoi votre contenu desktop disparaît-il des résultats Google s'il manque sur mobile ?

- □ La vitesse de page impacte-t-elle réellement les conversions selon Google ?

- □ Google traite-t-il vraiment 40 milliards d'URLs de spam par jour ?

- □ La compression réseau améliore-t-elle réellement le crawl budget de votre site ?

- □ Le lazy loading est-il vraiment indispensable pour optimiser le poids initial de vos pages ?

- □ Googlebot s'arrête-t-il vraiment après 15 Mo par URL ?

- □ Pourquoi le poids des pages mobiles a-t-il triplé en une décennie ?

- □ Le poids des pages impacte-t-il vraiment l'expérience utilisateur et le SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la parité mobile-desktop reste-t-elle un facteur de déclassement majeur ?

- □ Faut-il encore se préoccuper du poids des pages pour le SEO ?

- □ La taille des ressources est-elle le facteur déterminant de la vitesse de votre site ?

- □ Pourquoi Google impose-t-il une limite stricte de 1 Mo pour les images ?

- □ L'optimisation de la taille des pages profite-t-elle vraiment plus aux utilisateurs qu'au SEO ?

- □ Googlebot limite-t-il vraiment le crawl à 15 Mo par URL ?

- □ Le poids des pages web explose : faut-il s'inquiéter pour son SEO ?

- □ La taille des pages web nuit-elle encore vraiment à votre SEO ?

- □ Les structured data alourdissent-elles vos pages au point de nuire au SEO ?

- □ La vitesse de chargement influence-t-elle vraiment les conversions de vos pages ?

- □ La compression réseau suffit-elle à optimiser l'espace de stockage des utilisateurs ?

- □ Pourquoi la disparité mobile/desktop tue-t-elle votre référencement en indexation mobile-first ?

- □ Le lazy loading est-il vraiment un levier de performance SEO à activer systématiquement ?

- □ Google bloque 40 milliards d'URLs de spam par jour : comment votre site échappe-t-il au filtre ?

- □ L'optimisation des images peut-elle vraiment diviser par 10 le poids de vos pages ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL ?

- □ Pourquoi la parité mobile-desktop impacte-t-elle autant votre classement en Mobile-First Indexing ?

- □ Le poids de vos pages freine-t-il vraiment votre référencement ?

- □ Les données structurées ralentissent-elles vraiment votre crawl ?

- □ Google intercepte vraiment 40 milliards d'URLs de spam par jour ?

- □ Faut-il limiter vos images à 1 Mo pour plaire à Google ?

- □ Googlebot s'arrête-t-il vraiment à 15 Mo par URL crawlée ?

- □ La vitesse d'un site impacte-t-elle vraiment la conversion ?

- □ Pourquoi la disparité mobile-desktop ruine-t-elle encore tant de classements SEO ?

- □ Les données structurées alourdissent-elles vraiment vos pages HTML ?

- □ Pourquoi la taille des pages reste-t-elle un facteur SEO critique malgré l'amélioration des connexions Internet ?

- □ Le lazy loading peut-il vraiment booster vos performances sans impacter le crawl ?

- □ La taille d'un site web a-t-elle vraiment un impact sur son référencement ?

- □ Pourquoi Google limite-t-il la taille des images à 1Mo sur sa documentation développeur ?

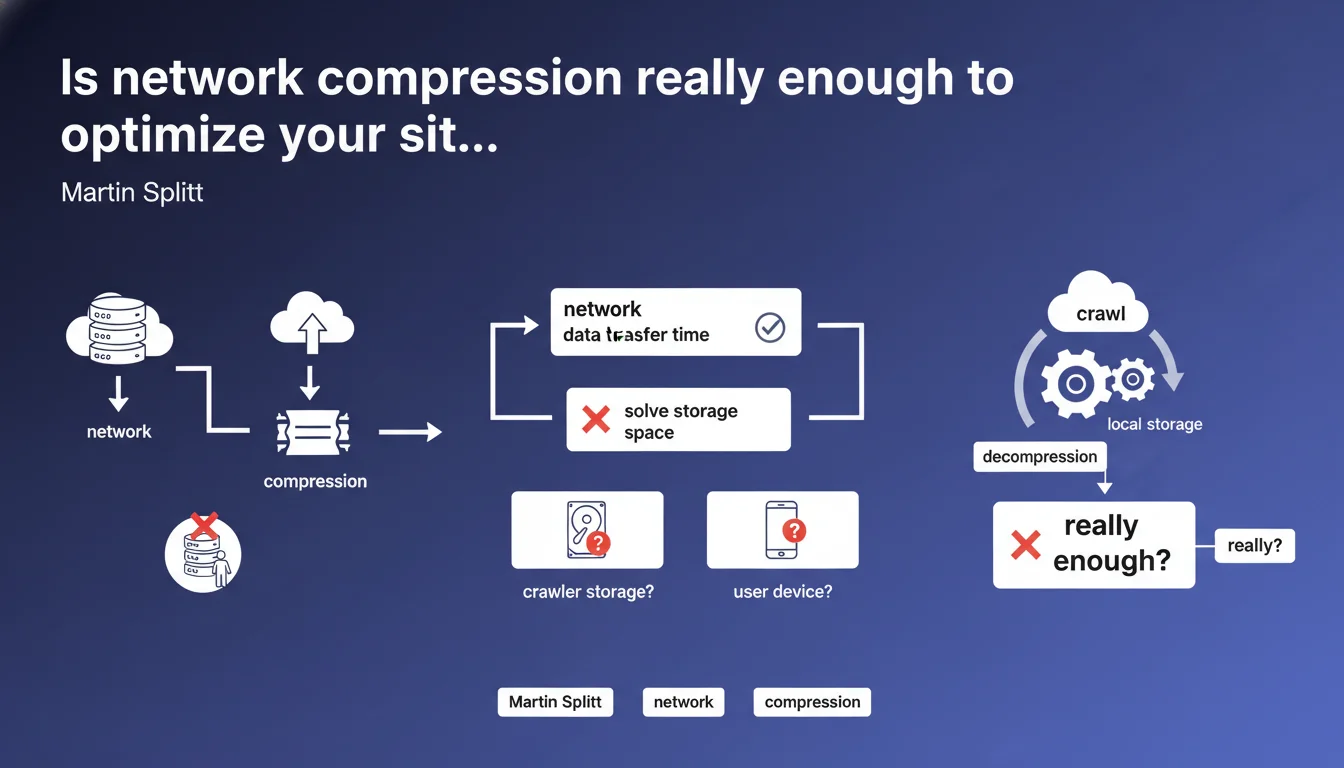

Network compression (gzip, brotli) reduces the data transfer time between server and client, but has no impact on the storage space required on the crawler's or user's side. Once decompressed, resources occupy the same volume as before compression. This technical detail has concrete implications for crawl budget optimization and managing large-sized resources.

What you need to understand

Why does Google specify that network compression does not solve local storage?

This clarification aims to correct a common misconception: many SEOs believe that by compressing their CSS, JavaScript or HTML files, they reduce not only page load time but also the load on the crawler side. This is partially wrong.

Network compression (gzip, brotli) acts only during the transit of data between the server and the client. Once files are received by Googlebot or the browser, they must be decompressed to be processed. At that point, they return to their original size and occupy as much memory space as an uncompressed file.

What is the difference between network compression and file weight optimization?

Network compression is a temporary and transparent operation: the server compresses, the client decompresses. It's a win-win for bandwidth, but that's where it stops.

Real file weight optimization involves reducing the native size of resources: code minification, comment removal, image compression (JPEG, WebP), elimination of unnecessary JavaScript. These gains persist after decompression and directly impact the memory consumption of the crawler or browser.

What are the implications for crawl budget and performance?

Googlebot has limited resources — in time, bandwidth, but also in processing capacity and temporary storage. If your pages weigh 5 MB after decompression, the crawler will need to allocate that space to analyze the DOM, execute JavaScript, and extract links.

A site with resource-heavy files, even well-compressed in transit, risks consuming its crawl budget faster than a natively light site. Network compression improves download speed, not processing efficiency.

- Network compression (gzip, brotli): reduces transfer time, not final memory footprint

- Native optimization: minification, removal of unnecessary elements, optimized images — real impact on storage and processing

- Crawl budget: influenced by the decompressed weight of resources, not just download speed

- Core Web Vitals: network compression helps with LCP and FCP, but the final resource size affects TBT and interactivity

SEO Expert opinion

Is this distinction really new for experienced SEOs?

Let's be honest: for a technical expert, this is basic knowledge. Every developer knows that gzip decompresses on the client side. But in SEO practice, this nuance is often overlooked.

We regularly see audits praising Brotli compression as a miracle solution to "page weight", when it only addresses a symptom — transfer time — without tackling the underlying problem. And that's where the issue lies: many modern CMS platforms generate bloated HTML, redundant JavaScript, and oversized CSS. Enabling network compression does not eliminate the need for real optimization work.

What are the concrete consequences on Googlebot's behavior?

Googlebot operates with strict quotas: crawl time, bandwidth, and processing capacity. If your pages are 3 MB decompressed, the crawler will need to allocate more resources to parse the DOM, execute JavaScript, and extract relevance signals.

The result? Fewer pages explored per crawl session. On a site with thousands of pages, this can delay the indexing of new URLs or the update of modified content. [To verify]: Google has never published a specific threshold beyond which decompressed resource weight directly impacts crawl budget, but real-world observations show a clear correlation between resource size and bot crawl frequency.

Should network compression be neglected then?

Certainly not. Network compression remains essential: it reduces transfer time, improves Core Web Vitals (particularly LCP), and decreases server-side bandwidth consumption. But it does not replace a comprehensive optimization strategy.

The trap would be believing that good server configuration (gzip, Brotli, CDN) eliminates the need to lighten source code. Both approaches are complementary, not interchangeable.

Practical impact and recommendations

What should you actually do to optimize the real weight of your pages?

First step: measure the decompressed weight of your resources. Standard tools (PageSpeed Insights, WebPageTest) mainly display transferred weight. Use Chrome DevTools (Network tab, Size vs Transferred column) to see the gap.

Next, prioritize native minification: remove spaces, comments, and unnecessary variables from HTML, CSS, and JavaScript. Tools like Terser (JS), cssnano (CSS), or HTMLMinifier automate this process. If you use a modern framework (React, Vue), enable production build optimizations.

What mistakes should you avoid when managing large resources?

Classic mistake: loading entire libraries when you only use a few functions. Lodash, jQuery, Bootstrap — these libraries are heavy when decompressed. Prefer tree-shaking or lightweight alternatives (vanilla JS, custom CSS utilities).

Another trap: non-optimized images. A 2 MB JPEG compressed with gzip remains a 2 MB JPEG after decompression. Switch to WebP or AVIF, reduce dimensions, and lazy-load images outside the viewport. The gain is direct and measurable.

How can you verify that your site is not wasting crawl budget?

Check the coverage reports in Search Console: pages crawled per day, average download time, server errors. If download time increases while network compression is active, the problem comes from decompressed weight or server speed.

Regularly audit the heaviest resources with Screaming Frog or OnCrawl. Identify JavaScript or CSS files exceeding 500 KB decompressed — these are priority optimization candidates.

- Enable gzip or Brotli on the server (nginx, Apache, CDN)

- Minify HTML, CSS, and JavaScript in production

- Remove unused or oversized JavaScript libraries

- Optimize images (WebP/AVIF format, compression, lazy-loading)

- Measure the decompressed weight of resources in DevTools

- Monitor average download time in Search Console

- Prioritize strategic pages to reduce their memory footprint

❓ Frequently Asked Questions

La compression Brotli est-elle meilleure que gzip pour le SEO ?

Le poids décompressé des ressources affecte-t-il réellement le crawl budget ?

Comment mesurer le poids décompressé de mes pages ?

Faut-il privilégier la minification ou la compression réseau ?

Quel impact sur les Core Web Vitals ?

🎥 From the same video 43

Other SEO insights extracted from this same Google Search Central video · published on 30/03/2026

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.