Official statement

Other statements from this video 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

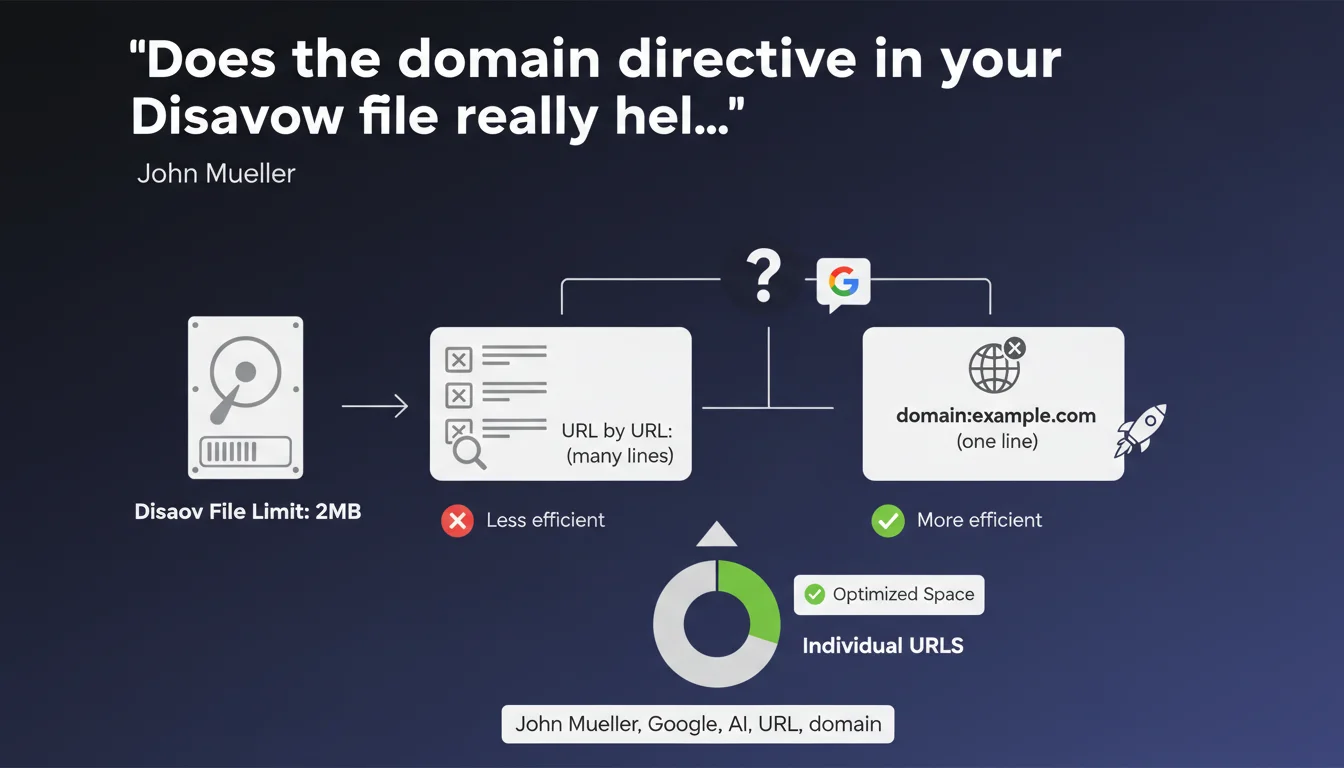

Google enforces a strict 2MB limit on Disavow files. To avoid exceeding it, Mueller recommends using the domain directive (domain:) rather than listing each URL individually. This approach optimizes space and simplifies managing massive disavowals.

What you need to understand

What is this 2MB limit and why does it exist?

Google sets a strict technical constraint: the Disavow file cannot exceed 2MB. Beyond that, the file is simply rejected or only partially processed.

This limit is explained by server processing reasons — Google must parse these files for millions of websites. A file that is too large would slow down the process and consume disproportionate resources.

Why does the domain directive change everything?

Listing each URL individually (https://spam-site.com/page1, https://spam-site.com/page2, etc.) consumes enormous amounts of space. A single domain:spam-site.com directive disavows the entire domain in just a few bytes.

Concretely? If a domain generates thousands of toxic backlinks, the domain directive reduces file size by 100 times or more. It's purely mechanical.

When should you really worry about this limit?

This issue primarily affects sites that have suffered massive negative SEO attacks or wild linking campaigns across hundreds of referring domains. For a standard audit, the 2MB limit remains rarely an obstacle.

- 2MB limit: non-negotiable technical constraint on Google's side

- Domain directive: disavows all backlinks from an entire domain in one line

- Essential optimization: for sites with thousands of toxic links to disavow

- Efficient parsing: drastically reduces file size and facilitates processing

SEO Expert opinion

Is this recommendation really new?

No. The domain directive has existed since the early days of the Disavow Tool. Mueller's reminder comes because many SEO professionals were still listing each URL out of habit or lack of knowledge.

Some audit tools generate Disavow files with URL-level granularity by default, not domain-level — which explains the persistence of this inefficient practice. Let's be honest: if a domain is toxic, disavowing 500 individual URLs from the same site makes no sense.

In what cases does the domain directive cause problems?

Where it gets tricky: when a quality domain (a real media outlet, an institutional site) hosts a few spammed or hacked pages. Disavowing the entire domain causes you to lose legitimate backlinks.

In this specific case, it's better to disavow the individual URLs of compromised pages. It's more verbose, but surgical. [To verify]: Google has never published data on the real impact of Disavow in 2023-2024 — it's impossible to quantify its on-the-ground effectiveness with certainty.

Does Disavow remain relevant with current algorithms?

Google has claimed for years that its algorithms automatically ignore poor-quality backlinks. So why maintain the Disavow Tool?

Because in extreme cases — massive attacks, manual penalties — the tool remains an explicit signal sent to Google. But for 95% of sites, Disavow is unnecessary. If your link profile is healthy, don't touch it.

Practical impact and recommendations

How do you structure an optimal Disavow file?

Start with a backlink profile audit. Identify entire domains that are toxic (link farms, questionable PBNs, obvious spam). For those, use domain:. For borderline cases — mixed domains with good and bad content — stay at URL level.

The file should look like this:

- One entry per line (URL or domain)

- Format: domain:example.com to disavow the entire domain

- Format: https://example.com/spam-page for a specific URL

- Comments allowed with # at the beginning of a line (useful for documenting your approach)

- Encode the file in UTF-8 or plain text, never in .doc or .pdf

- Verify final size: if > 2MB, consolidate further with domain directives

What mistakes should you absolutely avoid?

First common mistake: disavowing domains without checking their history. A domain can be resold, cleaned up, or host legitimate content despite a few spammed pages. Always cross-reference multiple sources (Ahrefs, Majestic, Search Console).

Second mistake: submitting a Disavow file "just in case". If Google detects that you're disavowing massively without valid reason, it can raise internal red flags. Disavow is not insurance — it's a last resort.

What if my file still exceeds 2MB after optimization?

It's rare, but it happens to sites that have suffered industrial-scale attacks. In this case, prioritize the most toxic domains (high Spam Score, zero traffic, suspicious link profile). Split your file in waves: submit the worst first, wait a few weeks, then add the rest.

And that's where it gets tricky — managing a backlink profile this polluted requires fine expertise and ongoing monitoring. Between manual analysis, disavow prioritization, and post-submission monitoring, the process can quickly become time-consuming. If you manage a critical site or a portfolio of domains, bringing in a specialized SEO agency to structure this approach can prevent irreversible errors and accelerate site recovery.

❓ Frequently Asked Questions

Que se passe-t-il si mon fichier Disavow dépasse 2MB ?

Puis-je mixer directives domaine et URLs individuelles dans le même fichier ?

Combien de temps avant que Google prenne en compte un fichier Disavow ?

Faut-il désavouer les liens nofollow ?

Le Disavow peut-il nuire à mon SEO si mal utilisé ?

🎥 From the same video 29

Other SEO insights extracted from this same Google Search Central video · published on 14/01/2022

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.