Official statement

Other statements from this video 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

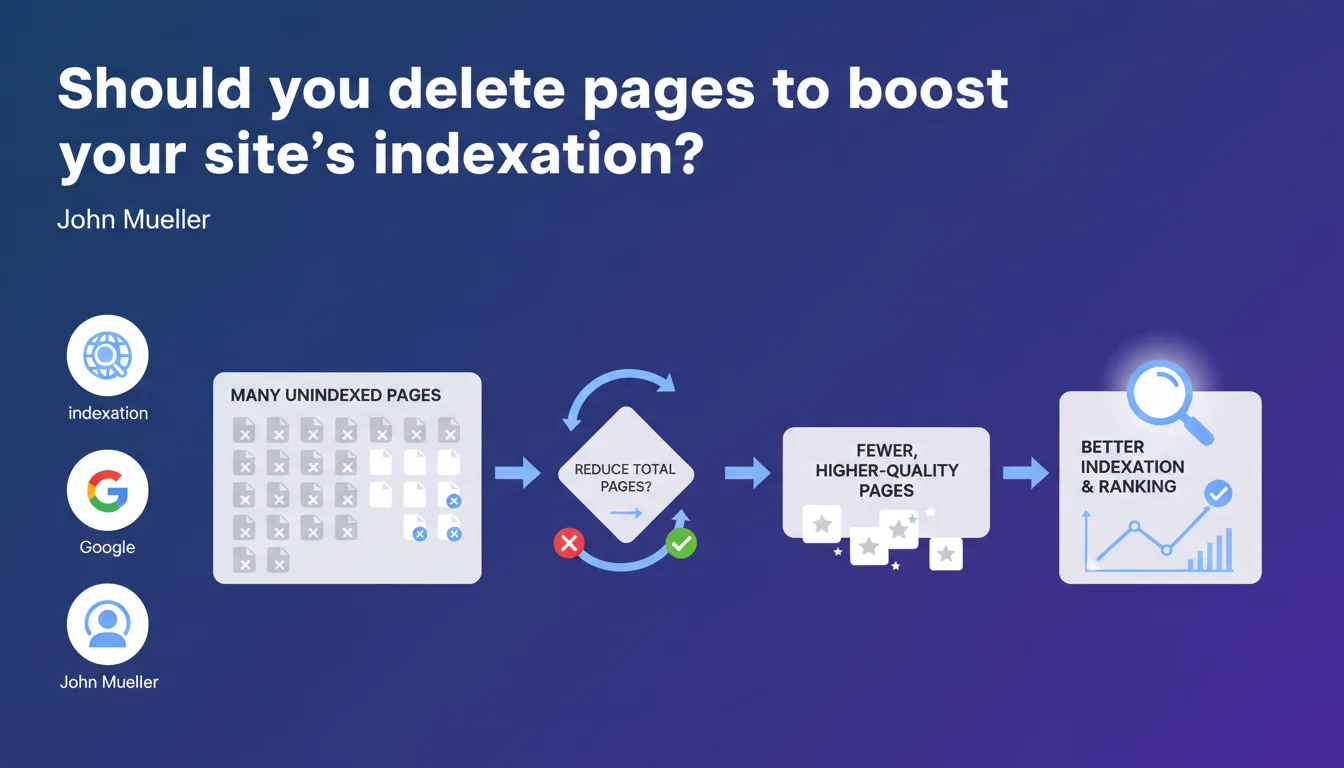

John Mueller confirms that a site with many non-indexed pages can benefit from reducing its overall volume. The goal: concentrate crawl budget and value on higher-quality pages. Google will index and rank priority content better if you simplify the task.

What you need to understand

Why does Google struggle to index all content on a website?

Crawl budget is not infinite. Google allocates limited time and resources to explore each site based on criteria like domain authority, update frequency, and perceived content quality.

If a site publishes massively without a clear editorial strategy — duplicate pages, poor content, infinite variations — the bot spends time on valueless URLs. Result: strategic pages are not crawled, or are crawled with significant delay.

What distinguishes a "quality" page from a superfluous one?

Google never provides binary criteria. But a quality page addresses a clear user intent, delivers unique value, and generates engagement signals.

Conversely, a superfluous page might be an unnecessary parametric variation, auto-generated content with no added value, an empty archive, or a hidden technical duplicate. Often these pages exist for historical or technical reasons, not for the user.

How does reducing the number of pages improve indexation?

Fewer pages means less dispersal of crawl budget. Google dedicates more resources to priority content, revisits it more often, and indexes updates faster.

For ranking, concentrating signals — internal links, click depth, traffic — on a limited number of pages strengthens their individual authority. A 500-page high-performing site often outranks a 5000-page mediocre site.

- Crawl budget is a limited resource that Google distributes based on perceived site quality

- Reducing page volume only makes sense if the removed pages are low-value

- Quality trumps quantity: 100 excellent pages beat 1000 average pages

- Indexation is not a right — Google decides what deserves indexing by its own criteria

- This logic applies especially to mid-authority sites with documented indexation issues

SEO Expert opinion

Is this recommendation truly new or just a reminder?

Let's be honest: this statement is not groundbreaking. The principle of crawl budget and quality over quantity has been repeated for years. What changes is that Google verbalizes it increasingly explicitly.

For several years we've observed a trend toward aggressive deindexing of content deemed irrelevant, even on established sites. Mueller's statement fits this logic: Google prefers a web focused on useful content rather than an ocean of indiscriminately generated pages.

In what cases doesn't this rule apply?

An authority site with strong crawl budget — think Amazon, Wikipedia — can afford millions of pages. Volume is not a problem if quality follows and crawling is efficient.

Conversely, a small niche site with 50 pages has no reason to delete content on principle. Mueller's advice targets sites that have artificially inflated their volume — infinite e-commerce facets, dated archives, auto-generated content — and that suffer from documented low indexation rates in Search Console.

What nuances should be applied to this reduction logic?

Mueller speaks of "higher-quality pages", but Google provides no quantifiable threshold. What level of quality? Measured how? By whom? [To verify] in each specific context.

Moreover, the notion of "priority pages" is subjective. For Google, priority may be determined by user engagement. For a publisher, it might be strategic pages with low traffic but crucial for conversion or editorial credibility. These two visions don't always align.

Finally, reducing page count is just one lever among many. A poorly structured site with 200 pages can be worse than a well-organized site with 2000 pages. Internal linking, speed, editorial quality, UX signals — everything counts.

Practical impact and recommendations

What should I do concretely if my site suffers from partial indexation?

Start by auditing non-indexed pages in Search Console. Identify patterns: are these e-commerce facets? Dated archives? Duplicate or poor content?

Next, segment these pages into three groups: those deserving improvement, those that can be consolidated (merging similar content), and those to be deleted or set to noindex. Never delete without checking traffic and backlinks.

For retained pages, optimize their crawlability: reinforced internal linking, reduced click depth, improved editorial quality. Redirect 301 deleted pages to relevant content, or use 410 if no equivalent exists.

What errors should be avoided when reducing volume?

Don't rely solely on recent traffic metrics. A page with no traffic may have quality backlinks or convert occasionally. Always verify.

Avoid deleting pages in batches without individual analysis. Each URL potentially has a story, links, utility. A mechanical approach destroys value.

Don't confuse indexation with ranking. Reducing volume may improve indexation, but if remaining pages are mediocre, ranking won't follow. Editorial quality remains decisive.

- Analyze non-indexed pages via Search Console (Coverage tab then Excluded)

- Export organic traffic data for 12+ months minimum for each URL candidate for deletion

- Check backlinks via third-party tool (Ahrefs, Majestic, SEMrush)

- Identify duplicate or near-duplicate content with a crawler (Screaming Frog, OnCrawl)

- Consolidate similar content rather than deleting systematically

- Implement 301 redirects to relevant content for any deleted page

- Use 410 (Gone) for pages without logical equivalent

- Strengthen internal linking to priority retained pages

- Monitor indexation and traffic evolution for 3 months post-intervention

❓ Frequently Asked Questions

Combien de pages dois-je supprimer pour améliorer mon indexation ?

Si je supprime des pages, est-ce que Google indexera automatiquement les autres ?

Vaut-il mieux supprimer une page ou la passer en noindex ?

Cette logique s'applique-t-elle aux sites d'actualité ou e-commerce ?

Comment savoir si mon site souffre vraiment d'un problème de crawl budget ?

🎥 From the same video 29

Other SEO insights extracted from this same Google Search Central video · published on 14/01/2022

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.