Declaration officielle

Autres déclarations de cette vidéo 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

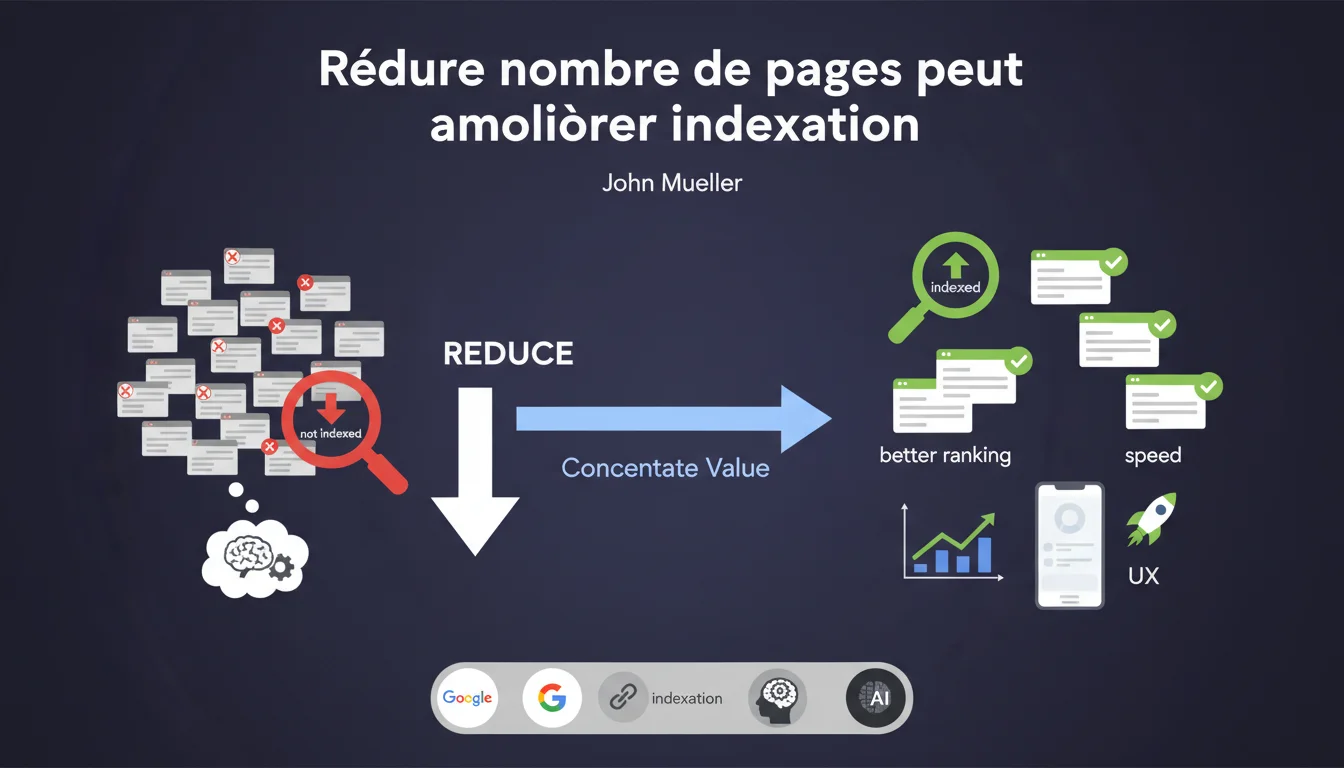

John Mueller confirme qu'un site avec beaucoup de pages non indexées peut gagner à réduire son volume total. L'objectif : concentrer le crawl budget et la valeur sur des pages de meilleure qualité. Google indexera et classera mieux les contenus prioritaires si on lui simplifie le travail.

Ce qu'il faut comprendre

Pourquoi Google peine-t-il à indexer tous les contenus d'un site ?

Le crawl budget n'est pas infini. Google alloue un temps et des ressources limités pour explorer chaque site, en fonction de critères comme l'autorité du domaine, la fréquence de mise à jour, et la qualité perçue des contenus.

Si un site publie massivement sans stratégie éditoriale claire — pages dupliquées, contenus pauvres, variations infinies — le robot passe du temps sur des URL sans valeur. Résultat : les pages stratégiques ne sont pas crawlées, ou le sont avec un délai important.

Qu'est-ce qui différencie une page « de qualité » d'une page superflue ?

Google ne donne jamais de critères binaires. Mais une page de qualité répond à une intention utilisateur claire, apporte une valeur unique, génère des signaux d'engagement.

À l'inverse, une page superflue peut être une variation paramétrique inutile, un contenu généré automatiquement sans valeur ajoutée, une archive vide, ou un doublon technique masqué. Souvent, ces pages existent pour des raisons historiques ou techniques, pas pour l'utilisateur.

En quoi réduire le nombre de pages améliore-t-il l'indexation ?

Moins de pages signifie moins de dispersion du crawl budget. Google consacre davantage de ressources aux contenus prioritaires, les revisite plus souvent, et indexe plus rapidement les mises à jour.

Côté ranking, la concentration de signaux — liens internes, profondeur de clic, trafic — sur un nombre limité de pages renforce leur autorité individuelle. Un site de 500 pages performantes surclasse souvent un site de 5000 pages médiocres.

- Le crawl budget est une ressource limitée que Google distribue selon la qualité perçue du site

- Réduire le volume de pages n'est pertinent que si les pages supprimées sont de faible valeur

- La qualité prime sur la quantité : mieux vaut 100 pages excellentes que 1000 pages moyennes

- L'indexation n'est pas un droit — Google décide ce qui mérite d'être indexé selon ses propres critères

- Cette logique s'applique surtout aux sites de moyenne autorité avec des problèmes d'indexation documentés

Avis d'un expert SEO

Cette recommandation est-elle réellement nouvelle ou juste un rappel ?

Soyons honnêtes : cette déclaration n'a rien de révolutionnaire. Le principe du crawl budget et de la qualité sur la quantité est répété depuis des années. Ce qui change, c'est que Google le verbalise de plus en plus explicitement.

On observe depuis plusieurs années une tendance à la désindexation agressive de contenus jugés non pertinents, même sur des sites établis. La déclaration de Mueller s'inscrit dans cette logique : Google préfère un web resserré sur des contenus utiles plutôt qu'un océan de pages générées sans discernement.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Un site d'autorité avec un fort crawl budget — pensez Amazon, Wikipedia — peut se permettre des millions de pages. Le volume n'est pas un problème si la qualité suit et que le crawl est efficace.

À l'inverse, un petit site de niche avec 50 pages n'a aucun intérêt à supprimer du contenu pour le principe. Le conseil de Mueller vise les sites qui ont gonflé artificiellement leur volume — facettes e-commerce infinies, archives datées, contenus auto-générés — et qui souffrent d'un taux d'indexation faible documenté dans la Search Console.

Quelles nuances faut-il apporter à cette logique de réduction ?

Mueller parle de "pages de meilleure qualité", mais Google ne fournit aucun seuil quantifiable. Quel niveau de qualité ? Mesuré comment ? Par qui ? [À vérifier] dans chaque contexte spécifique.

De plus, la notion de "pages prioritaires" est subjective. Pour Google, la priorité peut être déterminée par l'engagement utilisateur. Pour un éditeur, ce peut être des pages stratégiques peu visitées mais cruciales pour la conversion ou la crédibilité éditoriale. Ces deux visions ne coïncident pas toujours.

Enfin, réduire le nombre de pages n'est qu'un levier parmi d'autres. Un site mal structuré avec 200 pages peut être pire qu'un site bien organisé avec 2000 pages. Le maillage interne, la vitesse, la qualité éditoriale, les signaux UX — tout compte.

Impact pratique et recommandations

Que faut-il faire concrètement si mon site souffre d'indexation partielle ?

Commence par auditer les pages non indexées dans la Search Console. Identifie les patterns : s'agit-il de facettes e-commerce ? D'archives datées ? De contenus dupliqués ou pauvres ?

Ensuite, segmente ces pages en trois groupes : celles qui méritent d'être améliorées, celles qui peuvent être consolidées (fusion de contenus similaires), et celles qui doivent être supprimées ou mises en noindex. Ne supprime jamais sans vérifier le trafic et les backlinks.

Pour les pages conservées, optimise leur crawlabilité : maillage interne renforcé, réduction de la profondeur de clic, amélioration de la qualité éditoriale. Redirige en 301 les pages supprimées vers des contenus pertinents, ou laisse un 410 si aucun équivalent n'existe.

Quelles erreurs éviter lors d'une réduction de volume ?

Ne te base pas uniquement sur des métriques de trafic récent. Une page sans trafic peut avoir des backlinks de qualité ou convertir ponctuellement. Vérifie systématiquement.

Évite de supprimer des pages par batch sans analyse individuelle. Chaque URL a potentiellement une histoire, des liens, une utilité. Une approche mécanique détruit de la valeur.

Ne confonds pas indexation et ranking. Réduire le volume peut améliorer l'indexation, mais si les pages restantes sont médiocres, le classement ne suivra pas. La qualité éditoriale reste déterminante.

- Analyser les pages non indexées via Search Console (onglet "Couverture" puis "Exclues")

- Exporter les données de trafic organique sur 12 mois minimum pour chaque URL candidate à la suppression

- Vérifier les backlinks via un outil tiers (Ahrefs, Majestic, SEMrush)

- Identifier les contenus dupliqués ou quasi-dupliqués avec un crawler (Screaming Frog, OnCrawl)

- Consolider les contenus similaires plutôt que de les supprimer systématiquement

- Mettre en place des redirections 301 vers des contenus pertinents pour toute page supprimée

- Utiliser le 410 (Gone) pour les pages sans équivalent logique

- Renforcer le maillage interne vers les pages prioritaires conservées

- Monitorer l'évolution de l'indexation et du trafic pendant 3 mois post-intervention

❓ Questions frequentes

Combien de pages dois-je supprimer pour améliorer mon indexation ?

Si je supprime des pages, est-ce que Google indexera automatiquement les autres ?

Vaut-il mieux supprimer une page ou la passer en noindex ?

Cette logique s'applique-t-elle aux sites d'actualité ou e-commerce ?

Comment savoir si mon site souffre vraiment d'un problème de crawl budget ?

🎥 De la même vidéo 29

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.