Declaration officielle

Autres déclarations de cette vidéo 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

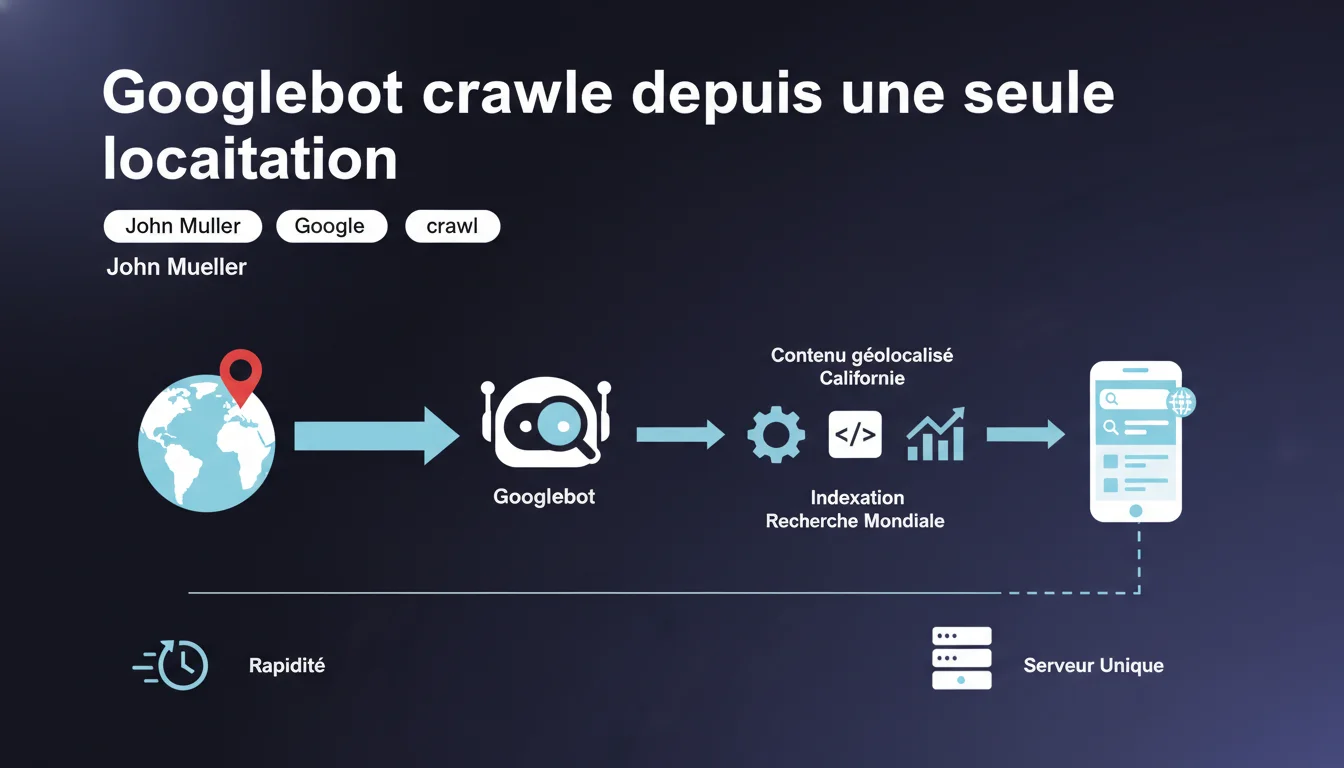

Googlebot crawle généralement depuis une seule localisation — probablement la Californie pour la plupart des systèmes. Si votre contenu varie selon la géolocalisation de l'utilisateur, c'est la version californienne qui sera indexée. Pour les sites internationaux ou régionaux, cette réalité impose de repenser totalement la gestion du contenu géo-ciblé.

Ce qu'il faut comprendre

D'où Googlebot crawle-t-il exactement nos contenus ?

John Mueller confirme ce que beaucoup soupçonnaient : Googlebot ne simule pas des crawls depuis plusieurs pays. Il opère depuis une seule localisation géographique — probablement la Californie pour l'essentiel des systèmes de Google.

Concrètement ? Si vous affichez un contenu différent selon l'IP de l'utilisateur (prix en euros vs dollars, disponibilité produit régionale, promotions locales), Googlebot ne verra qu'une seule version. Et cette version, c'est celle que vous servez depuis la Californie.

Pourquoi cette limitation pose-t-elle problème ?

Parce que de nombreux sites ajustent leur contenu en fonction de la géolocalisation de l'utilisateur — pensez aux e-commerces, aux sites d'actualités régionales, aux plateformes de réservation.

Si votre stratégie repose sur du contenu dynamique géo-ciblé sans versions distinctes indexables, vous risquez de servir à Google une version qui ne correspond pas à votre cible réelle. Le bot indexe ce qu'il voit depuis la Californie, pas ce que voient vos utilisateurs français, britanniques ou japonais.

Quelle différence avec les sites multilingues classiques ?

Les sites structurés avec des sous-domaines ou sous-répertoires par pays (exemple.fr, example.com/uk/) ne sont pas impactés de la même manière. Ces URLs distinctes sont crawlées et indexées séparément.

Le problème concerne surtout les sites qui changent dynamiquement le contenu d'une même URL selon la localisation détectée — sans redirection, sans URL différente. Googlebot n'a qu'une seule IP, donc il ne voit qu'une seule version.

- Googlebot crawle depuis une seule localisation géographique, probablement la Californie

- Les contenus géolocalisés dynamiquement ne seront indexés que dans leur version californienne

- Les structures multi-pays avec URLs distinctes échappent à ce problème

- Les variations tarifaires, linguistiques ou de disponibilité basées sur l'IP ne seront pas toutes indexées

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, largement. Depuis des années, les praticiens SEO constatent que Googlebot crawle majoritairement depuis des plages IP américaines. Les logs serveur le confirment : pas de diversité géographique notable dans les requêtes du bot.

Mais attention — et c'est là que Mueller reste volontairement flou — il dit « probablement la Californie pour la plupart des systèmes ». Cette formulation laisse une marge d'interprétation : existe-t-il des exceptions ? Pour quels types de contenus ou de sites ? [A vérifier] Google ne précise pas.

Quelles nuances faut-il apporter à cette règle ?

Mueller parle de Googlebot « pour la recherche ». Il existe d'autres bots Google : AdSense, AdWords, AdsBot, Google Images. Cette déclaration ne les concerne peut-être pas tous. Et qu'en est-il de Google Discover ou Google News, qui ont leurs propres systèmes de crawl ?

Deuxième nuance : le fait que Googlebot crawle depuis une seule localisation n'empêche pas Google de classer différemment les résultats selon la localisation de l'utilisateur. Le ranking est géolocalisé, pas le crawl. C'est un point que beaucoup confondent encore.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Si vous utilisez des hreflang et des URLs distinctes par pays/langue, vous n'êtes pas touché. Chaque URL est crawlée indépendamment, peu importe d'où vient le bot.

En revanche, si vous changez le contenu d'une même URL selon l'IP, vous êtes directement concerné. Et c'est précisément là que beaucoup de sites internationaux se plantent : ils pensent que Google « sait » qu'ils affichent un contenu différent selon le pays. Non. Google indexe ce qu'il voit depuis la Californie, point.

Impact pratique et recommandations

Que faut-il faire concrètement si votre site affiche du contenu géolocalisé ?

Première urgence : identifiez ce que Googlebot voit réellement. Testez votre site depuis une IP américaine (VPN, proxy, serveur cloud US). Comparez avec ce que voient vos utilisateurs français, britanniques, etc.

Si le contenu diffère significativement — prix, disponibilité produit, langue — vous avez un problème d'indexation. Googlebot indexe la version US, vos utilisateurs européens ne trouveront pas ce qu'ils cherchent dans les résultats.

Quelles erreurs éviter absolument ?

Ne vous reposez jamais sur la détection d'IP côté serveur sans URLs distinctes. C'est la cause principale de contenus non-indexés ou mal indexés pour les audiences internationales.

Évitez aussi de bloquer ou rediriger automatiquement Googlebot selon sa localisation détectée. Si vous le redirigez vers une version régionale, assurez-vous que cette redirection est cohérente avec vos hreflang et votre structure d'URLs.

Comment restructurer votre architecture internationale pour être conforme ?

La solution la plus sûre : des URLs distinctes par pays ou langue. Sous-domaines (fr.example.com), sous-répertoires (/fr/), ou domaines nationaux (.fr, .co.uk). Chaque URL sert une version unique, crawlable et indexable indépendamment.

Complétez avec des balises hreflang pour indiquer à Google les relations entre versions linguistiques ou régionales. Ainsi, même si Googlebot crawle depuis la Californie, il comprend qu'une version .fr existe pour les utilisateurs français.

- Testez votre site depuis une IP américaine pour voir ce que Googlebot indexe réellement

- Identifiez les contenus géolocalisés qui varient selon l'IP de l'utilisateur

- Passez à une structure avec URLs distinctes par pays/langue si ce n'est pas déjà fait

- Implémentez correctement les balises hreflang pour chaque version régionale

- Vérifiez dans Search Console que toutes vos versions internationales sont bien indexées

- Évitez les redirections automatiques basées uniquement sur l'IP détectée de Googlebot

- Documentez dans vos logs serveur d'où proviennent réellement les crawls de Googlebot

❓ Questions frequentes

Googlebot crawle-t-il depuis d'autres pays que les États-Unis ?

Si j'affiche des prix différents selon le pays de l'utilisateur, lesquels seront indexés ?

Les balises hreflang suffisent-elles si je sers du contenu géolocalisé dynamiquement ?

Comment vérifier ce que Googlebot voit réellement sur mon site ?

Cette règle s'applique-t-elle aussi à Google Images ou Google News ?

🎥 De la même vidéo 29

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.