Declaration officielle

Autres déclarations de cette vidéo 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

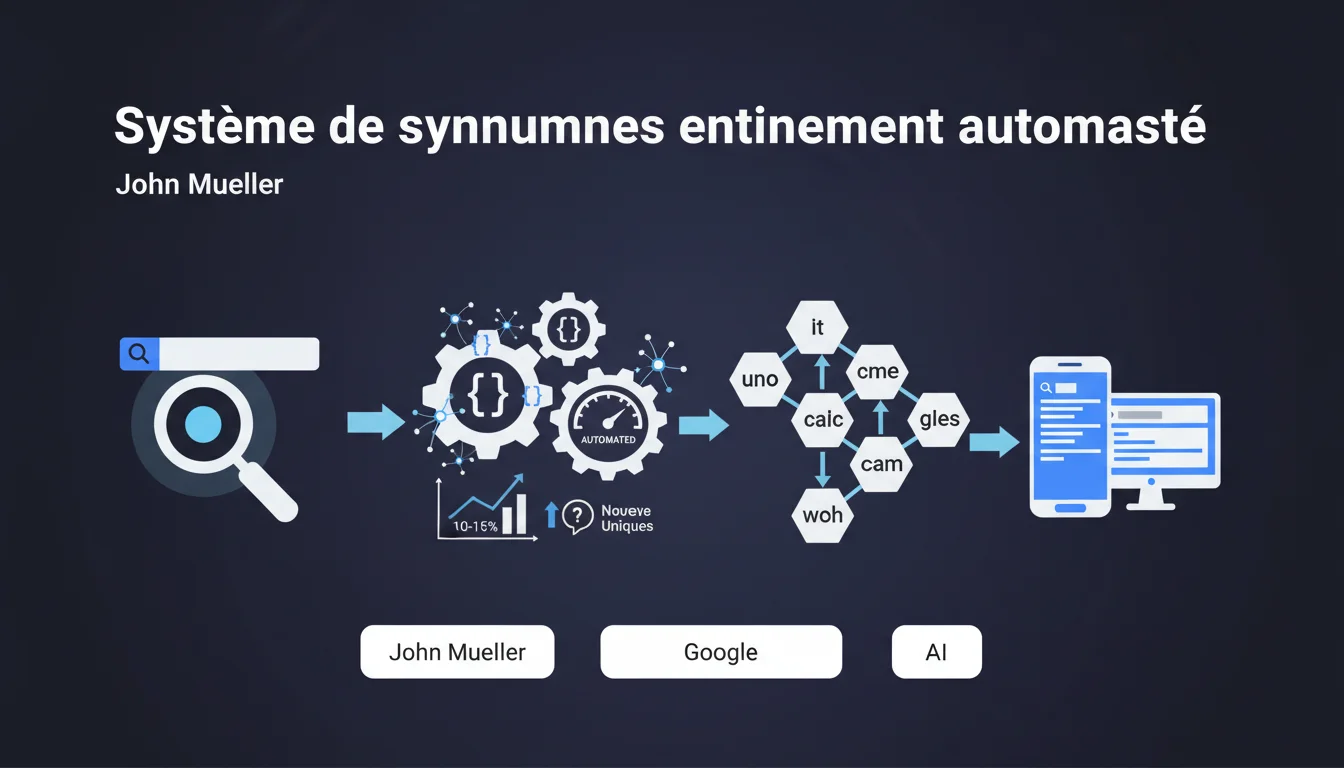

Google affirme que son système de synonymes est 100% automatisé, sans aucune gestion manuelle de listes. La raison ? 10 à 15% des requêtes quotidiennes sont inédites, rendant impossible toute intervention humaine à cette échelle. Le machine learning fait tout le travail.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur l'automatisation totale ?

La déclaration de Mueller casse un mythe tenace : non, il n'y a pas d'équipe chez Google qui compile des synonymes manuellement dans des fichiers Excel. L'échelle du problème rend cette approche obsolète.

Avec 10 à 15% de requêtes totalement nouvelles chaque jour — soit des millions de combinaisons jamais vues — aucune curation humaine ne tiendrait la cadence. Le système doit apprendre en continu, identifier les patterns sémantiques et les appliquer en temps réel.

Comment ce système automatisé impacte-t-il l'interprétation des requêtes ?

Le moteur ne se contente pas de remplacer un mot par un autre. Il analyse le contexte de la recherche, l'historique utilisateur, les co-occurrences dans les documents indexés. Une requête pour "voiture" peut déclencher des résultats pour "automobile", mais aussi "véhicule", "auto", voire des marques si le contexte l'indique.

Cette flexibilité explique pourquoi deux utilisateurs tapant la même requête obtiennent parfois des résultats légèrement différents : le système ajuste en fonction des signaux comportementaux.

Quelles sont les limites de ce système automatisé ?

Un algorithme apprend de ce qu'il observe. Si un terme émerge dans un nouveau contexte ou une niche ultra-spécialisée, le système peut mettre du temps à capter la nuance. Les professionnels observent régulièrement des approximations douteuses, surtout sur le vocabulaire technique ou les néologismes.

- Le système de synonymes fonctionne sans intervention humaine

- 10 à 15% des requêtes quotidiennes sont totalement inédites

- Le machine learning analyse contexte et patterns sémantiques

- Les résultats peuvent varier selon l'utilisateur et son historique

- Les termes de niche ou nouveaux peuvent être mal interprétés temporairement

Avis d'un expert SEO

Cette déclaration colle-t-elle avec ce qu'on observe sur le terrain ?

Globalement, oui. Les tests montrent que Google comprend effectivement les variations sémantiques sans qu'on ait besoin de répéter mécaniquement chaque synonyme 50 fois dans un texte. Bourrer une page de "voiture, automobile, véhicule, auto" à chaque paragraphe ne sert strictement à rien.

Par contre — et c'est là que ça coince — on constate encore des incohérences sur certains termes. Des synonymes évidents dans un domaine ne sont pas toujours captés, surtout si le volume de recherche est faible. Le système apprend des données massives, pas des cas particuliers. [À vérifier] dans quelle mesure Google pondère les synonymes selon leur fréquence d'usage globale versus leur pertinence contextuelle.

Quelles nuances faut-il apporter à ce discours officiel ?

Mueller dit "entièrement automatisé", mais ça n'exclut pas des ajustements manuels ponctuels sur des requêtes sensibles ou problématiques. On sait que Google intervient manuellement sur certains résultats (médical, finance, élections). Difficile de croire qu'aucun ingénieur ne corrige jamais une interprétation foireuse qui tournerait en boucle.

L'autre point : dire que le système "apprend automatiquement" via machine learning, c'est vague. Apprend-il uniquement des données de recherche ? Des clics ? Du contenu crawlé ? Des retours utilisateurs ? On n'a aucune visibilité sur les sources d'entraînement du modèle.

Dans quels cas ce système montre-t-il ses limites ?

Sur les termes polysémiques, d'abord. "Souris" peut désigner l'animal ou le périphérique — Google se débrouille bien, mais pas toujours parfaitement selon le contexte de la page. Les SEO dans des secteurs avec un jargon très spécifique (médical, juridique, technique) constatent régulièrement des approximations.

Ensuite, sur les nouveaux concepts. Quand un terme émerge (nouveau produit, tendance, événement), le système met du temps à établir le réseau de synonymes associé. Pendant cette période, optimiser uniquement sur le terme exact peut encore faire la différence.

Impact pratique et recommandations

Faut-il encore optimiser pour les synonymes ou laisser Google gérer ?

Les deux. Google capte les variations évidentes, donc inutile de saupoudrer mécaniquement "chaussures, souliers, godasses" partout. Ça sent le spam et ça n'apporte rien.

En revanche, utiliser naturellement le champ lexical de votre sujet reste fondamental. Pas pour manipuler l'algo, mais pour prouver que vous maîtrisez le domaine. Un contenu riche en vocabulaire pertinent signale une expertise — et ça, ça compte.

Quelles erreurs éviter avec ce système automatisé ?

Première erreur : croire qu'on peut se limiter à un seul mot-clé par page. Si vous écrivez sur les "vélos électriques" en ne mentionnant jamais "VAE", "assistance électrique", "batterie", "moteur", votre profondeur sémantique est nulle. Google comprendra peut-être le synonyme, mais votre contenu restera superficiel.

Deuxième erreur : sur-optimiser pour des synonymes que Google ne reconnaît pas encore. Certains outils SEO suggèrent des dizaines de "variations" qui sont en réalité des termes distincts avec leur propre intention de recherche. Forcer leur intégration crée de la confusion.

Comment vérifier que Google interprète correctement vos contenus ?

Ouvrez la Search Console et analysez l'onglet "Performances". Regardez quelles requêtes déclenchent vos pages. Si vous optimisez pour "formation marketing digital" et que vous rankez aussi sur "cours marketing en ligne", "apprentissage webmarketing", c'est que le système fait son job.

Si vous ne ressortez que sur votre mot-clé exact, deux hypothèses : soit votre champ lexical est trop étroit, soit le sujet est tellement de niche que Google n'a pas assez de données pour établir les synonymes.

- Vérifiez dans Search Console les requêtes réelles qui déclenchent vos pages

- Enrichissez le vocabulaire naturellement, sans bourrage de mots-clés

- Testez l'interprétation de Google en cherchant vos synonymes principaux

- Ne forcez pas l'intégration de termes que l'algorithme ne relie pas encore

- Surveillez les approximations sur votre jargon métier et ajustez si nécessaire

- Priorisez la profondeur sémantique plutôt que la multiplication de variantes

❓ Questions frequentes

Google comprend-il tous les synonymes de mon secteur d'activité ?

Dois-je quand même utiliser des variantes de mots-clés dans mes contenus ?

Comment vérifier que Google associe bien mes synonymes à ma page ?

Le système de synonymes remplace-t-il complètement l'optimisation sémantique ?

Pourquoi certains de mes synonymes ne génèrent-ils aucun trafic ?

🎥 De la même vidéo 29

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.