Declaration officielle

Autres déclarations de cette vidéo 29 ▾

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

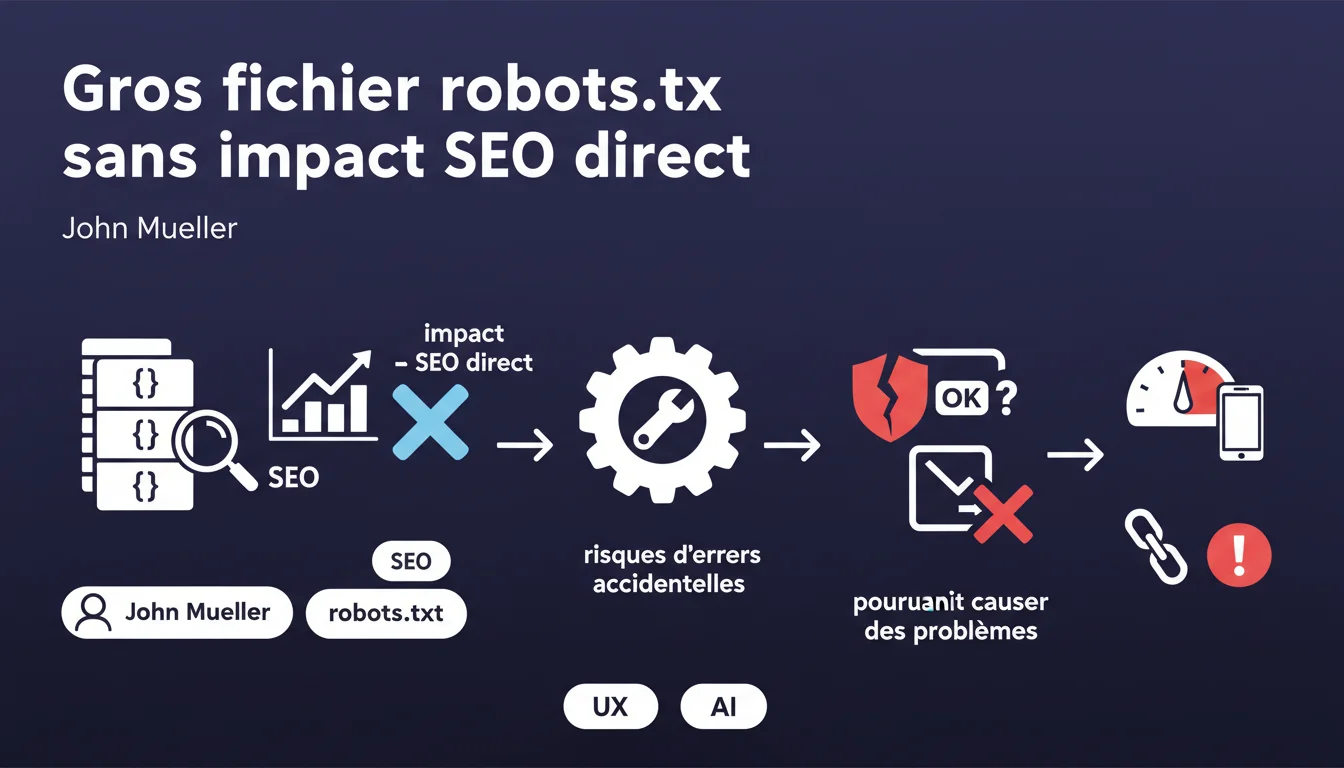

Google affirme qu'un fichier robots.txt dépassant les 1500 lignes n'a aucun impact SEO négatif direct. Le vrai danger ? La complexité de maintenance qui multiplie les risques d'erreurs catastrophiques — blocage accidentel de sections entières, désindexation imprévue.

Ce qu'il faut comprendre

Pourquoi Google dédramatise-t-il les fichiers robots.txt surchargés ?

La position de Mueller est claire : aucune pénalité algorithmique n'est appliquée sur un robots.txt volumineux. Googlebot traite ce fichier comme une simple liste d'instructions — qu'elle fasse 50 ou 5000 lignes ne change rien à sa capacité technique à l'interpréter.

Ce n'est pas un facteur de ranking. Ni un signal de qualité. C'est un fichier de configuration, point. La taille n'entre pas dans l'équation du crawl budget de manière directe — contrairement à ce qu'on lit parfois.

Où se situe le vrai problème selon Mueller ?

Le risque est humain, pas technique. Plus le fichier grossit, plus la probabilité d'erreur explose : syntaxe bancale, directives contradictoires, wildcards mal placés. Un seul caractère de travers peut bloquer des pans entiers de votre site.

Mueller pointe la maintenance. Un fichier de 1500 lignes devient vite ingérable sans documentation rigoureuse. Les équipes se succèdent, les règles s'accumulent, personne ne sait plus pourquoi telle section est bloquée depuis 2019.

Quelles sont les limites techniques à connaître ?

Google impose une taille maximale de 500 ko pour le robots.txt — au-delà, seule cette portion sera lue. En pratique, 1500 lignes représentent environ 50-80 ko selon la verbosité. Vous avez de la marge, mais ce n'est pas infini.

Il existe aussi une limite de 500 000 caractères après décompression. Rares sont les sites qui atteignent ce seuil, mais les plateformes massives avec des milliers de sous-domaines peuvent s'en approcher.

- Pas d'impact SEO direct lié au nombre de lignes du robots.txt

- La taille maximale traitée par Google est de 500 ko

- Le risque principal : erreurs humaines lors de la maintenance

- Un fichier complexe ralentit les audits et les interventions d'urgence

- Les directives contradictoires ou mal formulées créent des blocages imprévus

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui et non. Sur le principe, Mueller a raison : je n'ai jamais vu un site perdre du trafic uniquement parce que son robots.txt était long. Les cas de chute brutale sont toujours liés à une erreur de directive — pas à la volumétrie.

Par contre, la déclaration esquive un point crucial : la lisibilité du fichier impacte le délai de réaction. Face à une baisse soudaine, un robots.txt de 2000 lignes ralentit le diagnostic. Ce n'est pas du SEO technique pur, mais ça a des conséquences réelles sur la performance globale.

Quelles nuances faut-il apporter à cette position ?

Mueller parle d'impact SEO « direct ». C'est le mot-clé. Indirectement, un fichier obèse peut créer des dérives organisationnelles : duplication de règles, oubli de nettoyage après refonte, surcharge cognitive pour les équipes techniques.

Sur les très gros sites — e-commerce avec centaines de milliers de pages, plateformes multi-langues — un robots.txt mal structuré peut camoufler des erreurs critiques pendant des mois. [À vérifier] : Google n'indique pas si le temps de parsing d'un fichier de 10 000 lignes impacte la fréquence de crawl sur d'autres ressources du même domaine.

Autre zone grise : les CDN et caches intermédiaires. Certains proxies limitent la taille des fichiers texte servis. Si votre robots.txt est tronqué avant d'atteindre Googlebot, vous êtes dans le brouillard.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre robots.txt dépasse la limite des 500 ko, Google coupe la lecture. Tout ce qui suit est ignoré — ce qui peut créer un chaos si des directives critiques sont en fin de fichier.

Les sites avec génération dynamique du robots.txt doivent faire attention : certains CMS ou frameworks compilent des règles à la volée. Si le script bug, vous pouvez vous retrouver avec un fichier vide ou inversement, un fichier monstrueux qui plante les crawlers tiers.

Impact pratique et recommandations

Que faut-il faire concrètement pour maîtriser son robots.txt ?

Première étape : auditer l'existant. Exportez votre robots.txt, analysez chaque directive, supprimez tout ce qui est obsolète. La plupart des fichiers volumineux sont bourrés de règles mortes — anciennes refontes, tests oubliés, sections supprimées il y a trois ans.

Ensuite, structurez par blocs commentés. Ajoutez des annotations claires : « Bloc crawlers tiers », « Sections admin », « Tests staging ». Ça facilite la lecture et réduit les risques de mauvaise manipulation.

Pour les sites complexes, envisagez un système de gestion en version (Git, par exemple). Chaque modification doit être tracée, commentée, validée. Ça paraît lourd, mais c'est la seule façon de garder le contrôle sur un fichier de 1000+ lignes.

Quelles erreurs éviter absolument ?

Ne jamais utiliser de wildcards (* ou $) sans les tester en profondeur. Un Disallow: /*? mal placé peut bloquer toutes vos URLs avec paramètres — adieu les fiches produits filtrées.

Évitez les directives redondantes. Si vous avez déjà un Disallow: /admin/, inutile d'ajouter quinze lignes pour bloquer chaque sous-répertoire. Ça alourdit pour rien et multiplie les points de friction.

Attention aux User-agent spécifiques. Certains bots ne respectent pas toutes les directives — documenter qui obéit à quoi devient vite un enfer. Privilégiez les règles génériques sauf besoin critique.

Comment vérifier que votre configuration est optimale ?

Utilisez la Search Console pour tester chaque directive. L'outil Inspection d'URL vous dit exactement si une page est bloquée par le robots.txt. Ne vous fiez pas à votre lecture humaine — une virgule de travers et tout bascule.

Mettez en place un monitoring automatisé. Alertez-vous si le fichier change de taille brutalement (signe d'une modif non planifiée) ou si des sections critiques sont bloquées par erreur.

Testez sur un environnement de staging avant toute mise en production. Un robots.txt modifié peut désindexer des milliers de pages en quelques heures — la prudence n'est pas optionnelle.

- Auditer et nettoyer le robots.txt existant : supprimer les directives obsolètes

- Structurer par blocs commentés pour faciliter la lecture et la maintenance

- Versionner le fichier (Git) pour tracer toutes les modifications

- Tester chaque wildcard en environnement de staging avant mise en prod

- Utiliser l'outil de test robots.txt de la Search Console systématiquement

- Mettre en place des alertes sur les changements de taille du fichier

- Documenter chaque directive : pourquoi elle existe, quel problème elle résout

- Préférer les règles génériques aux directives ultra-spécifiques

❓ Questions frequentes

Est-ce que Google crawle moins souvent un site avec un gros robots.txt ?

Quelle est la limite maximale pour un fichier robots.txt ?

Faut-il créer plusieurs fichiers robots.txt pour alléger ?

Un changement dans le robots.txt est-il pris en compte immédiatement ?

Dois-je bloquer les crawlers tiers dans mon robots.txt ?

🎥 De la même vidéo 29

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.