Declaration officielle

Autres déclarations de cette vidéo 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il vraiment utiliser le fichier Disavow uniquement pour les liens achetés ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

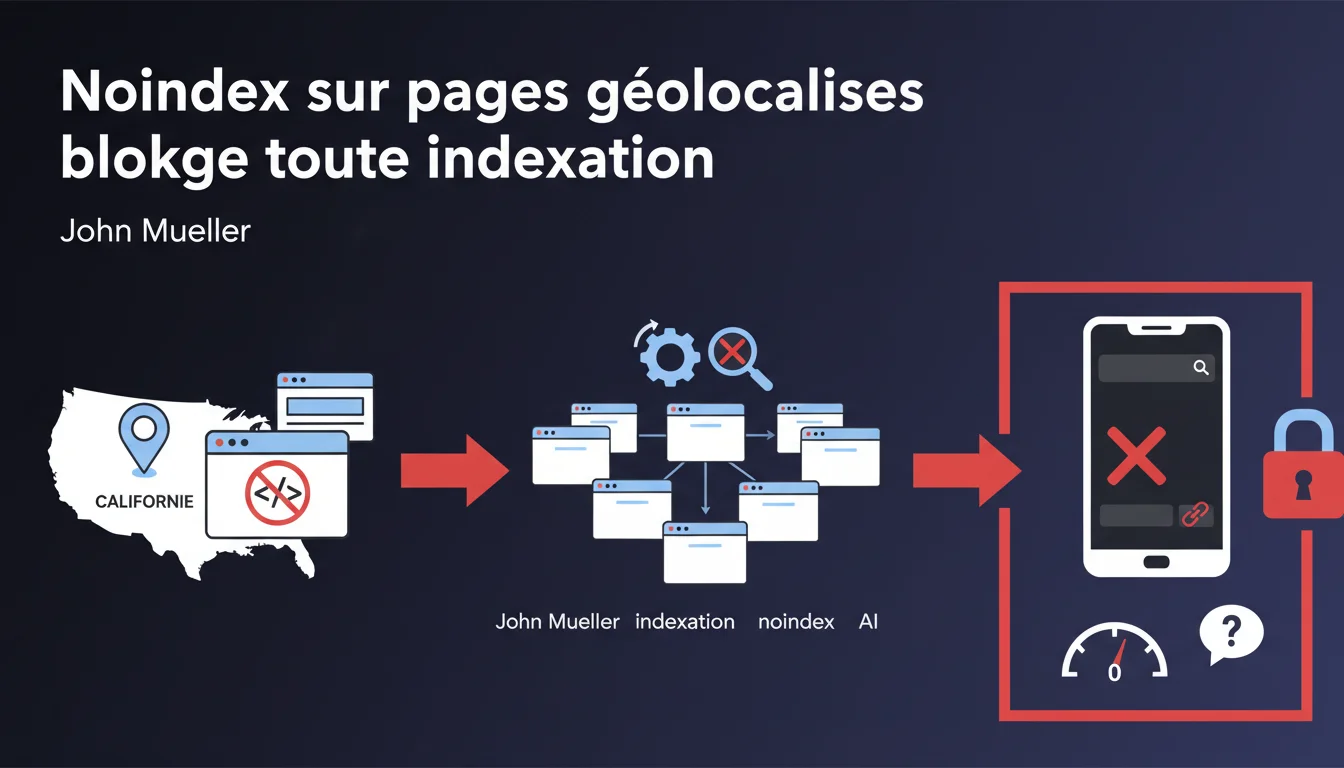

Ajouter une balise noindex sur des pages de destination géolocalisées peut entraîner la désindexation complète d'un site si ces pages sont servies comme page d'accueil selon la localisation de l'utilisateur. Google traite la page servie à l'URL racine comme la véritable homepage, même si elle varie selon la géolocalisation. Concrètement : si votre homepage affiche du contenu différent par état et qu'une version porte un noindex, c'est toute votre présence dans les SERP qui peut s'effondrer.

Ce qu'il faut comprendre

Pourquoi une balise noindex sur une page géolocalisée affecterait-elle la homepage ?

Le mécanisme est plus vicieux qu'il n'y paraît. Quand vous créez des pages de destination régionales (par état, par ville, par pays), vous implémentez généralement une redirection ou un affichage conditionnel basé sur l'IP ou les préférences utilisateur. Si un visiteur californien accède à votre domaine.com, il voit en réalité le contenu de votre page Californie — mais à l'URL racine.

Google crawle depuis différentes localisations et IPs. Si Googlebot accède à votre site depuis une IP californienne et reçoit la version Californie avec un noindex dans le header, il interprète cette instruction comme s'appliquant à l'URL qu'il crawle : votre homepage. Résultat ? Désindexation complète du site.

Comment Google détermine-t-il quelle version d'une page géolocalisée indexer ?

Google ne se soucie pas de votre architecture backend. Ce qui compte, c'est ce qui est servi à une URL donnée au moment du crawl. Si domain.com retourne du contenu variable selon la géolocalisation sans URLs distinctes (comme domain.com/us/, domain.com/ca/), vous créez techniquement plusieurs versions d'une même URL.

Le crawler ne peut pas deviner quelle version est « principale ». Il indexe ce qu'il voit. Et si ce qu'il voit porte une directive noindex, il applique la règle sans se poser de questions. C'est aussi simple — et aussi brutal — que ça.

Quels sont les signaux que ce problème touche votre site ?

- Chute brutale de la visibilité organique sans changement apparent du contenu principal

- Search Console affiche « Exclue par la balise noindex » pour la homepage ou des URLs clés

- Le rapport de couverture montre une désindexation massive des pages stratégiques

- Les pages géolocalisées elles-mêmes ne génèrent aucun trafic organique malgré leur optimisation

- Les tests avec différents VPN ou localisations révèlent des directives d'indexation contradictoires selon l'IP source

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. J'ai vu ce scénario se produire trois fois sur des sites e-commerce internationaux entre 2019 et 2023. Dans deux cas, la désindexation était partielle — seules certaines versions régionales disparaissaient. Dans le troisième, catastrophe totale : 90% du trafic organique évaporé en 72 heures parce que la version UK (marché principal) portait un noindex accidentel.

Ce qui surprend, c'est la rapidité de propagation. Google ne laisse pas 15 jours de grâce. Dès que Googlebot recrawle l'URL avec le noindex, l'instruction est appliquée. Certains pensent qu'un site « établi » bénéficie d'une certaine inertie. Faux. Le noindex est une directive, pas une suggestion — et Google l'exécute sans état d'âme.

Quelles nuances faut-il apporter à cette affirmation de Mueller ?

Mueller simplifie volontairement. Il ne précise pas si ce comportement s'applique uniquement aux redirections 302 temporaires, aux rewrites serveur, ou aussi aux solutions JavaScript côté client. [À vérifier] : est-ce que du contenu géolocalisé chargé en JS après le premier paint échappe à cette règle ? Probablement pas si le rendering détecte le noindex, mais la documentation officielle reste floue.

Autre point : Mueller parle de « pages de destination par état » avec un noindex. Pourquoi diable voudrait-on noindexer ces pages ? Soit pour éviter le duplicate content (mauvaise stratégie), soit parce qu'elles sont en construction (erreur de process). Dans les deux cas, le problème réel n'est pas technique — c'est une incompréhension fondamentale de l'architecture SEO internationale.

Dans quels cas cette règle ne pose-t-elle aucun problème ?

Si vous utilisez des URLs distinctes avec hreflang correctement implémenté (/fr/, /de/, /us/), chaque version est une entité indépendante. Vous pouvez noindexer /us/ sans toucher /fr/. Google comprend la structure, et le risque de contamination croisée disparaît.

Idem si vous servez une homepage unique neutre (sélecteur de langue/pays) et que les versions géolocalisées vivent sur des sous-répertoires ou sous-domaines dédiés. Là, pas d'ambiguïté : l'URL racine reste stable, indexable, et les variantes régionales sont clairement séparées.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter ce piège ?

D'abord, auditer immédiatement votre implémentation de géolocalisation. Utilisez un VPN ou un proxy pour tester l'accès à votre homepage depuis différentes localisations (USA, UK, France, Allemagne, Australie). Inspectez les headers HTTP et le code source renvoyés pour chaque géo. Cherchez toute trace de noindex dans les meta robots ou les X-Robots-Tag.

Ensuite, si vous détectez des directives noindex variables selon la localisation, il faut refondre l'architecture. Soit vous passez sur des URLs distinctes avec hreflang (solution recommandée pour l'international), soit vous abandonnez le noindex et vous gérez le duplicate autrement (canonical, contenu suffisamment différencié).

Quelles erreurs éviter absolument dans la gestion des pages géolocalisées ?

- Ne jamais appliquer un noindex « par défaut » sur des pages régionales pour « nettoyer l'index » — c'est la méthode suicide

- Ne pas confier la géolocalisation à un plugin ou service tiers sans comprendre son fonctionnement technique exact

- Ne jamais supposer que Google crawle uniquement depuis les USA — il utilise des IPs multiples, y compris européennes et asiatiques

- Éviter les redirections 302 géolocalisées vers la homepage avec du contenu variable — préférer des sous-répertoires stables

- Ne pas oublier de tester Search Console avec différents domaines de propriété si vous utilisez des ccTLDs

Comment vérifier que votre site est conforme et protégé ?

Mettez en place un monitoring quotidien de vos URLs stratégiques dans Search Console. Surveillez spécifiquement le statut d'indexation de la homepage et des principales landing pages régionales. Toute apparition de « Exclue par la balise noindex » doit déclencher une alerte immédiate.

Utilisez un outil de crawl (Screaming Frog, Oncrawl, Botify) configuré pour simuler des crawls depuis différentes IPs ou avec différents user-agents. Comparez les headers et directives retournés. Si vous constatez des incohérences, c'est que votre implémentation pose problème.

Le noindex sur pages géolocalisées est un piège méconnu qui peut anéantir votre visibilité organique en quelques heures. La solution passe par une architecture claire avec URLs distinctes, un hreflang rigoureux, et un monitoring permanent des directives d'indexation.

Ces configurations techniques exigent une expertise pointue en SEO international et en architecture serveur. Si votre stack technologique repose sur du routage dynamique, du edge computing ou des solutions de personnalisation avancées, l'accompagnement d'une agence SEO rompue aux problématiques d'indexation multilingue peut vous éviter des erreurs coûteuses et sécuriser durablement votre présence dans les SERP.

❓ Questions frequentes

Puis-je utiliser un noindex temporaire sur des pages géolocalisées en construction ?

Le hreflang suffit-il à éviter les problèmes de noindex sur pages géolocalisées ?

Comment Google choisit-il quelle version géolocalisée crawler ?

Un CDN avec routage géographique pose-t-il les mêmes risques ?

Que faire si mon site a déjà été désindexé à cause de ce problème ?

🎥 De la même vidéo 29

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.