Official statement

Other statements from this video 29 ▾

- □ Un fichier robots.txt volumineux pénalise-t-il vraiment votre SEO ?

- □ Soumettre son sitemap dans robots.txt ou Search Console : y a-t-il vraiment une différence ?

- □ Les balises H1-H6 ont-elles encore un impact réel sur le classement Google ?

- □ Faut-il vraiment respecter une hiérarchie stricte des balises Hn pour le SEO ?

- □ Combien de temps faut-il réellement pour qu'une migration de domaine soit prise en compte par Google ?

- □ Une migration de site peut-elle vraiment booster votre SEO ou tout faire planter ?

- □ Googlebot crawle-t-il vraiment depuis un seul endroit pour indexer vos contenus géolocalisés ?

- □ Le noindex sur pages géolocalisées peut-il faire disparaître tout votre site des résultats Google ?

- □ Faut-il vraiment abandonner les redirections géolocalisées pour une simple bannière ?

- □ Faut-il créer des pages de destination pour chaque ville ou se limiter aux régions ?

- □ Faut-il rediriger les utilisateurs mobiles vers votre application mobile ?

- □ Faut-il vraiment traduire mot pour mot ses pages pour que le hreflang fonctionne ?

- □ Fichier Disavow : pourquoi la directive domaine permet-elle de contourner la limite de 2MB ?

- □ Faut-il mettre en noindex ses pages de résultats de recherche interne pour bloquer les backlinks spam ?

- □ Le HTML sémantique booste-t-il vraiment votre référencement naturel ?

- □ AMP est-il encore un critère de ranking dans Google Search ?

- □ AMP est-il vraiment un facteur de classement pour Google ?

- □ Supprimer AMP boost-t-il le crawl de vos pages classiques ?

- □ Faut-il tester la suppression de son fichier Disavow de manière incrémentale ?

- □ Pourquoi les panels de connaissance s'affichent-ils différemment selon les appareils ?

- □ Le système de synonymes de Google fonctionne-t-il vraiment sans intervention humaine ?

- □ Faut-il vraiment créer une page distincte par localisation pour le schema Local Business ?

- □ Faut-il vraiment marquer TOUT son contenu en données structurées ?

- □ Faut-il vraiment afficher toutes les questions du schema FAQ sur la page ?

- □ Le contenu masqué dans les accordéons peut-il vraiment apparaître dans les featured snippets ?

- □ Pourquoi Google ne veut-il pas indexer l'intégralité de votre site web ?

- □ Faut-il supprimer des pages pour améliorer l'indexation de son site ?

- □ Le volume de recherche des ancres influence-t-il vraiment la valeur d'un lien interne ?

- □ Faut-il vraiment ajouter du contenu unique sur vos pages produit en e-commerce ?

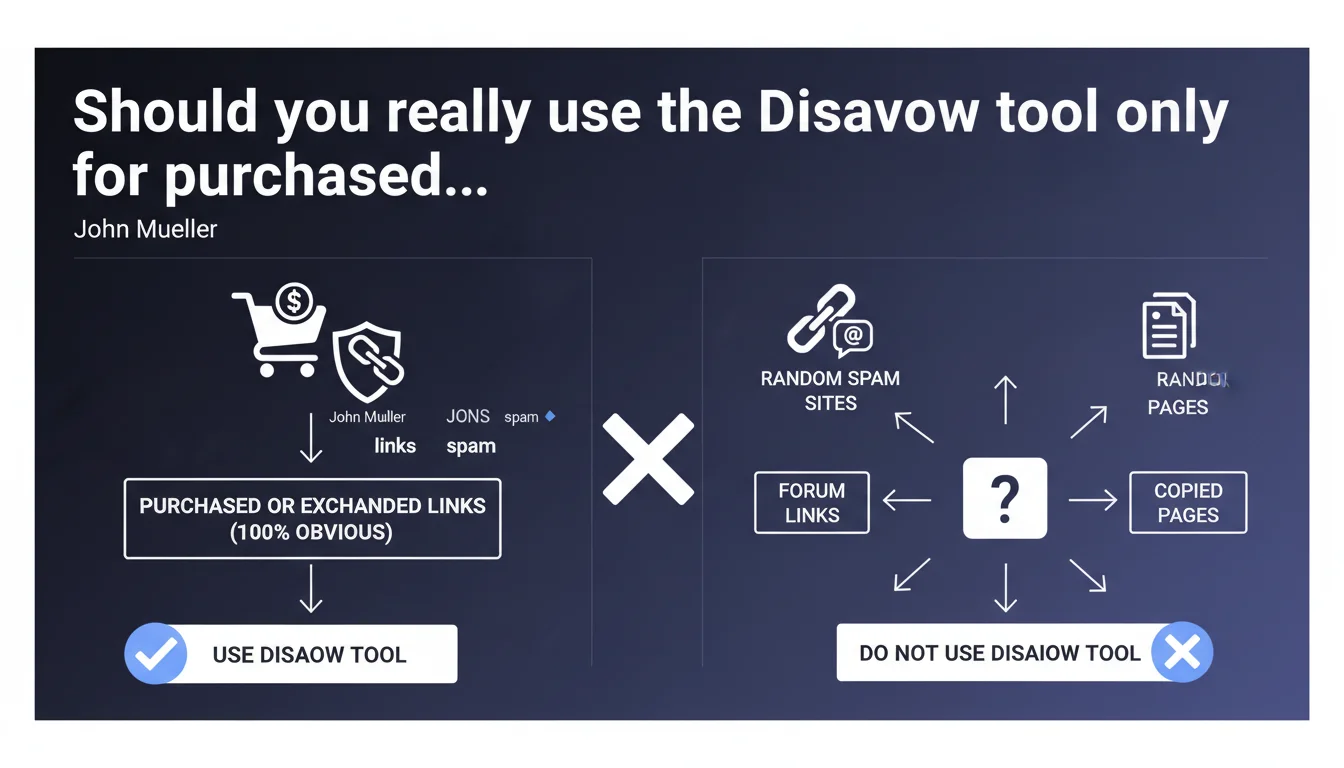

Google recommends limiting Disavow file usage to clearly purchased or exchanged links with absolute certainty. Random spam links, forum comments, or copied pages don't need to be disavowed — the algorithm knows how to ignore them.

What you need to understand

Why does Google restrict the use of the Disavow Tool?

Mueller's position is clear: the Disavow file is not a spam link vacuum cleaner. Google claims its algorithm already filters out the majority of spam links without manual intervention.

The underlying message? Disavowing indiscriminately risks doing more harm than good. By declaring natural links as spam, you can weaken your backlink profile without valid reason. Google wants to prevent SEOs from panicking and shooting themselves in the foot.

What does "100% obvious" mean in practice?

Mueller insists on absolute certainty. No gray area. A purchased link is one you have proof of: money exchanged, documented agreement, formalized service exchange.

A link from a sketchy directory or spam comment doesn't fall into this category — even if it smells bad. Google says it can handle that on its own. The question then becomes: do we trust them?

What does Google consider a "random" link to ignore?

The examples given are revealing: forums, copied pages, generic spam sites. These are links Google detects algorithmically as worthless.

Concretely, if you find your URL on 50 Russian video streaming sites without asking for anything, don't panic. Google claims to neutralize them automatically.

- Only use Disavow for documented purchased links

- Random spam links are supposed to be filtered by the algorithm

- Certainty must be absolute, not mere suspicion

- Excessive Disavow usage can weaken your link profile

- Google wants to limit "false positives" on the webmaster side

SEO Expert opinion

Is this position consistent with real-world observations?

Let's be honest: Google's theory doesn't always match reality. We've seen sites penalized by negative SEO campaigns, where thousands of toxic links caused rankings to plummet.

In those cases, mass disavowing sometimes helped recover traffic. So either Google is lying, or its algorithm has blind spots. [To verify] the actual capacity of the algorithm to ignore 100% of toxic links without intervention.

What nuances should be added to this recommendation?

The "100% obvious" line is fuzzy. A link exchange between two thematic sites with no money involved — is that a purchase? Technically no. But Google might view it as manipulation.

And what about old borderline SEO practices? Does a site acquisition with a questionable history deserve preventive cleanup? Mueller doesn't say. We're flying blind.

In what cases does this rule not apply?

First obvious case: active manual action. There, you have no choice — you must disavow anything that looks remotely like a manipulated link.

Second case: you inherit a site with a catastrophic backlink profile (detectable PBNs, over-optimized anchors). Waiting for Google to "handle it" could take months. Proactive cleanup can speed up recovery.

Practical impact and recommendations

What should you concretely do with your Disavow file?

If you have a Disavow file stuffed with hundreds of suspicious domains, don't empty it all at once. Google recommends caution, not a clean slate.

Analyze each entry: keep only links you're CERTAIN violate the guidelines (proof of purchase, tracked exchanges). For the rest, let Google do its job.

What mistakes should you absolutely avoid?

Don't disavow as a precaution. That's the worst practice. You risk cutting off natural links that positively contribute to your authority.

Also avoid disavowing entire domains without fine analysis. Sometimes a mixed site has a few spam links but also legitimate content that naturally cites you. Disavow at the URL level, not the domain level, except in extreme cases.

How to effectively audit your backlink profile?

Start with Search Console: identify abnormal spikes of new links. Check for over-optimized anchors (e.g., "cheap shoes Paris" on repeat).

Cross-reference with a third-party tool (Ahrefs, Majestic, SEMrush) to detect suspicious patterns: expired domains, identifiable blog networks, sitewide footer links.

- Audit your backlink profile at least every 3-6 months

- Keep in Disavow ONLY documented purchased links

- If you have doubt, DON'T add the link to the file

- Monitor abnormal spikes of incoming links (potential negative SEO)

- If a manual action occurs, prepare an exhaustive Disavow with documentation

- Document each disavowed link (date, reason, proof) for your internal tracking

❓ Frequently Asked Questions

Dois-je désavouer les liens provenant de commentaires spam sur des forums ?

Comment prouver qu'un lien a été acheté pour le désavouer ?

Le fichier Disavow peut-il nuire à mon SEO si je l'utilise mal ?

Que faire si je subis une attaque de negative SEO avec des milliers de liens pourris ?

Faut-il supprimer les anciens liens de mon fichier Disavow ?

🎥 From the same video 29

Other SEO insights extracted from this same Google Search Central video · published on 14/01/2022

🎥 Watch the full video on YouTube →

💬 Comments (0)

Be the first to comment.