Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Google accorde-t-il vraiment un traitement de faveur aux nouvelles pages d'accueil ?

- □ Google privilégie-t-il vraiment les pages de qualité dans son crawl ?

- □ Googlebot est-il vraiment stupide ou Google cache-t-il quelque chose ?

- □ La qualité d'une page détermine-t-elle vraiment le crawl des pages suivantes ?

- □ Google peut-il vraiment pénaliser certaines sections de votre site en fonction de leur qualité ?

- □ Faut-il vraiment déplacer le contenu UGC de faible qualité pour améliorer le crawl ?

- □ La fréquence de mise à jour influence-t-elle vraiment le crawl de vos pages ?

- □ Google filtre-t-il vraiment certains sujets lors du crawl et de l'indexation ?

- □ Pourquoi Google refuse-t-il d'indexer un contenu qu'il a pourtant crawlé ?

- □ Le contenu dupliqué est-il vraiment sans danger pour votre SEO ?

- □ Les liens d'affiliation peuvent-ils coexister avec une stratégie SEO de qualité ?

- □ Faut-il vraiment faire relire vos traductions automatiques par des humains ?

- □ Pourquoi Google privilégie-t-il les liens depuis des « sites normaux » pour évaluer votre importance ?

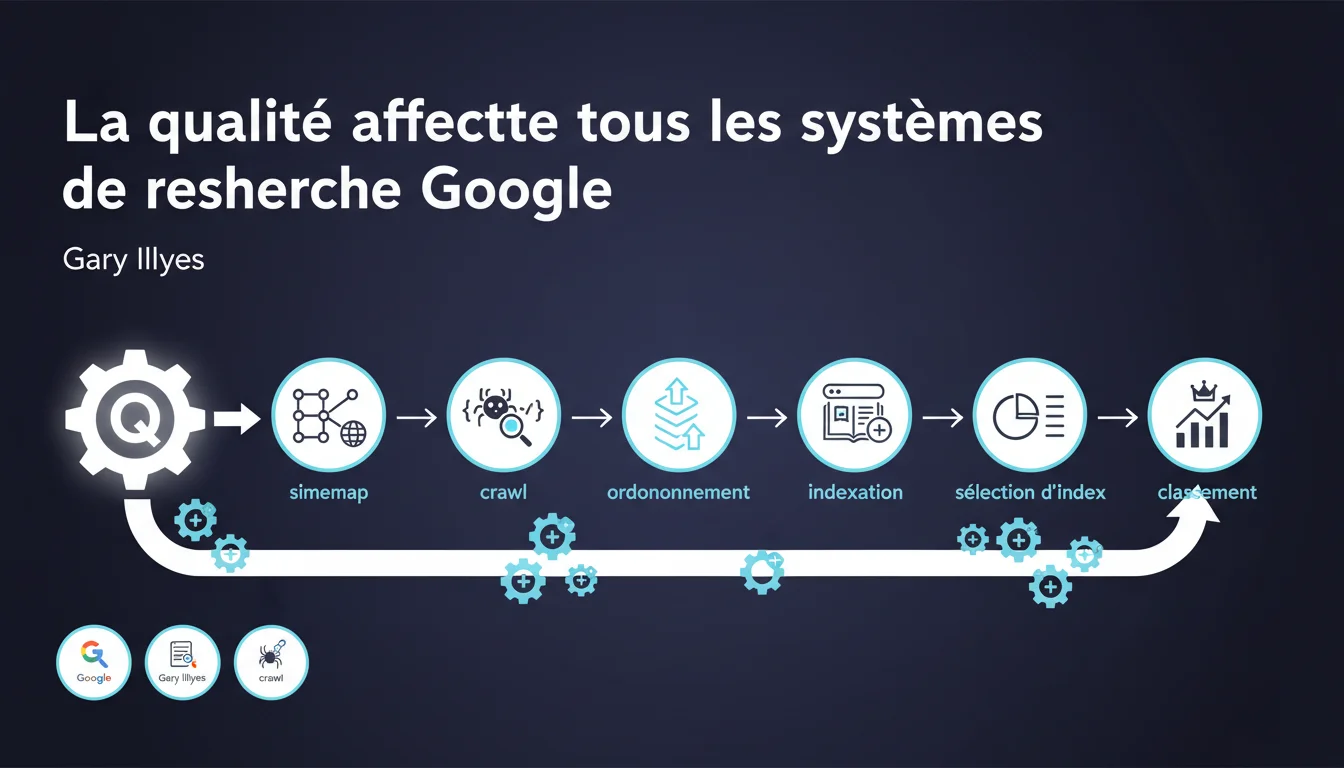

Gary Illyes affirme que la qualité du contenu impacte l'ensemble des systèmes de recherche Google — du crawl au classement, en passant par l'indexation et la sélection d'index. Chaque système utilise ce signal de qualité différemment, mais aucun ne l'ignore. Pour les praticiens SEO, cela signifie qu'un contenu de faible qualité peut être pénalisé bien avant d'atteindre les pages de résultats.

Ce qu'il faut comprendre

Google parle de « qualité » : de quoi s'agit-il exactement ?

La déclaration de Gary Illyes reste délibérément floue sur la définition de la qualité du contenu. On comprend qu'il s'agit d'un signal composite — pas d'une métrique unique — qui traverse l'ensemble des couches techniques de la recherche Google.

Ce qui frappe ici, c'est l'ampleur du périmètre : les sitemaps, le crawl, l'ordonnancement, l'indexation, la sélection d'index et enfin le classement. Autrement dit, un contenu jugé de faible qualité peut être désavantagé dès les premières étapes du pipeline, bien avant qu'il ne soit question de ranking.

Pourquoi cette déclaration est-elle importante pour les praticiens ?

Parce qu'elle remet en question l'idée reçue selon laquelle la qualité n'intervient qu'au moment du classement. Si un contenu est jugé faible en amont, il peut ne jamais être indexé, ou être relégué dans un index secondaire rarement consulté.

Concrètement, cela explique pourquoi certains sites voient leurs pages crawlées mais jamais classées, ou pourquoi des contenus similaires — techniquement optimisés — obtiennent des traitements radicalement différents. Le signal de qualité agit comme un filtre à plusieurs niveaux.

Quels sont les systèmes de recherche concernés ?

- Sitemaps : Google pourrait prioriser le crawl des URL issues de sitemaps en fonction de la qualité historique du site.

- Crawl : Les ressources de crawl (crawl budget) sont allouées différemment selon la qualité perçue du contenu.

- Ordonnancement : Le tri et la hiérarchisation des URL à indexer dépendent aussi de ce signal.

- Indexation : Une page peut être crawlée mais écartée de l'index principal si elle est jugée de faible qualité.

- Sélection d'index : Google dispose de plusieurs index (principal, secondaire) et la qualité détermine où atterrit une page.

- Classement : Enfin, la qualité intervient dans les algorithmes de ranking, ce qui n'est pas nouveau mais désormais confirmé comme partie d'un continuum.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, mais avec des nuances importantes. Sur le terrain, on observe effectivement que certains sites de faible qualité voient leur crawl budget s'effondrer sans raison technique apparente. De même, des contenus parfaitement optimisés techniquement peuvent rester invisibles dans les SERP si le domaine a accumulé des signaux de faible qualité.

Cela dit, la déclaration de Gary Illyes reste évasive sur un point crucial : comment cette qualité est-elle mesurée à chaque étape ? Est-ce le même algorithme partout ? Des signaux différents selon la couche ? [A vérifier] — Google ne fournit aucune donnée concrète pour permettre aux praticiens de diagnostiquer précisément où leur contenu est filtré.

Quelles sont les limites de cette affirmation ?

Première limite : la circularité du raisonnement. Si la qualité affecte le crawl, l'indexation et le classement, comment un nouveau site — sans historique — peut-il être évalué avant même d'être crawlé ? Google doit nécessairement utiliser des signaux externes ou contextuels, mais lesquels ? Backlinks ? Autorité perçue du domaine ? Thématique ?

Deuxième limite : tous les contenus ne sont pas égaux. Un site e-commerce avec des milliers de fiches produits similaires peut être pénalisé pour « faible qualité » alors qu'il répond parfaitement aux attentes utilisateur. À l'inverse, un site d'actualité peut publier rapidement du contenu peu approfondi qui sera indexé et classé sans problème — parce que la fraîcheur prime sur la densité informative.

Faut-il revoir ses priorités SEO à la lumière de cette déclaration ?

Oui, mais sans tomber dans la sur-optimisation. L'enseignement principal, c'est qu'un travail isolé sur le on-page ou le maillage interne ne suffit plus si le contenu lui-même est jugé faible. Il faut remonter en amont : quelle valeur apporte réellement chaque page ? Peut-elle être consolidée, supprimée ou améliorée ?

Mais restons lucides : on ne peut pas mesurer directement ce « signal de qualité » utilisé par Google. On en observe les effets — baisse de crawl, non-indexation, chute de ranking — mais on ne peut pas le corriger avec certitude. Ce que l'on peut faire, c'est renforcer les signaux connus : E-E-A-T, engagement utilisateur, profondeur de contenu, mise à jour régulière. Le reste relève de l'expérimentation terrain.

Impact pratique et recommandations

Que faut-il faire concrètement pour améliorer la qualité perçue par Google ?

Première action : auditer l'ensemble du contenu existant. Utilise Google Search Console pour identifier les pages crawlées mais non indexées, ou celles indexées mais jamais classées. Ce sont tes premiers suspects. Pose-toi la question : ces pages apportent-elles une valeur unique, ou sont-elles des variations redondantes ?

Deuxième action : consolide ou supprime les contenus faibles. Si tu as des centaines de pages à faible trafic, peu de backlinks et aucun engagement, envisage de les fusionner en contenus plus complets ou de les désindexer via robots.txt ou noindex. Un site de 500 pages de haute qualité sera mieux traité qu'un site de 5000 pages médiocres.

Troisième action : renforce les signaux E-E-A-T sur les pages stratégiques. Ajoute des auteurs identifiés, des sources crédibles, des mises à jour régulières. Google ne révèle pas comment il mesure la qualité, mais on sait qu'il surveille ces signaux depuis plusieurs années.

Quelles erreurs éviter absolument ?

- Ne pas croire qu'un contenu techniquement parfait (balises, structure, vitesse) sera automatiquement bien classé si la qualité éditoriale est faible.

- Ne pas publier en masse sans évaluation qualitative — mieux vaut 10 pages solides par mois que 100 pages moyennes.

- Ne pas ignorer les pages "zombies" (crawlées mais invisibles) : elles consomment du crawl budget et diluent le signal de qualité global du site.

- Ne pas se focaliser uniquement sur le classement final — si ton contenu est filtré en amont (crawl, indexation), tu ne verras jamais le problème dans les SERP.

- Ne pas négliger l'expérience utilisateur réelle : temps passé, taux de rebond, interactions sont des proxies de qualité que Google peut mesurer indirectement.

Comment vérifier que mon site respecte ces exigences de qualité ?

Utilise Google Search Console pour surveiller les taux d'indexation. Si une proportion importante de tes URL est découverte mais non indexée, c'est un signal d'alarme. Croise ces données avec Google Analytics pour identifier les pages à faible engagement.

Lance un audit de contenu trimestriel : classe tes pages par performance (trafic, conversions, backlinks) et par qualité éditoriale subjective. Priorise l'amélioration des pages à fort potentiel mais faible performance, et envisage la suppression ou la consolidation des pages à faible potentiel.

❓ Questions frequentes

La qualité du contenu peut-elle vraiment affecter le crawl budget ?

Google utilise-t-il le même algorithme de qualité à chaque étape ?

Une page techniquement parfaite peut-elle être écartée pour faible qualité ?

Comment savoir si mon contenu est jugé de faible qualité par Google ?

Faut-il supprimer les pages à faible trafic pour améliorer la qualité globale du site ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 19/09/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.