Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ La qualité du contenu influence-t-elle vraiment tous les systèmes de classement Google ?

- □ Google accorde-t-il vraiment un traitement de faveur aux nouvelles pages d'accueil ?

- □ Google privilégie-t-il vraiment les pages de qualité dans son crawl ?

- □ Googlebot est-il vraiment stupide ou Google cache-t-il quelque chose ?

- □ La qualité d'une page détermine-t-elle vraiment le crawl des pages suivantes ?

- □ Google peut-il vraiment pénaliser certaines sections de votre site en fonction de leur qualité ?

- □ Faut-il vraiment déplacer le contenu UGC de faible qualité pour améliorer le crawl ?

- □ Google filtre-t-il vraiment certains sujets lors du crawl et de l'indexation ?

- □ Pourquoi Google refuse-t-il d'indexer un contenu qu'il a pourtant crawlé ?

- □ Le contenu dupliqué est-il vraiment sans danger pour votre SEO ?

- □ Les liens d'affiliation peuvent-ils coexister avec une stratégie SEO de qualité ?

- □ Faut-il vraiment faire relire vos traductions automatiques par des humains ?

- □ Pourquoi Google privilégie-t-il les liens depuis des « sites normaux » pour évaluer votre importance ?

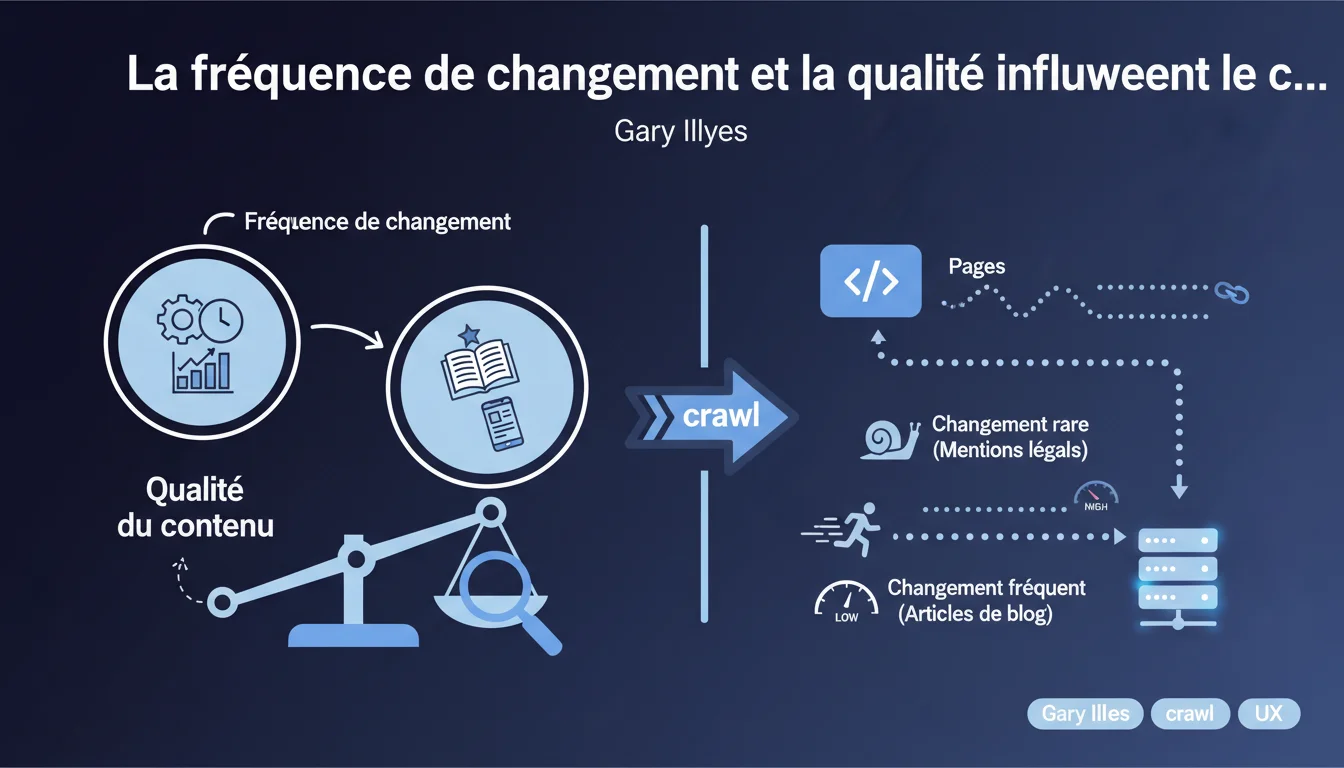

Google utilise deux critères pour décider de la fréquence de crawl : la qualité du contenu (signal prioritaire) et la fréquence de changement des pages. Les pages statiques comme les mentions légales sont naturellement crawlées moins souvent. L'implication : un contenu de qualité reste le facteur dominant, mais maintenir vos pages importantes à jour peut accélérer leur crawl.

Ce qu'il faut comprendre

Quels sont les deux signaux qui pilotent le crawl ?

Google distingue clairement la qualité du contenu comme signal principal et la fréquence de changement comme signal secondaire. Cette hiérarchie n'est pas anodine : elle signifie qu'une page médiocre mise à jour quotidiennement ne sera pas nécessairement crawlée plus souvent qu'un contenu exceptionnel mais statique.

La fréquence de changement agit comme un indicateur d'intérêt potentiel — si une page bouge régulièrement, Googlebot anticipe qu'elle mérite d'être revisitée. Mais sans qualité, ce signal perd son poids.

Pourquoi les mentions légales sont-elles moins crawlées ?

L'exemple donné par Gary Illyes est révélateur : les pages statiques par nature (CGV, mentions légales, politique de confidentialité) changent rarement et n'apportent généralement pas de valeur SEO différenciante. Google optimise donc son budget de crawl en les visitant moins fréquemment.

Concrètement ? Si votre page "Mentions légales" n'a pas bougé depuis 18 mois, Googlebot passera peut-être tous les 2-3 mois au lieu de toutes les semaines. C'est rationnel et ça libère du crawl budget pour des URL plus stratégiques.

Comment cette logique s'applique-t-elle aux sites dynamiques ?

Sur un site e-commerce où les fiches produits changent (stock, prix, avis clients), Google ajustera naturellement la fréquence de crawl à la hausse sur ces URL. Sur un blog où vous publiez chaque semaine, les pages récentes seront crawlées plus souvent que les archives anciennes et figées.

- La qualité prime : un contenu médiocre mis à jour quotidiennement ne gagnera pas en fréquence de crawl si Google le juge peu pertinent

- La fréquence de changement influence, mais reste un signal secondaire — elle ne compense jamais un déficit de qualité

- Les pages statiques (légales, institutionnelles) sont naturellement déprioritisées dans le planning de crawl

- L'optimisation du crawl budget passe donc par deux axes : améliorer la qualité et mettre à jour les pages stratégiques

Avis d'un expert SEO

Cette déclaration colle-t-elle avec les observations terrain ?

Oui, et c'est assez rare pour être souligné. Les audits de logs montrent systématiquement que Googlebot concentre ses passages sur les URL changeantes et qualitatives : pages produits à fort trafic, articles récents bien positionnés, catégories mises à jour régulièrement.

En revanche, les pages "utilitaires" peu liées et rarement modifiées (FAQ vieillissantes, pages mentions légales, archives anciennes) sont effectivement crawlées beaucoup moins fréquemment — parfois une fois par trimestre sur de gros sites. La hiérarchie qualité > fréquence se vérifie en pratique.

Quelles nuances faut-il apporter ?

Gary Illyes ne précise pas comment Google évalue la "qualité" dans ce contexte précis — s'agit-il de l'EAT, du trafic, de l'engagement, des signaux de pertinence topique ? [A vérifier] sur quels critères exacts repose ce jugement de qualité. On peut supposer qu'il s'agit d'un mix de signaux, mais aucune confirmation officielle.

Autre point : la fréquence de changement ne signifie pas "modifier pour modifier". Ajouter artificiellement une date ou changer un mot n'accélère pas le crawl si Google détecte que le contenu substantiel reste identique. Les bots sont entraînés à repérer les vrais changements des faux.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Sur les petits sites (moins de 1000 pages), le crawl budget n'est généralement pas une contrainte — Google crawle l'ensemble du site régulièrement, même les pages statiques. La hiérarchie qualité/fréquence joue moins.

Autre exception : les pages soumises manuellement via la Search Console (inspection d'URL) sont crawlées rapidement indépendamment de leur fréquence de changement habituelle. C'est un override temporaire du système automatique.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le crawl ?

Premier réflexe : identifier vos pages stratégiques (celles qui génèrent du trafic ou des conversions) et vous assurer qu'elles sont mises à jour régulièrement avec du contenu de qualité. Pas besoin de modifications quotidiennes, mais un refresh mensuel ou trimestriel selon la nature du contenu.

Ensuite, analysez vos logs de crawl pour repérer les URL crawlées inutilement : facettes de filtres, paramètres de session, doublons techniques. Bloquez-les via robots.txt ou canonicalisez-les pour libérer du budget de crawl vers les pages importantes.

Quelles erreurs éviter absolument ?

Ne modifiez pas artificiellement vos pages juste pour "simuler" du changement. Google détecte les modifications cosmétiques (ajout de date, changement d'un mot isolé) et ça n'influence pas positivement le crawl — au contraire, ça peut dégrader les signaux de qualité si le contenu devient incohérent.

Évitez aussi de négliger complètement les pages statiques importantes. Une page "À propos" ou "Contact" bien construite contribue à l'EAT même si elle change peu — assurez-vous qu'elle soit au moins accessible et crawlable, même si la fréquence de visite est basse.

- Auditer les logs de crawl pour identifier les patterns (quelles pages sont visitées souvent, lesquelles jamais ?)

- Prioriser les mises à jour sur les pages stratégiques : produits phares, articles piliers, catégories principales

- Bloquer ou désindexer les URL sans valeur SEO qui consomment du crawl budget inutilement

- Vérifier que les pages importantes sont bien liées depuis le maillage interne (les pages orphelines sont crawlées moins souvent)

- Monitorer la fréquence de crawl via Search Console (section "Statistiques d'exploration") et ajuster si nécessaire

- Ne jamais modifier du contenu juste pour "forcer" le crawl — la qualité du changement compte plus que sa fréquence

❓ Questions frequentes

Est-ce qu'un blog qui publie quotidiennement sera crawlé plus souvent qu'un site statique ?

Faut-il mettre à jour mes mentions légales régulièrement pour améliorer le crawl ?

Comment Google évalue-t-il la qualité d'une page pour décider du crawl ?

Modifier la date de publication d'un article suffit-il à relancer le crawl ?

Le crawl budget est-il un problème pour tous les sites ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 19/09/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.