Declaration officielle

Ce qu'il faut comprendre

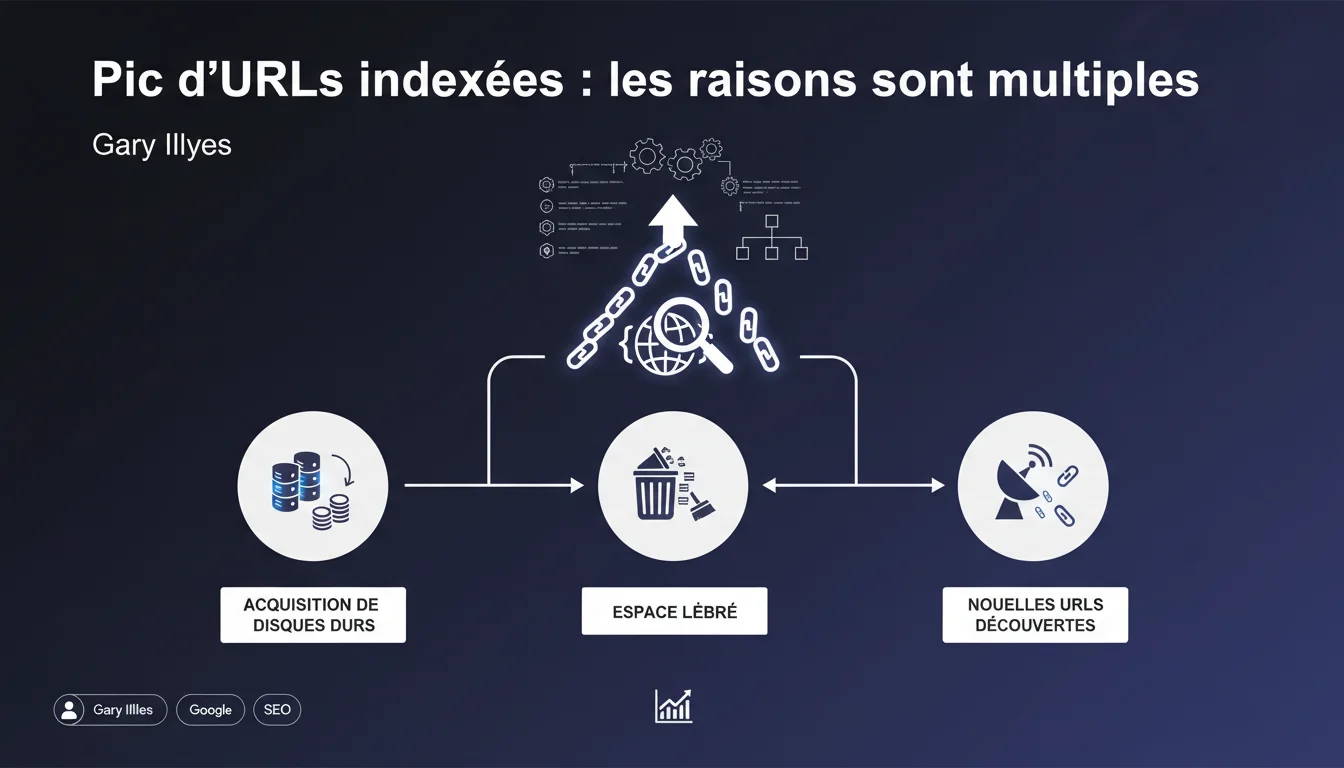

Google a levé le voile sur un phénomène que de nombreux SEO observent régulièrement : des pics soudains d'URLs indexées dans la Search Console. Ces variations peuvent être spectaculaires et sources d'interrogations.

Gary Illyes identifie trois causes principales liées à l'infrastructure de Google : l'acquisition de nouveaux serveurs augmentant la capacité de stockage, la libération d'espace sur les disques existants, ou encore la découverte de nouvelles URLs par les crawlers. Ces raisons sont essentiellement techniques et indépendantes de votre site.

Cependant, d'autres facteurs directement liés à vos optimisations SEO peuvent également expliquer ces hausses : amélioration de la qualité des contenus, résolution de blocages techniques (robots.txt, balises meta), accélération du temps de chargement, ou refonte du maillage interne.

- Infrastructure Google : capacité de stockage et découverte de nouvelles pages

- Qualité du site : amélioration des contenus et résolution de problèmes techniques

- Performances techniques : vitesse de chargement et architecture interne optimisée

- Crawlabilité : meilleure accessibilité pour les robots d'indexation

Avis d'un expert SEO

Cette déclaration est parfaitement cohérente avec la réalité du terrain. Il est effectivement crucial de distinguer les pics d'indexation provenant d'améliorations côté Google (sur lesquelles vous n'avez aucun contrôle) de ceux résultant de vos propres optimisations.

Une nuance importante : un pic d'URLs indexées n'est pas toujours positif. Si Google indexe massivement des pages de faible qualité ou dupliquées (pagination infinie, paramètres URL, contenus générés automatiquement), cela peut diluer votre crawl budget et nuire à votre visibilité. L'objectif n'est pas d'avoir le maximum de pages indexées, mais le bon nombre de pages qualitatives.

Impact pratique et recommandations

Face à une variation significative du nombre d'URLs indexées, voici les actions concrètes à mettre en œuvre :

- Analysez les URLs nouvellement indexées via la Search Console pour identifier leur typologie et leur pertinence

- Vérifiez vos fichiers techniques (robots.txt, sitemaps XML, balises meta) pour vous assurer qu'aucune modification involontaire n'a eu lieu

- Contrôlez la qualité : assurez-vous que les pages indexées apportent une réelle valeur et ne sont pas des contenus dupliqués ou faibles

- Optimisez votre maillage interne pour faciliter la découverte des pages stratégiques par les robots

- Auditez les performances techniques : temps de chargement, structure des URLs, gestion de la pagination

- Utilisez la désindexation stratégique (noindex, robots.txt) pour les sections non pertinentes consommant du crawl budget

- Surveillez l'évolution dans le temps : un pic isolé peut être normal, une tendance durable nécessite une action

💬 Commentaires (0)

Soyez le premier à commenter.