Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ La qualité du contenu influence-t-elle vraiment tous les systèmes de classement Google ?

- □ Google accorde-t-il vraiment un traitement de faveur aux nouvelles pages d'accueil ?

- □ Google privilégie-t-il vraiment les pages de qualité dans son crawl ?

- □ Googlebot est-il vraiment stupide ou Google cache-t-il quelque chose ?

- □ La qualité d'une page détermine-t-elle vraiment le crawl des pages suivantes ?

- □ Google peut-il vraiment pénaliser certaines sections de votre site en fonction de leur qualité ?

- □ Faut-il vraiment déplacer le contenu UGC de faible qualité pour améliorer le crawl ?

- □ La fréquence de mise à jour influence-t-elle vraiment le crawl de vos pages ?

- □ Google filtre-t-il vraiment certains sujets lors du crawl et de l'indexation ?

- □ Pourquoi Google refuse-t-il d'indexer un contenu qu'il a pourtant crawlé ?

- □ Le contenu dupliqué est-il vraiment sans danger pour votre SEO ?

- □ Les liens d'affiliation peuvent-ils coexister avec une stratégie SEO de qualité ?

- □ Faut-il vraiment faire relire vos traductions automatiques par des humains ?

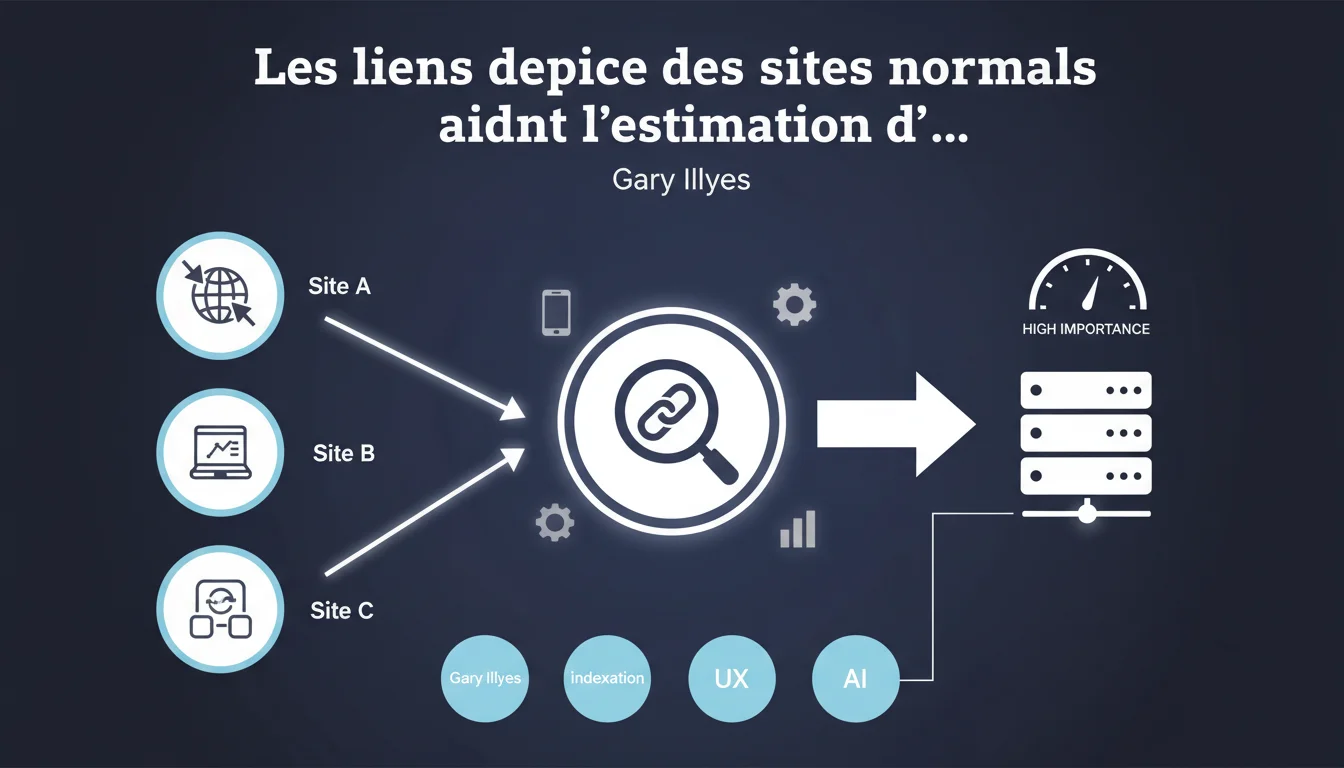

Google utilise les liens provenant de sites « normaux » — comprenez : légitimes, pas des profils de réseaux sociaux ou des annuaires suspects — comme signal clé pour estimer l'importance d'un site lors de l'indexation. Plus vous recevez de backlinks naturels depuis des sources fiables, plus Google considère votre contenu comme prioritaire pour l'exploration et l'indexation.

Ce qu'il faut comprendre

Que veut dire Google par « sites normaux » exactement ?

La formulation de Gary Illyes est volontairement floue. Un site normal, c'est avant tout un site éditorial classique : médias, blogs thématiques, sites institutionnels, forums modérés. Bref, des destinations qui publient du contenu original et attirent du trafic organique.

À l'inverse, Google exclut explicitement les pages de profil (réseaux sociaux, annuaires bas de gamme) et les sites suspects (fermes de liens, PBN de mauvaise qualité). Ce qui compte, c'est la légitimité éditoriale et la pertinence thématique du site source.

Quel est le lien entre ces backlinks et l'indexation ?

Google ne dit pas que les liens améliorent directement le classement — il parle d'estimation d'importance pour l'indexation. Nuance cruciale : un site avec peu de backlinks de qualité risque de voir ses pages explorées moins fréquemment, voire ignorées si le crawl budget est serré.

Les liens depuis des sites légitimes servent de signal de découverte et de validation de pertinence. Plus vous en obtenez, plus Googlebot estime que vos pages méritent d'être crawlées régulièrement et indexées rapidement.

Comment Google distingue-t-il un lien « naturel » d'un lien manipulé ?

Aucune précision technique dans cette déclaration — c'est tout le problème. On sait que Google analyse le contexte éditorial (le lien est-il intégré dans un vrai contenu ?), la cohérence thématique (le site source traite-t-il du même sujet ?) et l'historique du domaine (émet-il des liens vers des dizaines de sites sans rapport ?).

Mais au-delà de ces généralités, la frontière entre « naturel » et « manipulé » reste une zone grise que seul l'algorithme connaît.

- Signal d'indexation : les liens depuis des sites légitimes accélèrent l'exploration et l'indexation de vos pages.

- Sites normaux : sites éditoriaux classiques avec trafic organique et contenu original — pas des profils ou annuaires.

- Critère flou : Google ne détaille pas ses méthodes pour distinguer un backlink naturel d'un lien manipulé.

- Crawl budget : un site sans backlinks de qualité risque de voir ses pages explorées moins souvent.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, dans l'ensemble. On observe depuis des années que les sites bien maillés dans des écosystèmes éditoriaux légitimes voient leurs nouvelles pages indexées en quelques heures, tandis que des sites isolés — même avec du contenu correct — peuvent attendre des jours, voire des semaines.

Le problème, c'est que Gary Illyes ne donne aucune métrique concrète : combien de liens ? Depuis combien de domaines référents ? Avec quelle fréquence ? Tout reste dans le vague, ce qui rend la déclaration difficile à exploiter opérationnellement. [À vérifier] dans vos propres données.

Pourquoi insister sur « sites normaux » plutôt que simplement « backlinks de qualité » ?

Parce que Google veut décourager les pratiques de netlinking artificiel. En précisant « pas des pages de profil ou sites suspects », Illyes vise clairement les réseaux sociaux automatisés, les annuaires low-cost et les PBN mal construits.

Soyons honnêtes : cette formulation est aussi une manière d'éviter de donner des critères précis. Si Google disait « il faut X liens depuis des sites avec un DR de Y », la moitié du web SEO passerait son temps à gamer le système. Le flou est stratégique.

Quelles sont les limites de cette déclaration ?

Première limite : elle ne dit rien sur le classement. Un site peut être parfaitement indexé et rester invisible en page 10. L'indexation est une condition nécessaire, pas suffisante.

Deuxième limite : la notion de « normalité » d'un site est subjective. Un blog WordPress hébergé chez un particulier est-il « normal » ? Un forum de niche avec 500 membres actifs ? Google ne donne aucun seuil, aucun critère objectif.

Impact pratique et recommandations

Que faut-il faire concrètement pour obtenir ces liens « normaux » ?

L'approche la plus saine reste le PR digital classique : identifier des médias et blogs thématiques pertinents, leur proposer du contenu exclusif ou des données originales, obtenir des mentions naturelles. Ça prend du temps, mais c'est ce que Google valorise.

Les stratégies de guest posting restent efficaces si elles sont menées intelligemment — c'est-à-dire en ciblant des sites avec un vrai lectorat, pas des plateformes de publication ouverte à tous. Privilégiez la qualité éditoriale à la quantité de domaines référents.

Quelles erreurs éviter absolument ?

Ne perdez pas de temps avec les annuaires généralistes, les communiqués de presse low-cost distribués sur 200 sites clonés, ou les profils de réseaux sociaux créés uniquement pour poser un lien. Google les ignore au mieux, les pénalise au pire.

Autre piège : acheter des backlinks depuis des PBN « premium » vendus comme « sites normaux ». Si le réseau est détecté — et ils le sont souvent — vous risquez une dévaluation manuelle ou algorithmique de tous les liens concernés.

Comment vérifier que votre stratégie fonctionne ?

Surveillez la vitesse d'indexation de vos nouvelles pages dans la Search Console. Si elles sont découvertes et indexées en moins de 48h après publication, c'est bon signe. Si elles traînent en « Découverte, actuellement non indexée » pendant des semaines, vous manquez probablement de backlinks entrants.

Analysez aussi la fréquence de crawl : un site bien linké voit Googlebot passer plusieurs fois par jour sur ses pages stratégiques. Un site isolé peut n'être visité qu'une fois par semaine.

- Identifiez 10 à 20 sites éditoriaux pertinents dans votre thématique et proposez-leur du contenu exclusif.

- Évitez les annuaires généralistes, les communiqués de presse clonés et les profils de réseaux sociaux sans valeur éditoriale.

- Surveillez la vitesse d'indexation de vos nouvelles pages dans la Search Console.

- Analysez la fréquence de crawl de vos pages stratégiques pour détecter d'éventuels problèmes de crawl budget.

- Privilégiez toujours la qualité éditoriale des sites sources à la quantité brute de domaines référents.

❓ Questions frequentes

Un lien depuis un réseau social comme LinkedIn ou Twitter compte-t-il pour l'indexation ?

Combien de backlinks faut-il pour qu'un site soit jugé « important » par Google ?

Un site sans aucun backlink peut-il être correctement indexé ?

Les liens internes suffisent-ils pour améliorer l'indexation de mes pages profondes ?

Google considère-t-il les forums et communautés en ligne comme des « sites normaux » ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 19/09/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.