Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ La qualité du contenu influence-t-elle vraiment tous les systèmes de classement Google ?

- □ Google accorde-t-il vraiment un traitement de faveur aux nouvelles pages d'accueil ?

- □ Google privilégie-t-il vraiment les pages de qualité dans son crawl ?

- □ Googlebot est-il vraiment stupide ou Google cache-t-il quelque chose ?

- □ La qualité d'une page détermine-t-elle vraiment le crawl des pages suivantes ?

- □ Google peut-il vraiment pénaliser certaines sections de votre site en fonction de leur qualité ?

- □ La fréquence de mise à jour influence-t-elle vraiment le crawl de vos pages ?

- □ Google filtre-t-il vraiment certains sujets lors du crawl et de l'indexation ?

- □ Pourquoi Google refuse-t-il d'indexer un contenu qu'il a pourtant crawlé ?

- □ Le contenu dupliqué est-il vraiment sans danger pour votre SEO ?

- □ Les liens d'affiliation peuvent-ils coexister avec une stratégie SEO de qualité ?

- □ Faut-il vraiment faire relire vos traductions automatiques par des humains ?

- □ Pourquoi Google privilégie-t-il les liens depuis des « sites normaux » pour évaluer votre importance ?

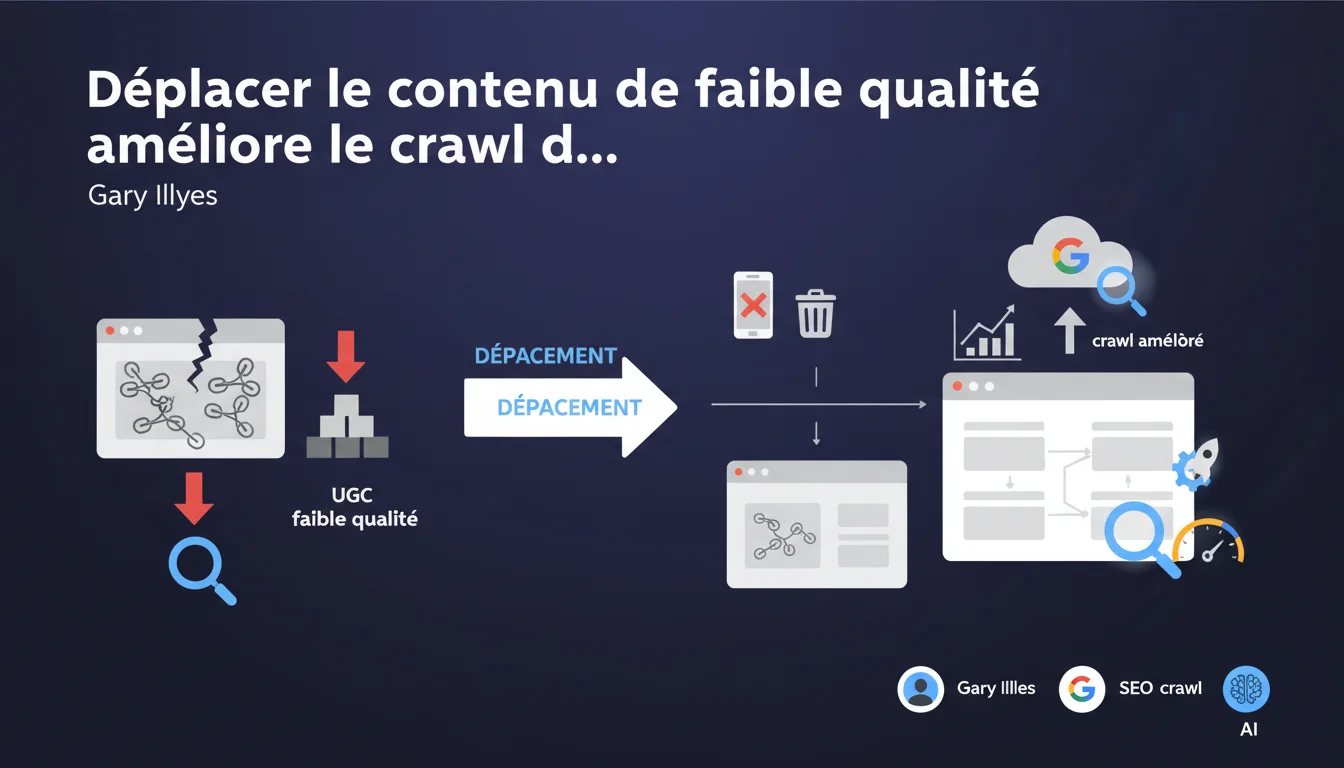

Google confirme que déplacer du contenu UGC de faible qualité hors du site principal améliore la façon dont Googlebot crawle les sections restantes. Cette observation terrain validée par Gary Illyes suggère que la qualité globale d'un site influence directement l'allocation du crawl budget — ce que Google appelle sortir des 'prisons de crawl'.

Ce qu'il faut comprendre

Qu'est-ce qu'une 'prison de crawl' selon Google ?

Le terme « prison de crawl » n'est pas documenté officiellement dans les guidelines Google, mais Gary Illyes l'utilise ici pour désigner un état où Googlebot réduit drastiquement son activité sur certaines sections d'un site. Concrètement ? Le robot passe moins de temps sur des zones qu'il juge peu qualitatives, créant un goulot d'étranglement.

Ce phénomène n'est pas nouveau — on observe depuis des années que Google ajuste son crawl budget en fonction de signaux qualité. Mais cette déclaration officialise que le contenu UGC (User Generated Content) de faible qualité peut être un déclencheur direct de cette restriction.

Pourquoi le contenu UGC pose-t-il problème spécifiquement ?

Le contenu généré par les utilisateurs — commentaires spam, forums pollués, fiches produits vides — représente souvent un volume massif de pages à faible valeur ajoutée. Google doit arbitrer : crawler 10 000 pages de commentaires médiocres ou 500 pages de contenu éditorial solide ?

En déplaçant ce contenu UGC sur un sous-domaine ou un domaine séparé, les SEO observent que Googlebot réalloue son budget vers les sections critiques. Ce n'est pas magique : c'est une question d'efficacité algorithmique. Google privilégie les zones où il détecte un signal qualité positif.

Quels signaux indiquent qu'un site est en 'prison de crawl' ?

Plusieurs indicateurs dans Search Console doivent alerter : une baisse progressive du nombre de pages crawlées par jour, une augmentation des erreurs 404 ou soft-404 sur des sections spécifiques, un délai anormalement long entre publication et indexation.

Autre signal : des sections entières du site ne sont plus visitées par Googlebot pendant plusieurs semaines, alors qu'elles contiennent du contenu frais. Si vous constatez ce pattern, c'est probablement que Google a réduit la priorité de crawl sur ces zones.

- Le crawl budget n'est pas uniforme : Google alloue des ressources différemment selon les sections d'un site

- La qualité globale impacte le crawl : même du bon contenu peut être pénalisé si noyé dans du médiocre

- Déplacer ≠ supprimer : l'objectif est d'isoler le faible qualité, pas forcément de le perdre

- Les 'prisons de crawl' sont réversibles : améliorer la qualité permet de restaurer un crawl normal

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui — et c'est rare que Google soit aussi explicite. Depuis des années, on observe que les sites avec un fort ratio contenu UGC / contenu éditorial souffrent de problèmes d'indexation chroniques. Forums phpBB, marketplaces avec des milliers de fiches vides, sites d'avis avec du spam massif : tous partagent ce symptôme.

Ce qui change ici, c'est la validation officielle. Gary Illyes ne dit pas « théoriquement ça devrait marcher » — il dit « des SEO ont constaté ». C'est un retour d'expérience validé par Google, pas une hypothèse. Ça donne du poids à une pratique qui restait jusqu'ici dans le domaine de l'empirique.

Quelles nuances faut-il apporter à cette recommandation ?

Première nuance : [À vérifier] Google ne définit pas précisément ce qu'il considère comme « faible qualité » pour l'UGC. Est-ce basé sur le taux d'engagement ? La longueur des commentaires ? Le ratio spam détecté ? On manque de critères objectifs pour auditer son propre contenu.

Deuxième point — déplacer du contenu UGC n'est pas anodin techniquement ni stratégiquement. Si ce contenu génère du trafic organique (même marginal), le basculer sur un sous-domaine peut entraîner une perte sèche. Il faut mesurer le ROI avant d'agir.

Troisième nuance : tous les sites n'ont pas besoin de cette manipulation. Un blog avec quelques dizaines de commentaires modérés par article ne tombera jamais en « prison de crawl ». Cette stratégie concerne les plateformes à forte volumétrie UGC — marketplaces, forums, sites d'avis.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre site a moins de 10 000 pages et un contenu UGC modéré qualitativement, vous n'êtes probablement pas concerné. Le crawl budget n'est un enjeu critique que pour les gros sites — Google le répète régulièrement.

Autre cas : si votre UGC est activement utilisé par Google pour enrichir les résultats (ex : avis vérifiés affichés en rich snippets), le déplacer serait contre-productif. Il faut distinguer l'UGC toxique (spam, contenu vide) de l'UGC stratégique (avis clients structurés, Q&A pertinentes).

Impact pratique et recommandations

Comment identifier le contenu UGC à déplacer ?

Commencez par un audit de crawl via Search Console. Exportez les données de crawl sur 3 mois et segmentez par type de page. Identifiez les sections qui consomment du budget sans générer de trafic organique ni de conversions.

Ensuite, analysez la qualité page par page. Utilisez un scraper pour extraire le ratio texte unique / contenu dupliqué ou générique. Les pages avec moins de 100 mots de contenu original sont des candidates prioritaires au déplacement.

- Auditer le crawl par section dans Search Console (onglet Statistiques sur l'exploration)

- Calculer le ROI de chaque type de page UGC : trafic vs coût de crawl

- Identifier les pages UGC avec taux de rebond >90% et temps sur page <10s

- Vérifier si l'UGC génère des backlinks ou du trafic direct (sinon, déplacer)

- Tester le déplacement sur un échantillon avant migration totale

Quelle architecture adopter pour isoler le contenu faible qualité ?

Trois options principales : sous-domaine dédié, domaine séparé, ou relégation en noindex. Le sous-domaine (ex : community.votresite.com) est souvent le plus simple techniquement — il garde une cohérence de marque tout en isolant le crawl.

Le domaine séparé (ex : forum-votresite.com) offre une isolation maximale mais complique la gestion. Le noindex massif est une solution radicale qui fonctionne si le contenu n'a aucune valeur SEO — mais attention, vous perdez toute possibilité de ranking.

Quelles erreurs éviter lors de cette migration ?

Erreur classique : déplacer sans redirection 301. Résultat ? Des milliers de 404 qui plombent l'expérience utilisateur et génèrent du bruit dans Search Console. Si le contenu a des backlinks ou du trafic, redirigez systématiquement.

Deuxième erreur : négliger la communication utilisateurs. Si vous déplacez un forum actif sur un sous-domaine, prévenez la communauté. Un changement d'URL brutal casse les habitudes et peut tuer l'engagement.

Déplacer du contenu UGC de faible qualité peut débloquer des situations de crawl stagnant — mais c'est une opération technique sensible. Entre l'audit initial, le choix de l'architecture, la gestion des redirections et le monitoring post-migration, les étapes sont nombreuses et les risques réels. Si votre site manipule des dizaines de milliers de pages UGC et que vous manquez de ressources internes pour piloter cette refonte, faire appel à une agence SEO spécialisée peut s'avérer judicieux pour éviter les erreurs coûteuses et maximiser l'impact sur le crawl.

❓ Questions frequentes

Le déplacement d'UGC sur un sous-domaine affecte-t-il l'autorité du domaine principal ?

Faut-il conserver des redirections 301 vers le contenu UGC déplacé ?

Cette stratégie fonctionne-t-elle aussi avec du contenu éditorial de faible qualité ?

Combien de temps faut-il pour observer une amélioration du crawl après déplacement ?

Le noindex massif est-il une alternative viable au déplacement ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 19/09/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.