Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Qu'est-ce qu'un crawler web et pourquoi Google insiste-t-il sur cette définition ?

- □ Googlebot ne fait-il vraiment que crawler sans décider de l'indexation ?

- □ Comment Googlebot crawle-t-il réellement vos pages web ?

- □ Le crawl budget dépend-il vraiment de la demande de Search ?

- □ Le crawl budget existe-t-il vraiment chez Google ?

- □ Faut-il bloquer certaines pages du crawl Google pour optimiser son budget ?

- □ Google manque-t-il vraiment d'espace de stockage pour indexer votre contenu ?

- □ Les liens naturels sont-ils vraiment plus importants que les sitemaps pour la découverte ?

- □ Faut-il vraiment lier depuis la page d'accueil pour accélérer le crawl de vos nouvelles pages ?

- □ Faut-il vraiment limiter l'usage de l'Indexing API aux seuls cas d'usage recommandés par Google ?

- □ Pourquoi Google limite-t-il l'usage de l'Indexing API à certains contenus ?

- □ L'Indexing API peut-elle faire retirer votre contenu aussi vite qu'elle l'indexe ?

- □ Comment l'amélioration de la qualité du contenu accélère-t-elle le crawl de Google ?

- □ L'outil d'inspection d'URL peut-il vraiment accélérer l'indexation de vos améliorations ?

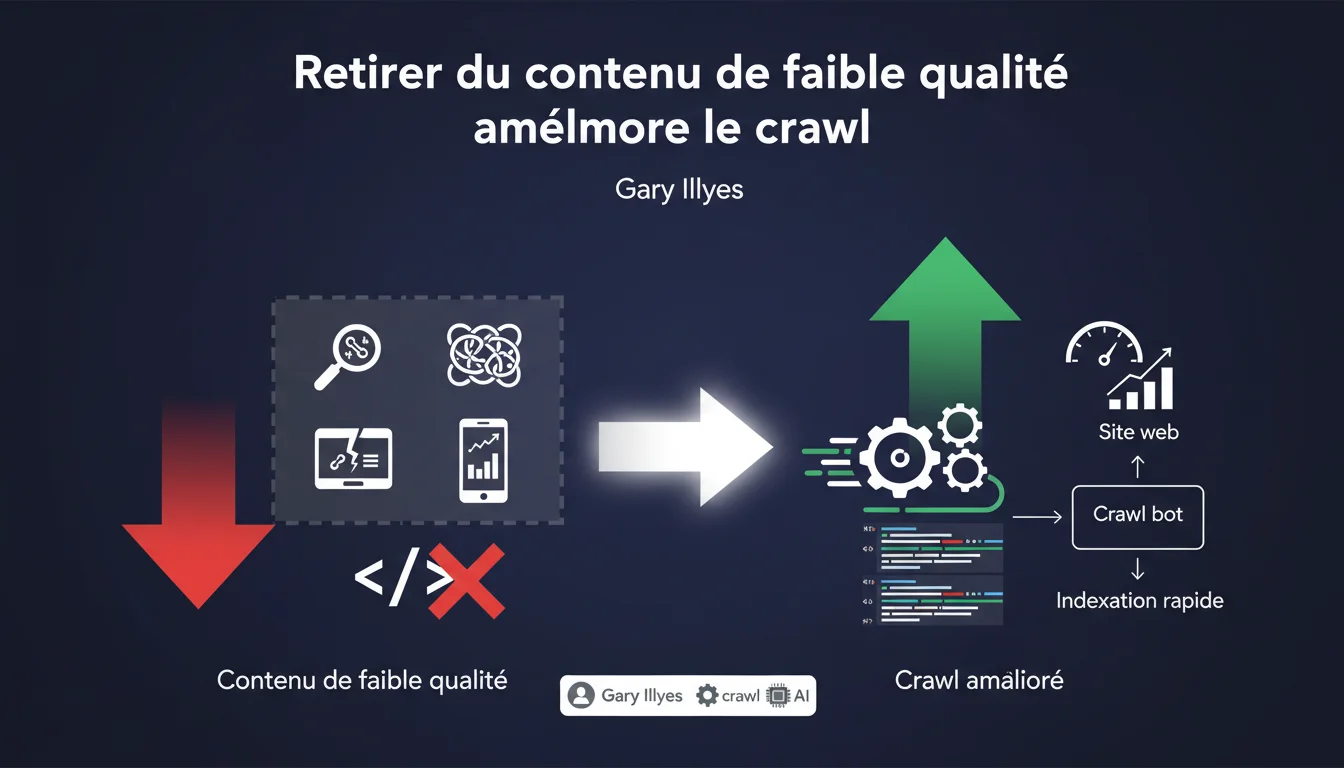

Gary Illyes confirme que retirer des sections entières de contenu faible qualité améliore significativement le crawl. Les études de cas montrent des résultats tangibles quand la proportion de pages concernées est importante. Le message est clair : mieux vaut un site plus petit mais cohérent qu'un catalogue gonflé artificiellement.

Ce qu'il faut comprendre

Google pénalise-t-il vraiment les sites avec beaucoup de contenu médiocre ?

La déclaration d'Illyes ne parle pas directement de pénalité algorithmique, mais d'optimisation du crawl. La nuance compte. Google alloue un budget de crawl limité à chaque site — si Googlebot perd son temps sur des pages sans valeur, il explore moins les contenus stratégiques.

Les "nombreuses études de cas" mentionnées restent floues. Aucune donnée chiffrée, aucun exemple concret. On reste dans l'affirmation générale, ce qui est typique des déclarations Google : juste assez précis pour orienter, pas assez pour mesurer.

Qu'est-ce qu'une "section relativement grande" de faible qualité ?

Illyes ne donne aucun seuil. 10% du site ? 30% ? 50% ? Cette imprécision volontaire force les SEO à analyser leur propre situation. Un site de 10 000 pages avec 3 000 fiches produits vides ou dupliquées entre clairement dans cette catégorie.

Le terme "section" suggère qu'il ne s'agit pas de quelques pages isolées. On parle de zones entières : anciennes catégories abandonnées, archives blog sans trafic, variantes produits générées automatiquement sans contenu différencié.

Quels signaux indiquent une amélioration du crawl ?

L'amélioration du crawl se mesure via Google Search Console : augmentation du nombre de pages explorées quotidiennement, réduction du temps moyen de téléchargement, meilleure fraîcheur d'indexation des contenus stratégiques.

- Le crawl budget n'est pas infini — Google optimise ses ressources serveur

- Retirer du contenu faible qualité libère du budget pour les pages importantes

- L'impact se voit surtout sur les gros sites (10 000+ pages)

- Les "études de cas" mentionnées manquent de données publiques vérifiables

- La corrélation crawl amélioré = meilleur ranking reste à prouver

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. J'ai vu des sites doubler leur fréquence de crawl après avoir supprimé 40% de leurs URLs — principalement des pages tags auto-générées et des filtres produits sans valeur ajoutée. Mais attention : l'amélioration du crawl n'a pas toujours produit de hausse de trafic immédiate.

Le lien entre meilleur crawl et meilleur ranking n'est pas automatique. Google explore mieux, certes, mais si vos pages stratégiques restent médiocres, ça ne change rien. La suppression de contenu faible qualité est une condition nécessaire mais pas suffisante.

Dans quels cas cette stratégie échoue-t-elle ?

Quand on confond "faible qualité" avec "faible trafic actuel". J'ai vu des clients massacrer des pans entiers de contenu informatif sous prétexte de zéro visite en trois mois — puis perdre du trafic global parce que ces pages alimentaient le maillage interne et la cohérence thématique.

Autre piège : retirer du contenu sans plan de redirection. Les backlinks pointant vers les pages supprimées partent en 404, vous perdez du jus. [À vérifier] : Illyes ne précise pas si l'amélioration du crawl compense systématiquement cette perte potentielle d'autorité.

Quelle est la limite de cette approche ?

Google ne dit pas comment définir objectivement "faible qualité". Zéro trafic ? Thin content ? Duplication ? Taux de rebond élevé ? Chacun interprète avec ses propres critères, ce qui rend les comparaisons impossibles.

Impact pratique et recommandations

Comment identifier le contenu à retirer en priorité ?

Commence par extraire toutes vos URLs indexées via Google Search Console et croise avec vos analytics. Les pages avec zéro clic sur 12 mois ET zéro backlink externe sont des candidats évidents. Mais creuse plus loin.

Utilise Screaming Frog ou Oncrawl pour détecter les pages à faible profondeur de crawl (10+ clics depuis la home), faible nombre de mots (< 150), ou fort taux de duplication. Ces signaux techniques révèlent souvent les zones que Googlebot survole sans réel intérêt.

Quelle méthode de suppression adopter ?

Trois options selon le contexte : suppression pure avec 410 Gone si le contenu ne reviendra jamais, redirection 301 vers une page parente si le sujet reste pertinent, ou consolidation de plusieurs pages faibles en une seule page pilier robuste.

Évite le noindex massif comme solution paresseuse. Ça garde les URLs dans votre architecture, ça consomme toujours du crawl budget via les liens internes, et ça crée de la confusion. Si c'est inutile, supprime franchement.

Comment mesurer l'impact post-suppression ?

Suis l'évolution dans Search Console : nombre de pages crawlées par jour, nombre de Ko téléchargés, temps de réponse serveur. Compare sur 30 jours avant/après. Si le crawl s'améliore mais que ton trafic stagne, c'est que tes pages stratégiques ont d'autres problèmes structurels.

- Exporte toutes les URLs indexées et croise avec données GA4/Search Console

- Priorise les sections entières, pas les pages isolées (archives, anciennes catégories, filtres sans valeur)

- Mets en place un plan de redirection 301 pour préserver les backlinks existants

- Supprime définitivement (410) uniquement si aucune valeur historique ou lien externe

- Monitore le crawl budget pendant 60 jours post-suppression dans GSC

- Vérifie que la suppression n'impacte pas la cohérence du maillage interne sur les pages stratégiques

❓ Questions frequentes

Supprimer des pages nuit-il toujours au trafic à court terme ?

Combien de pages faut-il supprimer pour voir un effet sur le crawl ?

Faut-il utiliser le noindex ou supprimer définitivement ?

Cette stratégie fonctionne-t-elle sur tous types de sites ?

Comment définir objectivement la faible qualité ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/03/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.