Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Qu'est-ce qu'un crawler web et pourquoi Google insiste-t-il sur cette définition ?

- □ Googlebot ne fait-il vraiment que crawler sans décider de l'indexation ?

- □ Comment Googlebot crawle-t-il réellement vos pages web ?

- □ Le crawl budget dépend-il vraiment de la demande de Search ?

- □ Le crawl budget existe-t-il vraiment chez Google ?

- □ Faut-il bloquer certaines pages du crawl Google pour optimiser son budget ?

- □ Google manque-t-il vraiment d'espace de stockage pour indexer votre contenu ?

- □ Les liens naturels sont-ils vraiment plus importants que les sitemaps pour la découverte ?

- □ Faut-il vraiment lier depuis la page d'accueil pour accélérer le crawl de vos nouvelles pages ?

- □ Faut-il vraiment limiter l'usage de l'Indexing API aux seuls cas d'usage recommandés par Google ?

- □ Pourquoi Google limite-t-il l'usage de l'Indexing API à certains contenus ?

- □ L'Indexing API peut-elle faire retirer votre contenu aussi vite qu'elle l'indexe ?

- □ Faut-il supprimer vos pages de faible qualité pour améliorer votre crawl budget ?

- □ L'outil d'inspection d'URL peut-il vraiment accélérer l'indexation de vos améliorations ?

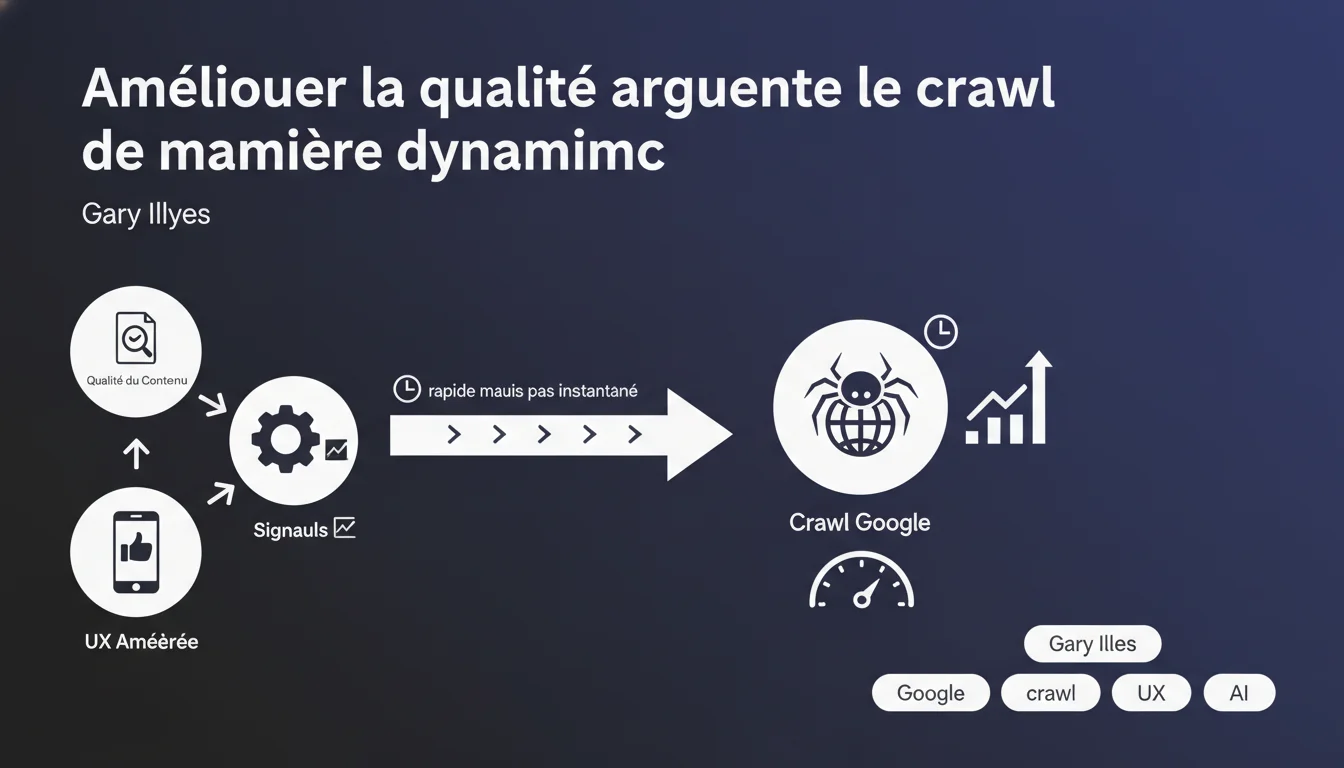

Google ajuste son crawl budget de manière dynamique dès qu'il détecte une amélioration de la qualité du contenu sur plusieurs URLs. La réaction est rapide mais pas immédiate — le système a besoin de temps pour confirmer que l'amélioration est réelle et durable avant d'allouer plus de ressources de crawl.

Ce qu'il faut comprendre

Qu'est-ce que le crawl dynamique selon Google ?

Google ne fixe pas un crawl budget statique pour chaque site. Le scheduling du crawler varie en fonction de multiples signaux de qualité. Quand Google détecte que plusieurs URLs d'un site montrent des améliorations qualitatives, il ajuste à la hausse la fréquence et la profondeur de crawl.

Cette déclaration confirme que le crawl n'est pas une constante figée — c'est un processus réactif qui s'adapte aux évolutions du site. Concrètement, si vous corrigez massivement du contenu médiocre, Google ne vous fait pas attendre des semaines pour reconnaître l'effort.

Quels signaux indiquent une amélioration de qualité ?

Gary Illyes parle de "signaux" sans les détailler, ce qui est typique de Google. On peut raisonnablement penser aux métriques d'engagement utilisateur (CTR, temps de visite, taux de rebond), à la fraîcheur du contenu, à la réduction des erreurs 404 ou des pages dupliquées, et à l'amélioration des Core Web Vitals.

Le fait que l'amélioration doive concerner "plusieurs URLs" suggère que Google cherche une tendance, pas une exception isolée. Un signal ponctuel ne suffit pas — il faut que l'ensemble du site montre une direction claire.

Que signifie "rapidement, mais pas instantanément" ?

Google évite volontairement de donner un délai précis. "Rapidement" peut signifier quelques jours à quelques semaines selon la taille du site et l'historique de crawl. Le délai permet à Google de valider la cohérence de l'amélioration avant d'investir plus de ressources.

Cette formulation prudente protège Google contre les tentatives de manipulation à court terme — si vous gonflez artificiellement la qualité juste pour booster le crawl, le système finira par s'en apercevoir et réajustera à la baisse.

- Le crawl budget n'est pas figé mais réactif aux améliorations qualitatives

- L'amélioration doit être visible sur plusieurs URLs, pas isolée

- La réaction de Google prend quelques jours à quelques semaines, selon le contexte

- Le système cherche des tendances durables, pas des pics temporaires

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, largement. Les cas de refonte qualitative suivis d'une augmentation de crawl sont documentés régulièrement. Quand un site nettoie massivement son contenu thin, consolide ses pages dupliquées ou améliore son architecture, on observe souvent un pic de crawl dans les 7 à 21 jours suivants.

Mais — et c'est un point crucial — cette réactivité dépend aussi de la taille et de l'autorité du site. Un site établi avec un historique stable verra une réaction plus rapide qu'un nouveau domaine ou un site pénalisé par le passé. [A vérifier] : Google ne précise jamais les seuils exacts ni les pondérations appliquées selon l'historique du site.

Quelles nuances faut-il apporter ?

Soyons honnêtes : "amélioration de la qualité" reste un concept flou. Google mélange probablement des signaux on-page (structure HTML, richesse sémantique, fraîcheur) et des signaux comportementaux (engagement, retour à la SERP). Mais la déclaration ne dit pas si tous ces signaux ont le même poids.

Autre point : Gary parle d'augmentation de la "demande de crawl", pas nécessairement de la fréquence d'indexation. Un crawl accru ne garantit pas automatiquement un meilleur ranking — c'est une condition nécessaire mais non suffisante. Si le contenu amélioré ne répond toujours pas aux critères de pertinence ou d'E-E-A-T, le crawl supplémentaire ne changera rien au positionnement.

Dans quels cas cette logique échoue-t-elle ?

Cette promesse d'ajustement dynamique suppose que Google détecte effectivement les améliorations. Si votre site a un crawl budget historiquement faible (gros site avec beaucoup de pages inutiles, serveur lent, faible autorité), Google peut mettre des semaines — voire des mois — à découvrir vos changements.

noindex, bloquées par le robots.txt, ou enterrées à 5 clics de la home, le scheduler ne pourra pas détecter ces améliorations. La qualité doit être techniquement accessible au crawler.Enfin, certains sites migrent ou changent d'hébergeur au moment où ils améliorent le contenu. Si le temps de réponse serveur se dégrade en parallèle, l'effet positif sur le crawl sera annulé — voire inversé. Google priorise toujours la stabilité technique avant la qualité éditoriale.

Impact pratique et recommandations

Que faut-il faire concrètement pour déclencher cette augmentation de crawl ?

D'abord, concentrez-vous sur une amélioration cohérente et visible. Ne retouchez pas 5 pages au hasard — ciblez une section entière du site ou un type de contenu spécifique. Google cherche des tendances, pas des exceptions.

Ensuite, assurez-vous que vos améliorations soient techniquement détectables : mettez à jour les dates de publication, ajoutez du balisage structuré pertinent (Article, FAQPage), améliorez les temps de chargement. Facilitez le travail du crawler en rendant ces pages facilement accessibles depuis la home et le sitemap XML.

- Identifiez un ensemble de pages à améliorer (au moins 20-30 URLs pour un signal clair)

- Enrichissez le contenu éditorial : ajoutez de la profondeur, des sources, des médias

- Corrigez les erreurs techniques : 404, redirections en chaîne, balises canoniques contradictoires

- Améliorez les Core Web Vitals sur ces pages (LCP, CLS, INP)

- Mettez à jour les dates de publication et le balisage

lastmoddans le sitemap - Renforcez le maillage interne vers ces pages depuis des sections bien crawlées

- Surveillez les logs serveur pour confirmer l'augmentation du crawl dans les 2-3 semaines

Quelles erreurs éviter ?

Ne confondez pas quantité et qualité. Ajouter 500 mots de remplissage générique ne déclenchera rien — pire, cela peut envoyer un signal négatif. Google détecte les patterns de contenu gonflé artificiellement.

Évitez aussi de toucher uniquement aux métadonnées (title, meta description) en espérant un miracle. Ces éléments jouent un rôle, mais l'amélioration doit être substantielle et éditoriale pour que Google réagisse. Enfin, ne bloquez pas le crawler pendant vos modifications — certains CMS mettent automatiquement les pages en noindex pendant une refonte, ce qui annule tout l'effort.

Comment vérifier que la stratégie fonctionne ?

Surveillez vos logs serveur : comptez le nombre de requêtes Googlebot par jour avant et après vos modifications. Une augmentation progressive confirme que Google détecte et valorise vos efforts.

Dans la Search Console, consultez le rapport "Statistiques d'exploration" : observez l'évolution du nombre de pages explorées par jour et le temps de réponse moyen. Une courbe ascendante sur 2-3 semaines est un indicateur positif.

❓ Questions frequentes

Combien de temps faut-il attendre avant de voir une augmentation du crawl après avoir amélioré le contenu ?

Faut-il améliorer toutes les pages du site ou suffit-il de cibler certaines sections ?

Est-ce que l'augmentation du crawl garantit une amélioration du positionnement ?

Quels signaux précis indiquent à Google que la qualité s'est améliorée ?

Peut-on forcer Google à crawler plus rapidement après une mise à jour ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/03/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.