Declaration officielle

Ce qu'il faut comprendre

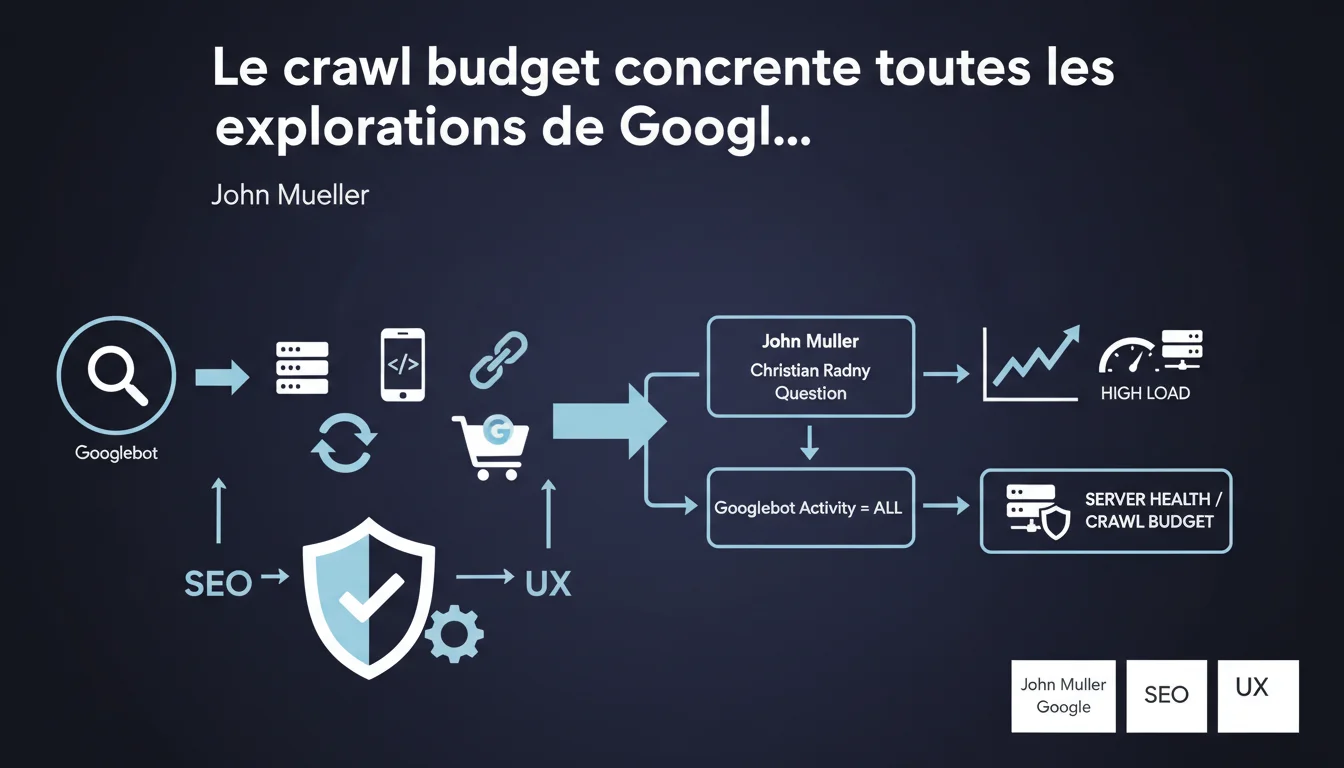

Qu'est-ce que le crawl budget et pourquoi cette précision de Google est-elle importante ?

Le crawl budget représente la quantité de ressources que Googlebot alloue à l'exploration d'un site web. Cette déclaration de John Mueller clarifie un point souvent méconnu : toutes les activités de crawl comptent, y compris celles liées au Merchant Center pour les flux produits e-commerce.

L'objectif principal du crawl budget n'est pas d'imposer une limite arbitraire, mais de protéger vos serveurs contre une surcharge technique. Google adapte son exploration pour éviter de dégrader les performances de votre infrastructure.

Quelles sont les différentes formes de crawl concernées par ce budget ?

Le crawl budget englobe l'ensemble des requêtes de Googlebot vers votre serveur. Cela inclut l'exploration classique des pages web, mais aussi les mises à jour automatiques du Merchant Center, les crawls de validation AMP, ou encore les explorations JavaScript.

Chaque requête consomme des ressources serveur : bande passante, CPU, mémoire. Google surveille la capacité de réponse de votre infrastructure et ajuste son rythme d'exploration en conséquence.

Le crawl budget est-il vraiment limité de façon stricte ?

Contrairement à l'idée répandue d'un quota fixe, les révélations de Gary Illyes et Dave Smart en 2024 ont nuancé cette notion. Le crawl budget n'est pas un plafond rigide mais un équilibre dynamique.

La demande de recherche influence directement le volume de crawl : plus vos pages sont recherchées et jugées pertinentes, plus Google allouera de ressources pour les explorer fréquemment. C'est un système basé sur la popularité et la valeur perçue du contenu.

- Toutes les formes de crawl de Googlebot consomment du crawl budget, y compris le Merchant Center

- L'objectif principal est de protéger votre infrastructure serveur contre la surcharge

- Le crawl budget n'est pas une limite fixe mais un équilibre dynamique adapté à la demande

- La popularité et la pertinence de vos contenus influencent le volume de crawl alloué

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument, et cette clarification confirme ce que les SEO techniques observent depuis longtemps dans les logs serveur. Les explorations liées aux flux produits e-commerce génèrent effectivement une charge non négligeable, particulièrement sur les sites avec des catalogues importants.

J'ai constaté sur plusieurs projets e-commerce que les mises à jour automatiques du Merchant Center peuvent représenter 15 à 25% du volume total de crawl. Ignorer cette composante conduit à sous-estimer la charge réelle sur l'infrastructure.

Quelles nuances essentielles faut-il apporter à cette notion de crawl budget ?

La nuance majeure concerne la distinction entre contrainte technique et priorité stratégique. Le crawl budget n'est problématique que pour les sites de très grande taille (plusieurs dizaines de milliers de pages) ou avec des infrastructures limitées.

Pour la majorité des sites, le véritable enjeu n'est pas tant la quantité de crawl, mais sa qualité et son orientation vers les pages stratégiques. Un site de 5000 pages bien structuré sera entièrement crawlé sans problème.

Dans quels cas cette problématique devient-elle critique ?

Le crawl budget devient critique dans trois situations principales : les sites e-commerce massifs (+ 100 000 produits), les sites générant du contenu dynamique ou dupliqué en masse, et les infrastructures serveur sous-dimensionnées.

Pour ces cas, surveiller la répartition du crawl entre pages stratégiques et pages secondaires devient essentiel. Si Googlebot passe 80% de son temps sur des pages à faible valeur (filtres, paginations, variantes), c'est un signal d'alerte majeur.

Impact pratique et recommandations

Comment auditer efficacement l'utilisation de votre crawl budget ?

Commencez par analyser vos logs serveur sur une période de 30 jours minimum. Identifiez les différents types de crawl (Googlebot standard, Googlebot-Image, crawls Merchant Center) et leur répartition.

Utilisez la Search Console pour comparer le volume de pages crawlées versus le nombre de pages indexées. Un écart important révèle souvent des problèmes de qualité de contenu ou d'architecture.

Croisez ces données avec vos pages génératrices de trafic : sont-elles crawlées régulièrement ? Si vos meilleures pages ne sont explorées qu'une fois par mois, vous avez un problème de priorisation.

Quelles optimisations techniques mettre en place concrètement ?

Pour les sites e-commerce utilisant le Merchant Center, optimisez la structure de vos flux produits et évitez les mises à jour inutiles. Configurez des délais appropriés entre les synchronisations automatiques.

Implémentez un fichier robots.txt stratégique pour bloquer les sections sans valeur SEO : pages de compte utilisateur, étapes de tunnel de commande, résultats de recherche interne non optimisés.

Améliorez votre architecture de liens internes pour guider Googlebot vers vos pages prioritaires. Les pages stratégiques doivent être accessibles en 3 clics maximum depuis la homepage.

Que faut-il surveiller pour maintenir un crawl budget optimal dans le temps ?

- Analysez vos logs serveur mensuellement pour identifier les patterns de crawl et les anomalies

- Surveillez le ratio pages crawlées / pages indexées dans la Search Console

- Vérifiez que vos pages stratégiques sont crawlées au moins hebdomadairement

- Auditez régulièrement votre robots.txt et vos balises noindex pour éviter les blocages accidentels

- Optimisez la vitesse de chargement serveur pour permettre un crawl plus efficace

- Éliminez systématiquement le contenu dupliqué et les pages de faible qualité

- Configurez des sitemaps XML segmentés par type de contenu et priorité

- Surveillez les erreurs serveur (5xx) qui freinent l'exploration de Googlebot

💬 Commentaires (0)

Soyez le premier à commenter.