Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Qu'est-ce qu'un crawler web et pourquoi Google insiste-t-il sur cette définition ?

- □ Googlebot ne fait-il vraiment que crawler sans décider de l'indexation ?

- □ Comment Googlebot crawle-t-il réellement vos pages web ?

- □ Le crawl budget dépend-il vraiment de la demande de Search ?

- □ Le crawl budget existe-t-il vraiment chez Google ?

- □ Faut-il bloquer certaines pages du crawl Google pour optimiser son budget ?

- □ Google manque-t-il vraiment d'espace de stockage pour indexer votre contenu ?

- □ Les liens naturels sont-ils vraiment plus importants que les sitemaps pour la découverte ?

- □ Faut-il vraiment lier depuis la page d'accueil pour accélérer le crawl de vos nouvelles pages ?

- □ Faut-il vraiment limiter l'usage de l'Indexing API aux seuls cas d'usage recommandés par Google ?

- □ L'Indexing API peut-elle faire retirer votre contenu aussi vite qu'elle l'indexe ?

- □ Comment l'amélioration de la qualité du contenu accélère-t-elle le crawl de Google ?

- □ Faut-il supprimer vos pages de faible qualité pour améliorer votre crawl budget ?

- □ L'outil d'inspection d'URL peut-il vraiment accélérer l'indexation de vos améliorations ?

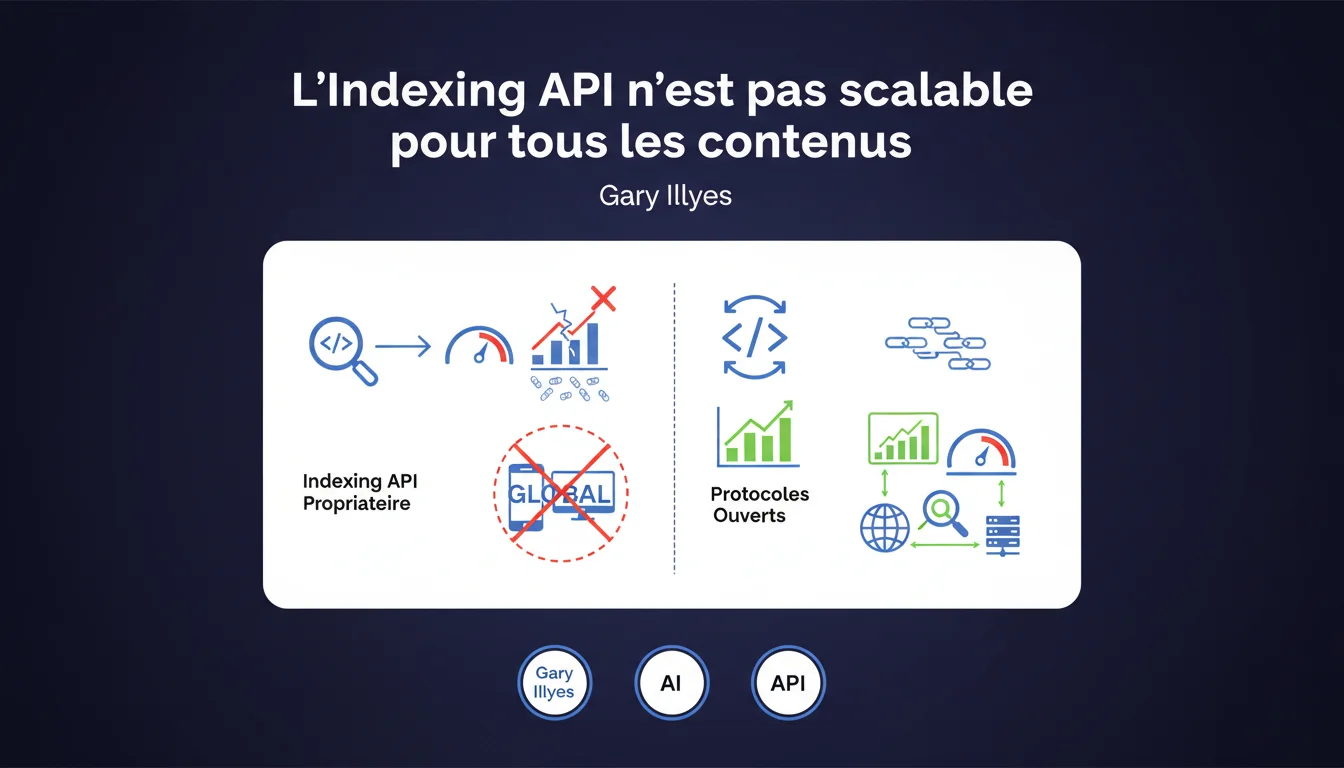

L'Indexing API n'est pas conçue pour indexer tous vos contenus à grande échelle. Google la réserve à des cas d'usage spécifiques car elle n'est ni scalable ni ouverte comme les protocoles standards. Autrement dit : oubliez l'idée de l'utiliser pour forcer l'indexation de toutes vos pages.

Ce qu'il faut comprendre

Qu'est-ce que l'Indexing API et pourquoi existe-t-elle ?

L'Indexing API est un outil développé par Google permettant de notifier le moteur en temps réel de l'ajout ou de la mise à jour de contenus spécifiques. Elle a été créée initialement pour des cas d'usage précis : les offres d'emploi et les vidéos en livestream.

L'objectif ? Accélérer l'indexation de contenus à forte valeur temporelle, où chaque minute compte. Un job qui disparaît dans 48h ou un livestream qui démarre dans l'heure nécessitent une réactivité que le crawl classique ne garantit pas.

Pourquoi Google insiste-t-il sur le fait qu'elle n'est pas scalable ?

Gary Illyes utilise le terme "scalable" pour une raison simple : l'API génère une charge technique importante côté Google. Contrairement au crawl organique que Googlebot gère à son rythme, l'Indexing API force un traitement immédiat.

Si des milliers de sites l'utilisaient pour soumettre chaque page de leur catalogue, cela créerait une pression ingérable sur l'infrastructure. Google garde donc le contrôle en limitant les cas d'usage autorisés.

Que signifie "propriétaire" par opposition aux protocoles ouverts ?

En mentionnant le caractère propriétaire de l'API, Illyes oppose cette solution fermée aux standards web universels comme les sitemaps XML ou RSS. Ces derniers sont documentés, ouverts, et fonctionnent avec n'importe quel moteur de recherche.

L'Indexing API, elle, ne fonctionne qu'avec Google. Vous créez une dépendance technique à un écosystème fermé, sans garantie de pérennité ni de compatibilité avec d'autres plateformes.

- L'Indexing API est réservée aux offres d'emploi et livestreams — pas aux pages produits, articles de blog ou landing pages

- Elle génère une charge technique que Google ne souhaite pas voir exploser, d'où les restrictions strictes

- Contrairement aux sitemaps XML, elle ne repose pas sur un standard ouvert et reste sous contrôle exclusif de Google

- L'utiliser hors cas autorisés risque des sanctions ou le retrait de l'accès à l'API

Avis d'un expert SEO

Cette limitation est-elle vraiment technique ou stratégique ?

Soyons honnêtes : l'argument de la scalabilité tient la route, mais il masque aussi une dimension stratégique. Google ne veut pas donner aux SEO un bouton "indexe ma page maintenant" pour tout et n'importe quoi.

Si cette API devenait un canal d'indexation généraliste, cela court-circuiterait tout le système de crawl et de priorisation que Google a passé des années à affiner. Le moteur perdrait le contrôle sur ce qu'il indexe, quand et comment — impensable pour Googlebot.

[À vérifier] : certains praticiens rapportent avoir utilisé l'API pour des contenus non autorisés sans conséquence immédiate. Mais l'absence de sanction visible ne signifie pas qu'il n'y a pas de dépriorisation algorithmique ou de mise sur liste de surveillance.

Les protocoles ouverts sont-ils vraiment suffisants ?

Dans 95 % des cas, oui. Un sitemap XML bien structuré, couplé à un maillage interne solide et un crawl budget optimisé, suffit amplement pour une indexation efficace. Ajouter des flux RSS pour les contenus frais reste une bonne pratique complémentaire.

Le problème se pose uniquement quand vous avez des contenus ultra-temporels où quelques heures de retard changent tout. Dans ce cas précis — et seulement celui-là — l'Indexing API a du sens.

Quelles observations terrain contredisent cette déclaration ?

Aucune contradiction frontale, mais une nuance importante : des sites ayant un crawl budget limité constatent parfois des délais d'indexation de plusieurs jours voire semaines, même avec un sitemap parfaitement configuré.

Dans ces situations, la frustration de ne pas pouvoir forcer l'indexation est réelle. Google répond "optimisez votre architecture", mais quand vous avez déjà tout fait côté technique, le message sonne creux. L'API aurait pu être un levier, mais Google refuse d'en faire un outil accessible à tous.

Impact pratique et recommandations

Que faut-il faire concrètement si on a des contenus temporels ?

D'abord, vérifier si vos contenus entrent dans les cas autorisés : offres d'emploi structurées avec JobPosting schema, ou vidéos en livestream avec BroadcastEvent schema. Si c'est le cas, configurez l'API via Google Search Console et respectez scrupuleusement la documentation officielle.

Si vos contenus ne correspondent pas — événements éphémères, promos flash, actualités chaudes — oubliez l'Indexing API. Misez plutôt sur un sitemap dynamique mis à jour en temps réel, avec une balise <lastmod> précise et un crawl budget optimisé.

Quelles erreurs éviter absolument ?

Ne cherchez pas à contourner les restrictions en maquillant vos contenus. Déclarer des pages produit comme des offres d'emploi pour déclencher l'API ? Mauvaise idée. Google détecte ces manipulations via le schema markup et le contenu réel de la page.

Autre erreur fréquente : installer un plugin qui envoie automatiquement chaque publication via l'Indexing API. Cela fonctionne peut-être quelques semaines, puis vous perdez l'accès sans préavis ni explication. Et récupérer un accès révoqué est quasi impossible.

Comment s'assurer que l'indexation reste rapide sans l'API ?

Concentrez-vous sur les fondamentaux qui accélèrent réellement le crawl : temps de réponse serveur sous 200ms, pages accessibles en maximum 3 clics depuis la home, sitemap segmenté par type de contenu avec priorités claires.

Ajoutez une stratégie de push actif : soumettre manuellement les URLs critiques via Search Console, utiliser les flux RSS pour les agrégateurs, déclencher des signaux sociaux qui génèrent des visites rapides — Googlebot suit souvent les traces d'activité utilisateur.

- Vérifier que vos contenus correspondent strictement aux cas autorisés (JobPosting ou BroadcastEvent schema)

- Ne jamais utiliser l'Indexing API pour des pages classiques, même si des outils le proposent

- Optimiser le crawl budget : architecture plate, sitemap XML segmenté, lastmod précis

- Surveiller les délais d'indexation via Search Console et identifier les goulots d'étranglement

- Pour les contenus urgents hors API : soumission manuelle + push social + flux RSS

- Documenter tous les appels API si vous l'utilisez légitimement, pour tracer d'éventuelles anomalies

❓ Questions frequentes

Puis-je utiliser l'Indexing API pour mes articles de blog ou pages produit ?

Quels sont les risques si j'utilise l'API hors cas autorisés ?

Un sitemap XML suffit-il vraiment pour une indexation rapide ?

Comment savoir si mon site a un problème de crawl budget ?

Les plugins WordPress qui utilisent l'Indexing API sont-ils légaux ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 14/03/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.