Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ La qualité du contenu influence-t-elle vraiment tous les systèmes de classement Google ?

- □ Google accorde-t-il vraiment un traitement de faveur aux nouvelles pages d'accueil ?

- □ Google privilégie-t-il vraiment les pages de qualité dans son crawl ?

- □ Googlebot est-il vraiment stupide ou Google cache-t-il quelque chose ?

- □ La qualité d'une page détermine-t-elle vraiment le crawl des pages suivantes ?

- □ Google peut-il vraiment pénaliser certaines sections de votre site en fonction de leur qualité ?

- □ Faut-il vraiment déplacer le contenu UGC de faible qualité pour améliorer le crawl ?

- □ La fréquence de mise à jour influence-t-elle vraiment le crawl de vos pages ?

- □ Google filtre-t-il vraiment certains sujets lors du crawl et de l'indexation ?

- □ Le contenu dupliqué est-il vraiment sans danger pour votre SEO ?

- □ Les liens d'affiliation peuvent-ils coexister avec une stratégie SEO de qualité ?

- □ Faut-il vraiment faire relire vos traductions automatiques par des humains ?

- □ Pourquoi Google privilégie-t-il les liens depuis des « sites normaux » pour évaluer votre importance ?

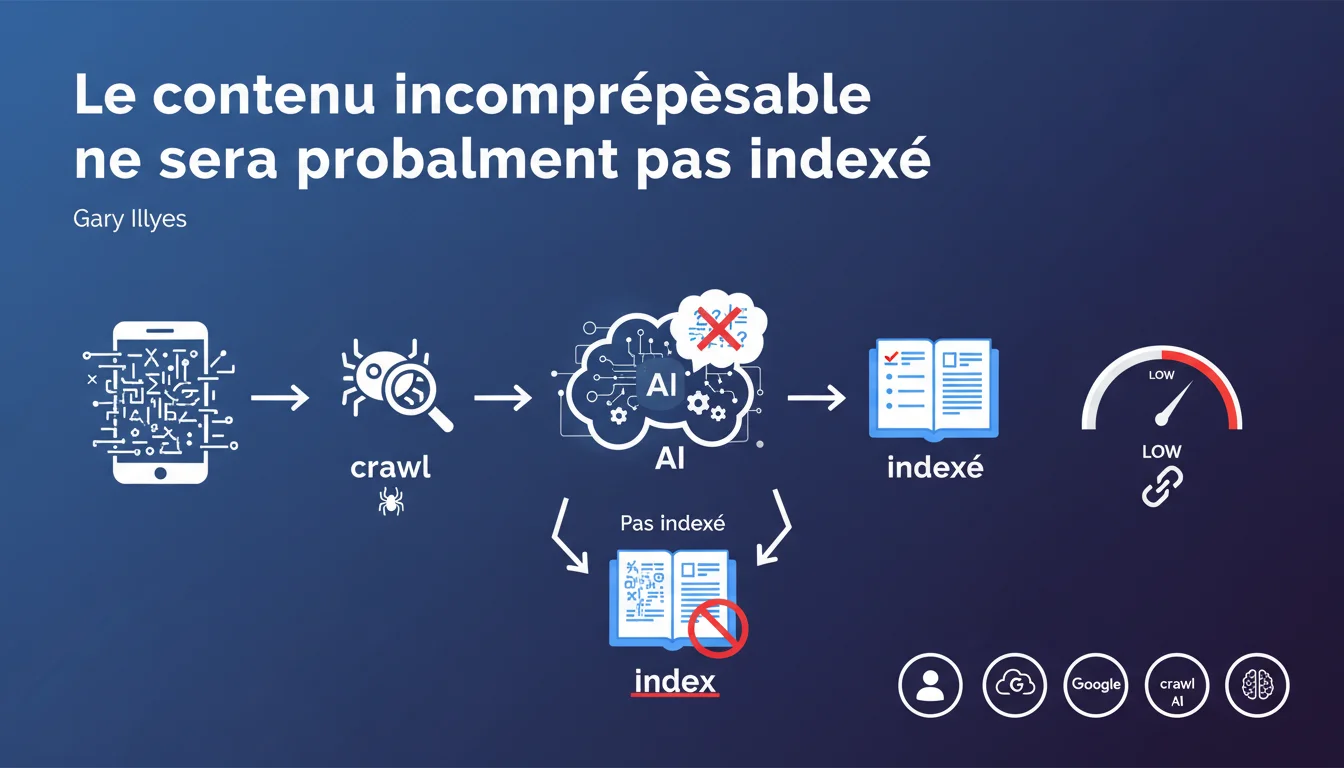

Google peut crawler une page sans l'indexer si le contenu est inintelligible ou charabia. Le moteur doit extraire des mots et du sens — sans ça, pas d'indexation. Cette distinction entre crawl et indexation rappelle que la qualité sémantique reste un filtre critique, même après le passage de Googlebot.

Ce qu'il faut comprendre

Gary Illyes pose un principe simple : crawler ne signifie pas indexer. Googlebot visite des milliards de pages, mais seule une fraction finit dans l'index. Le contenu doit être lisible, structuré et porteur de sens.

Cette déclaration souligne que l'indexation est conditionnelle. Le moteur analyse le texte, extrait des mots-clés, construit des signaux sémantiques. Si la page est du charabia — texte généré aléatoirement, langues mélangées, phrases incohérentes — le système abandonne.

Qu'est-ce qui rend un contenu « inintelligible » pour Google ?

Plusieurs situations déclenchent ce filtre. Le texte généré automatiquement sans relecture humaine, les pages bourrées de mots-clés sans structure logique, les scripts mal formés qui affichent du code au lieu de contenu.

Google utilise des modèles de langage pour évaluer la cohérence syntaxique et sémantique. Si le contenu ressemble à du bruit, le moteur le traite comme tel. Les pages en langues exotiques mal encodées, les contenus CSS masqués qui apparaissent au crawl mais pas à l'utilisateur, ou encore les fermes de liens générées par scraping tombent souvent dans cette catégorie.

La distinction crawl/indexation est-elle nouvelle ?

Pas du tout. Google rappelle depuis des années que crawler ne garantit rien. Mais cette déclaration reformule un filtre souvent négligé : la qualité sémantique.

Contrairement à d'autres signaux — vitesse, mobile-first, backlinks — celui-ci est binaire. Soit le contenu est compréhensible, soit il ne l'est pas. Aucun travail technique ne compensera un texte incohérent.

Quels signaux Google analyse-t-il pour décider ?

On peut supposer que le moteur évalue la densité lexicale, la cohérence grammaticale, la présence de structures syntaxiques reconnaissables. Les modèles NLP (Natural Language Processing) détectent les anomalies : répétitions aberrantes, absence de verbes, suites de mots sans relation sémantique.

Google ne publie pas de seuil précis, mais les observations terrain montrent que les pages générées par des spinners de mauvaise qualité ou les contenus traduits automatiquement sans relecture sont régulièrement exclus de l'index.

- Crawler n'implique pas indexer — Google visite des milliards de pages, seule une fraction entre dans l'index

- Le contenu doit être sémantiquement exploitable — texte cohérent, mots identifiables, structure logique

- Le charabia est un motif de rejet — texte généré aléatoirement, langues mélangées, bourrage de mots-clés incohérent

- Les modèles NLP détectent les anomalies — densité lexicale, cohérence grammaticale, structures syntaxiques

- Aucun signal technique ne compense un contenu inintelligible — la qualité sémantique est un filtre binaire

Avis d'un expert SEO

Cette déclaration est-elle vraiment utile aux praticiens ?

Soyons honnêtes : 99 % des sites légitimes n'ont aucun souci avec ce filtre. Le contenu « inintelligible » concerne surtout les fermes de contenu automatisées, les pages générées par IA mal calibrée, ou les techniques black hat dépassées.

L'intérêt de cette déclaration n'est pas tant dans le diagnostic que dans la confirmation d'un principe souvent oublié : Google ne se contente pas de lire le HTML, il cherche du sens. Les praticiens qui optimisent pour les robots en oubliant la cohérence sémantique prennent un risque.

Quelles zones grises cette règle laisse-t-elle ?

Gary Illyes ne précise pas où commence le « charabia ». Un contenu généré par IA avec des tournures maladroites mais grammaticalement correct sera-t-il indexé ? Probablement oui. [A vérifier] Un texte en français mélangé à de l'anglais dans un contexte multilingue ? Ça dépend.

Les pages avec du jargon technique très spécialisé — documentation API, brevets, littérature scientifique — peuvent déclencher des faux positifs. Google prétend gérer ces cas, mais on observe régulièrement des pages expertes exclues de l'index pour « manque de qualité », alors que le contenu est parfaitement cohérent pour un public averti.

Autre zone grise : les pages en langues peu représentées dans le corpus d'entraînement de Google. Une page en breton ou en quechua, même parfaitement rédigée, pourrait être mal évaluée si le moteur n'a pas assez de données pour valider la cohérence linguistique.

Cette déclaration contredit-elle des observations terrain ?

Pas vraiment, mais elle simplifie. On sait que Google indexe parfois des pages de faible qualité sémantique si elles reçoivent des backlinks puissants ou si le domaine a une forte autorité. Le filtre « charabia » semble donc appliqué avec une tolérance variable.

L'expérience montre aussi que des pages techniquement valides — bien structurées, avec des balises Hn propres — peuvent être exclues si le contenu manque de profondeur ou de cohérence. Google ne dit pas « contenu court = charabia », mais les deux problèmes se recoupent souvent.

Impact pratique et recommandations

Comment vérifier que mon contenu est « compréhensible » pour Google ?

Première étape : relire le texte à voix haute. Si ça ne sonne pas naturel, si les phrases manquent de liens logiques, Google aura le même problème. Les outils NLP comme Hemingway, Grammarly ou les analyseurs sémantiques français (Antidote, TextRazor) détectent les incohérences.

Vérifiez aussi la Search Console. Si Google crawle vos pages mais ne les indexe pas (statut « Crawlée, actuellement non indexée »), le problème peut venir de la qualité sémantique. Comparez avec des pages indexées : y a-t-il une différence de structure, de longueur, de cohérence ?

Quelles erreurs éviter absolument ?

Le bourrage de mots-clés reste le premier piège. Répéter 15 fois « plombier Paris » dans 200 mots ne crée pas de sens, juste du bruit. Google le détecte immédiatement.

Les contenus générés automatiquement sans validation humaine posent problème. Les spinners de texte, les agrégateurs de flux RSS mal configurés, les pages créées par scraping produisent du charabia plus souvent qu'on ne le croit.

Attention aussi aux pages multilingues mal gérées. Si votre CMS mélange des fragments français, anglais et allemand dans la même page sans balises hreflang correctes, Google peut abandonner l'analyse sémantique.

Que faut-il faire concrètement ?

- Relire chaque contenu avant publication — une relecture humaine reste le meilleur filtre

- Vérifier la cohérence sémantique avec des outils NLP (Hemingway, Antidote, TextRazor)

- Consulter la Search Console pour repérer les pages « Crawlées, non indexées » sans raison technique évidente

- Éviter les spinners de texte et les contenus générés sans validation humaine

- Structurer le texte avec des balises Hn, des paragraphes courts, des transitions logiques

- Tester la lisibilité avec des scores Flesch ou Gunning Fog (même si Google ne les utilise pas directement, ils corrèlent avec la cohérence sémantique)

- Supprimer le bourrage de mots-clés et privilégier le champ lexical naturel

- Valider les pages multilingues avec des balises hreflang propres et un contenu distinct par langue

L'indexation dépend de la capacité de Google à extraire du sens. Un contenu techniquement parfait mais sémantiquement incohérent sera crawlé puis abandonné.

La relecture humaine reste la meilleure garantie. Les outils NLP aident, mais ne remplacent pas le jugement d'un rédacteur averti. Si vous gérez un site complexe avec des milliers de pages ou des contenus techniques très spécialisés, un audit sémantique approfondi peut s'avérer nécessaire — dans ce cas, un accompagnement par une agence SEO spécialisée vous permettra d'identifier les zones de fragilité et de calibrer vos processus éditoriaux pour maximiser vos chances d'indexation.

❓ Questions frequentes

Google peut-il indexer une page sans la crawler ?

Un contenu généré par IA est-il considéré comme du charabia ?

Comment savoir si Google trouve mon contenu inintelligible ?

Le jargon technique ou scientifique pose-t-il problème ?

Un contenu court peut-il être considéré comme du charabia ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 19/09/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.