Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Le contenu dupliqué freine-t-il réellement le crawl de votre site ?

- □ Faut-il vraiment s'inquiéter des alertes de duplication dans Google Search Console ?

- □ La balise canonical : pourquoi Google ignore-t-il parfois vos instructions ?

- □ Faut-il privilégier la balise HTML ou l'en-tête HTTP pour déclarer une URL canonique ?

- □ Pourquoi Google ignore-t-il votre balise canonical et comment le corriger ?

- □ Faut-il vraiment rediriger en 301 toutes les URL non-canoniques pour le SEO ?

- □ Pourquoi fusionner des pages similaires améliore-t-il le SEO même sans duplicate content ?

- □ Faut-il vraiment fusionner vos pages pour améliorer votre SEO ?

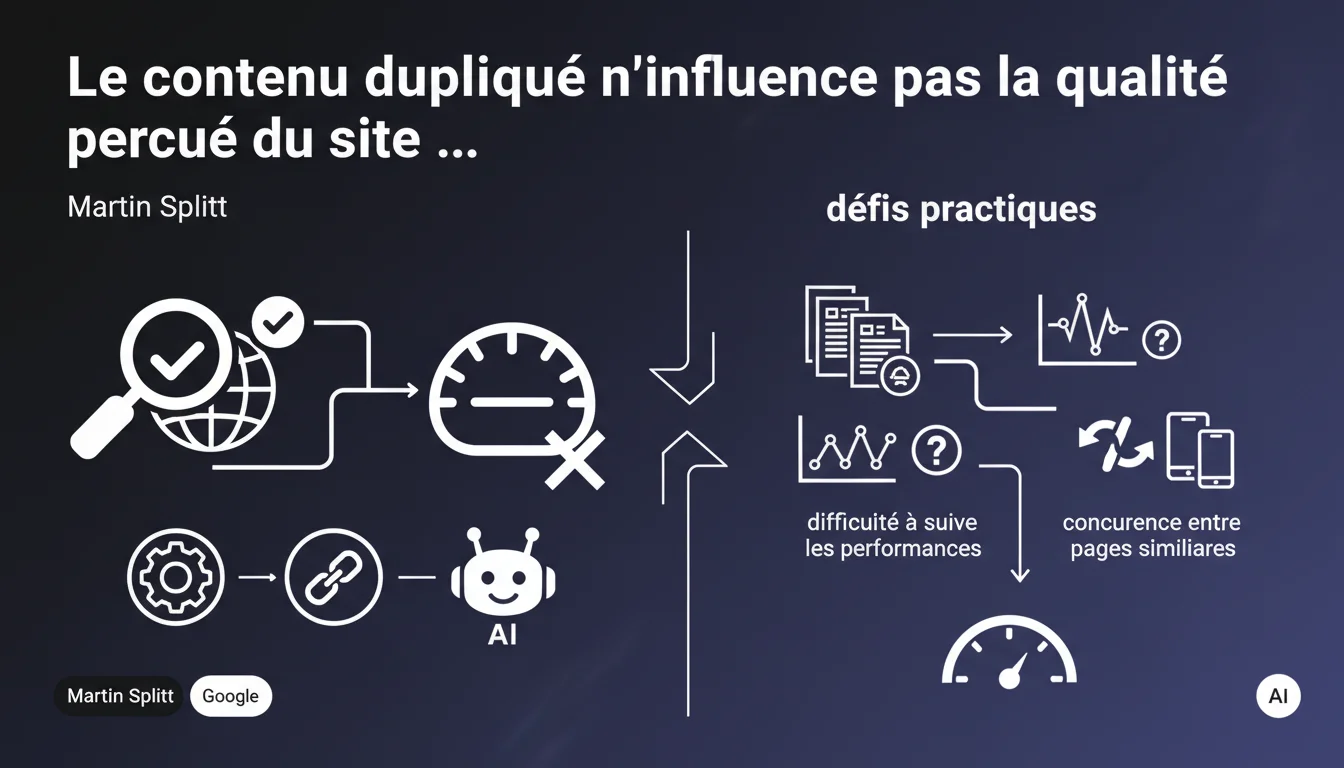

Google affirme que le contenu dupliqué n'affecte pas négativement la perception de qualité d'un site ni son classement. En revanche, il complique le suivi des performances et crée une cannibalisation entre pages similaires qui peut diluer votre visibilité.

Ce qu'il faut comprendre

Qu'entend Google exactement par "contenu dupliqué" ?

Google désigne par là les contenus identiques ou très similaires présents sur plusieurs URLs, que ce soit au sein d'un même domaine ou sur des sites différents. Contrairement à l'idée reçue, cela n'enclenche aucune pénalité algorithmique.

Le moteur gère cette situation en filtrant les doublons lors de l'affichage des résultats. Une seule version est généralement sélectionnée pour être montrée, les autres étant écartées — mais pas sanctionnées.

Pourquoi Martin Splitt insiste-t-il sur l'absence d'impact sur la qualité perçue ?

Parce que pendant des années, la communauté SEO a cru — et certains croient encore — qu'avoir du contenu dupliqué dégraderait la confiance que Google accorde à un site. C'est faux.

Google ne considère pas le duplicate content comme un signal de spam ou de low-quality. Il le traite comme un problème technique de choix d'URL, pas comme un défaut de contenu.

Quels sont alors les vrais risques du contenu dupliqué ?

Le problème n'est pas algorithmique, il est opérationnel. Quand plusieurs pages similaires existent, Google doit choisir laquelle afficher. Et ce choix n'est pas toujours celui que vous souhaiteriez.

Résultat : vous perdez du contrôle. Vos efforts SEO se dispersent, vos backlinks se diluent, et votre tracking Analytics devient un casse-tête.

- Le contenu dupliqué n'est pas une pénalité ni un facteur de déclassement

- Il complique le suivi des performances et dilue les signaux SEO

- Google filtre les doublons mais ne choisit pas toujours la version canonique que vous préférez

- La cannibalisation entre pages similaires réduit leur visibilité individuelle

- Les backlinks pointant vers différentes versions du même contenu perdent en concentration de jus

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, globalement. Les sites avec beaucoup de duplicate content ne sont pas systématiquement pénalisés, on le constate régulièrement. Les boutiques e-commerce avec des fiches produits identiques, les agrégateurs de contenu, les sites multilingues — aucun n'est frappé par une action manuelle pour cette raison.

Ce qui pose problème, c'est quand le duplicate empêche Google de comprendre quelle page indexer. Là, on voit des fluctuations de positions, des pages qui switchen dans les SERPs, parfois la mauvaise URL qui se positionne. Pas de chute brutale, plutôt une performance sous-optimale.

Quelles nuances faut-il apporter à cette affirmation ?

Dire que le duplicate n'affecte pas la qualité perçue, c'est vrai dans l'absolu. Mais dans certains cas limites, ça peut indirectement jouer contre vous.

Prenons un site qui scrape massivement du contenu ailleurs. Techniquement, Google ne le pénalise pas pour duplicate. Mais le manque de contenu original et utile peut déclencher d'autres signaux négatifs — notamment liés aux critères E-E-A-T ou au Helpful Content System. Ce n'est plus du duplicate pur, c'est un problème de valeur ajoutée.

Autre cas : si votre site est majoritairement composé de pages dupliquées avec peu de contenu unique, Google peut réduire votre crawl budget. Pas une pénalité, juste une priorisation à la baisse. [A vérifier] : Google n'a jamais clarifié le seuil exact où cela devient problématique.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Quand le duplicate est le résultat d'une manipulation délibérée pour créer de multiples points d'entrée artificiels, Google peut considérer ça comme du spam. On sort alors du simple duplicate technique.

De même, si vous republiez systématiquement du contenu d'autres sites sans autorisation ni valeur ajoutée, vous risquez une action manuelle pour thin content ou scraping — pas pour duplicate en soi, mais pour violation des guidelines.

Impact pratique et recommandations

Que faut-il faire concrètement pour gérer le contenu dupliqué ?

D'abord, identifier les doublons sur votre site. Utilisez un crawler (Screaming Frog, Sitebulb, OnCrawl) pour détecter les contenus identiques ou quasi-identiques. Concentrez-vous sur les pages stratégiques, pas sur les doublons mineurs de footer.

Ensuite, choisissez une stratégie de consolidation. Si plusieurs URLs présentent le même contenu, déterminez laquelle doit être visible et redirigez les autres en 301. Si les pages doivent coexister (filtres, variantes produit), utilisez la balise canonical pour indiquer votre préférence.

Pour les contenus syndiqués ou republiés ailleurs, assurez-vous que la version originale est indexée en premier. Publiez d'abord sur votre site avant toute diffusion externe, et demandez aux partenaires d'inclure un canonical vers votre URL.

Quelles erreurs éviter absolument ?

Ne bloquez jamais les pages dupliquées via robots.txt. Google a besoin de les crawler pour comprendre qu'elles sont identiques et appliquer le canonical. Un blocage empêche cette détection.

Évitez les canonicals circulaires ou contradictoires — c'est une source fréquente de confusion pour le moteur. Une page A qui pointe vers B, qui elle-même pointe vers C, c'est le meilleur moyen de perdre le contrôle.

Ne vous dispersez pas à chasser chaque micro-doublon. Concentrez-vous sur les pages avec du trafic ou du potentiel SEO. Le perfectionnisme excessif fait perdre du temps sans ROI mesurable.

Comment vérifier que votre gestion du duplicate est efficace ?

Suivez dans la Search Console les URLs exclues pour duplicate. Si vous voyez des pages importantes dans cette catégorie, c'est qu'il y a un problème de canonicalisation à corriger.

Utilisez l'outil d'inspection d'URL pour vérifier quelle version Google considère comme canonique. Si ce n'est pas celle que vous avez définie, creusez : canonical ignoré, signaux contradictoires, ou simplement Google qui en décide autrement.

Monitorer vos positions et votre trafic par groupe de pages similaires. Si vous constatez une cannibalisation (plusieurs URLs qui alternent en SERP pour la même requête), c'est le signal d'une consolidation nécessaire.

- Crawler régulièrement votre site pour identifier les contenus dupliqués

- Définir une URL canonique claire pour chaque groupe de pages similaires

- Rediriger en 301 les doublons inutiles vers la version principale

- Utiliser la balise canonical sur les variantes devant coexister

- Ne jamais bloquer les duplicates via robots.txt

- Vérifier dans la Search Console que Google respecte vos canonicals

- Monitorer les fluctuations de positions pouvant indiquer une cannibalisation

- Publier votre contenu original avant toute syndication externe

❓ Questions frequentes

Google pénalise-t-il vraiment les sites avec du contenu dupliqué ?

La balise canonical suffit-elle à résoudre tous les problèmes de duplicate ?

Dois-je bloquer les pages dupliquées dans le robots.txt ?

Comment savoir si mon site souffre de cannibalisation SEO ?

Le contenu syndiqué ou republié peut-il nuire à mon SEO ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/11/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.