Declaration officielle

Ce qu'il faut comprendre

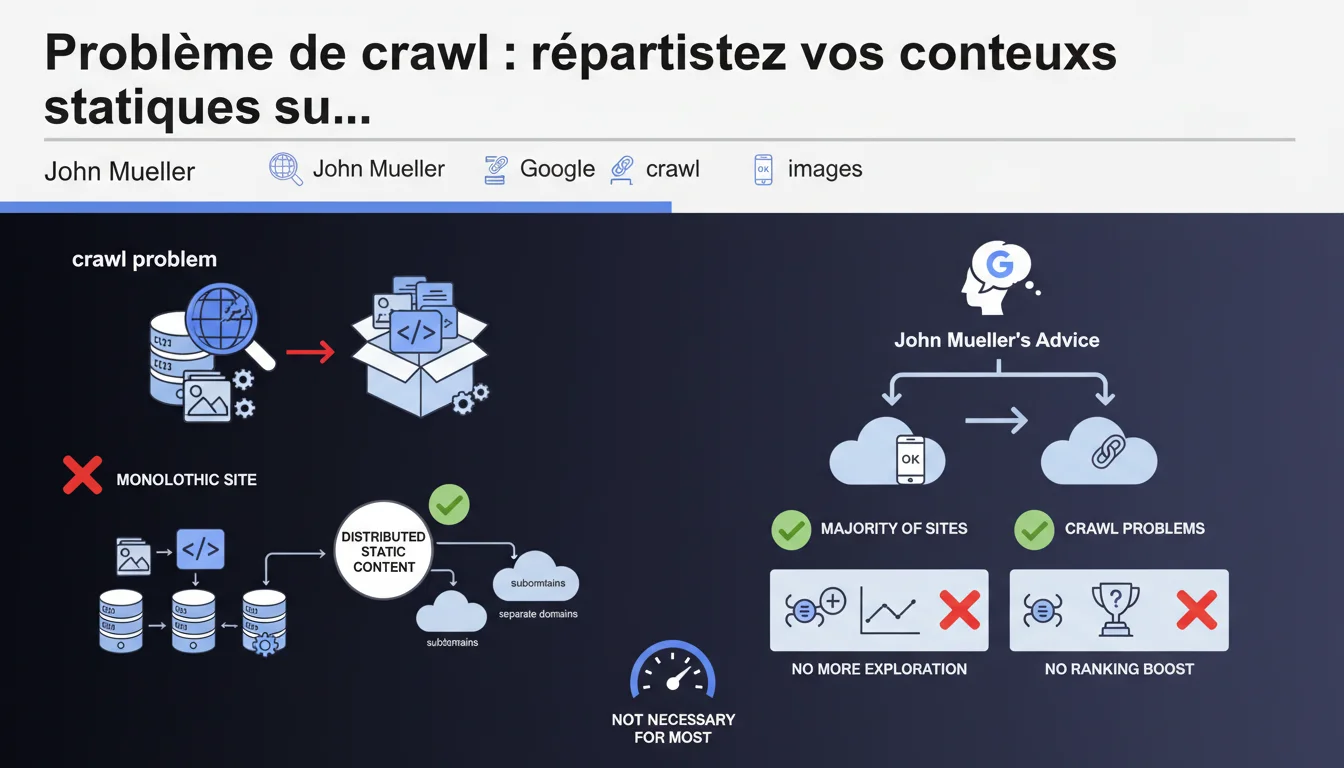

Google rappelle une technique parfois utilisée en SEO technique : la distribution des ressources statiques (images, CSS, JavaScript) sur des sous-domaines ou domaines séparés. L'objectif initial est de contourner les limitations de connexions simultanées des navigateurs et potentiellement d'optimiser le budget de crawl.

Cependant, la précision apportée est essentielle : cette approche ne convainc pas Google de crawler davantage vos pages. Le budget de crawl alloué à votre site ne sera pas augmenté simplement parce que vous distribuez vos ressources statiques. Google gère son exploration en fonction de multiples facteurs comme l'autorité du site, la fraîcheur du contenu et la qualité globale.

Plus important encore, il faut bien comprendre que davantage de crawl ne garantit absolument pas un meilleur positionnement. L'exploration est nécessaire pour l'indexation, mais ce sont les signaux de qualité, de pertinence et d'expérience utilisateur qui déterminent le classement.

- La distribution sur plusieurs domaines concerne principalement les très gros sites avec des problèmes de crawl avérés

- Cette technique n'augmente pas le budget de crawl alloué par Google

- Plus de pages crawlées ≠ meilleur classement dans les résultats de recherche

- La majorité des sites n'ont pas besoin de cette optimisation

Avis d'un expert SEO

Cette clarification est particulièrement bienvenue car elle démystifie une pratique souvent mal comprise. Beaucoup de SEO pensent encore que distribuer les ressources statiques est une optimisation systématique, alors qu'il s'agit d'une solution à un problème spécifique : les sites avec des millions de pages et des contraintes réelles de crawl.

Dans la pratique, j'observe que les sites de taille moyenne (moins de 100 000 pages) n'ont généralement aucun bénéfice SEO mesurable à cette approche. Par contre, elle peut compliquer la configuration technique, augmenter les risques d'erreurs CORS, et rendre le suivi analytics plus complexe. Le jeu n'en vaut rarement la chandelle.

Les vrais bénéfices de cette technique se situent surtout côté performance utilisateur (parallélisation des téléchargements, optimisation CDN) plutôt que SEO pur. Si vous l'implémentez, faites-le pour les bonnes raisons.

Impact pratique et recommandations

- N'implémentez pas la distribution de ressources statiques si votre site fait moins de 50 000 pages indexables

- Analysez d'abord votre budget de crawl réel via la Search Console (rapport Statistiques sur l'exploration) avant toute décision

- Vérifiez que vos pages stratégiques sont bien crawlées régulièrement - c'est plus important que le volume total

- Optimisez votre structure de liens internes et réduisez la profondeur de clic si certaines pages ne sont pas explorées

- Éliminez les pages inutiles du crawl (facettes, duplicatas) via robots.txt ou noindex plutôt que de distribuer les ressources

- Utilisez un CDN performant pour vos ressources statiques - c'est bénéfique pour l'UX sans compliquer l'architecture

- Ne comptez pas sur plus de crawl pour améliorer vos positions - travaillez plutôt la qualité et la pertinence du contenu

- Si vous avez réellement un problème de crawl sur un très gros site (e-commerce, médias, annuaires), documentez-le précisément avec des données avant d'agir

La gestion du budget de crawl et l'optimisation de l'architecture technique pour les sites de grande envergure nécessitent une expertise pointue et une analyse approfondie des logs serveur, des données Search Console et du comportement réel de Googlebot. Ces optimisations touchent à des aspects critiques de l'infrastructure et peuvent avoir des conséquences importantes si mal exécutées.

Pour les sites complexes confrontés à de véritables enjeux de crawl, l'accompagnement par une agence SEO spécialisée en SEO technique peut s'avérer judicieux. Un audit technique approfondi permettra d'identifier les véritables goulots d'étranglement et de prioriser les actions réellement impactantes, plutôt que d'appliquer des recettes toutes faites qui ne correspondent peut-être pas à votre contexte spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.