Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ La balise meta robots noindex suffit-elle vraiment à empêcher l'indexation d'une page ?

- □ Peut-on vraiment piloter Googlebot News et Googlebot Search avec des balises meta robots distinctes ?

- □ Peut-on vraiment empiler plusieurs directives meta robots dans une seule balise ?

- □ L'en-tête HTTP X-Robots peut-il remplacer la balise meta robots ?

- □ Où faut-il vraiment placer le fichier robots.txt pour qu'il soit pris en compte ?

- □ Faut-il gérer un robots.txt distinct pour chaque sous-domaine ?

- □ Le fichier robots.txt est-il vraiment respecté par tous les moteurs de recherche ?

- □ Faut-il utiliser les wildcards dans robots.txt pour mieux contrôler son crawl ?

- □ Faut-il vraiment déclarer son sitemap XML dans le fichier robots.txt ?

- □ Pourquoi robots.txt empêche-t-il Google de désindexer vos pages ?

- □ Robots.txt bloque-t-il vraiment l'indexation de vos pages ?

- □ Le rapport robots.txt de Google Search Console change-t-il vraiment la donne pour le crawl ?

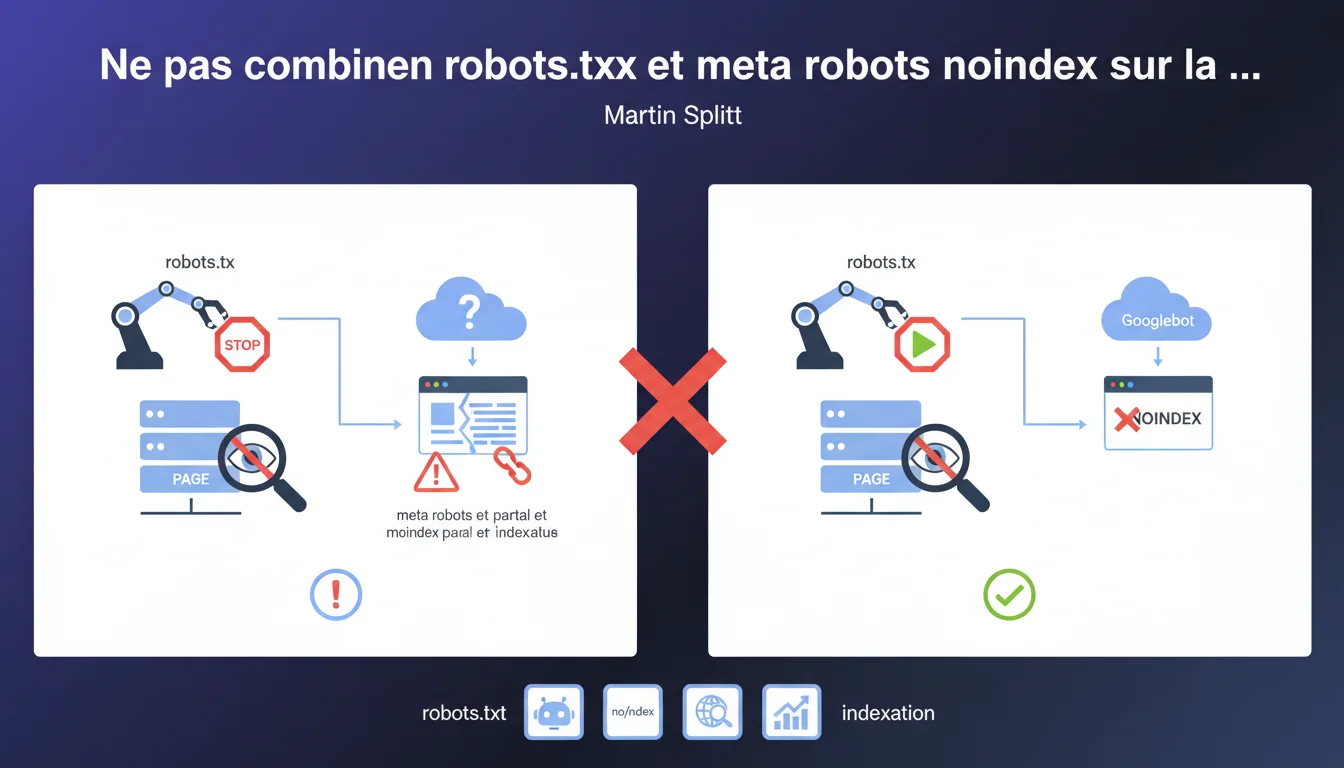

Bloquer une page dans robots.txt tout en y plaçant une meta robots noindex crée un paradoxe : Googlebot ne peut pas accéder à la page pour lire la directive noindex, ce qui peut paradoxalement entraîner son indexation avec des informations limitées. C'est l'inverse de l'effet recherché.

Ce qu'il faut comprendre

En quoi consiste exactement ce conflit de directives ?

Le problème repose sur une logique séquentielle simple : robots.txt agit en amont du crawl, tandis que la balise meta noindex n'est lue qu'une fois le bot sur la page. Si vous bloquez l'accès dans robots.txt, Googlebot n'ira jamais chercher le HTML — donc ne verra jamais votre instruction noindex.

Résultat ? Google sait que la page existe (via des backlinks, sitemaps, ou liens internes), mais ne peut pas explorer son contenu pour comprendre qu'elle ne doit pas être indexée. Il peut alors décider de l'indexer quand même, avec un titre générique et sans description.

Pourquoi Google indexerait-il une page qu'il ne peut pas crawler ?

Soyons honnêtes : ça paraît contre-intuitif. Mais Google indexe parfois des URLs bloquées dans robots.txt s'il détecte suffisamment de signaux externes (ancres de liens, mentions, etc.). L'URL apparaît dans les résultats avec la mention « Aucune information disponible sur cette page ».

C'est exactement ce que vous vouliez éviter avec votre noindex — sauf que vous avez rendu la balise inaccessible. Un classique du tir dans le pied.

Quelle est la logique technique derrière ce comportement ?

Le fichier robots.txt fonctionne comme un filtre de crawl, pas comme une directive d'indexation. Google le respecte scrupuleusement : pas d'accès = pas de crawl. Point.

La meta noindex, elle, nécessite un crawl pour être détectée. Elle dit « tu peux venir voir, mais ne m'indexe pas ». Si vous combinez les deux, vous créez une instruction contradictoire que Google résout à sa manière — généralement pas celle que vous espériez.

- robots.txt bloque l'accès avant toute exploration

- meta noindex nécessite un crawl pour être lue

- Combiner les deux empêche Google de voir la directive noindex

- Google peut quand même indexer l'URL avec des infos limitées si elle est référencée ailleurs

- La solution : choisir l'une ou l'autre, jamais les deux simultanément

Avis d'un expert SEO

Cette déclaration reflète-t-elle réellement les comportements observés sur le terrain ?

Absolument. On observe régulièrement ce scénario : des pages bloquées dans robots.txt qui apparaissent quand même dans l'index avec la fameuse mention « Aucune information disponible ». C'est frustrant, mais cohérent avec la mécanique expliquée par Splitt.

Ce qui manque — et c'est dommage — c'est une précision sur la fréquence de ce phénomène. Toutes les pages bloquées ne finissent pas indexées. Ça dépend du volume de backlinks, de la notoriété du domaine, de signaux sociaux éventuels. [À vérifier] : existe-t-il un seuil quantifiable de liens externes au-delà duquel Google force l'indexation malgré robots.txt ?

Dans quels cas cette règle mérite-t-elle d'être nuancée ?

Il existe des situations où vous n'avez pas le choix — du moins temporairement. Imaginons une migration de site : vous voulez désindexer l'ancien tout en bloquant son crawl pour concentrer le budget sur le nouveau. Bloquer dans robots.txt + noindex peut sembler logique.

Mais attention : si l'ancien site a encore des backlinks actifs, vous risquez l'effet inverse. Mieux vaut alors utiliser uniquement noindex avec un crawl autorisé, quitte à gérer le crawl budget autrement (vitesse serveur, pagination, etc.).

Quelle est la vraie bonne pratique selon les observations SEO avancées ?

Si vous voulez désindexer une page, utilisez meta noindex (ou X-Robots-Tag) et laissez Googlebot y accéder. Une fois désindexée, vous pouvez éventuellement bloquer dans robots.txt pour économiser du crawl budget — mais seulement après confirmation de la suppression de l'index.

Si vous voulez empêcher le crawl sans risque d'indexation partielle, utilisez robots.txt seul et supprimez tous les liens internes + backlinks vers cette URL. Pas de signaux = pas d'indexation fantôme. Mais c'est rarement réalisable à 100 %.

Impact pratique et recommandations

Que faut-il faire concrètement si vous êtes dans cette situation ?

Première étape : auditer votre site pour identifier les pages bloquées dans robots.txt qui contiennent quand même une balise noindex. Screaming Frog peut le faire, mais attention — il respecte robots.txt par défaut. Configurez-le pour ignorer ce fichier lors de l'audit.

Ensuite, décidez quelle directive garder. Vous voulez empêcher l'indexation ? Retirez le blocage robots.txt et laissez le noindex faire son job. Vous voulez bloquer le crawl ? Supprimez la balise noindex et assurez-vous qu'aucun lien interne ou backlink actif ne pointe vers cette page.

Comment vérifier que votre configuration est cohérente ?

Utilisez Google Search Console, onglet Couverture. Les pages bloquées par robots.txt mais indexées apparaissent souvent sous « Exclues » avec le statut « Bloquée par le fichier robots.txt ». Si elles sont quand même dans l'index, vous verrez un conflit.

Testez aussi avec l'outil d'inspection d'URL. Si une page est bloquée dans robots.txt, GSC vous le dira clairement avant même de tester le rendu. Vous saurez immédiatement si votre noindex est inaccessible.

- Crawler votre site en ignorant robots.txt pour détecter les doublons de directives

- Identifier les pages bloquées dans robots.txt qui ont quand même des backlinks actifs

- Choisir : noindex (avec crawl autorisé) OU robots.txt (sans liens entrants)

- Utiliser GSC pour confirmer que les pages noindex sont bien crawlées puis désindexées

- Ne bloquer dans robots.txt qu'après confirmation de la désindexation si vous voulez économiser du crawl budget

- Supprimer les liens internes vers toute page bloquée dans robots.txt pour éviter l'indexation fantôme

❓ Questions frequentes

Peut-on utiliser X-Robots-Tag au lieu de meta noindex si la page est bloquée dans robots.txt ?

Que se passe-t-il si une page bloquée dans robots.txt reçoit beaucoup de backlinks ?

Faut-il d'abord retirer le blocage robots.txt ou d'abord ajouter le noindex ?

Est-ce que Google Search Console signale ce type de conflit ?

Peut-on utiliser robots.txt pour bloquer temporairement une page en cours de développement ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/12/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.