Declaration officielle

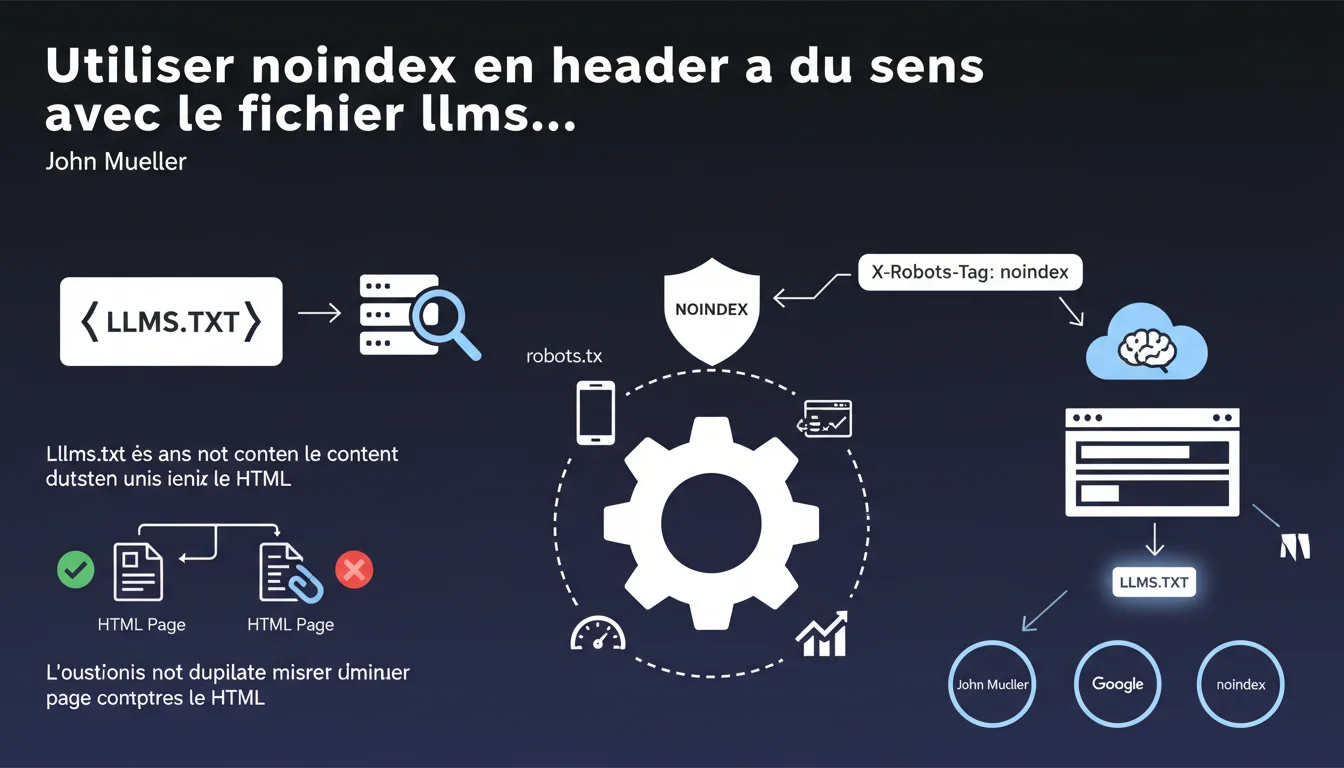

Cependant, Mueller recommande d'utiliser un en-tête noindex pour ces fichiers. Sa justification est d’ordre purement pratique : des sites externes pourraient créer des liens vers ces fichiers llms.txt, ce qui pourrait les faire indexer par Google et créer une expérience « étrange » pour les utilisateurs qui tomberaient dessus dans les résultats de recherche. L'utilisation d'un noindex empêche le contenu d'entrer dans l'index de Google, contrairement au blocage via robots.txt qui empêcherait simplement Google de crawler le fichier et donc de voir la directive noindex.

Ce qu'il faut comprendre

Les fichiers llms.txt sont une nouvelle pratique émergente dans l'écosystème du SEO et de l'intelligence artificielle. Ils permettent de fournir aux modèles de langage (LLMs) une version structurée en Markdown du contenu principal d'un site web.

Contrairement aux fichiers robots.txt qui contrôlent le crawl, les fichiers llms.txt servent un objectif totalement différent : ils facilitent la compréhension du contenu par les IA. Ils sont placés à la racine du domaine et contiennent une représentation formatée du contenu éditorial.

La question du contenu dupliqué se pose légitimement : ces fichiers contiennent-ils du duplicate content ? La réponse officielle est rassurante. Un fichier llms.txt ne sera considéré comme dupliqué que si son contenu est strictement identique à une page HTML, ce qui n'aurait aucun sens pratique.

Les points essentiels à retenir :

- Les fichiers llms.txt ne créent pas de problème de contenu dupliqué par nature

- Ils utilisent un format Markdown distinct des pages HTML classiques

- Ils peuvent être liés depuis des sites externes, ce qui pose un risque d'indexation

- L'utilisation d'un en-tête noindex est recommandée pour éviter leur apparition dans les SERP

- Il ne faut pas bloquer ces fichiers via robots.txt car cela empêcherait Google de voir la directive noindex

Avis d'un expert SEO

Cette recommandation est parfaitement cohérente avec les meilleures pratiques SEO concernant la gestion de l'indexation. L'utilisation d'un en-tête noindex plutôt qu'un blocage robots.txt démontre une compréhension fine de la différence entre crawl et indexation.

La logique est imparable : si vous bloquez le fichier llms.txt dans robots.txt, Googlebot ne pourra jamais le crawler et donc jamais voir la directive noindex. Le fichier pourrait alors être indexé sur la base de signaux externes (liens entrants, mentions) sans que Google ne connaisse son contenu réel. C'est exactement le scénario à éviter.

L'argument de l'expérience utilisateur est également pertinent. Un internaute qui tomberait sur un fichier llms.txt dans les résultats de recherche serait face à du contenu brut en Markdown, peu lisible et hors contexte. Cette mauvaise expérience pourrait affecter la perception de qualité de votre site.

Impact pratique et recommandations

Suite à cette clarification officielle, voici les actions concrètes à mettre en œuvre pour gérer correctement vos fichiers llms.txt :

- Créez ou mettez à jour votre fichier llms.txt avec une version Markdown structurée de votre contenu principal

- Ajoutez un en-tête HTTP noindex à votre fichier llms.txt (X-Robots-Tag: noindex)

- Vérifiez que le fichier llms.txt n'est pas bloqué dans robots.txt pour permettre le crawl et la lecture de la directive noindex

- Testez l'en-tête avec des outils comme curl ou les DevTools de votre navigateur pour confirmer sa présence

- Surveillez dans la Search Console que le fichier n'apparaît pas dans les pages indexées

- Documentez cette configuration dans votre documentation technique SEO pour les futures mises à jour

- Évitez de créer des liens internes vers ce fichier depuis vos pages HTML classiques

- Si vous utilisez un CDN ou un cache, assurez-vous que les en-têtes HTTP sont correctement transmis

La gestion des fichiers llms.txt représente une nouvelle dimension technique du SEO moderne, à l'intersection de l'optimisation traditionnelle et de l'ère de l'intelligence artificielle.

L'implémentation correcte des en-têtes HTTP, la compréhension fine des directives d'indexation et l'équilibre entre accessibilité pour les IA et protection contre l'indexation inappropriée requièrent une expertise technique approfondie.

Pour les sites à forte volumétrie ou les architectures complexes, ces optimisations peuvent s'avérer délicates à orchestrer sans risque. Un accompagnement par une agence SEO spécialisée permet de bénéficier d'une analyse personnalisée de votre contexte, d'une implémentation sécurisée et d'un suivi des impacts, garantissant ainsi que votre stratégie d'optimisation pour les IA ne compromette pas votre visibilité organique classique.

💬 Commentaires (0)

Soyez le premier à commenter.