Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ La balise meta robots noindex suffit-elle vraiment à empêcher l'indexation d'une page ?

- □ Peut-on vraiment piloter Googlebot News et Googlebot Search avec des balises meta robots distinctes ?

- □ L'en-tête HTTP X-Robots peut-il remplacer la balise meta robots ?

- □ Où faut-il vraiment placer le fichier robots.txt pour qu'il soit pris en compte ?

- □ Faut-il gérer un robots.txt distinct pour chaque sous-domaine ?

- □ Le fichier robots.txt est-il vraiment respecté par tous les moteurs de recherche ?

- □ Faut-il utiliser les wildcards dans robots.txt pour mieux contrôler son crawl ?

- □ Faut-il vraiment déclarer son sitemap XML dans le fichier robots.txt ?

- □ Pourquoi ne faut-il jamais combiner robots.txt et meta noindex sur la même page ?

- □ Pourquoi robots.txt empêche-t-il Google de désindexer vos pages ?

- □ Robots.txt bloque-t-il vraiment l'indexation de vos pages ?

- □ Le rapport robots.txt de Google Search Console change-t-il vraiment la donne pour le crawl ?

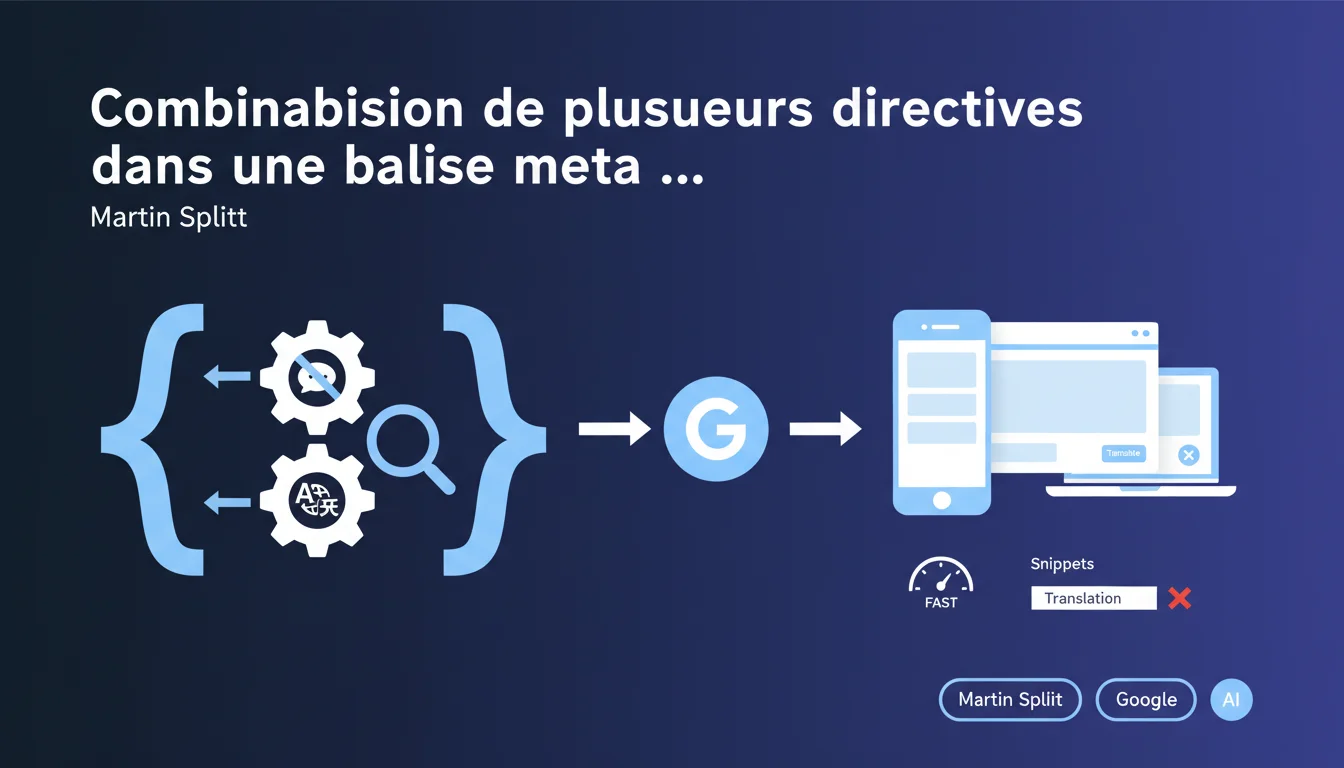

Google confirme qu'on peut combiner plusieurs directives dans une même balise meta robots — par exemple nosnippet ET notranslate simultanément. Cette pratique permet d'éviter la multiplication des balises et simplifie le code HTML. Concrètement, c'est un gain de propreté technique sans impact négatif sur le crawl.

Ce qu'il faut comprendre

Pourquoi cette précision de Google maintenant ?

La question revient régulièrement : faut-il créer plusieurs balises meta robots pour chaque directive, ou peut-on les regrouper ? Martin Splitt met fin au débat en validant explicitement la combinaison dans une seule balise. Cette approche est d'ailleurs recommandée dans la documentation officielle depuis longtemps, mais nombre de SEO hésitaient encore.

Le doute provenait surtout de retours terrain contradictoires — certains observant des comportements étranges avec des combinaisons complexes. Google clarifie donc : techniquement, ça fonctionne parfaitement. Le moteur parse la balise et applique chaque directive listée, sans hiérarchie ni conflit.

Quelles directives peut-on combiner concrètement ?

Toutes les directives meta robots standards sont compatibles : noindex, nofollow, nosnippet, notranslate, noarchive, noimageindex, max-snippet, max-image-preview, max-video-preview. Vous pouvez donc écrire <meta name="robots" content="noindex, nofollow, nosnippet"> sans risque.

Attention toutefois aux directives contradictoires. Combiner index ET noindex dans la même balise relève de l'absurde — Google appliquera la directive la plus restrictive. De même, max-snippet:0 est équivalent à nosnippet, inutile de les cumuler.

Quel impact sur le crawl et l'indexation ?

Aucun impact négatif mesuré. Googlebot traite la balise meta robots comme n'importe quel élément HTML : il la lit, parse les directives séparées par des virgules, et applique chacune. Pas de surcoût de crawl, pas de ralentissement. Le nombre de balises n'influence ni le crawl budget ni la vitesse d'indexation.

- Une seule balise meta robots suffit pour toutes vos directives — inutile de multiplier.

- Les directives sont séparées par des virgules et traitées indépendamment par Googlebot.

- Pas de hiérarchie entre les directives : toutes s'appliquent simultanément.

- Évitez les doublons ou contradictions dans une même balise (ex: index, noindex).

- Cette syntaxe fonctionne aussi bien avec

name="robots"qu'avecname="googlebot"pour cibler spécifiquement Google.

Avis d'un expert SEO

Cette déclaration change-t-elle quoi que ce soit sur le terrain ?

Soyons honnêtes : non. La plupart des SEO aguerris empilaient déjà plusieurs directives dans une balise meta robots sans se poser de questions. Cette confirmation de Martin Splitt relève plus de la validation officielle que de la révélation technique. Elle rassure ceux qui doutaient encore, rien de plus.

Le vrai intérêt, c'est la clarification pour les edge cases. Certains CMS ou plugins WordPress généraient des balises multiples par défaut — créant du code redondant. Maintenant, on peut affirmer sans équivoque qu'une seule balise regroupant toutes les directives est strictement équivalente et même préférable pour la propreté du HTML.

Y a-t-il des cas où cette règle pourrait coincer ?

Oui, dans les scénarios de ciblage différencié. Si vous voulez appliquer des directives spécifiques à Googlebot et d'autres à Bingbot, vous devrez créer deux balises distinctes : name="googlebot" et name="bingbot". Impossible de tout regrouper dans une seule balise name="robots" si vous visez des comportements différents par moteur.

Autre nuance : certaines directives comme max-snippet ou max-image-preview acceptent des valeurs numériques. Si vous combinez max-snippet:150, max-image-preview:large, vérifiez que votre CMS ou framework n'ajoute pas d'espaces parasites après les virgules — certains parsers mal codés pourraient mal interpréter. [À vérifier] sur vos environnements spécifiques, surtout si vous utilisez du JavaScript pour générer les balises côté client.

Faut-il auditer son site pour corriger des balises multiples ?

Pas une priorité critique. Si votre site affiche plusieurs balises meta robots successives pour des directives différentes, Google les fusionnera mentalement et appliquera l'ensemble. Aucun impact négatif mesuré — juste du code moins propre.

Cela dit, lors d'un refonte ou d'une optimisation technique, profitez-en pour consolider vos balises. Moins de lignes HTML = meilleure lisibilité pour les audits, debugging facilité, templates CMS plus clairs. C'est du confort développeur, pas une urgence SEO.

Impact pratique et recommandations

Que faut-il faire concrètement sur son site ?

Auditez vos templates de pages pour identifier les balises meta robots multiples. Si vous en trouvez plusieurs par page pour des directives différentes, regroupez-les dans une seule balise séparée par des virgules. Exemple : au lieu de <meta name="robots" content="noindex"><meta name="robots" content="nofollow">, écrivez <meta name="robots" content="noindex, nofollow">.

Sur WordPress, Yoast SEO et Rank Math gèrent déjà cette syntaxe correctement — mais certains plugins tiers ou custom codes peuvent générer des doublons. Vérifiez le HTML source de vos pages critiques (homepage, catégories, fiches produits) pour détecter les anomalies.

Quelles erreurs éviter absolument ?

Ne combinez jamais des directives contradictoires dans la même balise. Écrire content="index, noindex" n'a aucun sens — Google appliquera la directive la plus restrictive (noindex). Même logique pour follow/nofollow.

Évitez aussi les espaces parasites après les virgules si votre environnement technique est sensible. La norme HTML accepte noindex, nofollow et noindex,nofollow indifféremment, mais certains parsers maison peuvent bugger. Testez sur vos outils internes.

Comment vérifier que tout fonctionne correctement ?

Utilisez l'outil d'inspection d'URL de la Google Search Console. Collez l'URL concernée, cliquez sur "Tester l'URL en direct", puis consultez l'onglet "HTML" dans les détails. Google affichera les directives meta robots détectées — vous verrez si toutes vos combinaisons sont bien parsées.

Complétez avec un crawl Screaming Frog ou Sitebulb pour scanner l'ensemble du site. Filtrez les pages avec plusieurs balises meta robots, puis vérifiez si elles portent les mêmes directives (redondance inutile) ou des directives différentes (à consolider).

- Regrouper toutes les directives meta robots dans une seule balise par page

- Séparer les directives par des virgules sans contradiction (pas de index+noindex)

- Vérifier la syntaxe dans l'outil d'inspection d'URL Google Search Console

- Crawler le site avec Screaming Frog pour détecter les balises multiples ou doublons

- Tester les pages critiques en conditions réelles après modification (cache CDN, JavaScript client-side)

- Documenter les choix de directives dans un guide interne pour éviter les erreurs futures

❓ Questions frequentes

Peut-on combiner noindex et nofollow dans la même balise meta robots ?

Si j'ai deux balises meta robots successives avec des directives différentes, que se passe-t-il ?

Les directives X-Robots-Tag HTTP header prennent-elles le dessus sur les meta robots ?

Faut-il mettre des espaces après les virgules dans content="noindex, nofollow" ?

Peut-on combiner max-snippet:150 et nosnippet dans la même balise ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/12/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.