Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Faut-il vraiment se préoccuper du crawl budget pour votre site ?

- □ Comment Google définit-il réellement le crawl budget et quels leviers peut-on actionner ?

- □ Le crawl budget est-il un concept inventé par Google ou par les SEO ?

- □ Google n'indexe-t-il vraiment qu'une fraction du web à cause de ses coûts de stockage ?

- □ Les requêtes POST plombent-elles vraiment votre crawl budget ?

- □ Le crawl budget d'une nouvelle section est-il hérité de la qualité du site principal ?

- □ Les codes 503 et 429 peuvent-ils vraiment réduire votre crawl budget ?

- □ HTTP/2 améliore-t-il vraiment votre crawl budget ?

- □ Pourquoi vos URLs 'découvertes mais non crawlées' révèlent-elles un problème de fond ?

- □ Faut-il bloquer l'indexation de vos fichiers JavaScript pour optimiser le crawl budget ?

- □ Les 404 et robots.txt gaspillent-ils vraiment votre crawl budget ?

- □ Faut-il bloquer vos fichiers JavaScript décoratifs pour optimiser votre crawl budget ?

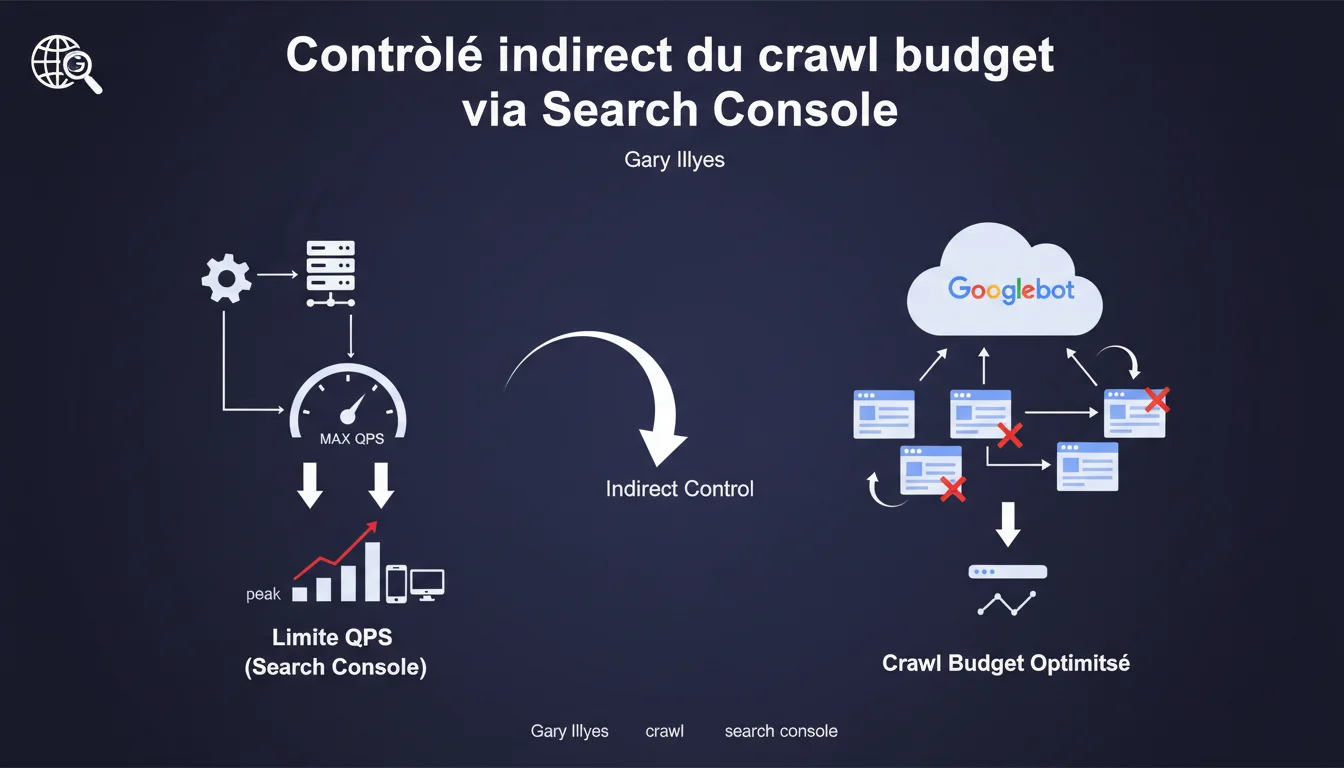

Google confirme que les webmasters peuvent contrôler indirectement leur crawl budget via les statistiques d'exploration de Search Console. Le principal levier : limiter le nombre maximum de requêtes par seconde (QPS) de Googlebot pour éviter de surcharger le serveur. Un contrôle partiel donc, pas total.

Ce qu'il faut comprendre

Qu'entend Google par "contrôle indirect" du crawl budget ?

Gary Illyes le dit clairement : le contrôle est indirect. Vous ne dictez pas à Google quelles pages explorer en priorité, ni à quelle fréquence revenir sur tel ou tel segment de votre site. Ce qui est à votre disposition, c'est un limiteur de débit — un plafond de QPS (queries per second) que vous fixez dans Search Console pour éviter que Googlebot ne mette vos serveurs à genoux.

Concrètement, vous protégez votre infrastructure. Vous ne gérez pas la stratégie de crawl de Google, vous limitez la casse technique. Nuance de taille.

Pourquoi limiter le nombre de requêtes par seconde de Googlebot ?

Parce que Googlebot peut être gourmand. Sur un site avec des milliers (ou des millions) d'URLs, des pics de crawl peuvent provoquer des ralentissements serveur, voire des erreurs 500 ou 503 si votre infrastructure n'est pas dimensionnée pour encaisser la charge.

Limiter le QPS vous permet de lisser l'activité du bot. C'est particulièrement utile si votre serveur partage ses ressources avec d'autres services critiques — par exemple un site e-commerce dont le front-office doit rester fluide en permanence. Sacrifier un peu de vitesse de crawl pour garantir la disponibilité : c'est un arbitrage légitime.

Quels sont les risques d'une limitation trop stricte du QPS ?

Si vous bridez trop Googlebot, vous ralentissez la découverte et l'indexation de vos contenus. Sur un site à fort rythme de publication — un média, un gros e-commerce avec des milliers de fiches produits actualisées chaque jour — c'est un problème direct. Vos nouvelles pages mettront plus de temps à apparaître dans l'index.

L'équilibre est délicat. Trop lâche, vous risquez la saturation serveur. Trop serré, vous freinez votre propre indexation. Il faut tester, monitorer, ajuster en fonction de vos pics de trafic réels et de votre capacité serveur.

- Contrôle indirect : vous limitez la charge, pas la stratégie de crawl elle-même

- QPS ajustable dans les statistiques d'exploration de Search Console

- Objectif principal : protéger le serveur en période de pic de trafic

- Risque : une limitation trop stricte ralentit l'indexation de nouvelles pages

- Pas de contrôle fin sur quelles URLs sont crawlées en priorité ou à quelle fréquence

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, elle l'est. Les SEO qui gèrent des infrastructures complexes — plateformes e-commerce lourdes, sites médias à fort volume — savent que le crawl budget est une ressource limitée. Google n'a ni l'envie ni les moyens de crawler l'intégralité du web en continu à pleine vitesse. Limiter le QPS est donc un compromis pragmatique.

Maintenant, soyons honnêtes : ce n'est qu'un levier. Si votre architecture génère des millions d'URLs inutiles — paramètres de tri, de filtres, de sessions —, brider le QPS ne résoudra rien. Vous ralentissez juste l'hémorragie. Le vrai sujet reste l'optimisation structurelle du site.

Quelles nuances faut-il apporter à cette déclaration ?

Gary parle de "contrôle indirect" et c'est le mot-clé. Vous ne pilotez pas où Googlebot va, ni ce qu'il explore en priorité. Vous plafonnez simplement sa gourmandise technique. Le vrai pilotage du crawl budget passe ailleurs : qualité du maillage interne, profondeur des URLs, architecture logique, robots.txt, noindex stratégique, canonicals propres, pagination bien fichue, sitemap XML ciblé.

Autre point — [A vérifier] — : Google ne donne aucune indication chiffrée sur ce qu'est un QPS "raisonnable" ni sur l'impact réel d'une limitation sur la vitesse d'indexation. Tout est laissé à l'appréciation du webmaster. Aucune donnée publique sur la corrélation entre QPS limité et temps moyen d'indexation d'une nouvelle URL. On navigue à vue.

Dans quels cas ce réglage ne sert-il à rien ?

Si votre site génère moins de 50–100 pages par jour et que votre serveur tient la route, limiter le QPS n'aura aucun effet positif. Pire : vous risquez de freiner l'indexation sans raison valable. Ce levier est pertinent pour des sites à gros volume, pas pour un blog WordPress ou un petit site vitrine.

Impact pratique et recommandations

Que faut-il faire concrètement pour ajuster le QPS de Googlebot ?

Rendez-vous dans Google Search Console > Paramètres > Statistiques d'exploration. Vous y trouverez un graphique du nombre de requêtes par jour et, plus important, une option pour limiter le taux de crawl. Par défaut, Google gère seul. Si vous activez la limitation manuelle, vous pouvez fixer un plafond de requêtes par seconde.

Avant de toucher à ce réglage, analysez vos logs serveur pour identifier les pics de crawl et croiser avec vos pics de trafic réel. Si Googlebot crawle massivement pendant vos heures de forte affluence utilisateur, vous avez un motif légitime pour plafonner. Sinon, laissez faire.

Quelles erreurs éviter lors de la gestion du crawl budget ?

Ne confondez pas limitation du QPS et optimisation du crawl budget. Limiter le débit ne corrige pas une architecture de site pourrie. Si vous avez 10 000 URLs paginées inutiles, des facettes infinies, des doublons non canonicalisés, brider Googlebot ne fera que ralentir la découverte de vos pages utiles — sans rien régler au fond.

Autre erreur classique : activer la limitation sans monitorer l'impact. Si vous plafonnez trop bas, vous risquez de retarder l'indexation de nouvelles pages stratégiques — lancements produits, articles de fond, landing pages SEO. Suivez vos courbes d'indexation dans Search Console après chaque ajustement.

Comment vérifier si mon site bénéficie (ou souffre) de ce réglage ?

Comparez le taux de crawl moyen avant/après limitation dans les statistiques d'exploration. Regardez aussi le temps de téléchargement moyen d'une page : s'il chute après avoir limité le QPS, c'est bon signe — votre serveur respire mieux. À l'inverse, si le temps de téléchargement ne change pas mais que l'indexation ralentit, vous avez probablement trop serré la vis.

Croisez avec vos outils analytics : si vous publiez régulièrement et que le délai entre publication et apparition dans l'index s'allonge significativement, c'est un signal d'alerte. Ajustez alors le plafond à la hausse.

- Analyser les logs serveur pour identifier les pics de crawl

- Croiser pics de crawl avec pics de trafic utilisateur réel

- Activer la limitation QPS uniquement si surcharge serveur avérée

- Fixer un plafond prudent et monitorer l'impact sur l'indexation

- Comparer temps de téléchargement moyen avant/après dans Search Console

- Ne jamais limiter le QPS sans d'abord optimiser l'architecture du site

- Suivre la courbe d'indexation des nouvelles pages après chaque ajustement

- Réviser le réglage régulièrement en fonction de l'évolution du site

❓ Questions frequentes

Limiter le QPS ralentit-il forcément l'indexation de mon site ?

Peut-on cibler quelles sections du site Googlebot doit crawler en priorité ?

Quel est le QPS "idéal" pour éviter de surcharger mon serveur ?

Faut-il limiter le QPS si mon site est hébergé sur une infrastructure cloud scalable ?

Cette limitation s'applique-t-elle aussi à Googlebot pour images, vidéos, ou news ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/08/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.