Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Faut-il vraiment se préoccuper du crawl budget pour votre site ?

- □ Comment Google définit-il réellement le crawl budget et quels leviers peut-on actionner ?

- □ Le crawl budget est-il un concept inventé par Google ou par les SEO ?

- □ Google n'indexe-t-il vraiment qu'une fraction du web à cause de ses coûts de stockage ?

- □ Les requêtes POST plombent-elles vraiment votre crawl budget ?

- □ Le crawl budget d'une nouvelle section est-il hérité de la qualité du site principal ?

- □ Les codes 503 et 429 peuvent-ils vraiment réduire votre crawl budget ?

- □ Peut-on vraiment piloter son crawl budget depuis Google Search Console ?

- □ HTTP/2 améliore-t-il vraiment votre crawl budget ?

- □ Pourquoi vos URLs 'découvertes mais non crawlées' révèlent-elles un problème de fond ?

- □ Faut-il bloquer l'indexation de vos fichiers JavaScript pour optimiser le crawl budget ?

- □ Les 404 et robots.txt gaspillent-ils vraiment votre crawl budget ?

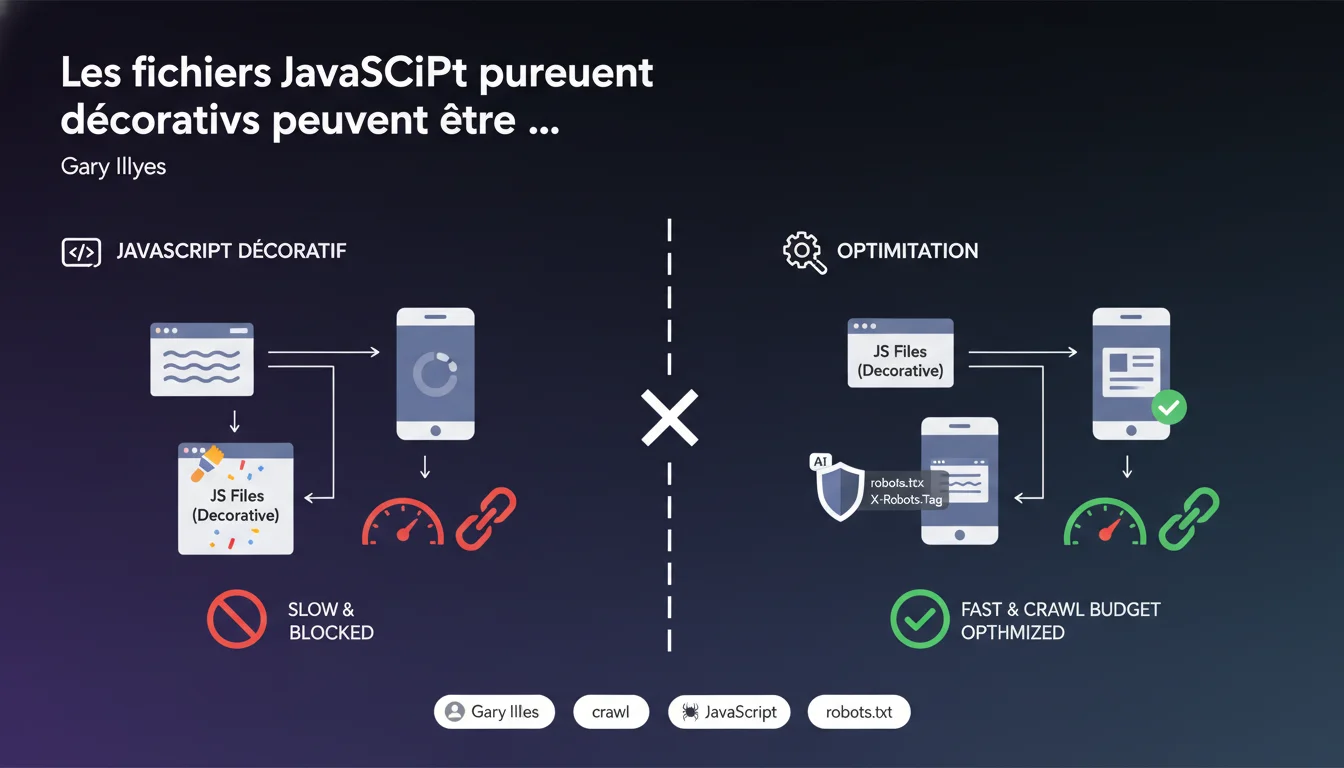

Google confirme qu'on peut bloquer sans risque les fichiers JavaScript purement décoratifs via robots.txt ou X-Robots-Tag. Le rendu échouera pour ces ressources, mais le contenu de la page reste intact — une opportunité d'optimiser son crawl budget en évitant que Googlebot ne perde du temps sur des ressources non essentielles.

Ce qu'il faut comprendre

Qu'entend Google par "JavaScript purement décoratif" ?

Google fait ici la distinction entre les scripts qui génèrent du contenu indexable et ceux qui ne servent qu'à l'animation visuelle ou à l'expérience utilisateur sans impact sur le rendu sémantique de la page. Un carrousel d'images avec transitions CSS, un effet parallaxe, des animations au scroll — tout ça peut être considéré comme décoratif.

Le problème : la frontière n'est pas toujours nette. Un script qui gère l'apparition d'un bouton CTA est-il décoratif ? Et un lazy-loading d'images ? Il faut trancher au cas par cas.

Pourquoi bloquer ces ressources peut-il optimiser le crawl budget ?

Chaque fois que Googlebot rend une page, il doit télécharger et exécuter les scripts qu'elle référence. Sur un site avec des milliers de pages, ça représente des millions de requêtes pour des fichiers qui n'apportent aucune valeur au rendu indexable.

En bloquant ces ressources via robots.txt ou X-Robots-Tag, on réduit le volume de données que Googlebot doit traiter, ce qui peut accélérer le crawl des pages stratégiques. C'est particulièrement pertinent pour les gros sites — e-commerce, médias, annuaires — où chaque seconde de crawl compte.

Le rendu échoue, mais ça ne pose pas de problème ?

Google dit clairement que le rendu échouera pour ces ressources bloquées, mais que le contenu de la page ne sera pas affecté. Autrement dit : si votre contenu est bien présent dans le HTML initial (server-side rendering ou pré-rendu), le blocage de scripts décoratifs n'empêche pas l'indexation.

C'est une confirmation importante — mais qui suppose que vous maîtrisez votre stratégie de rendu. Si votre contenu dépend d'un script bloqué, vous avez un problème.

- Les scripts décoratifs (animations, effets visuels) peuvent être bloqués sans impact sur l'indexation

- Le blocage se fait via robots.txt ou X-Robots-Tag

- Ça permet d'optimiser le crawl budget en réduisant le volume de ressources à télécharger

- Le rendu échoue pour ces ressources, mais le contenu reste accessible si le HTML initial est correct

- La distinction entre décoratif et fonctionnel n'est pas toujours évidente

Avis d'un expert SEO

Cette déclaration est-elle vraiment applicable en pratique ?

Sur le papier, c'est séduisant. Mais concrètement, combien de sites ont une architecture assez propre pour identifier précisément quels scripts sont purement décoratifs ? La plupart des frameworks JavaScript modernes (React, Vue, Next.js) mélangent logique métier et rendu visuel dans les mêmes bundles.

Soyons honnêtes : à moins d'avoir une stack technique rigoureusement architecturée avec des bundles séparés (vendor, core, decorative), cette recommandation reste théorique. Et même dans ce cas, bloquer un script peut avoir des effets de bord sur d'autres dépendances — notamment si des gestionnaires d'événements échouent silencieusement.

Quels risques si on bloque un script "presque" décoratif ?

Le vrai danger, c'est le faux négatif. Vous bloquez un script que vous pensez purement cosmétique, mais qui en réalité injecte des balises Schema.org, gère un lazy-loading d'images critiques, ou conditionne l'affichage d'un module de contenu. Googlebot ne verra rien, et vous ne le saurez peut-être pas avant plusieurs semaines.

Gary Illyes dit "le rendu échouera mais ça n'affectera pas le contenu" — mais [A vérifier] comment Google détermine ce qui est du contenu et ce qui ne l'est pas. Si un script décoratif charge un widget qui contient du texte indexable, est-ce du contenu ou de la décoration ? La déclaration manque de précision sur ce point.

Cette optimisation vaut-elle vraiment le coup pour tous les sites ?

Non. Si vous avez un site de 50 pages avec un crawl budget confortable, vous n'avez aucun intérêt à jouer avec le feu. Cette optimisation s'adresse aux sites de grande échelle — milliers de pages, crawl régulier, budgets serrés — où chaque milliseconde et chaque kilo-octet compte.

Pour un site moyen, le gain marginal ne justifie pas le risque d'erreur. Concentrez-vous d'abord sur les fondamentaux : temps de réponse serveur, pagination propre, maillage interne cohérent. Bloquer des scripts décoratifs, c'est du tuning avancé, pas de l'optimisation de base.

Impact pratique et recommandations

Comment identifier les fichiers JavaScript purement décoratifs ?

Commencez par un audit de toutes les ressources JS chargées sur vos pages stratégiques. Utilisez Chrome DevTools (onglet Coverage) pour voir quels scripts sont effectivement exécutés et quelle proportion de leur code est utilisée. Un script avec 5% de code utilisé est un bon candidat à l'analyse.

Ensuite, classez vos scripts en trois catégories : critiques (génération de contenu, SEO), fonctionnels (interaction utilisateur, tracking), décoratifs (animations, effets visuels). Seuls ces derniers peuvent être bloqués sans risque.

Quelle méthode de blocage choisir : robots.txt ou X-Robots-Tag ?

Le robots.txt est plus simple à mettre en place si vous bloquez des fichiers entiers (ex : toutes les ressources dans /assets/animations/). Mais il est rigide — un fichier bloqué l'est pour toutes les pages.

Le X-Robots-Tag offre plus de granularité : vous pouvez bloquer un script seulement pour certaines sections du site, ou conditionner le blocage à la réponse serveur. C'est plus complexe à configurer, mais plus puissant pour des stratégies avancées.

Comment vérifier que le blocage n'a pas cassé l'indexation ?

Testez systématiquement avec l'outil d'inspection d'URL de la Search Console. Demandez un rendu en direct, comparez le DOM obtenu avec celui sans blocage. Vérifiez que tous les éléments critiques (titres, textes, images, liens internes) sont bien présents.

Mettez en place un monitoring régulier : si des pages stratégiques perdent soudainement du trafic organique après l'implémentation, c'est un signal d'alerte. Croisez avec les logs serveur pour voir si Googlebot rencontre des erreurs inhabituelles.

- Auditer toutes les ressources JS avec Chrome DevTools (Coverage)

- Classer les scripts en critiques, fonctionnels, décoratifs

- Tester le blocage sur un échantillon de pages avant déploiement global

- Utiliser l'outil d'inspection d'URL pour valider le rendu

- Monitorer le trafic organique et les logs Googlebot post-implémentation

- Documenter tous les fichiers bloqués pour faciliter la maintenance future

❓ Questions frequentes

Bloquer un script décoratif peut-il affecter mon Core Web Vitals ?

Dois-je bloquer les bibliothèques d'animations comme GSAP ou Lottie ?

Le blocage via robots.txt empêche-t-il l'indexation du fichier JS lui-même ?

Comment savoir si mon site a vraiment un problème de crawl budget ?

Cette optimisation fonctionne-t-elle aussi pour Bing et les autres moteurs ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/08/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.