Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Faut-il vraiment se préoccuper du crawl budget pour votre site ?

- □ Comment Google définit-il réellement le crawl budget et quels leviers peut-on actionner ?

- □ Le crawl budget est-il un concept inventé par Google ou par les SEO ?

- □ Google n'indexe-t-il vraiment qu'une fraction du web à cause de ses coûts de stockage ?

- □ Les requêtes POST plombent-elles vraiment votre crawl budget ?

- □ Le crawl budget d'une nouvelle section est-il hérité de la qualité du site principal ?

- □ Peut-on vraiment piloter son crawl budget depuis Google Search Console ?

- □ HTTP/2 améliore-t-il vraiment votre crawl budget ?

- □ Pourquoi vos URLs 'découvertes mais non crawlées' révèlent-elles un problème de fond ?

- □ Faut-il bloquer l'indexation de vos fichiers JavaScript pour optimiser le crawl budget ?

- □ Les 404 et robots.txt gaspillent-ils vraiment votre crawl budget ?

- □ Faut-il bloquer vos fichiers JavaScript décoratifs pour optimiser votre crawl budget ?

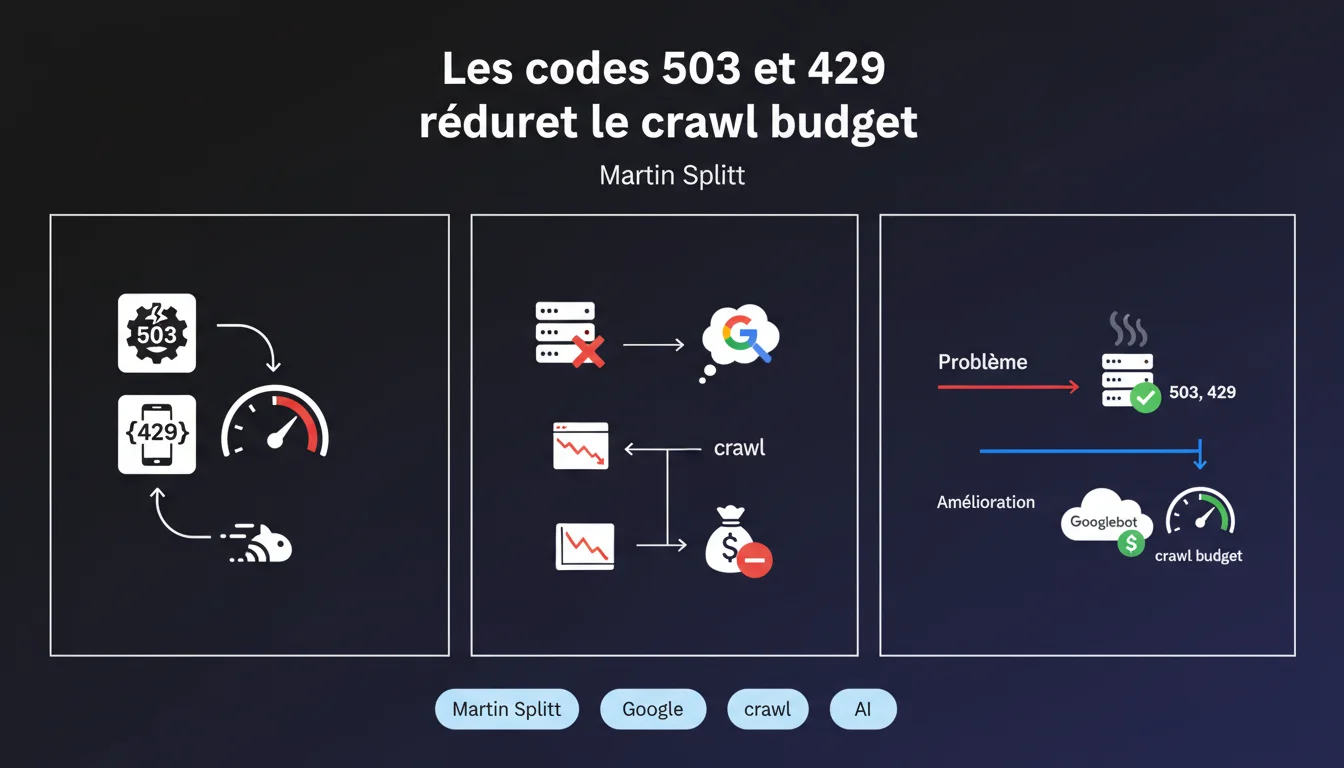

Les codes HTTP 503 et 429, ainsi que les temps de réponse lents, indiquent à Googlebot que votre serveur est surchargé. Conséquence directe : le robot ralentit son crawl et réduit le budget alloué à votre site. Bonne nouvelle : l'effet n'est pas définitif et disparaît dès que le serveur retrouve des performances normales.

Ce qu'il faut comprendre

Que se passe-t-il quand Googlebot rencontre un code 503 ou 429 ?

Googlebot interprète ces codes comme un signal de détresse serveur. Le 503 (Service Unavailable) signale une indisponibilité temporaire, tandis que le 429 (Too Many Requests) indique explicitement un dépassement de limite de requêtes.

Dans les deux cas, le robot applique une logique simple : ralentir pour éviter d'aggraver la situation. La réduction du crawl budget qui s'ensuit n'est pas une punition — c'est une mesure de protection, autant pour votre infrastructure que pour les ressources de Google.

Pourquoi les temps de réponse lents ont-ils le même effet ?

Un serveur qui met du temps à répondre envoie un signal similaire. Si vos pages mettent 2, 3 ou 5 secondes à se charger côté serveur, Googlebot en déduit que vous êtes à la limite de vos capacités.

Le robot ajuste alors son rythme pour ne pas saturer complètement votre infrastructure. Moins de requêtes par seconde = moins de pages crawlées dans le temps imparti = budget de crawl effectif réduit.

Cette réduction de crawl est-elle définitive ?

Non. Martin Splitt est clair : la situation s'améliore quand le serveur redevient sain. Googlebot teste régulièrement votre disponibilité et augmente progressivement le rythme si tout se passe bien.

Concrètement, si vous corrigez le problème (montée en charge serveur, optimisation applicative, correction d'un bug), vous devriez observer un retour à la normale en quelques jours — parfois quelques semaines pour les gros sites.

- 503 et 429 signalent à Googlebot un serveur en difficulté

- Le robot ralentit automatiquement son crawl pour protéger votre infrastructure

- Les temps de réponse lents produisent le même effet de réduction

- La baisse du crawl budget n'est pas permanente et s'inverse quand le serveur se stabilise

- Googlebot réévalue régulièrement la capacité de votre serveur à encaisser la charge

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. On observe depuis des années que les sites qui renvoient massivement des 503 — suite à une migration ratée, un pic de trafic imprévu ou un problème d'hébergement — voient leur fréquence de crawl chuter drastiquement.

Ce qui est intéressant, c'est que Google le reconnaît officiellement ici. Pas de langue de bois : si ton serveur ne suit pas, Googlebot lève le pied. Point.

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : tous les 503 ne se valent pas. Un 503 ponctuel sur une poignée d'URLs pendant 30 minutes ne déclenche pas la même réaction qu'un 503 global qui dure 3 jours. La durée, la fréquence et l'ampleur comptent.

Deuxième nuance : Martin parle de "temps de réponse lents", mais il ne précise pas de seuil. [À vérifier] : on ignore si Google considère qu'un temps de réponse serveur de 500ms est problématique, ou s'il faut atteindre 2-3 secondes pour déclencher une réaction. Certains tests internes suggèrent que le seuil se situe autour de 1-1,5 seconde, mais Google ne communique aucune donnée officielle là-dessus.

Troisième point : le retour à la normale n'est pas instantané. On observe souvent un délai de réaction — Googlebot attend de s'assurer que le problème est vraiment résolu avant de remonter progressivement le crawl. Sur des sites de taille moyenne, comptez une à deux semaines pour retrouver le rythme d'avant incident.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Les sites à très forte autorité — pensez Wikipedia, Amazon, sites d'actualité majeurs — bénéficient d'un traitement différent. Leur crawl budget est tellement élevé que même une réduction temporaire ne pénalise pas vraiment leur indexation.

À l'inverse, un petit site qui reçoit déjà 20 passages de Googlebot par jour et qui se prend une vague de 503 peut voir son crawl tomber à 5 passages — et ça, ça se voit directement dans les logs et dans les délais d'indexation.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter ces pénalités de crawl ?

Première priorité : monitorer la santé serveur. Si vous ne suivez pas déjà vos temps de réponse TTFB (Time To First Byte) et vos codes de statut, commencez maintenant. Google Search Console vous signale les erreurs serveur, mais ça arrive souvent trop tard — quand le problème a déjà impacté le crawl.

Deuxième action : analyser vos logs serveur pour identifier les patterns. Si Googlebot ralentit son rythme, vous devez savoir pourquoi. Un pic de 503 à 3h du matin pendant une maintenance automatique ? Un temps de réponse qui explose quand certaines pages lourdes sont crawlées ? Ces insights sont dans vos logs.

Troisième levier : optimiser les ressources côté serveur. Cache applicatif, CDN pour les assets, optimisation des requêtes de base de données, mise en place d'un reverse proxy — tout ce qui réduit la charge et accélère le TTFB joue en votre faveur.

Quelles erreurs éviter absolument ?

Erreur classique : renvoyer un 503 global pendant une migration ou une maintenance sans avoir désactivé le crawl via robots.txt ou l'outil de Search Console. Résultat : Googlebot se heurte à un mur de 503, interprète ça comme un problème de capacité, et réduit le crawl pour les jours ou semaines qui suivent.

Autre piège : utiliser un 429 pour "économiser le crawl budget". Certains SEO pensent pouvoir contrôler finement le rythme de Googlebot en renvoyant des 429 sur certaines sections. Ça ne marche pas comme prévu — vous risquez surtout de signaler un problème de performance et de réduire le crawl global du site.

Enfin, ne sous-estimez jamais l'impact des temps de réponse. Un TTFB qui oscille entre 800ms et 1,2 seconde ne déclenche peut-être pas d'alerte immédiate, mais ça limite mécaniquement le nombre de pages que Googlebot peut crawler dans le temps qu'il alloue à votre site.

Comment vérifier que mon site est conforme et réactif ?

- Mettre en place un monitoring temps réel du TTFB et des codes de statut HTTP

- Analyser les logs serveur pour repérer les ralentissements ou pics d'erreurs serveur

- Vérifier la Search Console régulièrement pour détecter les erreurs d'exploration

- Tester la montée en charge : votre serveur tient-il la cadence si Googlebot double son rythme ?

- Optimiser le cache applicatif pour réduire la charge sur les ressources critiques

- Configurer correctement les rate limits si vous en utilisez, et exclure Googlebot si nécessaire

- En cas de maintenance planifiée, communiquer via Search Console ou désactiver temporairement le crawl

❓ Questions frequentes

Combien de temps faut-il pour que le crawl budget remonte après un incident serveur ?

Un code 503 ponctuel sur une seule page réduit-il le crawl de tout le site ?

Quelle est la différence entre un 503 et un 429 du point de vue de Googlebot ?

Peut-on utiliser un 429 pour contrôler le rythme de crawl de Googlebot ?

À partir de quel temps de réponse serveur Googlebot commence-t-il à ralentir ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/08/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.