Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Faut-il vraiment se préoccuper du crawl budget pour votre site ?

- □ Comment Google définit-il réellement le crawl budget et quels leviers peut-on actionner ?

- □ Le crawl budget est-il un concept inventé par Google ou par les SEO ?

- □ Google n'indexe-t-il vraiment qu'une fraction du web à cause de ses coûts de stockage ?

- □ Les requêtes POST plombent-elles vraiment votre crawl budget ?

- □ Le crawl budget d'une nouvelle section est-il hérité de la qualité du site principal ?

- □ Les codes 503 et 429 peuvent-ils vraiment réduire votre crawl budget ?

- □ Peut-on vraiment piloter son crawl budget depuis Google Search Console ?

- □ HTTP/2 améliore-t-il vraiment votre crawl budget ?

- □ Pourquoi vos URLs 'découvertes mais non crawlées' révèlent-elles un problème de fond ?

- □ Les 404 et robots.txt gaspillent-ils vraiment votre crawl budget ?

- □ Faut-il bloquer vos fichiers JavaScript décoratifs pour optimiser votre crawl budget ?

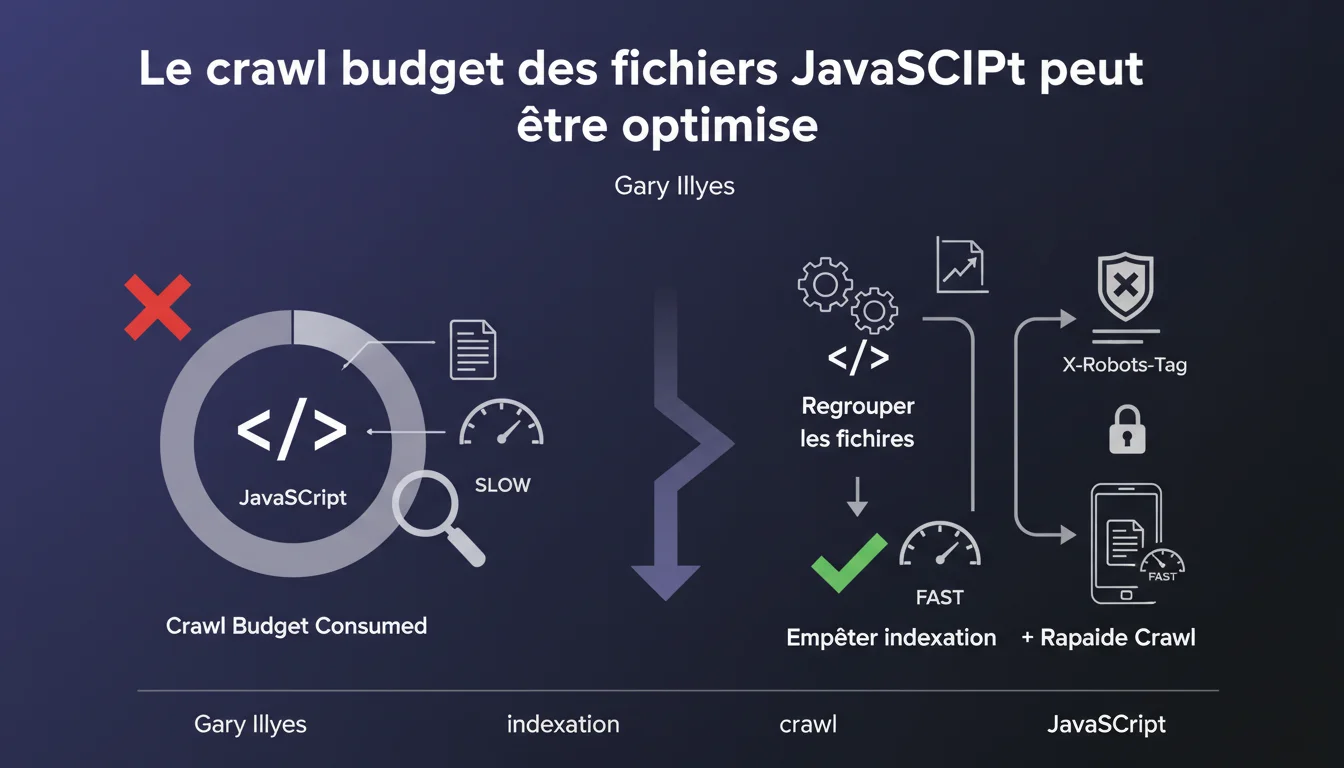

Google confirme qu'une part importante du crawl budget — parfois 35% à 90% — peut être gaspillée par des fichiers JavaScript qui n'apportent aucun contenu. Gary Illyes recommande de regrouper ces fichiers ou d'utiliser X-Robots-Tag pour empêcher leur indexation. L'objectif : libérer du budget pour les ressources réellement stratégiques.

Ce qu'il faut comprendre

Pourquoi Google crawle-t-il autant de fichiers JavaScript ?

Les fichiers JS représentent souvent une portion massive des ressources d'un site moderne. Frameworks front-end, bibliothèques tierces, scripts analytics, widgets sociaux — tout ça consomme du crawl budget, même si le contenu généré est nul ou déjà indexé ailleurs.

Le problème surgit quand Googlebot alloue 35% à 90% de son budget à ces fichiers, au détriment des pages réelles qui mériteraient d'être explorées et indexées. Résultat : des sections entières de votre site peuvent rester invisibles, simplement parce que le robot a épuisé son quota sur des dépendances inutiles.

Qu'est-ce qu'un fichier JavaScript qui « n'ajoute pas de contenu » ?

Typiquement, il s'agit de scripts qui ne modifient pas le DOM côté client de manière significative, ou dont le contenu généré est déjà présent dans le HTML initial. Les polyfills, certaines librairies d'animation, des trackers publicitaires — autant de candidats.

Google précise ici un angle souvent négligé : même si un JS est techniquement utile pour l'UX, s'il ne produit aucun contenu indexable, il devient un poids mort dans le budget crawl.

Comment libérer du budget crawl concrètement ?

Deux leviers principaux ressortent de cette déclaration officielle :

- Regrouper les fichiers : bundling, minification, tree-shaking — classique, mais encore sous-utilisé. Un seul fichier au lieu de 15 réduit drastiquement le nombre de requêtes crawlées.

- Bloquer l'indexation via X-Robots-Tag : empêche Googlebot de tenter d'indexer ces ressources, économisant des cycles de crawl pour le contenu réel.

- Lazy-loading des scripts non critiques, différé après le premier rendu — Google ne crawlera pas ce qui ne charge pas au premier passage.

- Audit régulier des scripts tiers : combien de trackers, widgets, chat-bots sont vraiment indispensables ?

Avis d'un expert SEO

Cette recommandation est-elle cohérente avec les observations terrain ?

Oui, et c'est même un rappel bienvenu. Les audits de crawl budget montrent systématiquement une sur-représentation des assets JS/CSS dans les logs serveur — parfois jusqu'à écraser le crawl des catégories ou des fiches produit sur les gros sites e-commerce.

Cependant, Gary Illyes reste vague sur les seuils. « 35% ou 90% » — la fourchette est énorme. Concrètement, à partir de quel pourcentage faut-il s'inquiéter ? [A vérifier] car aucune métrique claire n'est donnée pour diagnostiquer son propre site.

Quelles nuances faut-il apporter ?

Bloquer l'indexation via X-Robots-Tag ne signifie pas que Googlebot cesse de télécharger le fichier. Il le crawle toujours pour exécuter le JS et comprendre la page. L'économie porte sur l'indexation, pas sur la bande passante ni le temps de traitement.

Ensuite, regrouper les fichiers peut créer un bundle monolithique qui charge du code inutile sur certaines pages. Le compromis idéal dépend de la structure du site : un bundle global pour un site vitrine de 10 pages, du code-splitting pour une webapp de 10 000 URL.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur un site avec quelques centaines de pages et un crawl budget largement suffisant, optimiser les fichiers JS devient secondaire. L'impact sera négligeable si Googlebot passe déjà toutes vos pages plusieurs fois par jour.

À l'inverse, les sites à fort volume — marketplaces, médias, annuaires — doivent traiter ce sujet comme prioritaire. Une économie de 20% de crawl budget peut signifier des milliers de pages supplémentaires indexées par mois.

Impact pratique et recommandations

Que faut-il faire concrètement pour auditer son site ?

Première étape : analyser les logs serveur pour identifier la proportion de requêtes Googlebot consommées par les fichiers JS. Outils comme Oncrawl, Botify, ou un script custom sur vos logs Apache/Nginx.

Ensuite, croiser avec les rapports de couverture dans Search Console. Si des sections stratégiques apparaissent comme « Détectées — non indexées » alors que le crawl budget part massivement sur des assets, vous avez un diagnostic clair.

Quelles erreurs éviter absolument ?

Ne bloquez pas à l'aveugle tous les fichiers JS via robots.txt — ça empêche le rendu complet et Google ne verra pas le contenu généré côté client. X-Robots-Tag est préférable : il autorise le téléchargement/exécution, mais désindexe le fichier lui-même.

Autre piège : oublier de tester après regroupement. Un bundle mal configuré peut introduire des erreurs JS qui cassent le rendu, rendant vos pages invisibles pour Google.

- Analyser les logs serveur pour quantifier la part de crawl budget consommée par les fichiers JS/CSS

- Identifier les scripts qui ne génèrent aucun contenu indexable (trackers, analytics, widgets décoratifs)

- Regrouper et minifier les fichiers critiques ; lazy-loader le reste

- Ajouter X-Robots-Tag: noindex sur les fichiers JS non essentiels à l'indexation

- Tester le rendu dans l'outil d'inspection d'URL Search Console avant et après modifications

- Monitorer l'évolution du crawl budget et de la couverture indexée sur 4-6 semaines

Comment vérifier que les optimisations portent leurs fruits ?

Suivez deux métriques clés : le taux de crawl des pages stratégiques (augmentation attendue) et le nombre de pages indexées dans Search Console (idem). Un délai de 2 à 4 semaines est normal avant de voir l'impact stabilisé.

Si vous constatez une hausse du crawl sur les catégories/produits et une baisse sur les assets JS, vous êtes sur la bonne voie. Un suivi régulier via des dashboards automatisés permet d'anticiper les régressions.

❓ Questions frequentes

Le X-Robots-Tag empêche-t-il Googlebot de télécharger les fichiers JavaScript ?

Faut-il bloquer les fichiers JavaScript via robots.txt ?

À partir de quel seuil dois-je m'inquiéter de la consommation de crawl budget par les fichiers JS ?

Le bundling des fichiers JavaScript peut-il nuire aux performances ?

Comment mesurer l'impact de ces optimisations sur le crawl budget ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/08/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.