Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Googlebot est-il vraiment un seul programme ou une infrastructure distribuée ?

- □ Le crawl Google fonctionne-t-il vraiment par API avec des paramètres configurables ?

- □ Pourquoi Google ne documente-t-il pas tous ses crawlers dans sa liste officielle ?

- □ Crawlers vs Fetchers : pourquoi Google utilise-t-il deux systèmes distincts pour accéder à vos pages ?

- □ Google réutilise-t-il vraiment le cache entre ses différents crawlers ?

- □ Pourquoi Googlebot crawle-t-il principalement depuis les États-Unis ?

- □ Pourquoi Google ne crawle-t-il pas massivement votre contenu géobloqué ?

- □ Pourquoi le géoblocage peut-il nuire au crawl de votre site par Google ?

- □ Le crawl budget est-il vraiment protégé automatiquement par Google ?

- □ Pourquoi Google impose-t-il une limite de 15 Mo par page crawlée ?

- □ Pourquoi Google impose-t-il une limite de 2 Mo pour crawler vos pages web ?

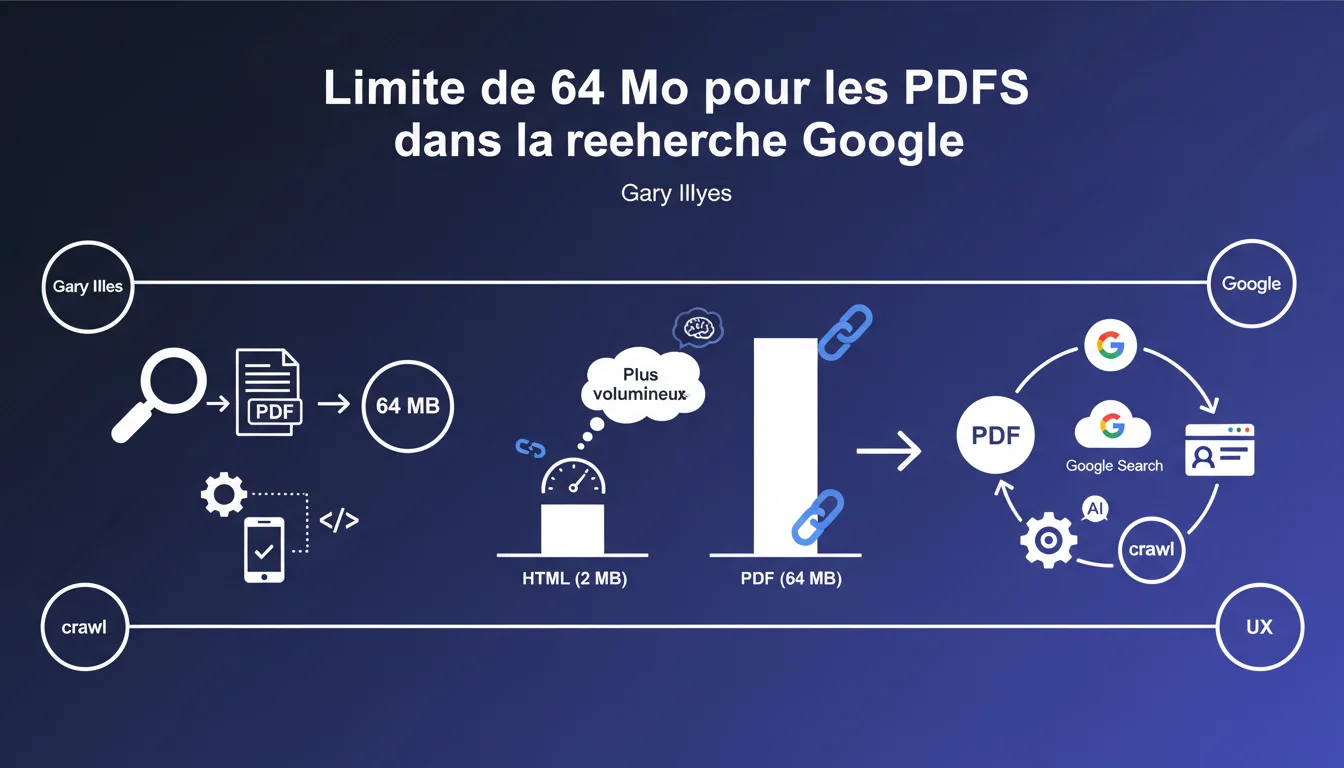

Google applique une limite de crawl de 64 Mo pour les fichiers PDF, soit 32 fois plus que les 2 Mo autorisés pour le HTML. Cette différence s'explique par la nature intrinsèquement plus volumineuse des PDFs, qui intègrent polices, images et métadonnées. Un document qui dépasse ce seuil ne sera tout simplement pas crawlé intégralement par Googlebot.

Ce qu'il faut comprendre

Quelle est exactement cette limite de 64 Mo annoncée par Gary Illyes ?

Google impose une limite stricte de crawl à environ 64 mégaoctets pour les fichiers PDF indexables. Concrètement, si votre PDF dépasse cette taille, Googlebot arrêtera sa lecture au seuil et n'indexera pas le contenu restant.

Cette restriction s'applique uniquement au crawl — autrement dit, à la lecture du fichier par le robot. Elle ne concerne pas le téléchargement initial du PDF par un utilisateur, mais bien la capacité de Google à extraire et indexer son contenu textuel.

Pourquoi cette limite est-elle 32 fois plus élevée que celle du HTML ?

Les fichiers HTML sont limités à environ 2 Mo par Google, une contrainte connue depuis des années. Les PDFs, eux, embarquent bien plus que du texte brut : polices intégrées, images haute résolution, métadonnées structurées, annotations, formulaires interactifs.

Un PDF de documentation technique ou un rapport annuel peut rapidement atteindre plusieurs dizaines de mégaoctets sans être pour autant « lourd » au sens fonctionnel. Google a donc calibré cette limite à 64 Mo pour couvrir la majorité des cas d'usage professionnels légitimes, tout en évitant que Googlebot ne se retrouve à crawler des fichiers démesurés.

Cette limite s'applique-t-elle à tous les types de PDFs ?

Oui, sans distinction. Qu'il s'agisse d'un PDF natif textuel (généré depuis Word ou InDesign), d'un PDF scanné avec OCR, ou d'un PDF image pur, la limite de 64 Mo s'applique uniformément.

Attention toutefois : un PDF scanné sans OCR ne sera de toute façon pas indexable textuellement par Google, quelle que soit sa taille. La limite de crawl n'entre en jeu que si le contenu est techniquement extractible.

- Limite de crawl PDF : ~64 Mo (volume fichier complet)

- Limite de crawl HTML : ~2 Mo (code source uniquement)

- Au-delà du seuil : le contenu excédentaire n'est pas indexé

- Type de PDF : la limite s'applique à tous, mais seuls les PDFs textuels/OCR sont indexables

- Implications pratiques : surveiller le poids des PDFs stratégiques pour le SEO

Avis d'un expert SEO

Cette limite de 64 Mo correspond-elle vraiment aux pratiques observées sur le terrain ?

Soyons honnêtes : jusqu'à cette déclaration de Gary Illyes, la plupart des SEO ignoraient qu'une limite spécifique existait pour les PDFs. L'observation terrain montre que les PDFs de 10 à 30 Mo s'indexent généralement sans difficulté, ce qui est cohérent avec un plafond à 64 Mo.

En revanche, pour les fichiers très volumineux — catalogues produits de 80 Mo, rapports annuels illustrés de 100 Mo — des problèmes d'indexation partielle ont souvent été constatés sans qu'on puisse toujours en identifier la cause. Cette clarification officielle explique enfin ces cas limites. [À vérifier] : Google n'a pas précisé si cette limite s'applique depuis toujours ou si elle a été introduite récemment.

La différence de traitement HTML/PDF pose-t-elle un problème d'équité ?

Pas vraiment. Comparer la limite de 2 Mo pour le HTML et celle de 64 Mo pour le PDF n'a de sens que si on compare des pommes avec des pommes. Le HTML moderne est rarement « lourd » en lui-même — ce sont les ressources externes (CSS, JS, images) qui alourdissent une page, et celles-ci ne sont pas comptabilisées dans la limite de 2 Mo.

Un PDF, lui, embarque tout : polices, images, métadonnées. Les 64 Mo incluent donc l'équivalent du HTML + toutes ses ressources. En ce sens, Google applique une logique relativement cohérente entre formats.

Faut-il s'inquiéter si un PDF stratégique dépasse 64 Mo ?

Ça dépend de votre contexte. Si le PDF en question est un asset SEO critique — par exemple, un guide technique que vous voulez positionner sur des requêtes longue traîne — alors oui, c'est un problème.

Si c'est un document annexe mis à disposition pour téléchargement (rapport financier détaillé, archive historique), l'impact SEO sera limité. Mais dans ce cas, pourquoi le laisser indexable ? Un simple X-Robots-Tag: noindex en en-tête HTTP ou un robots.txt bien configuré résoudrait la question.

Impact pratique et recommandations

Que faire concrètement si mes PDFs dépassent ou approchent cette limite ?

Première étape : auditer les PDFs actuellement indexés sur votre site. Utilisez un crawler (Screaming Frog, OnCrawl, Botify) configuré pour extraire les URLs de fichiers PDF et leur poids. Filtrez ceux qui dépassent 50 Mo — c'est votre zone rouge.

Pour chaque PDF volumineux, posez-vous la question : ce document a-t-il une vocation SEO ? Si oui, il faut réduire son poids. Si non, désindexez-le proprement.

Quelles techniques utiliser pour réduire le poids d'un PDF sans perdre en qualité ?

Les leviers d'optimisation sont classiques mais souvent négligés. Compresser les images intégrées au PDF (passage en 150-200 dpi au lieu de 300 dpi pour le web), retirer les polices non utilisées, supprimer les métadonnées inutiles, désactiver les calques Photoshop embarqués.

Des outils comme Adobe Acrobat Pro, Ghostscript, ou des services en ligne type Smallpdf permettent une compression efficace. Dans la plupart des cas, un PDF de 80 Mo peut être ramené à 30-40 Mo sans dégradation visible à l'écran.

Comment vérifier que Google crawle bien l'intégralité de mes PDFs ?

Utilisez la Google Search Console pour inspecter l'URL du PDF et vérifier la version rendue par Googlebot. Si le contenu semble tronqué ou incomplet, c'est un signal d'alarme.

Autre technique : rechercher dans Google une expression textuelle située en fin de PDF (dernière page, annexes). Si elle n'apparaît pas dans l'index alors que le début du document est bien indexé, vous avez probablement un problème de limite de crawl.

- Auditer tous les PDFs indexables et identifier ceux > 50 Mo

- Compresser les images intégrées (150-200 dpi suffisent pour le web)

- Retirer les polices embarquées non essentielles

- Découper les documents volumineux en plusieurs fichiers thématiques si pertinent

- Tester la version crawlée via Google Search Console (inspection d'URL)

- Vérifier l'indexation du contenu de fin de document avec des recherches ciblées

- Désindexer les PDFs non stratégiques (X-Robots-Tag: noindex ou robots.txt)

- Implémenter un monitoring récurrent du poids des PDFs publiés

❓ Questions frequentes

La limite de 64 Mo s'applique-t-elle au poids du fichier sur le serveur ou au poids une fois décompressé ?

Si je découpe un PDF de 80 Mo en deux fichiers de 40 Mo, Google les indexera-t-il tous les deux intégralement ?

Un PDF hébergé sur un CDN externe (type Google Drive, Dropbox) est-il soumis à la même limite ?

Les PDFs générés dynamiquement (factures, rapports personnalisés) sont-ils concernés par cette limite ?

Google prévoit-il d'augmenter cette limite à l'avenir avec l'évolution des infrastructures ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.