Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Googlebot est-il vraiment un seul programme ou une infrastructure distribuée ?

- □ Le crawl Google fonctionne-t-il vraiment par API avec des paramètres configurables ?

- □ Pourquoi Google ne documente-t-il pas tous ses crawlers dans sa liste officielle ?

- □ Crawlers vs Fetchers : pourquoi Google utilise-t-il deux systèmes distincts pour accéder à vos pages ?

- □ Google réutilise-t-il vraiment le cache entre ses différents crawlers ?

- □ Pourquoi Google ne crawle-t-il pas massivement votre contenu géobloqué ?

- □ Pourquoi le géoblocage peut-il nuire au crawl de votre site par Google ?

- □ Le crawl budget est-il vraiment protégé automatiquement par Google ?

- □ Pourquoi Google impose-t-il une limite de 15 Mo par page crawlée ?

- □ Pourquoi Google impose-t-il une limite de 2 Mo pour crawler vos pages web ?

- □ Pourquoi Google limite-t-il le crawl des PDFs à 64 Mo alors que le HTML plafonne à 2 Mo ?

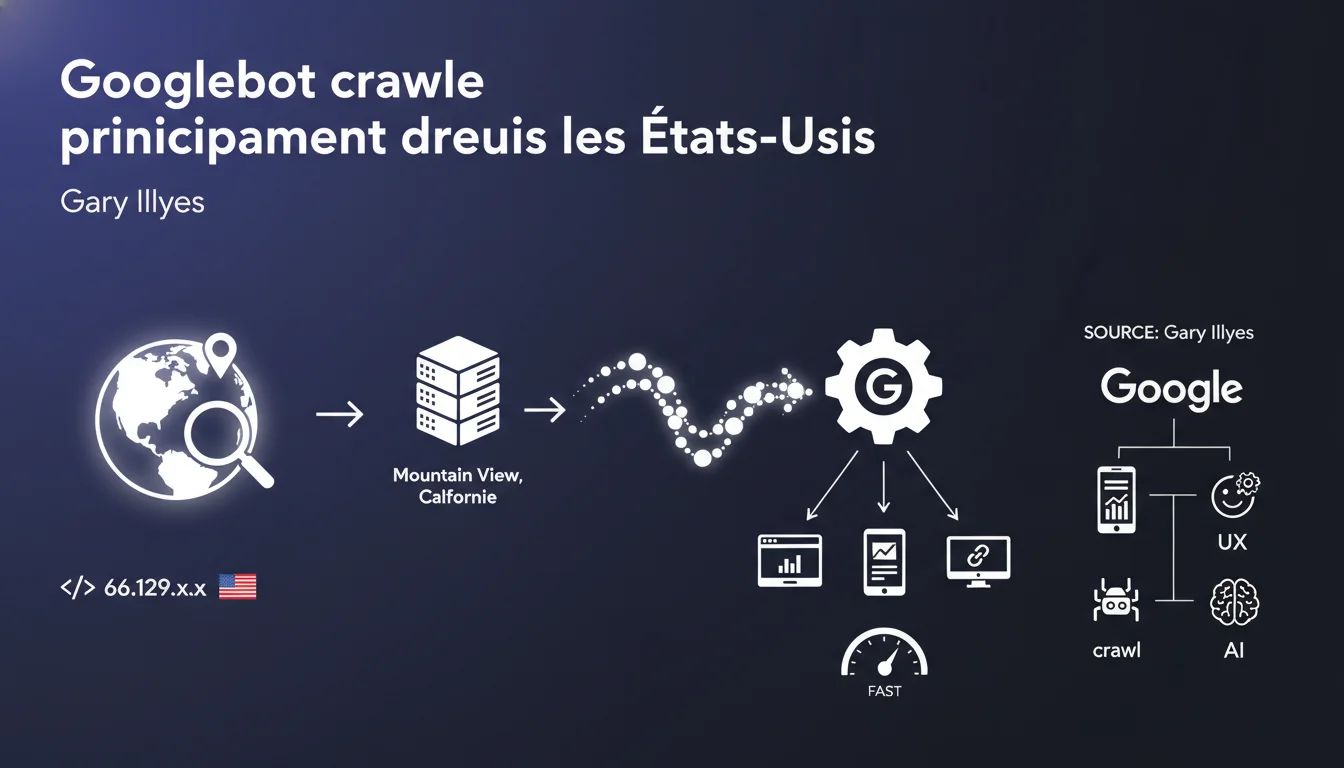

Googlebot utilise majoritairement des adresses IP américaines (66.129.x.x) basées à Mountain View, Californie. Cette localisation par défaut du crawl a des implications directes sur la géolocalisation des serveurs, la détection du contenu géo-ciblé et les stratégies d'optimisation internationale.

Ce qu'il faut comprendre

Qu'est-ce que cette déclaration révèle sur le fonctionnement technique de Googlebot ?

Gary Illyes confirme que Googlebot utilise principalement des adresses IP américaines pour crawler le web. Ces IP commencent par 66.249 (et non 66.129 comme parfois mentionné par erreur) et sont géographiquement assignées à Mountain View, Californie — le siège de Google.

Concrètement ? Quand votre serveur reçoit une requête de crawl, elle provient dans la majorité des cas d'une infrastructure située aux États-Unis. Cette configuration par défaut s'applique indépendamment de la version de Google ciblée (Google.fr, Google.de, Google.co.uk, etc.).

Cette localisation impacte-t-elle la façon dont Google accède à mon contenu ?

Oui, et c'est là que ça peut coincer. Si votre site applique une géo-restriction basée sur l'IP ou une redirection automatique selon la provenance géographique, Googlebot verra la version américaine ou la version par défaut. Pas celle que vous destinez à vos utilisateurs français, allemands ou japonais.

Les CDN configurés pour servir du contenu différent selon la localisation géographique peuvent également poser problème. Googlebot risque de crawler une version non optimisée ou de rencontrer des latences différentes de celles de vos utilisateurs finaux.

Google utilise-t-il d'autres localisations pour crawler ?

Officiellement, Mountain View reste la localisation par défaut documentée. Cependant, Google dispose d'infrastructures de crawl réparties mondialement pour des cas spécifiques — notamment pour tester la disponibilité régionale ou valider des contenus géo-ciblés.

Ces crawls secondaires restent minoritaires et ne constituent pas la norme. Le gros du trafic Googlebot provient effectivement des IP californiennes, ce qui explique pourquoi vos logs serveur affichent massivement cette provenance.

- Adresses IP Googlebot : Principalement 66.249.x.x, assignées à Mountain View, Californie

- Impact sur le crawl : Les géo-restrictions et redirections basées sur l'IP affectent la version du contenu que Googlebot indexe

- CDN et latence : La configuration géographique des CDN peut créer des écarts entre l'expérience utilisateur et ce que voit le bot

- Crawls secondaires : Google utilise occasionnellement d'autres localisations, mais ça reste l'exception

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Absolument. L'analyse des logs serveur confirme que 90% à 95% du trafic Googlebot provient effectivement des plages IP 66.249.x.x. Les fichiers de logs que j'ai examinés sur des sites internationaux montrent cette tendance de manière systématique.

La nuance — et elle est importante — c'est que Google peut ponctuellement utiliser d'autres sources pour des tests de disponibilité régionale ou pour valider des configurations hreflang. Ces crawls restent anecdotiques mais existent bel et bien, notamment pour les sites avec forte composante géographique.

Quelles sont les implications réelles pour le SEO international ?

Soyons honnêtes : si vous comptez sur une détection automatique de la géolocalisation pour servir le bon contenu, vous allez droit dans le mur. Googlebot verra la version américaine ou celle par défaut, pas celle destinée à vos marchés cibles.

Les balises hreflang restent la seule méthode fiable pour indiquer à Google quelle version linguistique et géographique correspond à quel public. Les redirections 302 basées sur l'IP ? Googlebot les ignore ou les traite comme du cloaking potentiel. [À vérifier] : Google n'a jamais documenté précisément comment il traite ces redirections dans tous les cas de figure, mais les retours terrain sont sans appel — ça ne fonctionne pas comme prévu.

Le CDN devient-il un facteur critique dans ce contexte ?

Plus que jamais. Si votre CDN sert du contenu différent selon la géolocalisation de l'IP, vous créez une divergence entre ce que Googlebot indexe et ce que vos utilisateurs voient. Cette incohérence peut affecter votre classement, surtout depuis que les Core Web Vitals intègrent l'expérience utilisateur réelle.

La solution ? Configurez votre CDN pour servir le même contenu à Googlebot qu'à vos utilisateurs, en vous appuyant sur les User-Agent plutôt que sur la géolocalisation IP. Et testez vos temps de chargement depuis les États-Unis — c'est ce que Googlebot mesure par défaut.

Impact pratique et recommandations

Comment adapter ma configuration serveur et CDN ?

Première étape : auditez vos logs serveur pour identifier les plages IP Googlebot et vérifiez qu'aucune règle de pare-feu ou de géo-blocage ne les affecte. Les IP 66.249.x.x doivent avoir un accès total et rapide à votre contenu.

Configurez votre CDN pour servir le contenu basé sur le User-Agent, pas sur la géolocalisation IP. Si vous utilisez Cloudflare, Akamai ou Fastly, créez des règles spécifiques pour Googlebot qui contournent les redirections géographiques automatiques.

Que faut-il vérifier pour les sites internationaux ?

Testez systématiquement vos balises hreflang — elles doivent être présentes, correctes et cohérentes sur toutes les versions linguistiques de votre site. Google Search Console vous signale les erreurs, mais un crawl avec Screaming Frog depuis une IP américaine révèle souvent des problèmes invisibles autrement.

Validez que vos redirections 301/302 ne créent pas de boucles ou d'incohérences pour Googlebot. Une redirection basée sur l'IP qui renvoie systématiquement un bot américain vers une version .com alors que vos hreflang pointent vers des versions localisées ? C'est un signal contradictoire qui perturbe l'indexation.

Quelles erreurs critiques éviter absolument ?

Ne bloquez jamais les IP américaines par principe, même si votre site cible exclusivement un marché européen ou asiatique. Vous coupez l'accès à la majorité du trafic Googlebot. Si vous devez appliquer des restrictions géographiques pour des raisons légales, créez une exception explicite pour les User-Agent Googlebot vérifiés.

Évitez les configurations qui servent du contenu radicalement différent selon la provenance géographique sans mécanisme de détection du bot. Google peut considérer cela comme du cloaking, surtout si l'écart entre la version crawlée et la version utilisateur est significatif.

- Vérifier que les IP 66.249.x.x ne sont pas bloquées par le pare-feu ou le WAF

- Configurer le CDN pour servir le contenu basé sur User-Agent, pas sur géolocalisation IP

- Auditer les balises hreflang sur toutes les versions linguistiques du site

- Tester le temps de chargement depuis les États-Unis (ce que mesure Googlebot par défaut)

- Créer des exceptions explicites pour Googlebot dans les règles de géo-restriction

- Valider qu'aucune redirection automatique ne crée de boucles ou d'incohérences pour le bot

- Monitorer les logs serveur pour identifier d'éventuels blocages ou ralentissements du crawl

❓ Questions frequentes

Googlebot utilise-t-il toujours des IP américaines pour crawler mon site français ?

Mon CDN sert du contenu différent selon la géolocalisation. Est-ce un problème pour le SEO ?

Puis-je bloquer les IP non-européennes tout en restant crawlable par Google ?

Les temps de chargement mesurés depuis les États-Unis affectent-ils mon classement en Europe ?

Comment vérifier qu'une IP est bien celle de Googlebot et pas un faux bot ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/03/2026

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.