Declaration officielle

Ce qu'il faut comprendre

Pourquoi Google crawle-t-il des pages qui n'existent plus ?

Lorsque Googlebot rencontre une page retournant un code 404, il ne l'abandonne pas immédiatement. Le robot effectue des recrawls réguliers par précaution, au cas où la disparition serait accidentelle ou temporaire.

Cette stratégie permet à Google de vérifier si le contenu est revenu disponible, évitant ainsi de perdre définitivement des pages qui auraient été supprimées par erreur ou durant une maintenance.

Est-ce que ces crawls répétés consomment mon budget de crawl inutilement ?

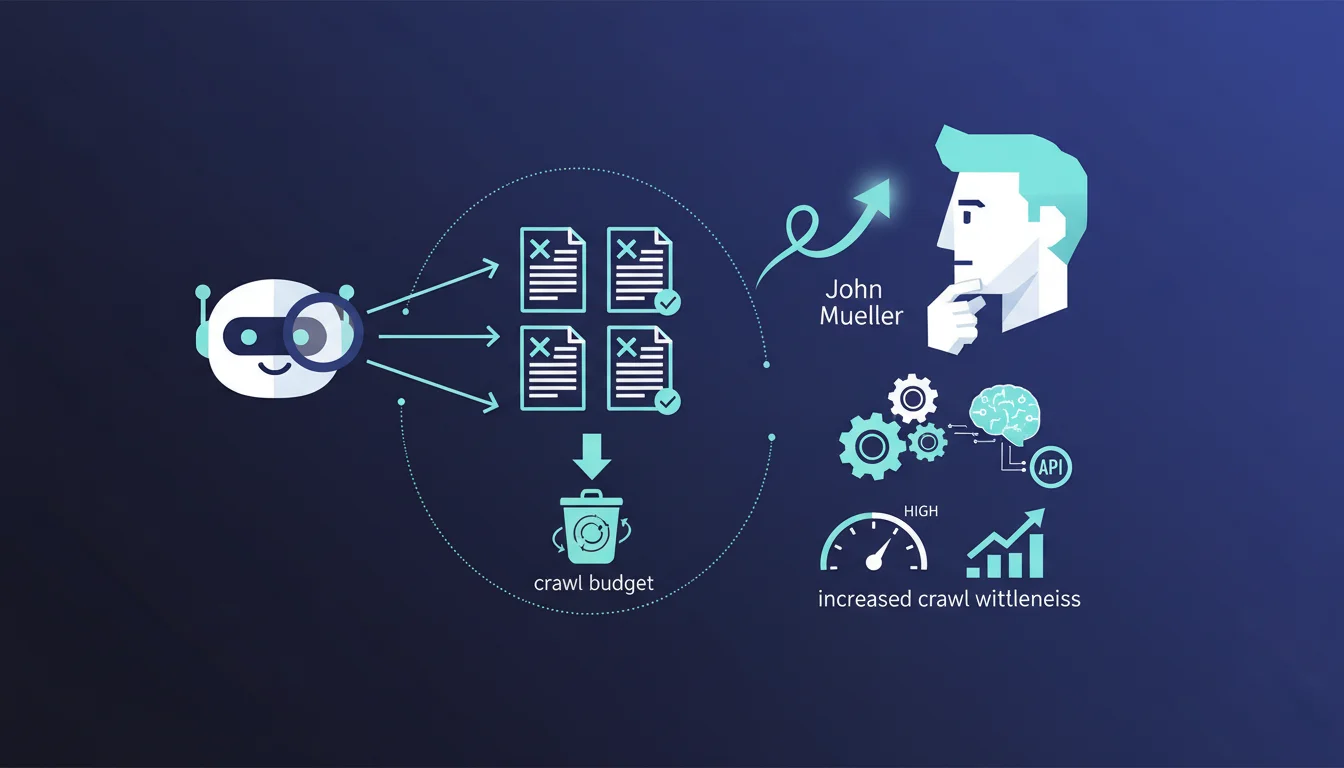

Contrairement à une inquiétude courante, ces visites répétées sur des 404 ne constituent pas un gaspillage problématique. Google gère intelligemment la fréquence de recrawl de ces pages.

Selon Mueller, ces crawls peuvent même être interprétés comme un signal positif : Google est disposé à récupérer davantage de contenu depuis votre site, ce qui indique une certaine confiance dans votre domaine.

Quelle différence entre un code 404 et un code 410 ?

Le code 404 indique qu'une page est introuvable, tandis que le code 410 signale une suppression définitive. En théorie, un 410 devrait accélérer la désindexation.

Cependant, Mueller précise que la différence pratique est minime. Google pourrait supprimer légèrement plus vite les pages 410 de son index, mais le gain reste marginal pour la plupart des sites.

- Googlebot recrawle les 404 par précaution contre les suppressions accidentelles

- Ces crawls répétés ne nuisent pas au budget de crawl global

- Un volume important de crawls 404 peut signaler que Google valorise votre site

- Passer de 404 à 410 apporte peu d'avantages concrets dans la majorité des cas

- La gestion intelligente du recrawl est automatique côté Google

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Depuis des années, les logs serveur des sites audités montrent effectivement que Googlebot revisite régulièrement des URLs en 404. Cette persistance s'observe particulièrement sur les domaines à forte autorité.

Cette déclaration confirme ce que les SEO expérimentés constatent : Google adopte une approche prudente et progressive face aux erreurs. Le moteur préfère vérifier plusieurs fois plutôt que de supprimer prématurément du contenu potentiellement pertinent.

Quelles nuances importantes faut-il apporter à cette affirmation ?

Si quelques centaines de 404 crawlés régulièrement sont normaux, des milliers de pages 404 actives peuvent quand même poser problème. Cela révèle généralement une architecture mal pensée ou une migration défaillante.

De plus, tous les 404 ne se valent pas. Des pages 404 qui recevaient beaucoup de backlinks de qualité ou de trafic organique méritent une attention particulière. Il est préférable de les rediriger en 301 vers du contenu pertinent plutôt que de laisser Google les recrawler indéfiniment.

Dans quels cas cette règle générale ne s'applique-t-elle pas ?

Sur les sites à très large échelle (millions de pages), le budget de crawl devient une ressource critique. Chaque visite sur une 404 est alors une opportunité perdue de crawler du contenu actif et indexable.

Pour les sites de petite taille avec peu de pages actives, laisser Google recrawler occasionnellement quelques 404 historiques n'a aucun impact. Mais pour un marketplace ou un site média volumineux, optimiser le crawl vers les pages stratégiques devient essentiel.

Impact pratique et recommandations

Que faut-il faire concrètement avec ses pages 404 ?

La priorité est d'identifier les 404 stratégiques : celles qui possèdent des backlinks externes, un historique de trafic important, ou qui correspondent à des recherches fréquentes. Ces pages doivent être redirigées en 301 vers le contenu le plus pertinent.

Pour les 404 sans valeur particulière (anciennes URLs de test, pages temporaires expirées, etc.), le mieux est de les laisser en 404. Google les gérera naturellement sans intervention de votre part.

Installez un monitoring régulier via la Search Console pour détecter les pics anormaux de 404. Une augmentation soudaine signale souvent un problème technique à corriger rapidement.

Quelles erreurs absolument éviter dans la gestion des 404 ?

Ne transformez jamais vos 404 en soft 404 en affichant une page d'erreur qui retourne un code 200. Google déteste cette pratique qui crée de la confusion et peut entraîner des pénalités.

Évitez les redirections massives de toutes vos 404 vers la page d'accueil. Cette technique génère une mauvaise expérience utilisateur et dilue inutilement le PageRank. Seules les redirections vers du contenu réellement pertinent ont du sens.

N'utilisez pas le code 410 systématiquement en pensant optimiser votre crawl. La différence pratique avec le 404 est négligeable, et vous risquez de supprimer définitivement des pages qui mériteraient une redirection future.

Comment vérifier et optimiser la gestion des erreurs sur mon site ?

Commencez par extraire la liste complète des URLs en erreur depuis la Search Console et vos logs serveur. Croisez ces données avec votre profil de backlinks pour identifier les priorités.

Segmentez vos 404 en catégories : celles à rediriger (avec backlinks ou valeur), celles à laisser (sans impact), et celles révélant des bugs techniques à corriger. Cette approche structurée permet d'optimiser votre temps.

- Auditer mensuellement les nouvelles pages 404 dans la Search Console

- Analyser les 404 qui reçoivent encore des backlinks externes de qualité

- Mettre en place des redirections 301 uniquement vers du contenu pertinent

- Créer une page 404 personnalisée avec des suggestions de navigation utiles

- Monitorer les logs serveur pour identifier les patterns de crawl sur les erreurs

- Corriger en priorité les causes techniques générant des 404 en masse

- Documenter les redirections importantes pour faciliter la maintenance future

- Éviter les soft 404 et les redirections automatiques vers l'accueil

💬 Commentaires (0)

Soyez le premier à commenter.