Declaration officielle

Autres déclarations de cette vidéo 22 ▾

- □ Pourquoi la position moyenne de Search Console ne reflète-t-elle pas un classement théorique mais des affichages réels ?

- □ Peut-on encore se permettre d'attendre qu'un classement instable se stabilise tout seul ?

- □ Faut-il vraiment produire plus de contenu pour améliorer son SEO ?

- □ Où placer son sitemap XML pour optimiser son crawl ?

- □ Faut-il vraiment utiliser l'outil d'inspection d'URL pour indexer un nouveau site ?

- □ Combien de temps faut-il attendre pour voir les backlinks dans Search Console ?

- □ Pourquoi les données Search Console et Analytics ne concordent-elles jamais vraiment ?

- □ Search Console collecte-t-elle vraiment toutes les données sur les gros sites e-commerce ?

- □ Faut-il vraiment préférer noindex à disallow pour contrôler l'indexation ?

- □ Les produits en rupture de stock peuvent-ils vraiment être traités comme des soft 404 par Google ?

- □ Les outils de test Google crawlent-ils vraiment en temps réel ou utilisent-ils un cache ?

- □ Google utilise-t-il des algorithmes différents selon votre secteur d'activité ?

- □ Pourquoi Google ignore-t-il les sites agrégateurs de faible effort ?

- □ Google compte-t-il vraiment les clics sur les rich results comme des clics organiques ?

- □ L'ordre des liens dans le HTML influence-t-il vraiment la priorité de crawl de Google ?

- □ Pourquoi robots.txt bloque le crawl mais n'empêche pas l'indexation de vos pages ?

- □ Les produits en rupture de stock nuisent-ils au classement global de votre site e-commerce ?

- □ Le contenu dupliqué partiel pénalise-t-il vraiment vos pages ?

- □ Pourquoi Google refuse-t-il d'indexer plusieurs versions d'une même page malgré une canonicalisation correcte ?

- □ Comment Google choisit-il réellement quelle URL canoniser parmi vos contenus dupliqués ?

- □ Les mentions de marque sans lien ont-elles une valeur SEO ?

- □ Pourquoi un lien sans URL indexée ne sert strictement à rien ?

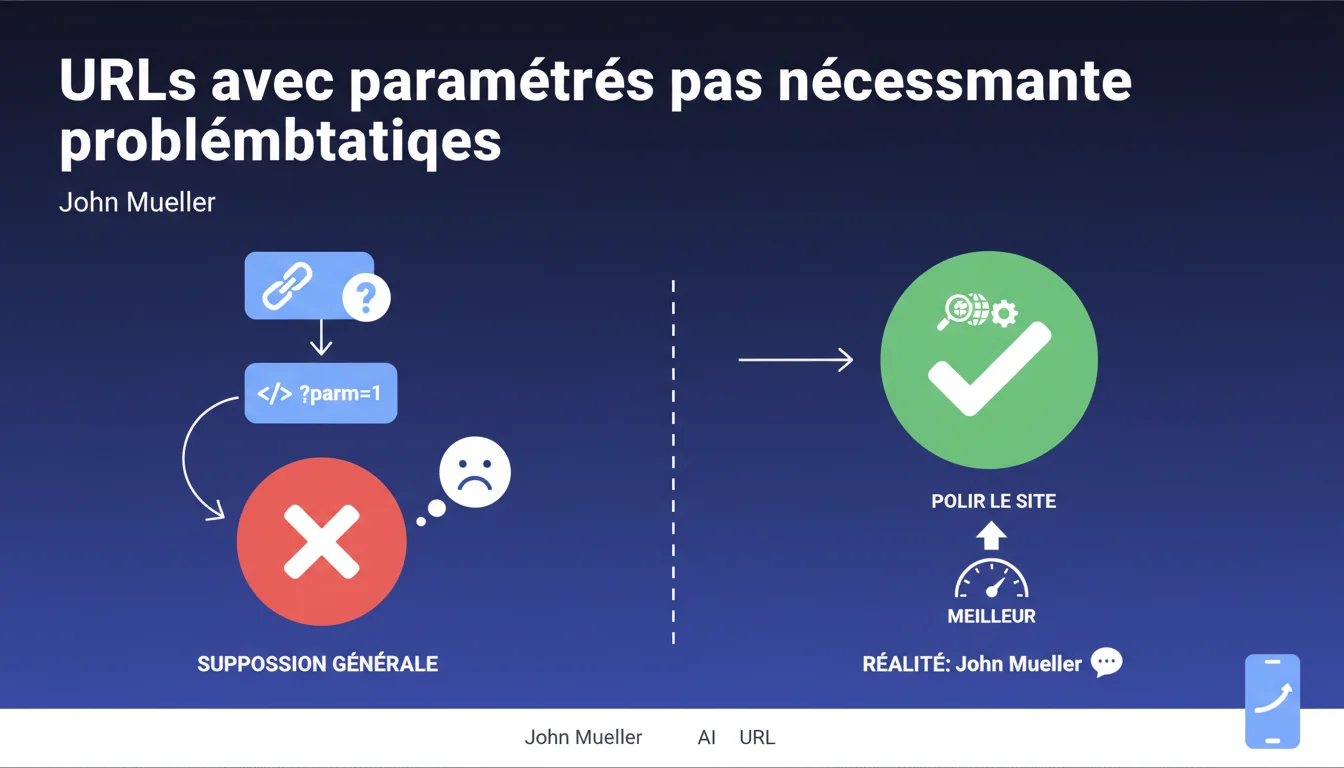

Les URLs avec paramètres ne sont pas intrinsèquement mauvaises pour le référencement. Google les gère très bien et leur optimisation relève davantage du perfectionnisme que de l'urgence technique. L'impact réel dépend du contexte et de l'implémentation — ne perdez pas votre temps sur ce chantier si vous avez des priorités SEO plus critiques.

Ce qu'il faut comprendre

Pourquoi cette idée reçue persiste-t-elle dans la communauté SEO ?

La méfiance envers les URLs avec paramètres remonte à une époque où les moteurs de recherche peinaient à les interpréter correctement. Les boucles d'indexation infinies, les contenus dupliqués générés par des facettes mal configurées, les problèmes de crawl budget — tout ça a marqué les esprits.

Sauf que Google a évolué. Le moteur digère aujourd'hui ces URLs sans broncher dans la majorité des cas. Le vrai problème n'est pas le paramètre en lui-même, mais comment il est utilisé.

Que veut dire Mueller par "polir le site" ?

Il place cette optimisation dans la catégorie des améliorations marginales. Pas un facteur bloquant, pas une pénalité qui vous attend au coin du bois. Simplement un détail qui peut rendre le site légèrement plus propre.

Concrètement, ça signifie que si votre site génère des millions de variations d'URLs via des paramètres de tri ou de filtres, mieux vaut les contrôler. Mais si vous avez quelques URLs avec des ?id=123 qui fonctionnent bien en Search Console — passez votre chemin, vous avez mieux à faire.

Quels types de paramètres posent réellement problème ?

Tous les paramètres ne se valent pas. Ceux qui créent du contenu unique (un produit spécifique, une catégorie) ne sont pas problématiques. Ceux qui génèrent des variations inutiles du même contenu (tri par prix croissant, décroissant, alphabétique) encombrent l'index.

Les sessions ID, les tracking parameters, les filtres superflus — voilà ce qui peut polluer votre crawl. Google sait généralement les ignorer, mais pourquoi prendre le risque quand une canonical propre ou un robots.txt bien configuré règle ça en deux minutes ?

- Les URLs avec paramètres ne pénalisent pas votre site par défaut

- Le vrai enjeu : éviter la dilution du crawl et les duplications inutiles

- Google gère bien ces URLs, mais pourquoi lui compliquer la tâche si vous pouvez faire autrement ?

- Priorisez d'abord les optimisations qui ont un impact mesurable sur vos KPIs

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment ce qu'on observe sur le terrain ?

Oui et non. Google indexe effectivement les URLs avec paramètres sans problème majeur dans 90% des cas. Mais dire que ce n'est "pas critique" mérite nuance.

Sur des sites e-commerce complexes avec des facettes multiples, on voit régulièrement des problèmes de crawl budget causés par des paramètres mal gérés. Google ne pénalise pas — il se perd. Résultat : des pages stratégiques qui ne sont pas crawlées assez souvent, des variations inutiles qui gonflent l'index. [A vérifier] systématiquement dans Search Console si vous avez plus de 10 000 URLs indexées.

Pourquoi Mueller minimise-t-il autant l'impact ?

Parce qu'il s'adresse probablement à des petits sites qui s'inquiètent pour rien. Un blog WordPress avec quelques paramètres de pagination ? Aucun souci, Google gère.

Mais cette généralisation peut être dangereuse pour les gros sites. Un marketplace avec des millions de combinaisons possibles ne peut pas se permettre de laisser Google décider tout seul quoi indexer. La réalité du terrain : les sites qui structurent proprement leurs URLs — avec ou sans paramètres — performent mieux. Pas à cause d'un boost SEO direct, mais parce qu'ils contrôlent leur architecture d'information.

Dans quels cas cette règle ne s'applique-t-elle absolument pas ?

Sites avec filtres facettés non canonicalisés : vous êtes assis sur une bombe à retardement. Sites avec des session IDs dans les URLs (oui, ça existe encore) : c'est du suicide SEO. Sites multilingues ou multi-devises qui gèrent ça via paramètres sans hreflang propre : même combat.

Mueller parle d'un cas général. Votre contexte spécifique peut exiger une réécriture d'URLs pour des raisons d'UX, de conversion, ou simplement de contrôle technique. Ne prenez pas cette déclaration comme une excuse pour ne rien faire si vous avez des signaux clairs de problèmes dans vos logs serveur.

Impact pratique et recommandations

Que faut-il auditer concrètement sur votre site ?

Commencez par Search Console : regardez les URLs indexées. Si vous voyez des centaines de variations avec paramètres pour le même contenu, vous avez un problème — même si Google prétend gérer.

Analyser vos logs serveur : Googlebot passe-t-il du temps sur des URLs parasites ? Si oui, vous gaspillez du crawl budget. Un simple filtre regex dans votre outil de log analysis vous donnera la réponse en 5 minutes.

Quelles actions prioriser selon votre situation ?

Si vous avez moins de 5000 pages indexées et quelques paramètres inoffensifs : ne touchez à rien. Vraiment. Passez votre temps sur du contenu ou des backlinks.

Si vous êtes un site e-commerce ou un marketplace : mettez en place une stratégie de canonicalisation stricte, bloquez les paramètres inutiles dans robots.txt, utilisez rel="canonical" religieusement. Et testez — ne présumez pas que Google fera le bon choix tout seul.

Si vous créez un nouveau site : privilégiez des URLs propres dès le départ. Même si les paramètres ne pénalisent pas, pourquoi vous compliquer la vie ? Une URL lisible améliore aussi le taux de clic en SERP — c'est mesurable.

- Vérifier dans Search Console le nombre d'URLs indexées avec paramètres

- Analyser les logs pour identifier les patterns de crawl sur ces URLs

- Mettre en place des canonicals sur toutes les variations non prioritaires

- Bloquer via robots.txt les paramètres purement tracking (utm_, fbclid, etc.)

- Documenter dans Google Search Console (anciennement URL Parameters tool, aujourd'hui via canonicals)

- Monitorer l'évolution du nombre d'URLs indexées sur 3 mois

- Si doute : privilégier la réécriture d'URLs propres pour les nouvelles fonctionnalités

❓ Questions frequentes

Google pénalise-t-il les sites qui utilisent des paramètres dans leurs URLs ?

Dois-je réécrire toutes mes URLs avec paramètres en URLs propres ?

Comment savoir si mes paramètres d'URL posent problème ?

Faut-il toujours utiliser des balises canonical sur les URLs avec paramètres ?

Les URLs avec paramètres impactent-elles le taux de clic en SERP ?

🎥 De la même vidéo 22

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.