Declaration officielle

Autres déclarations de cette vidéo 22 ▾

- □ Pourquoi la position moyenne de Search Console ne reflète-t-elle pas un classement théorique mais des affichages réels ?

- □ Peut-on encore se permettre d'attendre qu'un classement instable se stabilise tout seul ?

- □ Faut-il vraiment produire plus de contenu pour améliorer son SEO ?

- □ Faut-il vraiment utiliser l'outil d'inspection d'URL pour indexer un nouveau site ?

- □ Combien de temps faut-il attendre pour voir les backlinks dans Search Console ?

- □ Pourquoi les données Search Console et Analytics ne concordent-elles jamais vraiment ?

- □ Search Console collecte-t-elle vraiment toutes les données sur les gros sites e-commerce ?

- □ Faut-il vraiment préférer noindex à disallow pour contrôler l'indexation ?

- □ Les produits en rupture de stock peuvent-ils vraiment être traités comme des soft 404 par Google ?

- □ Les outils de test Google crawlent-ils vraiment en temps réel ou utilisent-ils un cache ?

- □ Google utilise-t-il des algorithmes différents selon votre secteur d'activité ?

- □ Pourquoi Google ignore-t-il les sites agrégateurs de faible effort ?

- □ Google compte-t-il vraiment les clics sur les rich results comme des clics organiques ?

- □ L'ordre des liens dans le HTML influence-t-il vraiment la priorité de crawl de Google ?

- □ Faut-il vraiment éviter les URLs avec paramètres pour le SEO ?

- □ Pourquoi robots.txt bloque le crawl mais n'empêche pas l'indexation de vos pages ?

- □ Les produits en rupture de stock nuisent-ils au classement global de votre site e-commerce ?

- □ Le contenu dupliqué partiel pénalise-t-il vraiment vos pages ?

- □ Pourquoi Google refuse-t-il d'indexer plusieurs versions d'une même page malgré une canonicalisation correcte ?

- □ Comment Google choisit-il réellement quelle URL canoniser parmi vos contenus dupliqués ?

- □ Les mentions de marque sans lien ont-elles une valeur SEO ?

- □ Pourquoi un lien sans URL indexée ne sert strictement à rien ?

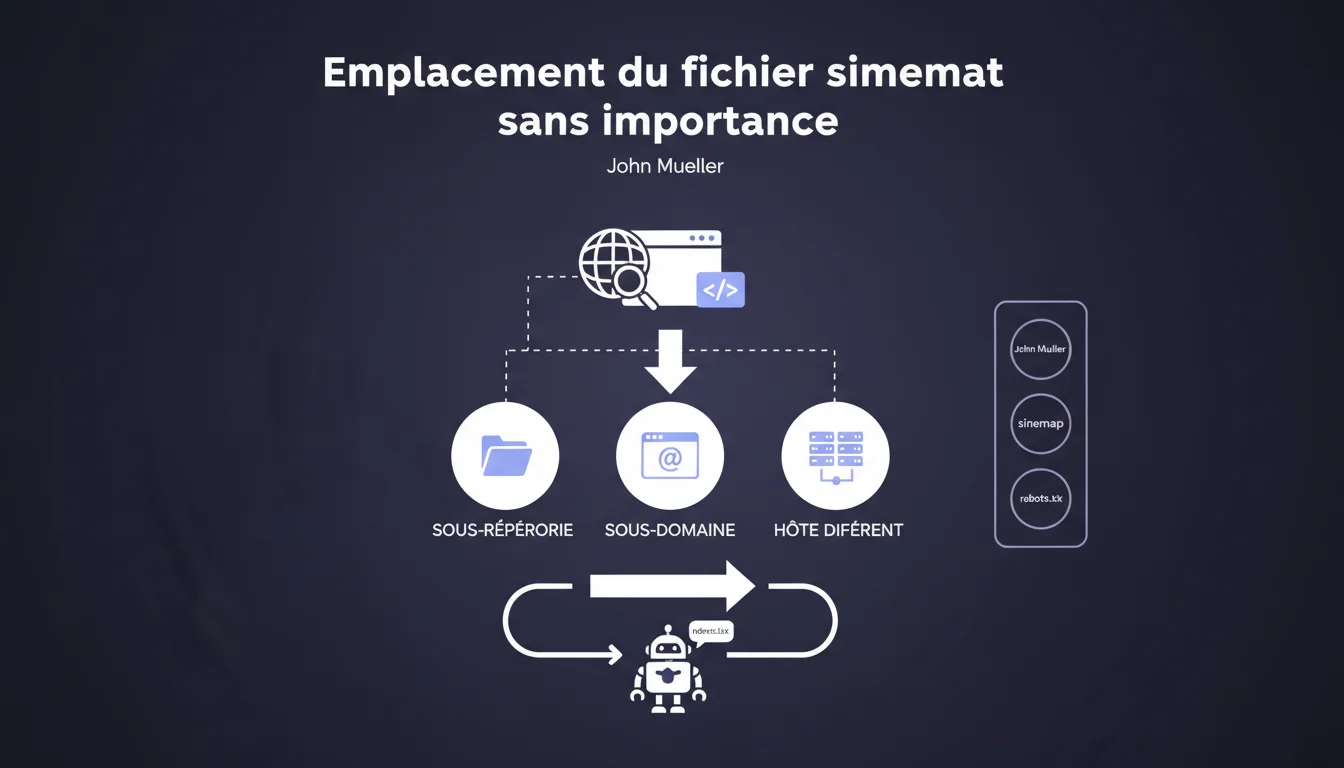

L'emplacement physique du fichier sitemap n'a aucune incidence sur son efficacité. Google peut le crawler depuis un sous-répertoire, un sous-domaine ou même un hôte distant, à condition qu'il soit déclaré dans le robots.txt. Seule cette déclaration compte réellement.

Ce qu'il faut comprendre

Pourquoi l'emplacement du sitemap a-t-il longtemps été considéré comme important ?

Historiquement, beaucoup de guides SEO recommandaient de placer le sitemap.xml à la racine du domaine (https://example.com/sitemap.xml). Cette pratique venait d'une époque où les standards n'étaient pas clairement définis et où certains outils imposaient des contraintes techniques.

La convention s'est maintenue par habitude — et parce que la plupart des CMS généraient automatiquement le fichier à cet endroit. Personne ne remettait vraiment en question cette localisation standard.

Que signifie concrètement cette déclaration de Mueller ?

Google s'appuie exclusivement sur la déclaration dans le robots.txt ou via Search Console pour localiser votre sitemap. Le chemin physique du fichier n'entre pas en ligne de compte dans l'équation.

Vous pouvez donc héberger votre sitemap sur cdn.example.com/data/sitemap.xml, example.com/wp-content/uploads/2023/sitemap.xml ou même external-host.com/example-sitemap.xml — tant que la référence est correcte dans robots.txt, Googlebot le trouvera.

Quelles sont les implications pour l'architecture technique ?

Cette flexibilité ouvre des possibilités pour les architectures distribuées. Sites multilingues avec des sous-domaines distincts, plateformes headless où le contenu est servi depuis plusieurs sources, configurations CDN complexes : tout devient plus simple.

Le seul prérequis reste l'accessibilité du fichier pour Googlebot et sa déclaration explicite. Pas de magie, pas de détection automatique.

- L'emplacement physique du sitemap n'affecte pas son efficacité

- La déclaration dans robots.txt ou Search Console est le seul mécanisme de découverte

- Vous pouvez héberger le sitemap sur un sous-domaine ou un hôte distinct

- Cette flexibilité facilite les architectures techniques complexes

- Le fichier doit rester accessible sans authentification ni blocage robots.txt

Avis d'un expert SEO

Cette déclaration est-elle vraiment surprenante ?

Non, franchement. Tout SEO qui a déjà testé différentes configurations l'a probablement observé empiriquement. Google suit les instructions explicites — c'est cohérent avec son approche générale du crawl.

Ce qui est intéressant, c'est que Mueller le formalise clairement. Ça met fin aux débats stériles sur la "meilleure" localisation du sitemap et aux recommandations dogmatiques qu'on trouve encore dans certains audits.

Quelles nuances faut-il apporter dans la pratique ?

Attention : tous les moteurs ne fonctionnent pas de la même façon. Bing, Yandex ou Baidu peuvent avoir leurs propres contraintes ou préférences. Tester reste indispensable si vous ciblez plusieurs moteurs.

Autre point — l'accessibilité technique. Un sitemap hébergé sur un CDN externe peut introduire des latences de synchronisation ou des problèmes de cache. Si votre fichier est mis à jour toutes les 10 minutes mais que le CDN invalide son cache toutes les heures, vous avez un problème de fraîcheur. [A vérifier] selon votre stack technique.

Dans quels cas cette flexibilité pose-t-elle problème ?

Sur les gros sites avec des sitemaps fragmentés (sitemap index + multiples sitemaps enfants), héberger les fichiers sur différents domaines peut compliquer le suivi et la maintenance. Vous multipliez les points de défaillance potentiels.

Si votre équipe de dev n'est pas rigoureuse sur la gestion des chemins et des redirections, vous risquez de casser silencieusement votre sitemap lors d'une migration ou d'un refactoring. La convention « à la racine » offre au moins une certaine prévisibilité — ce n'est pas négligeable dans les organisations où le turnover est élevé.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Rien de révolutionnaire. Si votre sitemap actuel fonctionne et qu'il est correctement crawlé, ne changez rien. N'optimisez pas ce qui n'est pas cassé.

En revanche, si vous avez des contraintes techniques qui vous empêchaient de placer le sitemap à la racine (restrictions d'accès serveur, CMS propriétaire, architecture microservices), vous savez maintenant que vous pouvez contourner le problème sans impact SEO.

Quelles erreurs éviter dans cette configuration ?

Ne partez pas du principe que Google va « deviner » où se trouve votre sitemap. La déclaration explicite reste absolument obligatoire — soit dans robots.txt, soit via Search Console.

Autre piège classique : déplacer le sitemap sans mettre à jour le robots.txt. Résultat : Google continue de chercher l'ancien fichier, obtient une 404, et arrête de crawler vos nouvelles URLs. Vérifiez toujours la cohérence entre votre déclaration et l'emplacement réel.

Enfin, si vous hébergez le sitemap sur un domaine externe, assurez-vous que ce domaine soit vérifié dans Search Console. Sinon, vous risquez des alertes de sécurité ou des blocages automatiques.

Comment vérifier que la configuration fonctionne correctement ?

- Testez l'accessibilité de votre sitemap avec un simple

curlouwgetdepuis une IP externe - Vérifiez que la directive

Sitemap:dans robots.txt pointe vers l'URL exacte du fichier - Consultez le rapport Sitemaps dans Search Console : erreurs de parsing, URLs non indexées, délais de traitement

- Si vous utilisez un sitemap index, vérifiez que tous les sitemaps enfants sont accessibles depuis leurs URLs déclarées

- Surveillez les logs serveur pour confirmer que Googlebot crawle effectivement le sitemap à la fréquence attendue

- Testez après toute modification d'architecture : migration, changement de CDN, refactoring

❓ Questions frequentes

Puis-je héberger mon sitemap sur un CDN comme Cloudflare ou Amazon S3 ?

Faut-il déclarer le sitemap dans robots.txt ET dans Search Console ?

Si je déplace mon sitemap, dois-je mettre une redirection 301 depuis l'ancien emplacement ?

Un sitemap hébergé sur un sous-domaine peut-il indexer des URLs du domaine principal ?

Cette règle s'applique-t-elle aussi aux sitemaps vidéo, images ou actualités ?

🎥 De la même vidéo 22

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 28/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.